Steerable Vision-Language-Action Policies for Embodied Reasoning and Hierarchical Control

作者: William Chen, Jagdeep Singh Bhatia, Catherine Glossop, Nikhil Mathihalli, Ria Doshi, Andy Tang, Danny Driess, Karl Pertsch, Sergey Levine

分类: cs.RO

发布日期: 2026-02-13

💡 一句话要点

提出可操纵的视觉-语言-动作策略,用于具身推理和分层控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 视觉语言模型 机器人控制 分层控制 可操纵策略

📋 核心要点

- 现有方法依赖自然语言指令连接VLM和低级策略,限制了VLM推理对机器人行为的精细控制。

- 论文提出可操纵策略,通过在多级别抽象命令上训练VLA,提升低级策略的可控性。

- 实验表明,该方法在真实世界操作任务中,优于现有具身推理VLA和基于VLM的分层基线。

📝 摘要(中文)

预训练的视觉-语言模型(VLM)可以在不同的环境中进行语义和视觉推理,为机器人控制提供有价值的常识先验知识。然而,如何有效地将这些知识融入到机器人行为中仍然是一个开放的挑战。先前的方法通常采用分层方法,其中VLM推理高级命令,然后由单独的低级策略(例如,视觉-语言-动作模型(VLA))执行。VLM和VLA之间的接口通常是自然语言任务指令,这从根本上限制了VLM推理对低级行为的指导程度。因此,我们引入了可操纵策略:VLA在各种抽象级别的丰富合成命令上进行训练,例如子任务、运动和接地的像素坐标。通过提高低级可控性,可操纵策略可以解锁VLM中预训练的知识,从而提高任务泛化能力。我们通过使用学习到的高级具身推理器和现成的VLM(通过上下文学习推理命令抽象)来控制我们的可操纵策略,从而证明了这种优势。在广泛的真实世界操作实验中,这两种新颖的方法优于先前的具身推理VLA和基于VLM的分层基线,包括在具有挑战性的泛化和长时程任务上。

🔬 方法详解

问题定义:现有方法在将预训练的视觉-语言模型(VLM)应用于机器人控制时,通常采用分层结构,VLM负责生成高级指令,而低级策略(如视觉-语言-动作模型VLA)负责执行。然而,VLM和VLA之间的接口通常是自然语言指令,这限制了VLM推理对低级行为的精细控制,阻碍了VLM知识的充分利用。现有方法的痛点在于低级策略的可控性不足,无法充分响应VLM的推理结果。

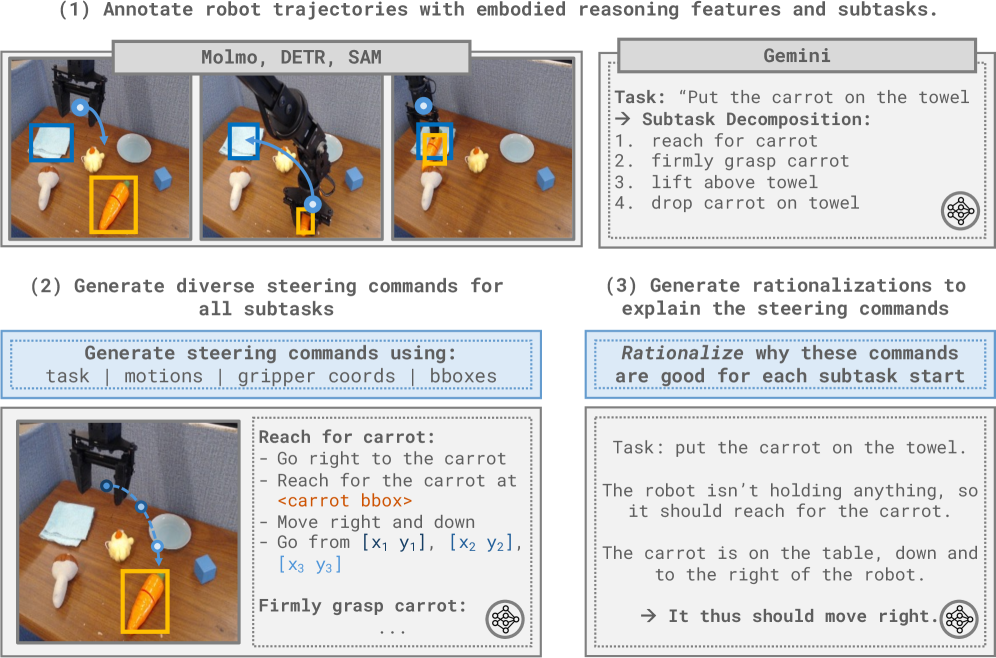

核心思路:论文的核心思路是提高低级策略的可操纵性,使其能够更好地响应VLM的推理结果。具体而言,通过在各种抽象级别的丰富合成命令(例如,子任务、运动和接地的像素坐标)上训练VLA,使得低级策略能够理解和执行更精细的指令,从而解锁VLM中预训练的知识。这样设计的目的是为了弥合VLM推理和机器人行为之间的差距,提高任务泛化能力。

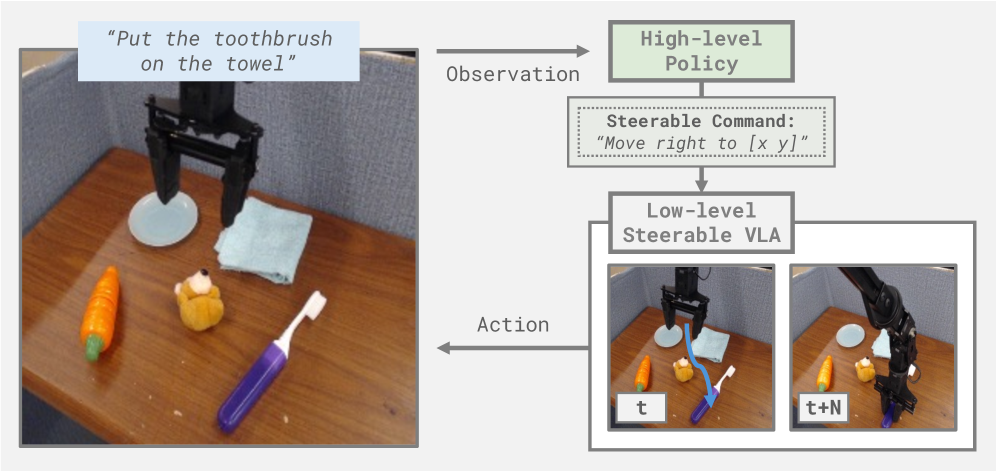

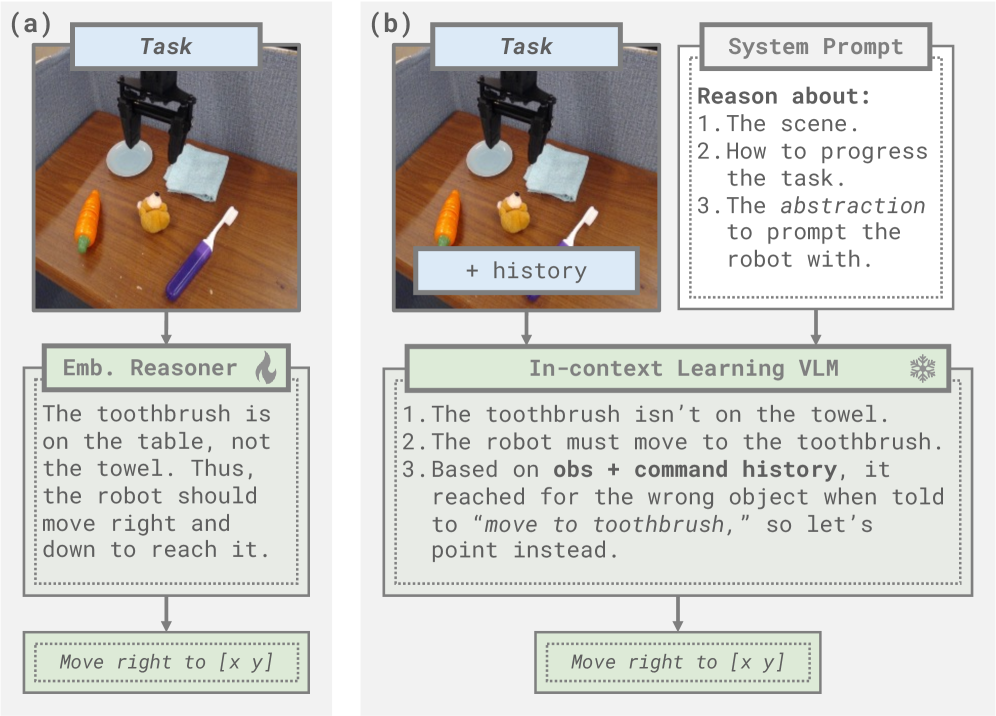

技术框架:整体框架包含两个主要部分:可操纵策略(Steerable Policies)和高级推理器。可操纵策略是经过训练的VLA,能够根据各种抽象级别的命令执行动作。高级推理器可以是学习到的具身推理器,也可以是现成的VLM,负责生成控制可操纵策略的命令。整体流程是,高级推理器根据任务目标生成命令,然后可操纵策略根据命令执行相应的动作。

关键创新:最重要的技术创新点在于可操纵策略的设计,它通过在多级别抽象命令上进行训练,提高了低级策略的可控性。与现有方法相比,可操纵策略能够理解和执行更精细的指令,从而更好地响应VLM的推理结果。这使得VLM能够更有效地指导机器人行为,提高了任务泛化能力。

关键设计:论文中关键的设计包括:1) 使用合成数据进行训练,以生成各种抽象级别的命令;2) 设计合适的网络结构,使得VLA能够理解和执行这些命令;3) 使用合适的损失函数,以优化VLA的性能。具体的参数设置、网络结构和损失函数等技术细节在论文中进行了详细描述(具体细节未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用可操纵策略的方法在真实世界操作任务中,显著优于现有的具身推理VLA和基于VLM的分层基线。具体而言,该方法在具有挑战性的泛化和长时程任务上表现出更强的性能。论文中提供了具体的性能数据和对比结果(具体数据未知),证明了可操纵策略的有效性。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,例如家庭服务机器人、工业自动化机器人等。通过提高机器人对复杂指令的理解和执行能力,可以实现更智能、更灵活的机器人控制,从而提高生产效率和服务质量。未来,该技术有望应用于更广泛的领域,例如自动驾驶、医疗机器人等。

📄 摘要(原文)

Pretrained vision-language models (VLMs) can make semantic and visual inferences across diverse settings, providing valuable common-sense priors for robotic control. However, effectively grounding this knowledge in robot behaviors remains an open challenge. Prior methods often employ a hierarchical approach where VLMs reason over high-level commands to be executed by separate low-level policies, e.g., vision-language-action models (VLAs). The interface between VLMs and VLAs is usually natural language task instructions, which fundamentally limits how much VLM reasoning can steer low-level behavior. We thus introduce Steerable Policies: VLAs trained on rich synthetic commands at various levels of abstraction, like subtasks, motions, and grounded pixel coordinates. By improving low-level controllability, Steerable Policies can unlock pretrained knowledge in VLMs, enabling improved task generalization. We demonstrate this benefit by controlling our Steerable Policies with both a learned high-level embodied reasoner and an off-the-shelf VLM prompted to reason over command abstractions via in-context learning. Across extensive real-world manipulation experiments, these two novel methods outperform prior embodied reasoning VLAs and VLM-based hierarchical baselines, including on challenging generalization and long-horizon tasks. Website: steerable-policies.github.io