UniManip: General-Purpose Zero-Shot Robotic Manipulation with Agentic Operational Graph

作者: Haichao Liu, Yuanjiang Xue, Yuheng Zhou, Haoyuan Deng, Yinan Liang, Lihua Xie, Ziwei Wang

分类: cs.RO

发布日期: 2026-02-13

备注: 15 pages, 12 figures, 6 tables, project page: https://henryhcliu.github.io/unimanip

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出UniManip以解决通用零-shot机器人操作问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 零-shot学习 机器人操作 语义推理 物理交互 动态规划

📋 核心要点

- 现有方法在零-shot泛化能力上存在不足,无法有效处理长时间任务和开放世界变化。

- 提出的UniManip框架通过双层代理操作图(AOG)将语义推理与物理基础相结合,提升了操作的灵活性与精确性。

- 实验结果显示,UniManip在未见对象和任务上的成功率显著高于现有最先进方法,验证了其有效性。

📝 摘要(中文)

实现通用机器人操作需要机器人在非结构化环境中无缝连接高层语义意图与低层物理交互。然而,现有方法在零-shot泛化方面表现不佳:端到端的视觉-语言-动作(VLA)模型往往缺乏长时间任务所需的精确性,而传统的层次规划在面对开放世界变化时则表现出语义僵化。为此,我们提出了UniManip,一个基于双层代理操作图(AOG)的框架,统一了语义推理与物理基础。通过将高层代理层与低层场景层相结合,系统能够持续对齐抽象规划与几何约束,实现稳健的零-shot执行。实验验证了该系统在未见对象和任务上的强大零-shot能力,成功率比最先进的VLA和层次基线分别提高了22.5%和25.0%。

🔬 方法详解

问题定义:本论文旨在解决通用零-shot机器人操作中的高层语义意图与低层物理交互之间的桥接问题。现有方法在长时间任务的精确性和开放世界变化的适应性上存在明显不足。

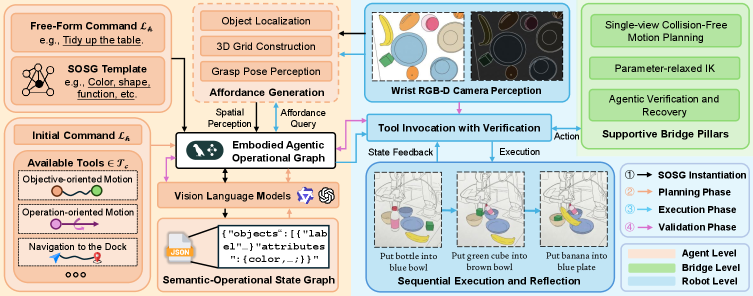

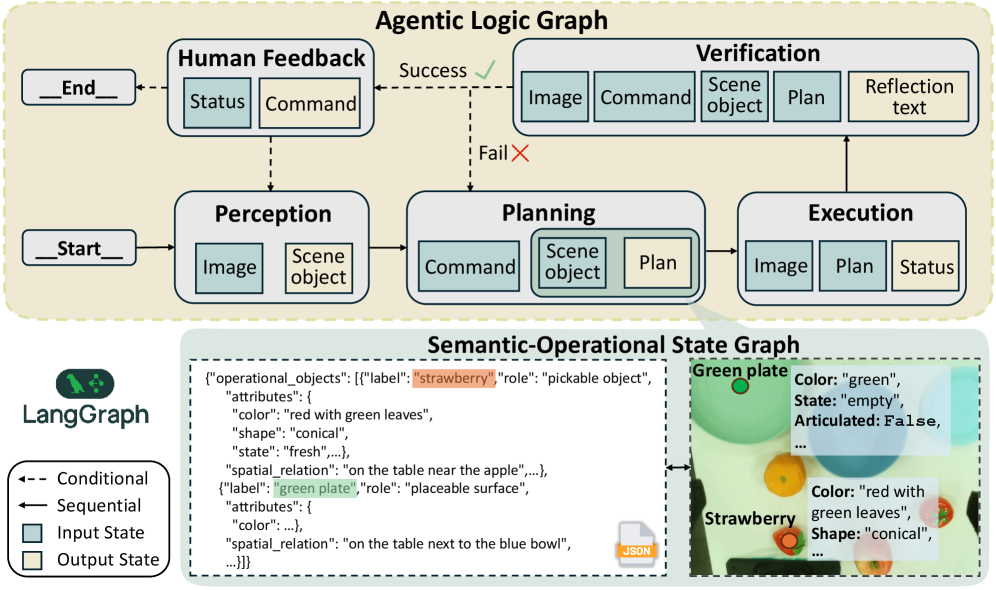

核心思路:UniManip框架的核心思路是通过双层代理操作图(AOG)来统一语义推理与物理基础。高层代理层负责任务的协调,而低层场景层则动态表示状态,从而实现抽象规划与几何约束的持续对齐。

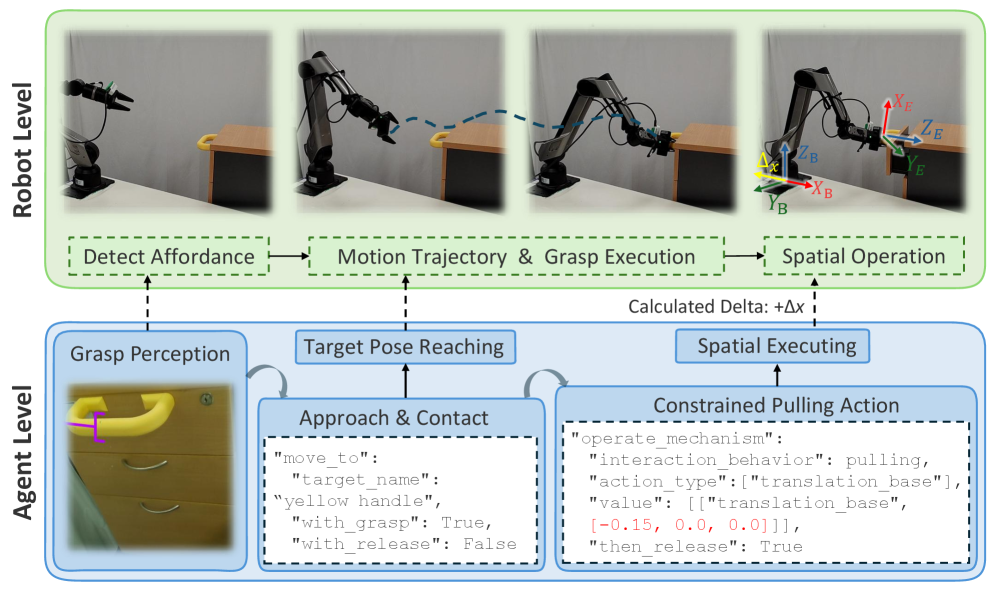

技术框架:UniManip的整体架构包括高层代理层和低层场景层。高层负责任务的抽象规划,低层则通过安全感知的局部规划器生成无碰撞的轨迹。此外,系统利用结构化记忆来自动诊断和恢复执行失败。

关键创新:UniManip的主要创新在于其动态代理循环的设计,能够从非结构化感知中主动实例化对象中心的场景图,并在执行过程中实时调整。这与现有静态管道方法形成了鲜明对比。

关键设计:在技术细节上,UniManip采用了安全感知的局部规划器来生成轨迹,并通过结构化记忆机制来处理执行中的失败情况。具体的参数设置和损失函数设计尚未详细披露,属于未知范围。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UniManip在未见对象和任务上的成功率比最先进的VLA和层次基线分别提高了22.5%和25.0%。该系统能够实现从固定基座到移动操作的直接零-shot转移,无需微调或重新配置,显示出其强大的适应性。

🎯 应用场景

该研究的潜在应用领域包括智能家居、工业自动化和服务机器人等。通过实现更灵活和高效的机器人操作,UniManip能够在复杂和动态的环境中执行多样化任务,具有重要的实际价值和未来影响。

📄 摘要(原文)

Achieving general-purpose robotic manipulation requires robots to seamlessly bridge high-level semantic intent with low-level physical interaction in unstructured environments. However, existing approaches falter in zero-shot generalization: end-to-end Vision-Language-Action (VLA) models often lack the precision required for long-horizon tasks, while traditional hierarchical planners suffer from semantic rigidity when facing open-world variations. To address this, we present UniManip, a framework grounded in a Bi-level Agentic Operational Graph (AOG) that unifies semantic reasoning and physical grounding. By coupling a high-level Agentic Layer for task orchestration with a low-level Scene Layer for dynamic state representation, the system continuously aligns abstract planning with geometric constraints, enabling robust zero-shot execution. Unlike static pipelines, UniManip operates as a dynamic agentic loop: it actively instantiates object-centric scene graphs from unstructured perception, parameterizes these representations into collision-free trajectories via a safety-aware local planner, and exploits structured memory to autonomously diagnose and recover from execution failures. Extensive experiments validate the system's robust zero-shot capability on unseen objects and tasks, demonstrating a 22.5% and 25.0% higher success rate compared to state-of-the-art VLA and hierarchical baselines, respectively. Notably, the system enables direct zero-shot transfer from fixed-base setups to mobile manipulation without fine-tuning or reconfiguration. Our open-source project page can be found at https://henryhcliu.github.io/unimanip.