Scaling Single Human Demonstrations for Imitation Learning using Generative Foundational Models

作者: Nick Heppert, Minh Quang Nguyen, Abhinav Valada

分类: cs.RO

发布日期: 2026-02-13

备注: ICRA 2026, 8 pages, 6 figures, 4 tables

💡 一句话要点

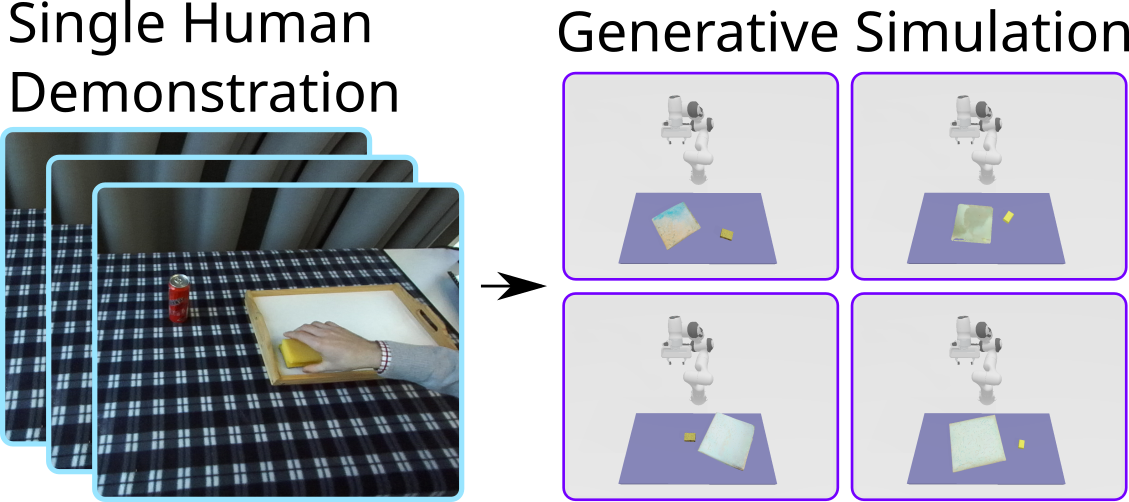

Real2Gen:利用生成式模型,从单个人类演示中学习机器人操作策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 机器人学习 单样本学习 生成式模型 流匹配 域自适应 人机协作

📋 核心要点

- 现有模仿学习方法依赖大量机器人演示数据,而机器人数据采集成本高昂,人类演示数据丰富但难以直接迁移。

- Real2Gen从单个人类演示中提取信息,迁移到仿真环境,利用可编程专家生成无限数据,训练流匹配策略。

- 实验表明,Real2Gen在三个真实任务中成功率平均提升26.6%,并具备更好的泛化能力,可零样本迁移到真实世界。

📝 摘要(中文)

模仿学习是训练机器人执行新任务的常用方法,但通过遥操作或动觉示教收集机器人演示数据既繁琐又耗时。相比之下,直接使用人类身体进行任务演示更容易,且数据丰富,但迁移到机器人上并非易事。本文提出了Real2Gen,一种从单个人类演示中训练操作策略的方法。Real2Gen从演示中提取所需信息,并将其转移到仿真环境中,在该环境中,可编程的专家代理可以任意多次地演示该任务,从而生成无限量的数据来训练流匹配策略。我们在三个不同的真实世界任务的人类演示上评估了Real2Gen,并将其与最近的基线进行了比较。Real2Gen的成功率平均提高了26.6%,并且由于训练数据的丰富性和多样性,训练策略的泛化能力更好。我们进一步将纯粹在仿真环境中训练的策略零样本部署到现实世界中。数据、代码和训练模型已公开。

🔬 方法详解

问题定义:现有模仿学习方法需要大量的机器人演示数据,而获取这些数据通常需要耗时且昂贵的遥操作或动觉示教。虽然人类演示数据更容易获取,但由于人类和机器人之间的差异(例如,运动学、动力学和视角),直接将人类演示迁移到机器人上是具有挑战性的。因此,如何利用有限的人类演示数据来训练有效的机器人策略是一个关键问题。

核心思路:Real2Gen的核心思路是利用单个人类演示来引导仿真环境中的专家代理,从而生成大量的合成数据。通过将人类演示中的关键信息(例如,目标状态、关键路径点)提取出来,并将其转化为仿真环境中的约束或奖励信号,专家代理可以在仿真环境中重复执行任务,并生成多样化的训练数据。这种方法可以有效地克服人类和机器人之间的差异,并利用仿真环境的优势来生成无限量的训练数据。

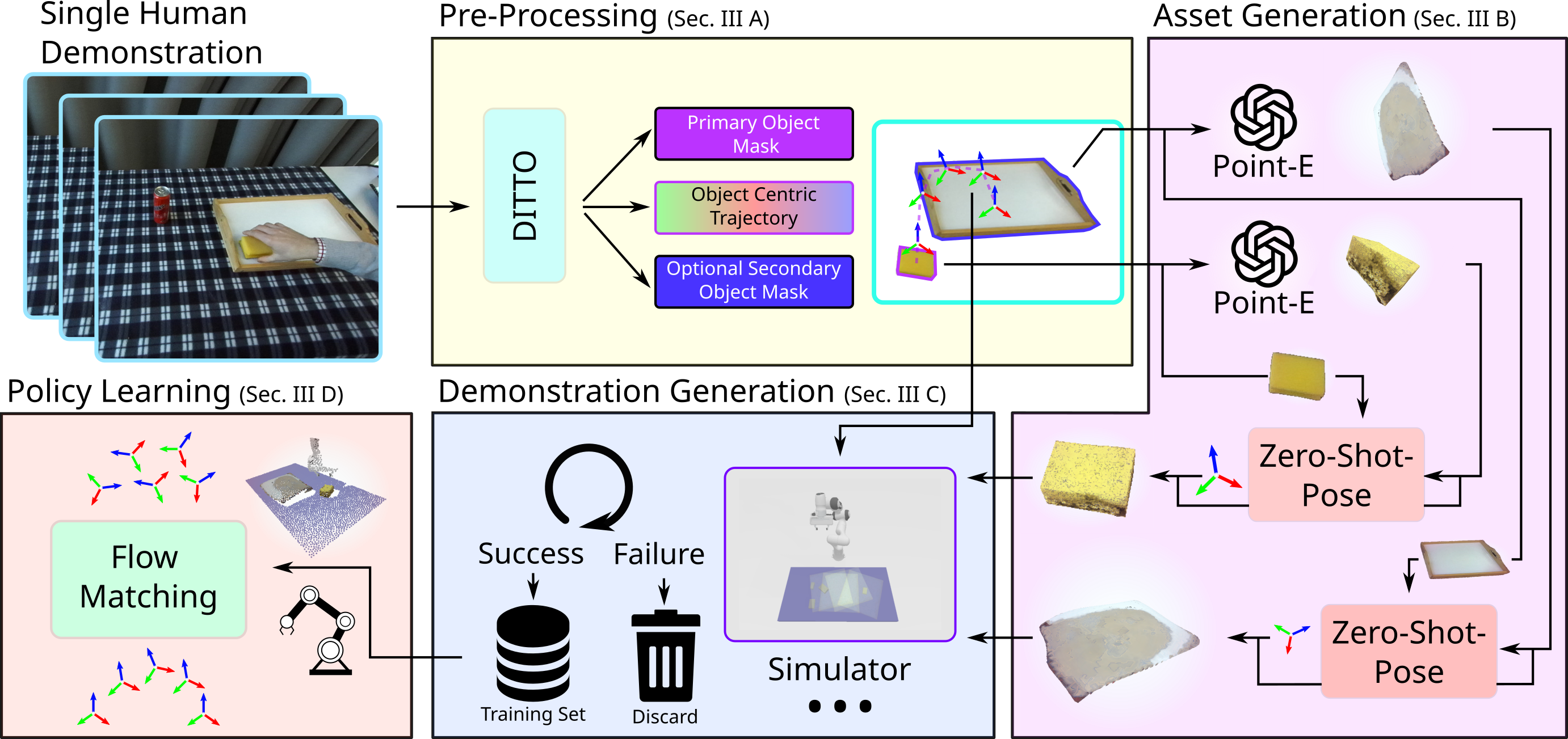

技术框架:Real2Gen的整体框架包括以下几个主要阶段:1) 人类演示数据采集:收集单个人类执行任务的演示数据,包括RGB图像、深度图像和姿态信息。2) 信息提取与迁移:从人类演示数据中提取关键信息,例如目标状态和关键路径点,并将这些信息迁移到仿真环境中。3) 专家代理训练:在仿真环境中训练一个专家代理,该代理能够根据提取的信息重复执行任务,并生成大量的合成数据。4) 策略学习:使用生成的合成数据训练一个流匹配策略,该策略能够将机器人的状态映射到动作空间。

关键创新:Real2Gen的关键创新在于它能够从单个人类演示中学习,并利用生成式模型在仿真环境中生成无限量的训练数据。这使得该方法能够克服数据稀缺的问题,并有效地利用人类的先验知识。此外,Real2Gen还能够将人类演示中的关键信息迁移到仿真环境中,从而引导专家代理生成高质量的训练数据。

关键设计:Real2Gen的关键设计包括:1) 使用深度学习模型从人类演示数据中提取关键信息。2) 设计合适的奖励函数或约束条件,以引导专家代理在仿真环境中生成多样化的训练数据。3) 使用流匹配模型来学习机器人的策略,该模型能够有效地处理高维状态空间和动作空间。4) 使用域随机化技术来提高策略的泛化能力,使其能够适应真实世界的环境。

🖼️ 关键图片

📊 实验亮点

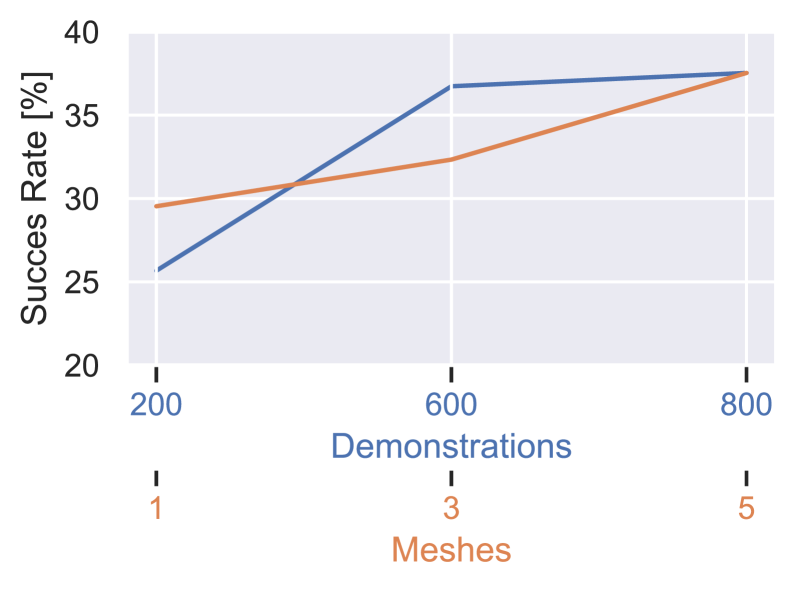

Real2Gen在三个不同的真实世界任务上进行了评估,并与最近的基线进行了比较。实验结果表明,Real2Gen的成功率平均提高了26.6%,并且由于训练数据的丰富性和多样性,训练策略的泛化能力更好。此外,该方法还能够将纯粹在仿真环境中训练的策略零样本部署到真实世界中,这进一步证明了该方法的有效性和实用性。

🎯 应用场景

Real2Gen具有广泛的应用前景,例如,它可以用于训练机器人执行各种操作任务,如装配、抓取和放置等。此外,该方法还可以应用于人机协作领域,例如,机器人可以根据人类的演示学习如何与人类进行协作。该研究的潜在价值在于降低了机器人学习的成本,并提高了机器人学习的效率,从而加速了机器人在各个领域的应用。

📄 摘要(原文)

Imitation learning is a popular paradigm to teach robots new tasks, but collecting robot demonstrations through teleoperation or kinesthetic teaching is tedious and time-consuming. In contrast, directly demonstrating a task using our human embodiment is much easier and data is available in abundance, yet transfer to the robot can be non-trivial. In this work, we propose Real2Gen to train a manipulation policy from a single human demonstration. Real2Gen extracts required information from the demonstration and transfers it to a simulation environment, where a programmable expert agent can demonstrate the task arbitrarily many times, generating an unlimited amount of data to train a flow matching policy. We evaluate Real2Gen on human demonstrations from three different real-world tasks and compare it to a recent baseline. Real2Gen shows an average increase in the success rate of 26.6% and better generalization of the trained policy due to the abundance and diversity of training data. We further deploy our purely simulation-trained policy zero-shot in the real world. We make the data, code, and trained models publicly available at real2gen.cs.uni-freiburg.de.