Xiaomi-Robotics-0: An Open-Sourced Vision-Language-Action Model with Real-Time Execution

作者: Rui Cai, Jun Guo, Xinze He, Piaopiao Jin, Jie Li, Bingxuan Lin, Futeng Liu, Wei Liu, Fei Ma, Kun Ma, Feng Qiu, Heng Qu, Yifei Su, Qiao Sun, Dong Wang, Donghao Wang, Yunhong Wang, Rujie Wu, Diyun Xiang, Yu Yang, Hangjun Ye, Yuan Zhang, Quanyun Zhou

分类: cs.RO, cs.LG

发布日期: 2026-02-13

备注: Project page: https://xiaomi-robotics-0.github.io

💡 一句话要点

小米提出Xiaomi-Robotics-0,一种用于实时执行的开源视觉-语言-动作模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人控制 实时执行 具身智能 深度学习

📋 核心要点

- 现有VLA模型在真实机器人上的实时部署面临推理延迟问题,影响动作的流畅性和实时性。

- Xiaomi-Robotics-0通过预训练、后训练和部署策略的优化,实现了高性能和流畅的实时执行。

- 该模型在模拟和真实机器人任务中均表现出色,并在需要灵巧操作的任务中取得了高成功率和吞吐量。

📝 摘要(中文)

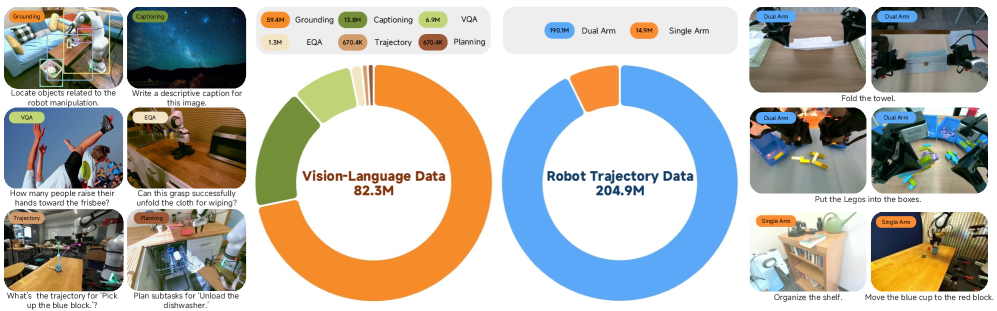

本报告介绍Xiaomi-Robotics-0,一种先进的视觉-语言-动作(VLA)模型,针对高性能和快速流畅的实时执行进行了优化。该方法的核心在于精心设计的训练方案和部署策略。Xiaomi-Robotics-0首先在大型跨具身机器人轨迹和视觉-语言数据上进行预训练,使其具有广泛且可泛化的动作生成能力,同时避免底层预训练VLM的视觉语义知识的灾难性遗忘。在后训练期间,我们提出了几种用于训练VLA模型以进行异步执行的技术,以解决真实机器人部署期间的推理延迟。在部署期间,我们仔细对齐连续预测动作块的时间步长,以确保连续无缝的实时部署。我们在模拟基准测试和两个需要精确和灵巧的双手操作的具有挑战性的真实机器人任务中对Xiaomi-Robotics-0进行了广泛的评估。结果表明,我们的方法在所有模拟基准测试中都达到了最先进的性能。此外,Xiaomi-Robotics-0可以使用消费级GPU在真实机器人上快速流畅地部署,在两个真实机器人任务上都实现了高成功率和吞吐量。为了促进未来的研究,代码和模型检查点已在https://xiaomi-robotics-0.github.io上开源。

🔬 方法详解

问题定义:现有视觉-语言-动作模型(VLA)在真实机器人上的部署面临推理延迟的挑战,导致动作执行不流畅,难以满足实时性要求。尤其是在需要精细操作的任务中,延迟会显著降低任务成功率。

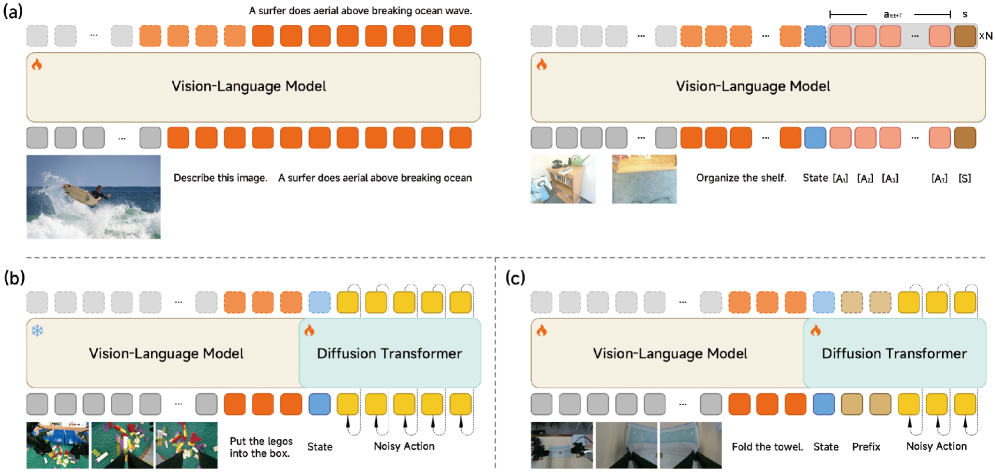

核心思路:Xiaomi-Robotics-0的核心思路是通过精心设计的训练方案和部署策略,优化模型的动作生成能力和实时执行效率。具体来说,通过大规模预训练赋予模型广泛的动作生成能力,并通过后训练解决异步执行中的推理延迟问题,最终通过时间步长对齐保证实时部署的流畅性。

技术框架:Xiaomi-Robotics-0的整体框架包含预训练、后训练和部署三个主要阶段。预训练阶段利用大规模跨具身机器人轨迹和视觉-语言数据,提升模型的通用动作生成能力。后训练阶段采用异步执行训练技术,降低推理延迟。部署阶段则通过时间步长对齐,保证连续动作的流畅执行。

关键创新:该论文的关键创新在于针对VLA模型在真实机器人上的实时部署问题,提出了一套完整的解决方案,包括预训练、后训练和部署策略的优化。特别是在后训练阶段,针对异步执行的训练方法有效降低了推理延迟,是实现实时控制的关键。

关键设计:论文中关于异步执行的训练方法是关键设计之一,具体细节未知。此外,时间步长对齐策略在部署阶段也至关重要,保证了连续动作的平滑过渡。预训练数据集的选择和规模,以及损失函数的设计等细节对模型性能也有重要影响,但具体细节未知。

🖼️ 关键图片

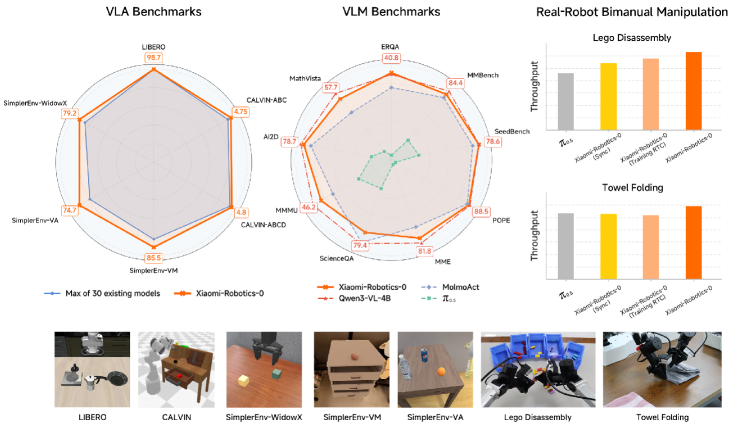

📊 实验亮点

Xiaomi-Robotics-0在模拟基准测试中取得了state-of-the-art的性能。在真实机器人任务中,该模型使用消费级GPU实现了快速流畅的部署,并在需要精确和灵巧的双手操作任务中取得了高成功率和吞吐量。具体性能数据未知,但结果表明该模型在实时性和准确性方面均有显著提升。

🎯 应用场景

Xiaomi-Robotics-0具有广泛的应用前景,可应用于工业自动化、家庭服务机器人、医疗机器人等领域。该模型能够理解人类指令,并控制机器人执行复杂的任务,例如物体抓取、装配、清洁等。其开源特性将促进机器人技术的进一步发展,加速机器人在各行各业的普及。

📄 摘要(原文)

In this report, we introduce Xiaomi-Robotics-0, an advanced vision-language-action (VLA) model optimized for high performance and fast and smooth real-time execution. The key to our method lies in a carefully designed training recipe and deployment strategy. Xiaomi-Robotics-0 is first pre-trained on large-scale cross-embodiment robot trajectories and vision-language data, endowing it with broad and generalizable action-generation capabilities while avoiding catastrophic forgetting of the visual-semantic knowledge of the underlying pre-trained VLM. During post-training, we propose several techniques for training the VLA model for asynchronous execution to address the inference latency during real-robot rollouts. During deployment, we carefully align the timesteps of consecutive predicted action chunks to ensure continuous and seamless real-time rollouts. We evaluate Xiaomi-Robotics-0 extensively in simulation benchmarks and on two challenging real-robot tasks that require precise and dexterous bimanual manipulation. Results show that our method achieves state-of-the-art performance across all simulation benchmarks. Moreover, Xiaomi-Robotics-0 can roll out fast and smoothly on real robots using a consumer-grade GPU, achieving high success rates and throughput on both real-robot tasks. To facilitate future research, code and model checkpoints are open-sourced at https://xiaomi-robotics-0.github.io