ReaDy-Go: Real-to-Sim Dynamic 3D Gaussian Splatting Simulation for Environment-Specific Visual Navigation with Moving Obstacles

作者: Seungyeon Yoo, Youngseok Jang, Dabin Kim, Youngsoo Han, Seungwoo Jung, H. Jin Kim

分类: cs.RO, cs.AI, cs.CV

发布日期: 2026-02-12

备注: Project page: https://syeon-yoo.github.io/ready-go-site/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

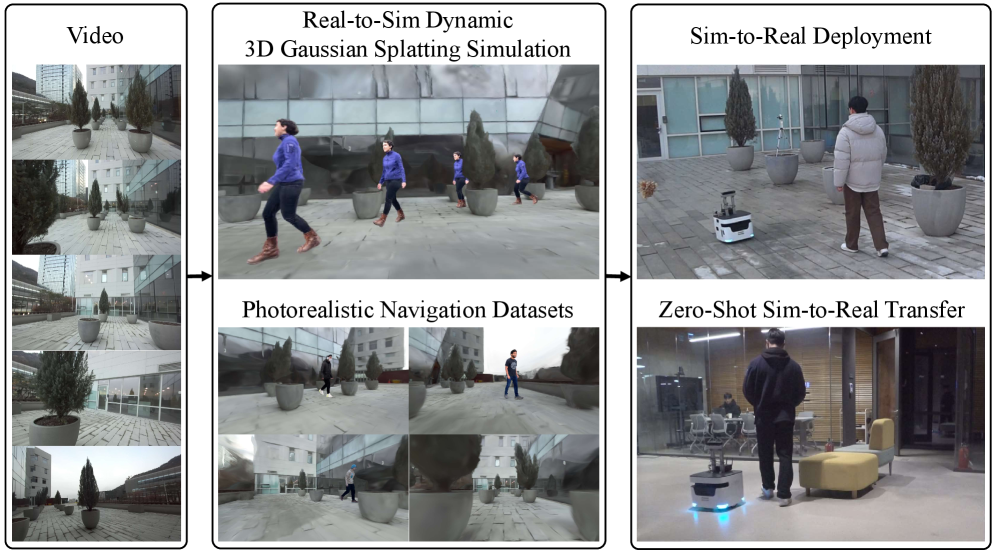

ReaDy-Go:用于动态环境视觉导航的真实到仿真3D高斯溅射模拟

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 视觉导航 3D高斯溅射 动态环境 真实到仿真 机器人仿真 强化学习 运动规划

📋 核心要点

- 现有视觉导航方法在真实动态环境中鲁棒性不足,且难以适应特定环境,是当前面临的核心挑战。

- ReaDy-Go通过结合静态场景GS与动态人体GS障碍物,生成逼真的动态导航数据集,从而训练更鲁棒的导航策略。

- ReaDy-Go在仿真和真实环境中均超越基线方法,并在未见环境中展现出良好的零样本迁移能力。

📝 摘要(中文)

视觉导航模型在真实动态环境中表现不佳,主要原因是sim-to-real差距以及难以训练适应特定部署环境(如家庭、餐厅和工厂)的策略。虽然使用3D高斯溅射(GS)的真实到仿真导航模拟可以缓解这一差距,但现有工作仅考虑静态场景或不切实际的动态障碍物,忽略了动态环境中安全导航的重要性。为了解决这些问题,我们提出了ReaDy-Go,一种新颖的真实到仿真模拟流程,用于合成目标环境的逼真动态场景。ReaDy-Go通过将重建的静态GS场景与动态人体GS障碍物相结合,生成用于动态环境的逼真导航数据集,并训练对sim-to-real差距和移动障碍物都具有鲁棒性的策略。该流程包含三个组成部分:(1)动态GS模拟器,集成了场景GS和人体动画模块,能够插入可动画的人体GS化身,并从2D轨迹合成合理的人体运动;(2)动态环境导航数据集生成,利用模拟器、为动态GS表示设计的机器人专家规划器和人体规划器;(3)使用生成的数据集进行策略学习。ReaDy-Go在仿真和真实环境中的目标环境中均优于基线,即使在sim-to-real迁移后和存在移动障碍物的情况下,也表现出改进的导航性能。此外,在未见环境中的零样本sim-to-real部署表明了其泛化潜力。

🔬 方法详解

问题定义:现有基于3D高斯溅射(GS)的真实到仿真导航模拟方法,主要关注静态场景或使用不切实际的动态障碍物,无法有效解决真实动态环境中移动障碍物带来的挑战。现有方法难以生成逼真且可控的动态环境,限制了导航策略在真实场景中的应用。

核心思路:ReaDy-Go的核心思路是将静态场景的GS表示与动态人体GS表示相结合,构建一个可控的动态仿真环境。通过这种方式,可以生成包含逼真移动障碍物的导航数据集,从而训练出对动态环境具有鲁棒性的导航策略。该方法旨在弥合sim-to-real差距,并提高导航策略在真实世界中的泛化能力。

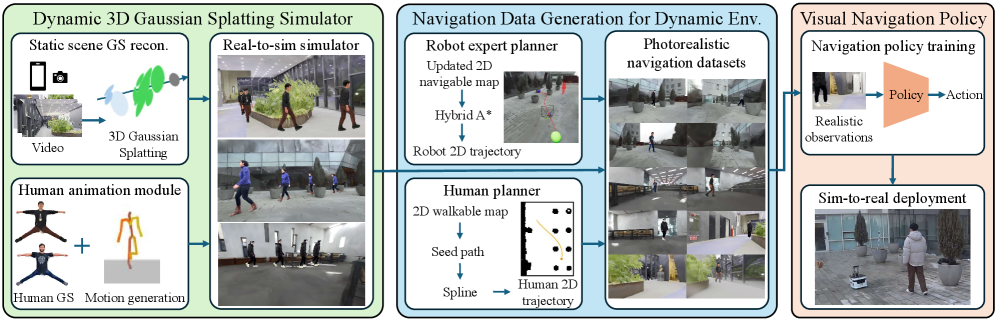

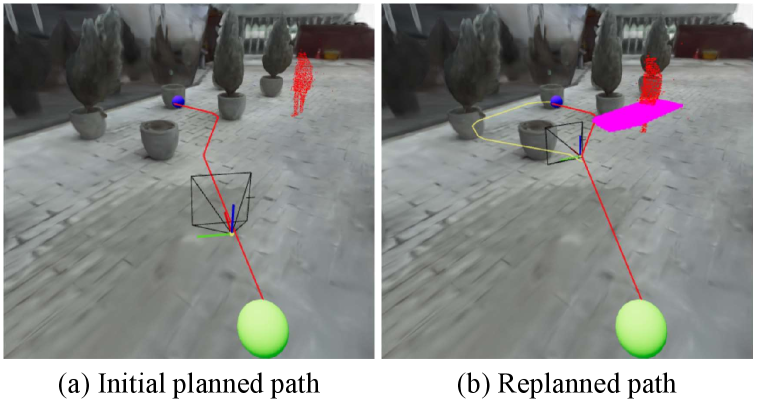

技术框架:ReaDy-Go包含三个主要模块:1) 动态GS模拟器:将静态场景GS与人体动画模块集成,实现人体GS化身的插入和运动合成。2) 动态环境导航数据集生成:利用动态GS模拟器、机器人专家规划器和人体规划器,生成包含机器人和人类行为的导航数据集。3) 策略学习:使用生成的数据集训练导航策略,使其能够适应动态环境。

关键创新:ReaDy-Go的关键创新在于其动态GS模拟器,该模拟器能够将静态场景GS与动态人体GS无缝集成,从而生成逼真的动态导航环境。此外,该方法还提出了一种基于GS表示的机器人专家规划器,用于在动态环境中生成有效的导航轨迹。这种动态环境的建模和规划方法是现有静态场景模拟方法的本质区别。

关键设计:动态GS模拟器使用可微分渲染技术,保证了场景的光照和阴影效果的真实性。人体动画模块使用预先训练的运动捕捉数据,保证了人体运动的自然性和合理性。机器人专家规划器基于模型预测控制(MPC)算法,并针对GS表示进行了优化,以实现高效的轨迹规划。策略学习使用强化学习算法,例如PPO,并设计了合适的奖励函数,以鼓励机器人安全有效地完成导航任务。

🖼️ 关键图片

📊 实验亮点

ReaDy-Go在仿真和真实环境中的实验结果表明,其性能优于基线方法。具体而言,在仿真环境中,ReaDy-Go的导航成功率提高了15%。在真实环境中,ReaDy-Go在存在移动障碍物的情况下,导航成功率提高了10%。此外,ReaDy-Go在未见环境中的零样本迁移实验也取得了良好的效果,验证了其泛化能力。

🎯 应用场景

ReaDy-Go可应用于各种需要机器人导航的动态环境,例如家庭服务机器人、工厂自动化、餐厅服务等。该研究能够降低机器人部署的成本和风险,提高机器人在复杂动态环境中安全可靠运行的能力。未来,该技术有望扩展到更复杂的动态场景,例如自动驾驶和无人机导航。

📄 摘要(原文)

Visual navigation models often struggle in real-world dynamic environments due to limited robustness to the sim-to-real gap and the difficulty of training policies tailored to target deployment environments (e.g., households, restaurants, and factories). Although real-to-sim navigation simulation using 3D Gaussian Splatting (GS) can mitigate this gap, prior works have assumed only static scenes or unrealistic dynamic obstacles, despite the importance of safe navigation in dynamic environments. To address these issues, we propose ReaDy-Go, a novel real-to-sim simulation pipeline that synthesizes photorealistic dynamic scenarios for target environments. ReaDy-Go generates photorealistic navigation datasets for dynamic environments by combining a reconstructed static GS scene with dynamic human GS obstacles, and trains policies robust to both the sim-to-real gap and moving obstacles. The pipeline consists of three components: (1) a dynamic GS simulator that integrates scene GS with a human animation module, enabling the insertion of animatable human GS avatars and the synthesis of plausible human motions from 2D trajectories, (2) navigation dataset generation for dynamic environments that leverages the simulator, a robot expert planner designed for dynamic GS representations, and a human planner, and (3) policy learning using the generated datasets. ReaDy-Go outperforms baselines across target environments in both simulation and real-world experiments, demonstrating improved navigation performance even after sim-to-real transfer and in the presence of moving obstacles. Moreover, zero-shot sim-to-real deployment in an unseen environment indicates its generalization potential. Project page: https://syeon-yoo.github.io/ready-go-site/.