Towards Long-Lived Robots: Continual Learning VLA Models via Reinforcement Fine-Tuning

作者: Yuan Liu, Haoran Li, Shuai Tian, Yuxing Qin, Yuhui Chen, Yupeng Zheng, Yongzhen Huang, Dongbin Zhao

分类: cs.RO

发布日期: 2026-02-11

💡 一句话要点

提出LifeLong-RFT,通过强化微调VLA模型实现机器人终身学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人学习 终身学习 强化学习 视觉语言动作模型 持续学习 多任务学习 强化微调

📋 核心要点

- 现有VLA模型依赖监督微调,面临数据需求高和灾难性遗忘的挑战,限制了其在机器人终身学习中的应用。

- LifeLong-RFT通过强化微调VLA模型,利用多维过程奖励机制,在离散动作、连续轨迹和输出格式三个维度优化策略。

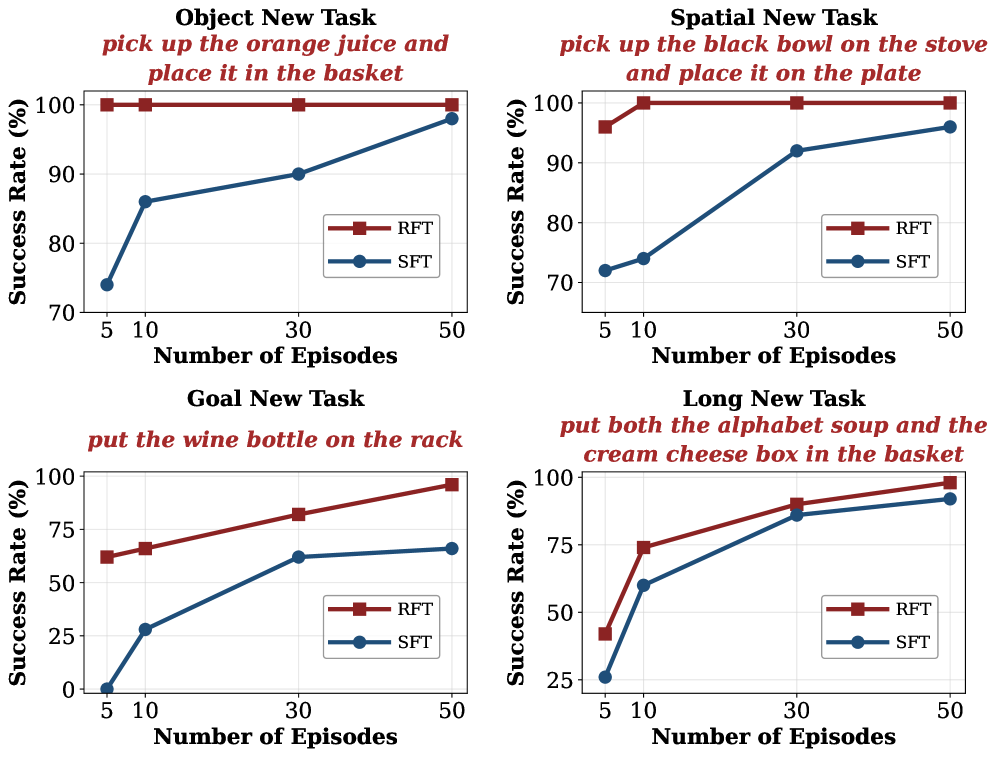

- 实验表明,LifeLong-RFT在多任务和持续学习中表现出色,相比监督微调,成功率提升显著,且数据需求更低。

📝 摘要(中文)

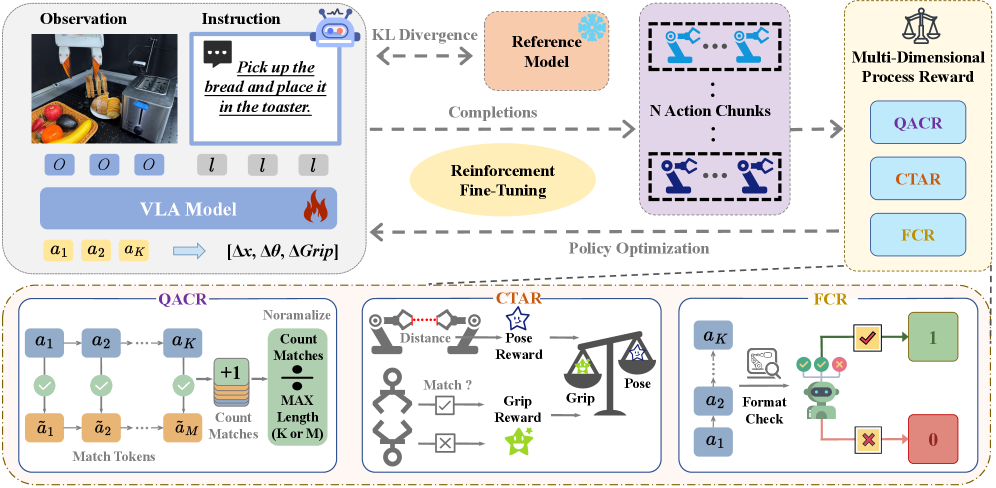

视觉语言动作(VLA)模型在大型多样数据集上预训练后,展现出强大的泛化和适应能力,可作为通用机器人策略。然而,监督微调(SFT)作为VLA适应下游领域的主要机制,需要大量的特定任务数据,并且容易发生灾难性遗忘。为了解决这些限制,我们提出LifeLong-RFT,一种简单而有效的VLA模型强化微调(RFT)策略,它独立于在线环境反馈和预训练的奖励模型。通过将块级别的在线强化学习与提出的多维过程奖励(MDPR)机制相结合,LifeLong-RFT量化了中间动作块在三个维度上的异构贡献,以促进策略优化。具体来说,(1)量化动作一致性奖励(QACR)确保离散动作空间内的准确动作预测;(2)连续轨迹对齐奖励(CTAR)将解码的连续动作块与参考轨迹对齐,以确保精确控制;(3)格式合规性奖励(FCR)保证输出的结构有效性。在SimplerEnv、LIBERO和真实世界任务上的综合实验表明,LifeLong-RFT在多任务学习中表现出强大的性能。此外,在LIBERO基准上的持续学习中,我们的方法比SFT的平均成功率提高了22%,同时仅使用20%的训练数据即可有效地适应新任务。总的来说,我们的方法为VLA提供了一种有前景的后训练范式。

🔬 方法详解

问题定义:现有视觉语言动作(VLA)模型主要依赖于监督微调(SFT)来适应新的任务和环境。然而,SFT存在两个主要问题:一是需要大量的特定任务数据,收集成本高昂;二是容易发生灾难性遗忘,即在学习新任务时忘记之前学习的任务。这限制了VLA模型在机器人终身学习场景中的应用,因为机器人需要不断学习新的技能,同时保持已有的能力。

核心思路:LifeLong-RFT的核心思路是利用强化学习(RL)来微调VLA模型,从而避免对大量特定任务数据的依赖,并缓解灾难性遗忘问题。该方法不依赖于在线环境反馈和预训练的奖励模型,而是通过设计一种多维过程奖励(MDPR)机制,从多个维度对VLA模型的输出进行评估和优化。这种方法允许模型在没有显式奖励信号的情况下,学习如何生成符合任务要求的动作序列。

技术框架:LifeLong-RFT的技术框架主要包括以下几个部分:1) VLA模型:作为策略网络,接收视觉和语言输入,输出动作序列。2) 块级别在线强化学习:将动作序列分解为多个块,并对每个块进行在线强化学习,以提高学习效率。3) 多维过程奖励(MDPR):包括量化动作一致性奖励(QACR)、连续轨迹对齐奖励(CTAR)和格式合规性奖励(FCR),分别从离散动作、连续轨迹和输出格式三个维度对VLA模型的输出进行评估。4) 策略优化:利用强化学习算法(如PPO)更新VLA模型的参数,使其能够生成更符合任务要求的动作序列。

关键创新:LifeLong-RFT的关键创新在于提出了多维过程奖励(MDPR)机制。与传统的强化学习方法不同,MDPR不需要显式的奖励信号,而是通过量化动作一致性、轨迹对齐和格式合规性来评估VLA模型的输出。这种方法能够更有效地指导VLA模型的学习,并缓解灾难性遗忘问题。此外,将动作序列分解为多个块,并对每个块进行在线强化学习,也提高了学习效率。

关键设计:MDPR机制是LifeLong-RFT的关键设计。具体来说,QACR用于确保VLA模型在离散动作空间内的准确动作预测,通过比较预测的动作与参考动作的一致性来计算奖励。CTAR用于将解码的连续动作块与参考轨迹对齐,通过计算预测轨迹与参考轨迹之间的距离来计算奖励。FCR用于保证输出的结构有效性,通过检查输出是否符合预定义的格式规范来计算奖励。这些奖励被组合起来,用于指导VLA模型的策略优化。

🖼️ 关键图片

📊 实验亮点

LifeLong-RFT在LIBERO基准上的持续学习中,相比监督微调(SFT),平均成功率提高了22%,并且仅使用20%的训练数据即可有效地适应新任务。这表明LifeLong-RFT在持续学习方面具有显著的优势,能够有效地缓解灾难性遗忘问题,并提高学习效率。此外,该方法在SimplerEnv和真实世界任务上也表现出强大的性能。

🎯 应用场景

LifeLong-RFT具有广泛的应用前景,可用于各种机器人任务,如家庭服务机器人、工业机器人和自动驾驶汽车。该方法能够使机器人不断学习新的技能,适应新的环境,并保持已有的能力,从而实现真正的终身学习。此外,该方法还可以用于训练更通用的机器人策略,使其能够处理各种不同的任务。

📄 摘要(原文)

Pretrained on large-scale and diverse datasets, VLA models demonstrate strong generalization and adaptability as general-purpose robotic policies. However, Supervised Fine-Tuning (SFT), which serves as the primary mechanism for adapting VLAs to downstream domains, requires substantial amounts of task-specific data and is prone to catastrophic forgetting. To address these limitations, we propose LifeLong-RFT, a simple yet effective Reinforcement Fine-Tuning (RFT) strategy for VLA models independent of online environmental feedback and pre-trained reward models. By integrating chunking-level on-policy reinforcement learning with the proposed Multi-Dimensional Process Reward (MDPR) mechanism, LifeLong-RFT quantifies the heterogeneous contributions of intermediate action chunks across three dimensions to facilitate policy optimization. Specifically, (1) the Quantized Action Consistency Reward (QACR) ensures accurate action prediction within the discrete action space; (2) the Continuous Trajectory Alignment Reward (CTAR) aligns decoded continuous action chunks with reference trajectories to ensure precise control; (3) the Format Compliance Reward (FCR) guarantees the structural validity of outputs. Comprehensive experiments across SimplerEnv, LIBERO, and real-world tasks demonstrate that LifeLong-RFT exhibits strong performance in multi-task learning. Furthermore, for continual learning on the LIBERO benchmark, our method achieves a 22% gain in average success rate over SFT, while effectively adapting to new tasks using only 20% of the training data. Overall, our method provides a promising post-training paradigm for VLAs.