TriPilot-FF: Coordinated Whole-Body Teleoperation with Force Feedback

作者: Zihao Li, Yanan Zhou, Ranpeng Qiu, Hangyu Wu, Guoqiang Ren, Weiming Zhi

分类: cs.RO

发布日期: 2026-02-10

💡 一句话要点

TriPilot-FF:力反馈协同双臂移动机器人全身遥操作系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion)

关键词: 移动机器人 全身遥操作 力反馈 脚踏板控制 激光雷达 人机协作 双臂协调

📋 核心要点

- 移动机器人全身遥操作面临挑战,现有手部控制为主的界面难以有效协调底座和双臂。

- TriPilot-FF提出一种基于脚踏板和力反馈的遥操作方案,利用激光雷达感知环境,提供触觉反馈引导避障。

- 实验表明,TriPilot-FF能有效提升操作员在复杂任务中的表现,并可将反馈信号融入强化学习策略。

📝 摘要(中文)

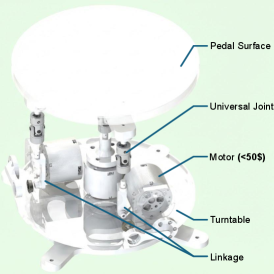

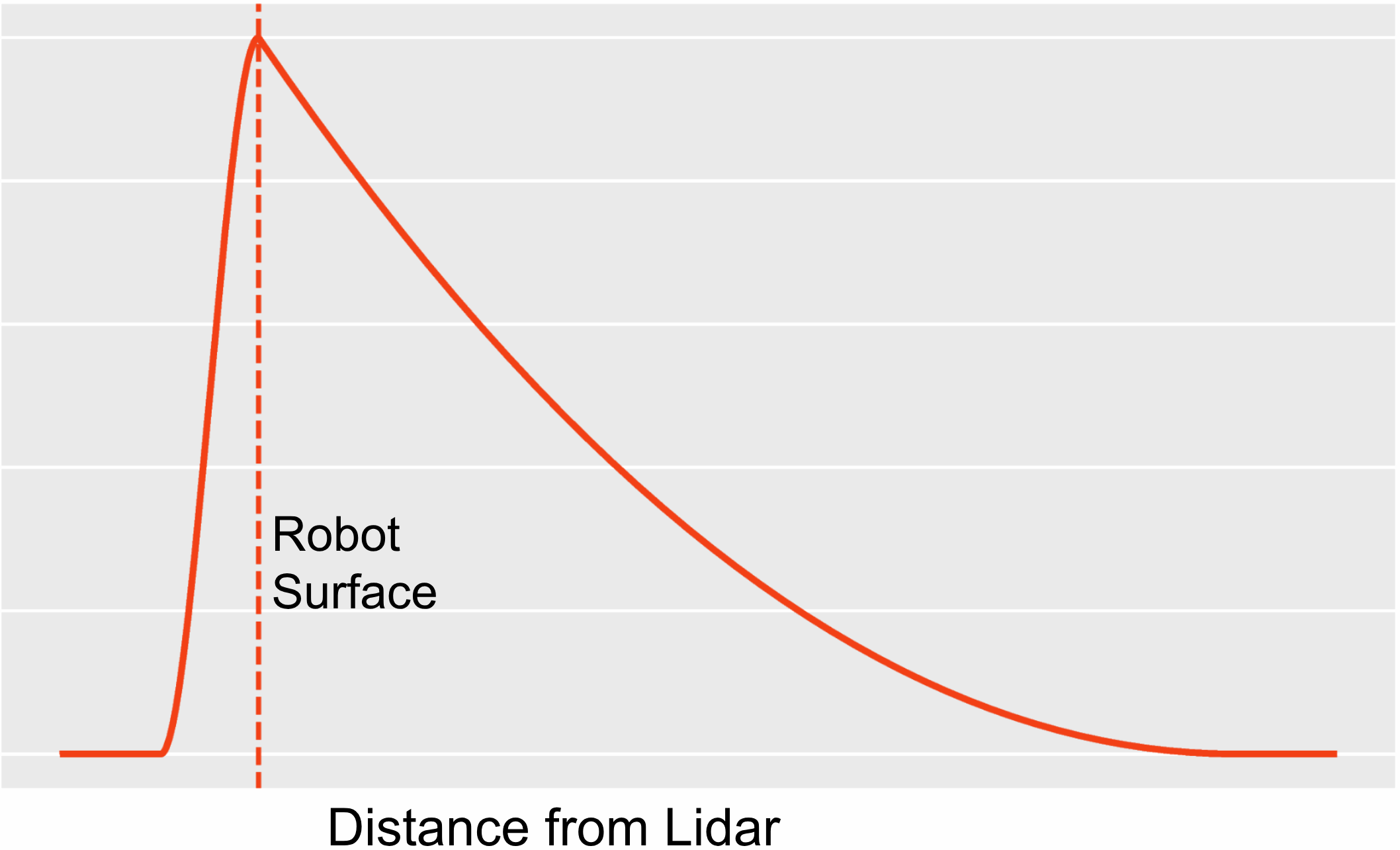

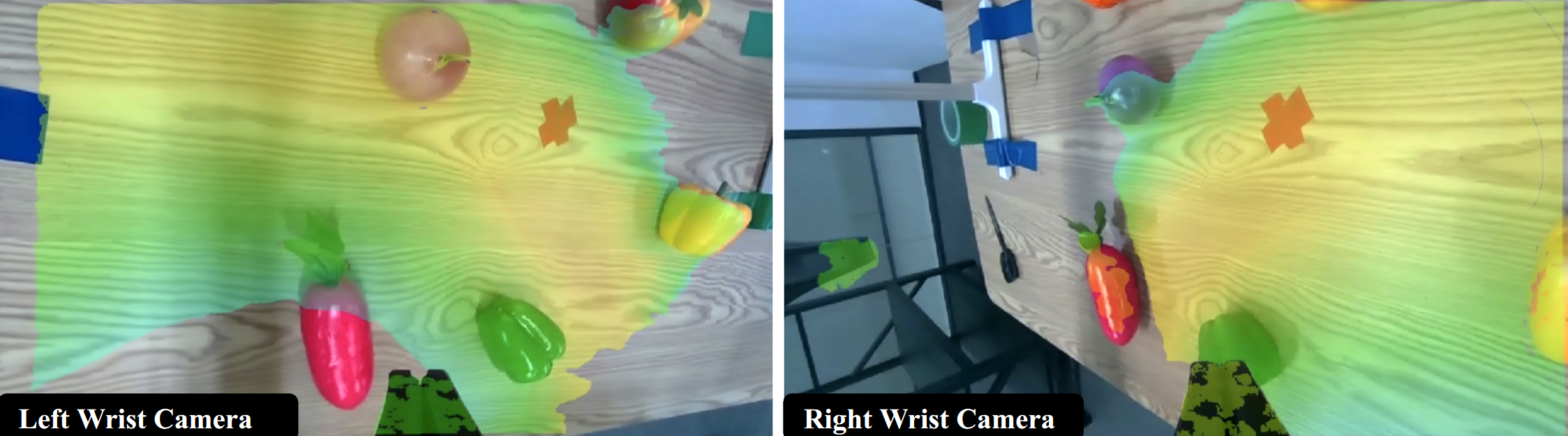

移动机械臂扩展了机器人操作的范围。然而,此类机器人的全身遥操作仍然是一个难题:操作员必须协调轮式底座和两个手臂,同时考虑障碍物和接触。现有的界面主要以手为中心(例如,VR控制器和操纵杆),而脚部操作通道在连续底座控制方面尚未得到充分探索。我们提出了TriPilot-FF,这是一个开源的全身遥操作系统,用于定制的双臂移动机械臂,该系统引入了一个脚踏板,具有激光雷达驱动的踏板触觉,并结合了上半身双臂领导者-跟随者遥操作。TriPilot-FF仅使用一个低成本的底座安装激光雷达,从指令方向上的接近障碍物信号渲染一个电阻踏板提示,从而在没有显式避碰控制器的情况下,将操作员的指令塑造成避免碰撞的行为。该系统还支持手臂侧的力反射,以实现接触感知,并提供双臂可操作性的实时力和视觉指导,以提示移动底座重新定位,从而提高可达性。我们展示了TriPilot-FF有效“协同驾驶”人类操作员在长时间范围和需要精确移动底座运动和协调的任务中的能力。最后,我们将遥操作反馈信号整合到具有Transformer的动作分块(ACT)策略中,并证明了在有额外信息可用时性能的提高。我们发布了踏板设备设计、完整的软件堆栈,并对双臂轮式平台进行了广泛的真实世界评估。TriPilot-FF的项目页面是http://bit.ly/46H3ZJT。

🔬 方法详解

问题定义:现有移动机器人全身遥操作系统主要依赖手部控制器,操作员需要同时控制底座和双臂,协调难度大,尤其是在复杂环境中避障和进行精细操作时。缺乏有效的底座控制方式和环境感知反馈是主要痛点。

核心思路:TriPilot-FF的核心思路是利用脚踏板作为底座的控制输入,并结合激光雷达提供的环境信息,通过力反馈模拟障碍物距离,引导操作员进行避障操作。同时,手臂侧提供力反馈,增强操作员的接触感知,并通过视觉提示引导底座重新定位,以提高双臂的可达性。

技术框架:TriPilot-FF系统主要包含以下几个模块:1) 脚踏板控制模块:操作员通过脚踏板控制底座的运动。2) 激光雷达环境感知模块:利用底座安装的激光雷达扫描周围环境。3) 力反馈模块:根据激光雷达数据,计算踏板的阻力,模拟障碍物距离。4) 双臂遥操作模块:采用领导者-跟随者模式,操作员控制主臂,从臂跟随主臂运动。5) 视觉引导模块:提供双臂可操作性的实时力和视觉指导。

关键创新:TriPilot-FF的关键创新在于:1) 引入脚踏板作为底座的控制输入,解放了操作员的双手。2) 利用激光雷达数据生成力反馈,实现了无显式避碰控制器的碰撞规避。3) 将遥操作反馈信号融入强化学习策略,提升了策略的性能。

关键设计:脚踏板的力反馈强度与激光雷达检测到的最近障碍物距离成反比,距离越近,阻力越大。双臂遥操作采用经典的领导者-跟随者模式,并加入了力反馈,增强操作员的接触感知。视觉引导模块显示双臂的可操作性椭球,提示操作员调整底座位置。

🖼️ 关键图片

📊 实验亮点

TriPilot-FF通过脚踏板力反馈实现了直观的底座控制和避障,提升了操作员在复杂环境下的任务完成效率。此外,研究者还将遥操作反馈信号融入到Action Chunking with Transformers (ACT)策略中,实验表明,在有额外信息可用时,策略性能得到显著提升。

🎯 应用场景

TriPilot-FF可应用于各种需要移动机器人进行复杂操作的场景,例如:危险环境下的远程排爆、核电站检修、灾难救援等。该系统能够提高操作员的控制效率和安全性,降低操作难度,并可为机器人自主导航和操作提供数据支持。

📄 摘要(原文)

Mobile manipulators broaden the operational envelope for robot manipulation. However, the whole-body teleoperation of such robots remains a problem: operators must coordinate a wheeled base and two arms while reasoning about obstacles and contact. Existing interfaces are predominantly hand-centric (e.g., VR controllers and joysticks), leaving foot-operated channels underexplored for continuous base control. We present TriPilot-FF, an open-source whole-body teleoperation system for a custom bimanual mobile manipulator that introduces a foot-operated pedal with lidar-driven pedal haptics, coupled with upper-body bimanual leader-follower teleoperation. Using only a low-cost base-mounted lidar, TriPilot-FF renders a resistive pedal cue from proximity-to-obstacle signals in the commanded direction, shaping operator commands toward collision-averse behaviour without an explicit collision-avoidance controller. The system also supports arm-side force reflection for contact awareness and provides real-time force and visual guidance of bimanual manipulability to prompt mobile base repositioning, thereby improving reach. We demonstrate the capability of TriPilot-FF to effectively ``co-pilot'' the human operator over long time-horizons and tasks requiring precise mobile base movement and coordination. Finally, we incorporate teleoperation feedback signals into an Action Chunking with Transformers (ACT) policy and demonstrate improved performance when the additional information is available. We release the pedal device design, full software stack, and conduct extensive real-world evaluations on a bimanual wheeled platform. The project page of TriPilot-FF is http://bit.ly/46H3ZJT.