Rethinking Visual-Language-Action Model Scaling: Alignment, Mixture, and Regularization

作者: Ye Wang, Sipeng Zheng, Hao Luo, Wanpeng Zhang, Haoqi Yuan, Chaoyi Xu, Haiweng Xu, Yicheng Feng, Mingyang Yu, Zhiyu Kang, Zongqing Lu, Qin Jin

分类: cs.RO

发布日期: 2026-02-10

💡 一句话要点

重新思考视觉-语言-动作模型扩展:对齐、混合与正则化

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人控制 数据扩展 跨形态迁移 物理对齐 形态混合 正则化 流匹配

📋 核心要点

- 现有VLA模型在机器人控制中面临异构数据带来的挑战,简单的数据扩展策略可能导致负迁移。

- 论文提出通过物理对齐(统一动作空间)、谨慎的形态混合和有效的正则化策略来优化VLA模型扩展。

- 实验表明,统一末端执行器相对动作表示对于跨形态迁移至关重要,并验证了分组盲集成协议的有效性。

📝 摘要(中文)

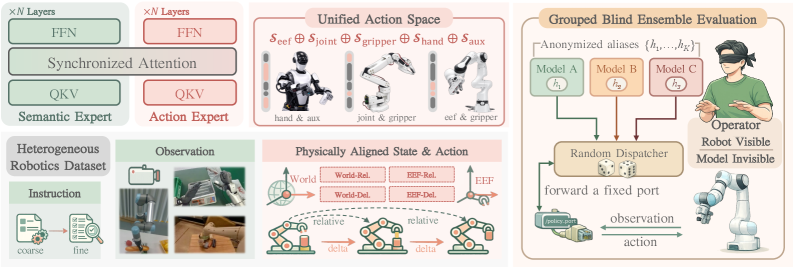

视觉-语言-动作(VLA)模型在通用机器人控制方面展现出强大的潜力,但标准的“数据扩展”方法是否以及在何种条件下适用于机器人领域仍不清楚,因为机器人领域的训练数据在机器人形态、传感器和动作空间方面本质上是异构的。本文对VLA扩展进行了一项系统的、受控的研究,重新审视了跨不同机器人进行预训练的核心训练选择。使用一个代表性的VLA框架(将视觉-语言骨干网络与流匹配相结合),我们在匹配的条件下消融了关键的设计决策,并在广泛的模拟和真实机器人实验中进行了评估。为了提高真实世界结果的可靠性,我们引入了一种分组盲集成协议,该协议使操作员对模型身份视而不见,并将策略执行与结果判断分开,从而减少实验者偏差。我们的分析针对VLA扩展的三个维度。(1) 物理对齐:我们表明,统一的末端执行器(EEF)相对动作表示对于鲁棒的跨形态迁移至关重要。(2) 形态混合:我们发现,简单地汇集异构机器人数据集通常会导致负迁移而不是增益,这突显了不加区分的数据扩展的脆弱性。(3) 训练正则化:我们观察到,直观的策略(如感官dropout和多阶段微调)并不能始终如一地提高大规模性能。总而言之,这项研究挑战了关于具身扩展的一些常见假设,并为从不同的机器人数据中训练大规模VLA策略提供了实践指导。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在扩展到不同机器人平台时,由于各平台在形态、传感器和动作空间上的差异,直接应用数据扩展策略往往导致性能下降,甚至出现负迁移现象。现有方法缺乏对异构数据的有效处理机制,难以实现鲁棒的跨平台泛化能力。

核心思路:论文的核心思路是通过三个关键维度来优化VLA模型的扩展:物理对齐、形态混合和训练正则化。物理对齐旨在统一不同机器人的动作空间,减少形态差异带来的影响;形态混合则关注如何有效地利用异构机器人数据,避免负迁移;训练正则化则探索如何提高模型在不同场景下的泛化能力。

技术框架:论文采用一个典型的VLA框架,该框架包含一个视觉-语言骨干网络和一个流匹配模块。视觉-语言骨干网络负责提取图像和语言指令的特征,流匹配模块则用于将这些特征映射到动作空间。整个训练流程包括预训练和微调两个阶段。在预训练阶段,模型在大规模机器人数据集上进行训练,学习通用的机器人控制知识。在微调阶段,模型在特定机器人平台上进行微调,以适应该平台的特性。

关键创新:论文的关键创新在于对VLA模型扩展的系统性研究,并提出了以下几点改进:1) 强调物理对齐的重要性,提出使用统一的末端执行器(EEF)相对动作表示,以实现更好的跨形态迁移;2) 指出简单地混合异构机器人数据集可能导致负迁移,需要谨慎选择混合策略;3) 引入分组盲集成协议,以减少实验者偏差,提高真实机器人实验结果的可靠性。

关键设计:论文的关键设计包括:1) 使用末端执行器相对动作表示,将不同机器人的动作统一到同一个坐标系下;2) 探索不同的形态混合策略,例如基于相似度的加权混合;3) 尝试不同的正则化方法,例如感官dropout和多阶段微调;4) 采用流匹配作为动作预测模块,将视觉-语言特征映射到连续的动作空间。

🖼️ 关键图片

📊 实验亮点

实验结果表明,统一的末端执行器相对动作表示能够显著提高跨形态迁移的性能。此外,研究发现简单地混合异构机器人数据集可能导致负迁移,需要谨慎选择混合策略。分组盲集成协议能够有效减少实验者偏差,提高真实机器人实验结果的可靠性。这些发现为VLA模型的扩展提供了重要的指导。

🎯 应用场景

该研究成果可应用于通用机器人控制领域,例如家庭服务机器人、工业机器人和自动驾驶汽车等。通过学习不同机器人的数据,VLA模型可以具备更强的泛化能力,从而适应不同的任务和环境。此外,该研究提出的物理对齐和形态混合策略,可以帮助研究人员更好地利用异构机器人数据,加速机器人学习的进程。

📄 摘要(原文)

While Vision-Language-Action (VLA) models show strong promise for generalist robot control, it remains unclear whether -- and under what conditions -- the standard "scale data" recipe translates to robotics, where training data is inherently heterogeneous across embodiments, sensors, and action spaces. We present a systematic, controlled study of VLA scaling that revisits core training choices for pretraining across diverse robots. Using a representative VLA framework that combines a vision-language backbone with flow-matching, we ablate key design decisions under matched conditions and evaluate in extensive simulation and real-robot experiments. To improve the reliability of real-world results, we introduce a Grouped Blind Ensemble protocol that blinds operators to model identity and separates policy execution from outcome judgment, reducing experimenter bias. Our analysis targets three dimensions of VLA scaling. (1) Physical alignment: we show that a unified end-effector (EEF)-relative action representation is critical for robust cross-embodiment transfer. (2) Embodiment mixture: we find that naively pooling heterogeneous robot datasets often induces negative transfer rather than gains, underscoring the fragility of indiscriminate data scaling. (3) Training regularization: we observe that intuitive strategies, such as sensory dropout and multi-stage fine-tuning, do not consistently improve performance at scale. Together, this study challenge some common assumptions about embodied scaling and provide practical guidance for training large-scale VLA policies from diverse robotic data. Project website: https://research.beingbeyond.com/rethink_vla