Phase-Aware Policy Learning for Skateboard Riding of Quadruped Robots via Feature-wise Linear Modulation

作者: Minsung Yoon, Jeil Jeong, Sung-Eui Yoon

分类: cs.RO

发布日期: 2026-02-10

备注: Accepted at ICRA 2026. Supplementary Video: https://www.youtube.com/watch?v=bCNfdQ3RYKg. M. Yoon and J. Jeong contributed equally

💡 一句话要点

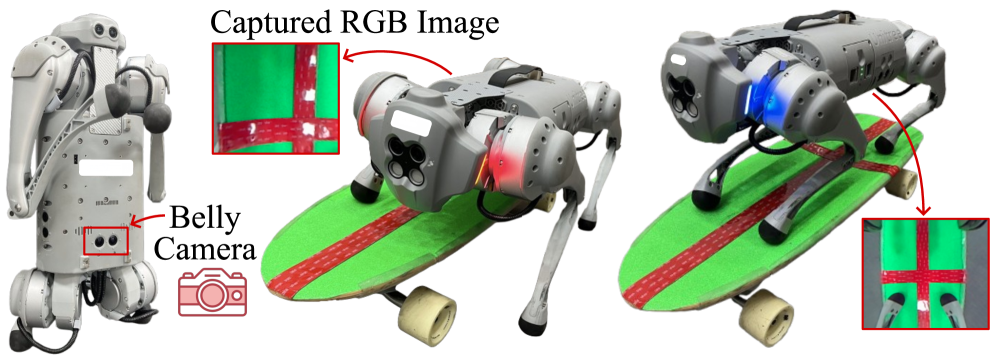

提出基于相位感知的强化学习方法PAPL,用于四足机器人滑板控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 四足机器人 滑板控制 强化学习 相位感知 特征线性调制

📋 核心要点

- 现有方法难以应对滑板运动中感知驱动的交互和多模态控制目标,导致四足机器人滑板控制面临挑战。

- PAPL利用滑板运动的循环特性,通过相位条件化的特征线性调制层,实现相位相关的行为控制和知识共享。

- 仿真实验验证了PAPL在命令跟踪精度和运动效率方面的优势,并证明了其在真实世界中的可行性。

📝 摘要(中文)

滑板作为一种个人移动设备,提供了一种紧凑而高效的交通方式。然而,由于感知驱动的交互以及跨不同滑板阶段的多模态控制目标,使用腿式机器人控制滑板对策略学习提出了诸多挑战。为了应对这些挑战,我们提出了一种相位感知策略学习(PAPL)框架,该框架专为四足机器人滑板运动而设计。PAPL利用滑板运动的循环特性,将相位条件化的特征线性调制层集成到Actor和Critic网络中,从而实现了一种统一的策略,该策略在捕获相位相关行为的同时,共享跨相位的机器人特定知识。在仿真环境中的评估验证了命令跟踪的准确性,并通过消融研究量化了每个组件的贡献。我们还将运动效率与腿式和轮腿式基线进行了比较,并展示了真实世界的迁移能力。

🔬 方法详解

问题定义:论文旨在解决四足机器人滑板控制中的策略学习问题。现有方法难以处理滑板运动中感知驱动的交互,以及不同滑板阶段(例如,推动、平衡、转向)的多模态控制目标。这些因素导致策略学习困难,难以实现稳定和高效的滑板运动。

核心思路:论文的核心思路是利用滑板运动的周期性,将滑板运动分解为不同的相位,并针对每个相位学习特定的控制策略。通过在Actor和Critic网络中引入相位条件化的特征线性调制(FiLM)层,使策略能够根据当前相位自适应地调整行为,从而实现更精细和高效的控制。

技术框架:PAPL框架基于强化学习算法,包含Actor网络和Critic网络。Actor网络负责生成控制指令,Critic网络负责评估当前状态的价值。关键在于,Actor和Critic网络都包含相位条件化的FiLM层。该层接收当前滑板运动的相位作为输入,并根据相位信息调整网络的特征表示。整个训练过程采用标准的强化学习流程,通过与环境交互不断优化策略。

关键创新:PAPL的关键创新在于相位条件化的特征线性调制(FiLM)层。传统的强化学习方法通常使用单一的策略来控制机器人的所有行为,而PAPL则根据滑板运动的相位动态调整策略。FiLM层允许网络根据当前相位自适应地调整特征表示,从而实现更精细和高效的控制。这种方法能够更好地捕捉滑板运动的复杂性和多模态特性。

关键设计:相位信息通过编码器获得,并输入到FiLM层中。FiLM层通过两个线性变换(γ和β)来调制特征图,公式为:FiLM(x) = γ * x + β,其中x是输入特征,γ和β是相位编码的函数。Actor和Critic网络的具体结构未知,但都包含多个FiLM层。损失函数采用标准的强化学习损失函数,例如PPO的裁剪损失。

🖼️ 关键图片

📊 实验亮点

仿真实验表明,PAPL在命令跟踪精度和运动效率方面优于传统的腿式和轮腿式基线方法。消融研究验证了相位条件化和FiLM层对性能提升的贡献。此外,实验还证明了PAPL策略在真实世界中的迁移能力,表明该方法具有良好的泛化性能。具体性能数据未知。

🎯 应用场景

该研究成果可应用于开发更智能、更灵活的腿式机器人,使其能够在复杂环境中执行任务,例如在城市环境中进行快速移动和运输。此外,该方法还可以推广到其他具有周期性运动特征的机器人控制任务,例如跑步、跳跃等。未来,该技术有望应用于物流、救援、娱乐等领域。

📄 摘要(原文)

Skateboards offer a compact and efficient means of transportation as a type of personal mobility device. However, controlling them with legged robots poses several challenges for policy learning due to perception-driven interactions and multi-modal control objectives across distinct skateboarding phases. To address these challenges, we introduce Phase-Aware Policy Learning (PAPL), a reinforcement-learning framework tailored for skateboarding with quadruped robots. PAPL leverages the cyclic nature of skateboarding by integrating phase-conditioned Feature-wise Linear Modulation layers into actor and critic networks, enabling a unified policy that captures phase-dependent behaviors while sharing robot-specific knowledge across phases. Our evaluations in simulation validate command-tracking accuracy and conduct ablation studies quantifying each component's contribution. We also compare locomotion efficiency against leg and wheel-leg baselines and show real-world transferability.