GaussianCaR: Gaussian Splatting for Efficient Camera-Radar Fusion

作者: Santiago Montiel-Marín, Miguel Antunes-García, Fabio Sánchez-García, Angel Llamazares, Holger Caesar, Luis M. Bergasa

分类: cs.RO

发布日期: 2026-02-09

备注: 8 pages, 6 figures. Accepted to IEEE ICRA 2026

💡 一句话要点

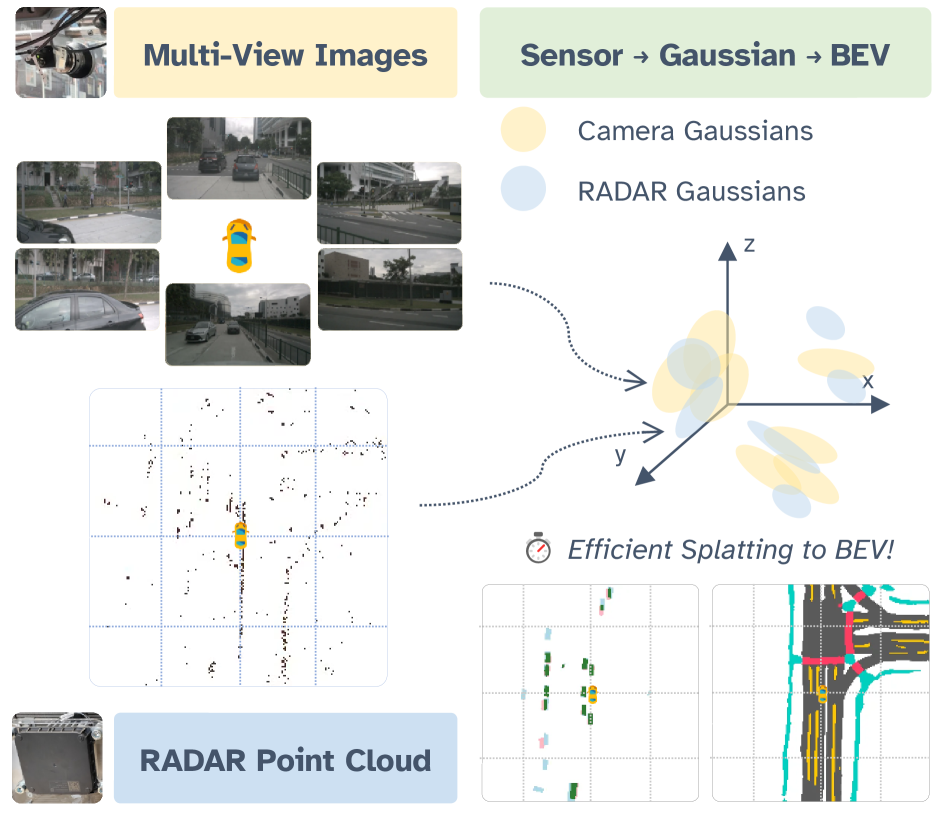

GaussianCaR:利用高斯溅射实现高效相机-雷达融合的BEV分割

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 相机雷达融合 高斯溅射 鸟瞰图分割 自动驾驶 多模态融合 传感器融合 BEV感知

📋 核心要点

- 现有BEV融合方法在处理相机和雷达数据时,视角差异大,融合效率低,限制了自动驾驶感知的性能。

- GaussianCaR利用高斯溅射作为通用视角转换器,将相机和雷达数据映射到统一的BEV特征空间,实现高效融合。

- 实验表明,GaussianCaR在nuScenes数据集上实现了与SOTA相当甚至更优的BEV分割性能,且推理速度提升3.2倍。

📝 摘要(中文)

在复杂交通场景中,对动态物体和地图元素进行鲁棒而精确的感知对于自动驾驶车辆的安全导航至关重要。虽然纯视觉方法由于其技术进步已成为事实上的标准,但它们可以受益于与雷达测量进行有效且经济高效的融合。本文通过重新利用高斯溅射作为一种高效的通用视角转换器来弥合视角差异,从而推进了融合方法,将图像像素和雷达点都映射到通用的鸟瞰图(BEV)表示中。我们的主要贡献是GaussianCaR,这是一个用于BEV分割的端到端网络,与先前的BEV融合方法不同,它利用高斯溅射将原始传感器信息映射到潜在特征,以实现高效的相机-雷达融合。我们的架构将多尺度融合与Transformer解码器相结合,以高效地提取BEV特征。实验结果表明,我们的方法在nuScenes数据集上的BEV分割任务中达到了与最先进水平相当甚至超过的性能(车辆、道路和车道分隔线的IoU分别为57.3%、82.9%和50.1%),同时保持了3.2倍更快的推理运行时间。代码和项目页面已在线提供。

🔬 方法详解

问题定义:论文旨在解决自动驾驶场景下,相机和雷达数据融合的效率和精度问题。现有方法通常难以有效处理相机和雷达之间的视角差异,导致融合后的BEV特征不够鲁棒,影响感知性能。此外,现有融合方法的计算复杂度较高,难以满足自动驾驶实时性的要求。

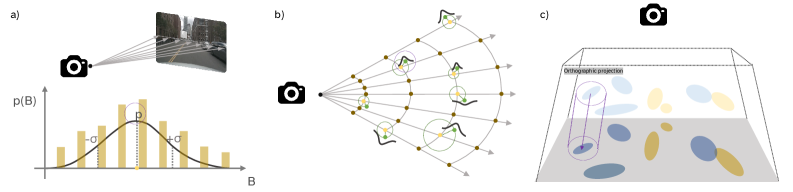

核心思路:论文的核心思路是利用高斯溅射(Gaussian Splatting)作为一种高效的通用视角转换器,将相机图像像素和雷达点云数据都映射到统一的鸟瞰图(BEV)表示中。通过在高斯溅射的隐空间中进行特征融合,可以有效弥合相机和雷达之间的视角差异,并提高融合效率。

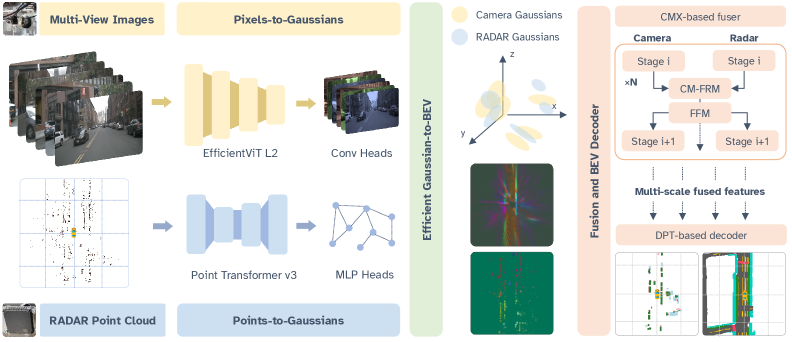

技术框架:GaussianCaR的整体架构是一个端到端的BEV分割网络,主要包含以下几个模块:1) 相机图像特征提取模块:使用卷积神经网络提取多尺度图像特征;2) 雷达点云特征提取模块:提取雷达点云特征;3) 高斯溅射模块:将相机图像像素和雷达点云数据映射到BEV空间,并生成高斯分布;4) 多尺度特征融合模块:将不同尺度的图像特征和雷达特征在高斯溅射的隐空间中进行融合;5) Transformer解码器:利用Transformer解码器提取BEV特征,并进行BEV分割。

关键创新:论文最重要的技术创新点在于将高斯溅射引入到相机-雷达融合中,并将其作为一种高效的通用视角转换器。与现有方法相比,GaussianCaR可以直接将原始传感器数据映射到BEV特征空间,避免了复杂的坐标转换和特征对齐操作,从而提高了融合效率和精度。

关键设计:GaussianCaR的关键设计包括:1) 使用多尺度特征融合来捕获不同尺度的图像和雷达信息;2) 使用Transformer解码器来提取全局BEV特征;3) 使用高斯分布来表示BEV空间中的特征,从而可以更好地处理传感器噪声和不确定性;4) 针对BEV分割任务,设计了相应的损失函数,包括交叉熵损失和IoU损失。

🖼️ 关键图片

📊 实验亮点

GaussianCaR在nuScenes数据集上进行了评估,实验结果表明,该方法在BEV分割任务中达到了与SOTA相当甚至更优的性能(车辆、道路和车道分隔线的IoU分别为57.3%、82.9%和50.1%),同时保持了3.2倍更快的推理运行时间。这表明GaussianCaR在保证感知精度的同时,显著提高了计算效率。

🎯 应用场景

GaussianCaR可应用于自动驾驶、机器人导航、智能交通等领域。通过高效融合相机和雷达数据,可以提升环境感知的鲁棒性和准确性,从而提高自动驾驶车辆的安全性。该方法还可以应用于构建高精度地图、目标跟踪、行为预测等任务,具有广泛的应用前景。

📄 摘要(原文)

Robust and accurate perception of dynamic objects and map elements is crucial for autonomous vehicles performing safe navigation in complex traffic scenarios. While vision-only methods have become the de facto standard due to their technical advances, they can benefit from effective and cost-efficient fusion with radar measurements. In this work, we advance fusion methods by repurposing Gaussian Splatting as an efficient universal view transformer that bridges the view disparity gap, mapping both image pixels and radar points into a common Bird's-Eye View (BEV) representation. Our main contribution is GaussianCaR, an end-to-end network for BEV segmentation that, unlike prior BEV fusion methods, leverages Gaussian Splatting to map raw sensor information into latent features for efficient camera-radar fusion. Our architecture combines multi-scale fusion with a transformer decoder to efficiently extract BEV features. Experimental results demonstrate that our approach achieves performance on par with, or even surpassing, the state of the art on BEV segmentation tasks (57.3%, 82.9%, and 50.1% IoU for vehicles, roads, and lane dividers) on the nuScenes dataset, while maintaining a 3.2x faster inference runtime. Code and project page are available online.