Mind the Gap: Learning Implicit Impedance in Visuomotor Policies via Intent-Execution Mismatch

作者: Cuijie Xu, Shurui Zheng, Zihao Su, Yuanfan Xu, Tinghao Yi, Xudong Zhang, Jian Wang, Yu Wang, Jinchen Yu

分类: cs.RO

发布日期: 2026-02-09

备注: 14 pages, 9 figures, 5 tables

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于意图-执行不匹配学习的隐式阻抗控制方法,用于提升遥操作机器人性能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 遥操作机器人 行为克隆 意图克隆 隐式阻抗控制 意图-执行不匹配

📋 核心要点

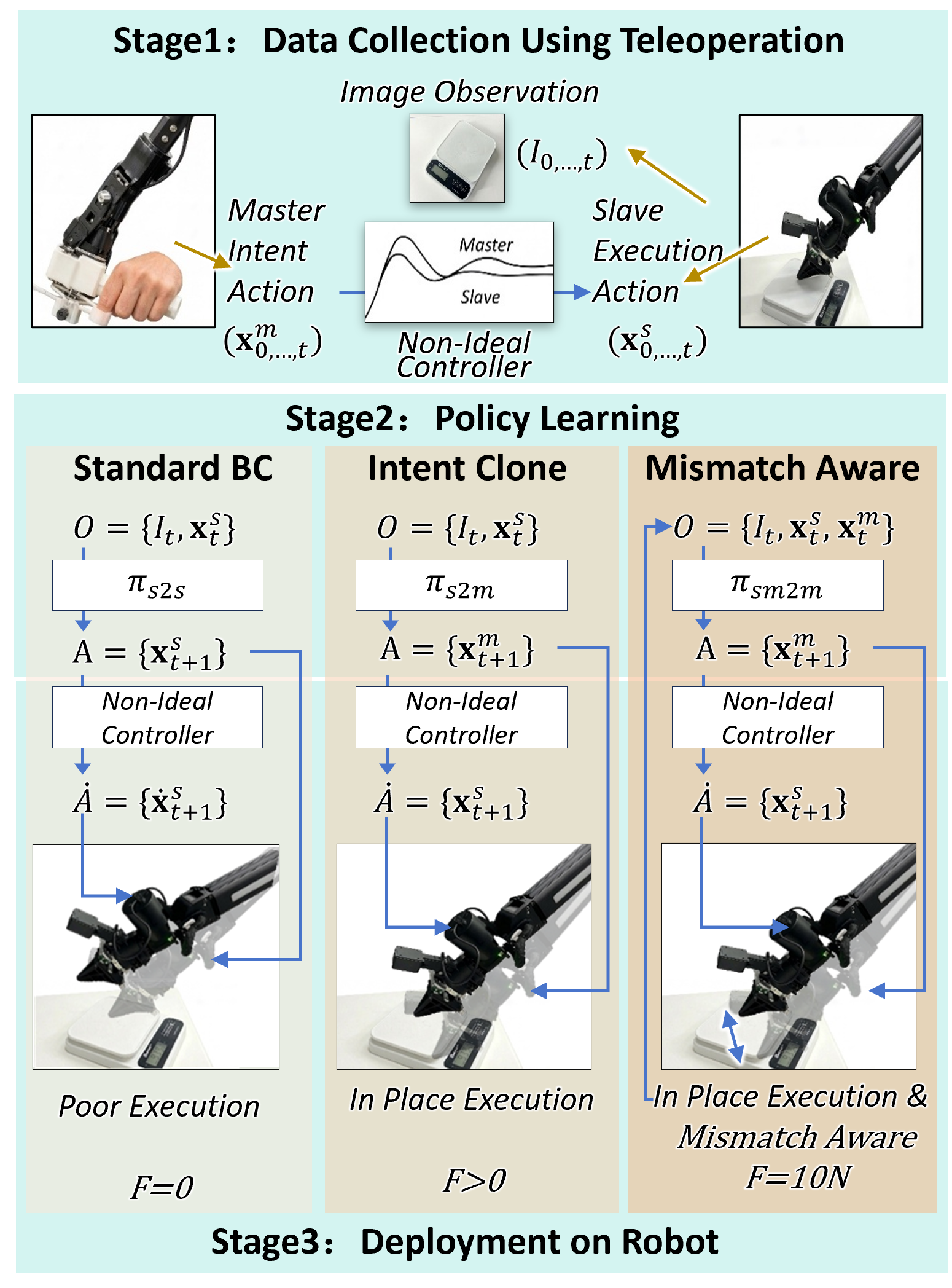

- 传统行为克隆忽略了遥操作中人为补偿硬件缺陷(如延迟、摩擦)的机制,导致性能受限。

- 论文提出“意图克隆”方法,利用主端指令与从端响应的差异(意图-执行不匹配)学习隐式阻抗控制。

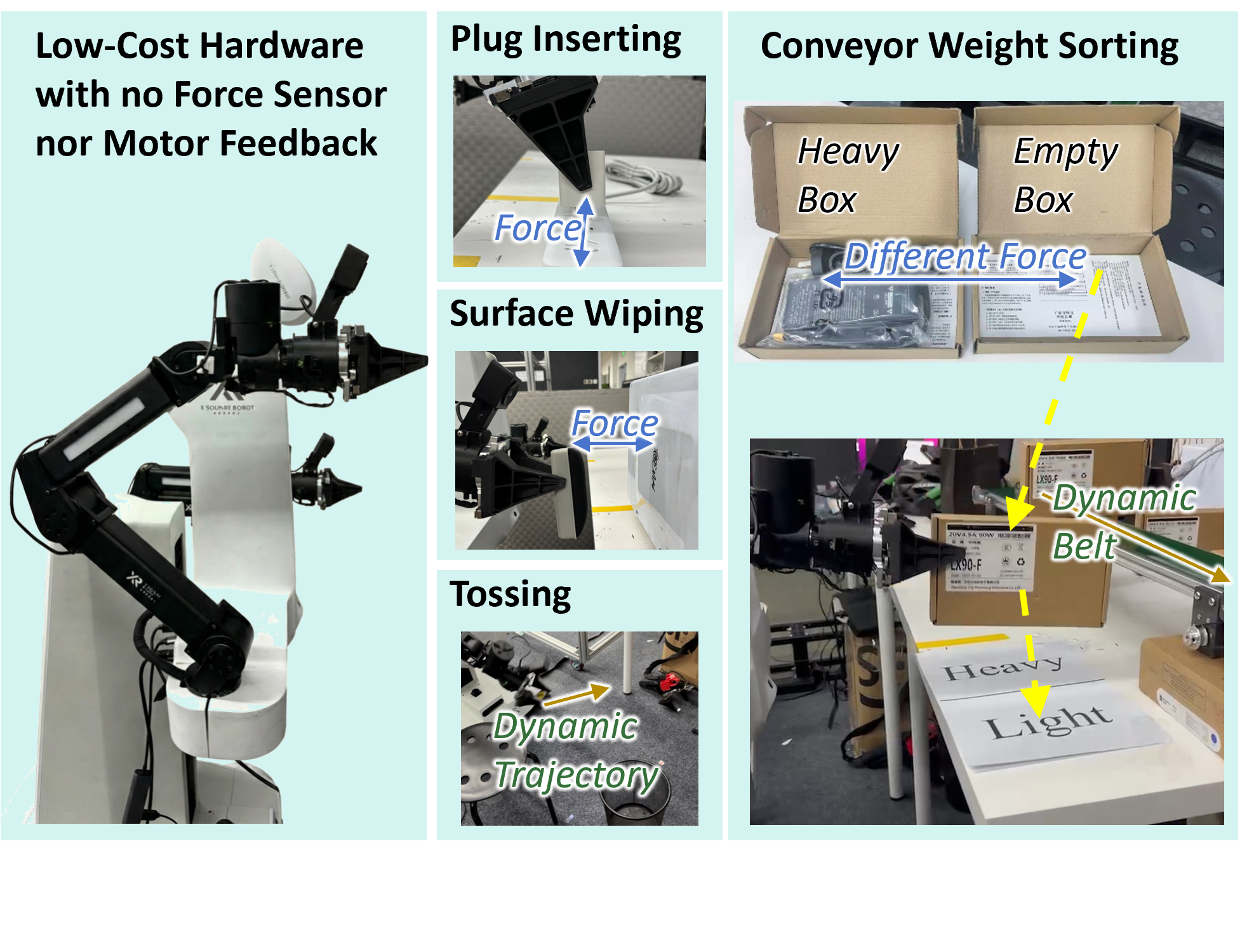

- 实验表明,该方法在接触操作和动态跟踪任务中优于传统行为克隆,无需力传感器即可实现力感知。

📝 摘要(中文)

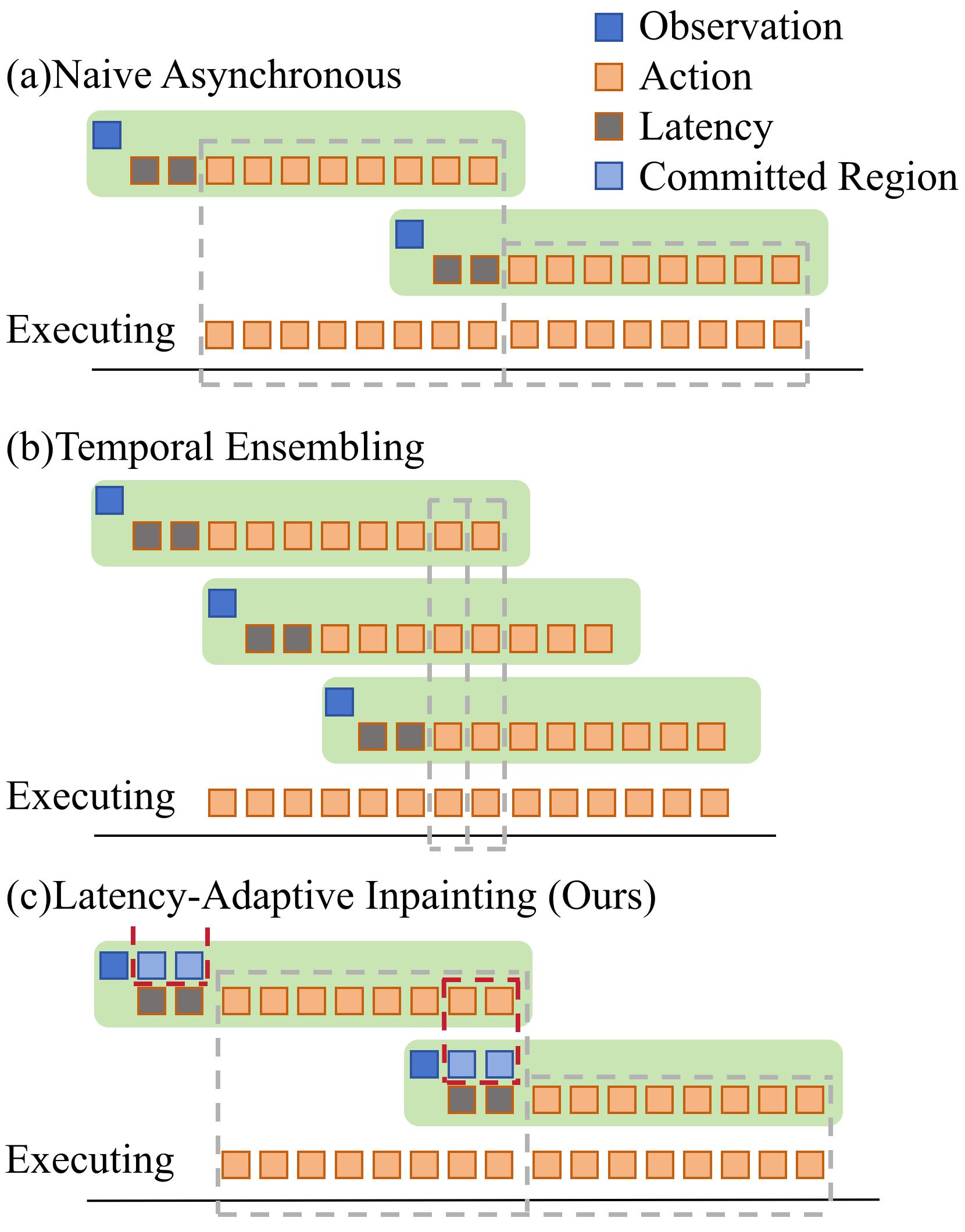

本文提出了一种双状态条件框架,通过“意图克隆”学习遥操作机器人的控制策略。该方法认为主端指令与从端响应之间的“意图-执行不匹配”并非噪声,而是编码了隐式交互力和揭示操作者克服系统动态策略的关键信号。通过预测主端意图,策略学习生成一个“虚拟平衡点”,实现隐式阻抗控制。此外,通过显式地以该不匹配的历史为条件,模型执行隐式系统辨识,将跟踪误差视为外部力来闭合控制回路。为了弥补推理延迟引起的时间间隔,进一步将策略公式化为轨迹修复器以确保连续控制。在低成本双臂平台上验证了该方法,结果表明,在需要接触操作和动态跟踪的任务中,标准执行克隆由于无法克服接触刚度和跟踪滞后而失败,而本文提出的方法取得了显著成功。该方法为低成本硬件提供了一个极简的行为克隆框架,无需显式力传感即可实现力感知和动态补偿。

🔬 方法详解

问题定义:遥操作机器人通常面临硬件缺陷,如延迟、机械摩擦和缺乏力反馈,操作员需要主动补偿这些缺陷。传统的行为克隆方法直接模仿机器人的执行轨迹,忽略了操作员的补偿机制,导致在接触操作和动态跟踪等任务中性能不佳,尤其是在低成本、无力传感器的硬件平台上。

核心思路:论文的核心思路是将学习目标从模仿机器人的执行轨迹转变为模仿操作员的“意图”,即主端指令。作者认为,主端指令与从端响应之间的差异(意图-执行不匹配)包含了操作员克服系统动态特性的策略信息,通过学习这种不匹配关系,可以使机器人学习到隐式的阻抗控制,从而更好地适应环境变化和硬件缺陷。

技术框架:该方法采用双状态条件框架,主要包含以下几个模块:1) 意图预测模块:预测主端指令,作为期望的机器人行为。2) 意图-执行不匹配模块:计算主端指令与从端实际执行轨迹之间的差异。3) 隐式系统辨识模块:利用不匹配的历史信息进行系统辨识,估计外部干扰和系统动态。4) 轨迹修复模块:弥补推理延迟,生成连续的控制轨迹。整体流程是,首先利用历史数据训练模型,然后在线推理时,模型根据当前状态和历史不匹配信息预测主端意图,并生成控制指令。

关键创新:该方法最重要的创新点在于将“意图-执行不匹配”视为一种有用的信号,而不是噪声。通过学习这种不匹配关系,模型可以学习到隐式的阻抗控制,从而更好地适应环境变化和硬件缺陷。与传统的行为克隆方法相比,该方法能够更好地捕捉操作员的控制策略,并且不需要显式的力传感器。

关键设计:论文中,策略网络以主从端的历史状态和意图-执行不匹配的历史作为输入,预测下一步的主端意图。损失函数主要包括意图预测损失和轨迹平滑损失。轨迹修复模块采用类似于图像修复的网络结构,以保证控制轨迹的连续性。具体网络结构和参数设置在论文中有详细描述,但此处未提供。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在接触操作和动态跟踪任务中,该方法显著优于传统的行为克隆方法。具体来说,在某项接触操作任务中,传统行为克隆的成功率接近于0,而该方法的成功率达到了80%以上。此外,在动态跟踪任务中,该方法的跟踪误差也明显小于传统方法。这些结果表明,该方法能够有效地学习隐式阻抗控制,并提高遥操作机器人的性能。

🎯 应用场景

该研究成果可应用于各种遥操作机器人系统,尤其是在低成本、无力传感器的场景下。例如,可以用于远程医疗手术、危险环境下的机器人操作、以及消费级机器人等领域。通过学习操作员的控制策略,机器人可以更好地适应环境变化和硬件缺陷,提高操作效率和安全性,降低对硬件的要求。

📄 摘要(原文)

Teleoperation inherently relies on the human operator acting as a closed-loop controller to actively compensate for hardware imperfections, including latency, mechanical friction, and lack of explicit force feedback. Standard Behavior Cloning (BC), by mimicking the robot's executed trajectory, fundamentally ignores this compensatory mechanism. In this work, we propose a Dual-State Conditioning framework that shifts the learning objective to "Intent Cloning" (master command). We posit that the Intent-Execution Mismatch, the discrepancy between master command and slave response, is not noise, but a critical signal that physically encodes implicit interaction forces and algorithmically reveals the operator's strategy for overcoming system dynamics. By predicting the master intent, our policy learns to generate a "virtual equilibrium point", effectively realizing implicit impedance control. Furthermore, by explicitly conditioning on the history of this mismatch, the model performs implicit system identification, perceiving tracking errors as external forces to close the control loop. To bridge the temporal gap caused by inference latency, we further formulate the policy as a trajectory inpainter to ensure continuous control. We validate our approach on a sensorless, low-cost bi-manual setup. Empirical results across tasks requiring contact-rich manipulation and dynamic tracking reveal a decisive gap: while standard execution-cloning fails due to the inability to overcome contact stiffness and tracking lag, our mismatch-aware approach achieves robust success. This presents a minimalist behavior cloning framework for low-cost hardware, enabling force perception and dynamic compensation without relying on explicit force sensing. Videos are available on the \href{https://xucj98.github.io/mind-the-gap-page/}{project page}.