Constrained Sampling to Guide Universal Manipulation RL

作者: Marc Toussaint, Cornelius V. Braun, Eckart Cobo-Briesewitz, Sayantan Auddy, Armand Jordana, Justin Carpentier

分类: cs.RO

发布日期: 2026-02-09

💡 一句话要点

提出Sample-Guided RL,引导通用操作强化学习探索复杂操作策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 机器人操作 模型预测控制 约束求解 通用策略

📋 核心要点

- 强化学习在操作任务中面临探索难题,尤其是在奖励稀疏和需要复杂接触策略时。

- Sample-Guided RL利用基于模型的约束求解器,采样可行状态来引导强化学习,提升探索效率。

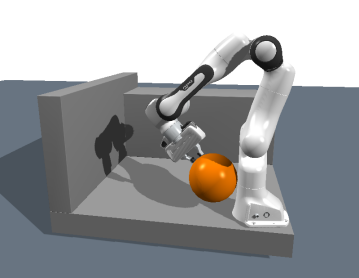

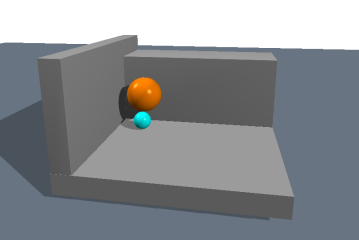

- 实验表明,该方法在双球和Panda机械臂操作任务中,显著提高了成功率,并发现了复杂操作策略。

📝 摘要(中文)

本文研究如何利用基于模型的求解器来指导通用策略的训练,使其能够在接触丰富的操作环境中,从任何可行的起始状态控制到任何可行的目标状态。尽管强化学习(RL)已经在此类环境中展示了其优势,但它可能难以充分探索和发现复杂的操作策略,尤其是在稀疏奖励设置中。我们的方法基于一个低维流形的概念,该流形由操作过程中可行的、可能访问的状态组成,并使用来自该流形的采样器来指导RL。我们提出了Sample-Guided RL,它使用基于模型的约束求解器来有效地采样可行的配置(满足可微的碰撞、接触和力约束),并利用它们来指导通用(目标条件)操作策略的RL。我们研究了直接使用这些数据来偏置状态访问,以及使用随机配置之间的开环轨迹的黑盒优化来施加状态偏差,并可选择添加行为克隆损失。在一个极简的双球操作环境中,Sample-Guided RL发现了复杂的操作策略,并在达到任何静态稳定状态时实现了高成功率。在一个更具挑战性的Panda机械臂环境中,我们的方法相对于接近于零的基线实现了显著的成功率,并展示了广泛的复杂全身接触操作策略。

🔬 方法详解

问题定义:现有强化学习方法在接触丰富的操作任务中,尤其是在奖励稀疏的情况下,难以有效探索和发现复杂的操作策略。传统的RL方法可能需要大量的试错才能学习到合适的策略,这在实际应用中是不可接受的。因此,如何引导RL算法更有效地探索可行状态空间,学习到复杂的操作策略,是本文要解决的核心问题。

核心思路:本文的核心思路是利用基于模型的约束求解器,对操作任务中可行且可能访问的状态进行采样,构建一个低维流形。然后,利用这些采样点来引导强化学习算法,使其能够更有效地探索状态空间,并学习到复杂的操作策略。这种方法结合了模型预测的优势和强化学习的自学习能力,从而提高了学习效率和性能。

技术框架:Sample-Guided RL的整体框架包括以下几个主要模块:1) 基于模型的约束求解器:用于生成满足碰撞、接触和力约束的可行状态样本。2) 状态偏置模块:利用采样数据来偏置强化学习算法的状态访问,鼓励算法探索更有可能成功的状态。3) 行为克隆模块(可选):利用采样数据训练一个行为克隆策略,作为强化学习的初始化或辅助损失。4) 强化学习算法:利用状态偏置和行为克隆策略的指导,学习最终的操作策略。整个流程是先通过约束求解器生成可行状态,然后利用这些状态来引导强化学习算法的学习过程。

关键创新:该方法最重要的创新点在于将基于模型的约束求解器与强化学习算法相结合,利用模型预测来指导强化学习的探索过程。与传统的强化学习方法相比,Sample-Guided RL能够更有效地探索状态空间,并学习到复杂的操作策略。此外,该方法还提出了一种利用采样数据来偏置状态访问和添加行为克隆损失的策略,进一步提高了学习效率和性能。

关键设计:在具体实现中,约束求解器需要能够处理可微的碰撞、接触和力约束,以便能够生成高质量的可行状态样本。状态偏置模块可以通过多种方式实现,例如,可以直接使用采样数据来调整状态访问概率,或者使用黑盒优化方法来生成连接随机配置的开环轨迹。行为克隆模块可以使用标准的监督学习方法进行训练。强化学习算法可以选择任何合适的算法,例如,PPO或SAC。关键参数包括采样点的数量、状态偏置的强度、行为克隆损失的权重等。

🖼️ 关键图片

📊 实验亮点

在双球操作任务中,Sample-Guided RL能够发现复杂的操作策略,并在达到任何静态稳定状态时实现了高成功率。在更具挑战性的Panda机械臂操作任务中,该方法相对于接近于零的基线实现了显著的成功率,并展示了广泛的复杂全身接触操作策略。这些实验结果表明,Sample-Guided RL能够有效地引导强化学习算法学习复杂的操作策略,并在实际应用中具有很大的潜力。

🎯 应用场景

该研究成果可应用于各种需要复杂操作策略的机器人任务,例如,装配、抓取、操作等。特别是在奖励稀疏或环境复杂的场景下,Sample-Guided RL能够显著提高学习效率和性能。此外,该方法还可以扩展到其他领域,例如,自动驾驶、游戏AI等,只要能够利用模型预测来指导强化学习的探索过程。

📄 摘要(原文)

We consider how model-based solvers can be leveraged to guide training of a universal policy to control from any feasible start state to any feasible goal in a contact-rich manipulation setting. While Reinforcement Learning (RL) has demonstrated its strength in such settings, it may struggle to sufficiently explore and discover complex manipulation strategies, especially in sparse-reward settings. Our approach is based on the idea of a lower-dimensional manifold of feasible, likely-visited states during such manipulation and to guide RL with a sampler from this manifold. We propose Sample-Guided RL, which uses model-based constraint solvers to efficiently sample feasible configurations (satisfying differentiable collision, contact, and force constraints) and leverage them to guide RL for universal (goal-conditioned) manipulation policies. We study using this data directly to bias state visitation, as well as using black-box optimization of open-loop trajectories between random configurations to impose a state bias and optionally add a behavior cloning loss. In a minimalistic double sphere manipulation setting, Sample-Guided RL discovers complex manipulation strategies and achieves high success rates in reaching any statically stable state. In a more challenging panda arm setting, our approach achieves a significant success rate over a near-zero baseline, and demonstrates a breadth of complex whole-body-contact manipulation strategies.