Bi-Adapt: Few-shot Bimanual Adaptation for Novel Categories of 3D Objects via Semantic Correspondence

作者: Jinxian Zhou, Ruihai Wu, Yiwei Liu, Yiwen Hou, Xunzhe Zhou, Checheng Yu, Licheng Zhong, Lin Shao

分类: cs.RO

发布日期: 2026-02-09

💡 一句话要点

Bi-Adapt:基于语义对应,实现3D物体新类别下的少样本双臂操作自适应

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双臂操作 少样本学习 语义对应 视觉基础模型 机器人操作 Affordance 映射 跨类别泛化

📋 核心要点

- 双臂操作对机器人执行复杂任务至关重要,但现有方法依赖大量数据和训练,难以有效泛化到新类别物体。

- Bi-Adapt利用视觉基础模型进行跨类别的 affordance 映射,并通过少量数据微调实现对新类别的泛化。

- 实验结果表明,Bi-Adapt在模拟和真实环境中均表现出高效率和高成功率,验证了其有效性。

📝 摘要(中文)

本文提出Bi-Adapt框架,旨在通过语义对应实现双臂操作的有效泛化。Bi-Adapt利用视觉基础模型的强大能力实现跨类别的 affordance 映射。通过对新类别进行少量数据微调,Bi-Adapt 能够以零样本方式显著泛化到类别外的物体。在模拟和真实环境中的大量实验验证了该方法的有效性,并表明其具有很高的效率,在不同基准任务上,仅使用有限的数据,就能在新类别上实现很高的成功率。

🔬 方法详解

问题定义:现有双臂操作方法需要大量数据收集和训练,难以泛化到未见过的物体类别。这限制了机器人在动态和多样化环境中执行任务的能力。痛点在于缺乏一种能够快速适应新类别物体的双臂操作框架。

核心思路:Bi-Adapt的核心思路是利用视觉基础模型强大的语义理解能力,建立跨类别物体之间的 affordance 映射关系。通过这种映射,可以将已学习的知识迁移到新的物体类别上,从而减少对新类别数据的依赖。

技术框架:Bi-Adapt框架主要包含以下几个阶段:1) 利用视觉基础模型提取物体的语义特征;2) 建立跨类别物体之间的语义对应关系,从而实现 affordance 映射;3) 使用少量新类别的数据对模型进行微调,以适应新物体的特定属性;4) 利用学习到的 affordance 映射和微调后的模型进行双臂操作。

关键创新:Bi-Adapt的关键创新在于利用视觉基础模型进行跨类别的 affordance 映射。与传统的基于几何特征或手工设计的 affordance 表示方法不同,Bi-Adapt能够自动学习物体之间的语义关系,从而实现更鲁棒和泛化的 affordance 映射。

关键设计:Bi-Adapt的关键设计包括:1) 使用预训练的视觉 Transformer 模型(例如 CLIP)提取物体的视觉特征;2) 设计一种基于图神经网络的语义对应模块,用于建立跨类别物体之间的语义关系;3) 使用对比学习损失函数来训练语义对应模块,使其能够学习到更准确的 affordance 映射;4) 使用强化学习算法来优化双臂操作策略。

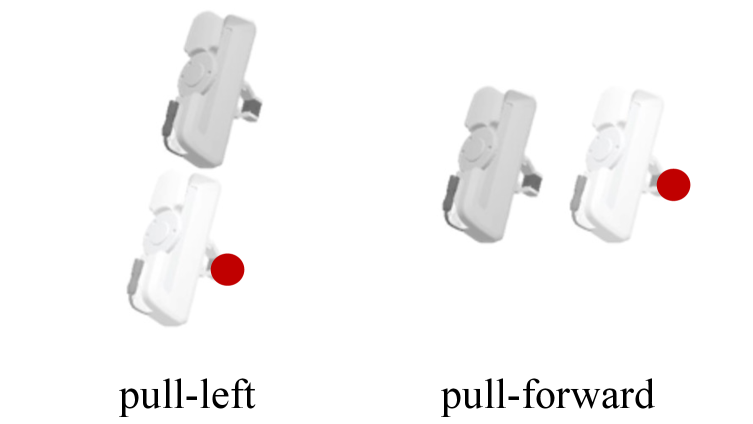

🖼️ 关键图片

📊 实验亮点

Bi-Adapt 在模拟和真实环境中的实验结果表明,该方法能够在新类别物体上实现很高的双臂操作成功率。与现有方法相比,Bi-Adapt 仅需少量数据即可达到 comparable 甚至更好的性能。例如,在某项基准测试中,Bi-Adapt 使用 10% 的数据即可达到与现有方法使用 100% 数据相当的成功率。

🎯 应用场景

Bi-Adapt 有潜力应用于各种需要双臂操作的机器人任务中,例如:家庭服务机器人可以利用该技术操作不同形状和大小的家居物品;工业机器人可以快速适应生产线上新产品的装配任务;医疗机器人可以辅助医生进行手术操作。该研究的实际价值在于降低了双臂操作系统的部署成本和开发周期,并提高了机器人的智能化水平。

📄 摘要(原文)

Bimanual manipulation is imperative yet challenging for robots to execute complex tasks, requiring coordinated collaboration between two arms. However, existing methods for bimanual manipulation often rely on costly data collection and training, struggling to generalize to unseen objects in novel categories efficiently. In this paper, we present Bi-Adapt, a novel framework designed for efficient generalization for bimanual manipulation via semantic correspondence. Bi-Adapt achieves cross-category affordance mapping by leveraging the strong capability of vision foundation models. Fine-tuning with restricted data on novel categories, Bi-Adapt exhibits notable generalization to out-of-category objects in a zero-shot manner. Extensive experiments conducted in both simulation and real-world environments validate the effectiveness of our approach and demonstrate its high efficiency, achieving a high success rate on different benchmark tasks across novel categories with limited data. Project website: https://biadapt-project.github.io/