BiManiBench: A Hierarchical Benchmark for Evaluating Bimanual Coordination of Multimodal Large Language Models

作者: Xin Wu, Zhixuan Liang, Yue Ma, Mengkang Hu, Zhiyuan Qin, Xiu Li

分类: cs.RO, cs.AI, cs.CV

发布日期: 2026-02-09

备注: 38 pages, 9 figures. Project page:https://bimanibench.github.io/

💡 一句话要点

BiManiBench:多模态大语言模型双臂协调能力的层级评估基准

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双臂协调 多模态大语言模型 机器人智能 具身智能 评估基准 空间推理 动作规划

📋 核心要点

- 现有机器人智能评估框架主要关注单臂操作,忽略了双臂协调任务中复杂的时空关系。

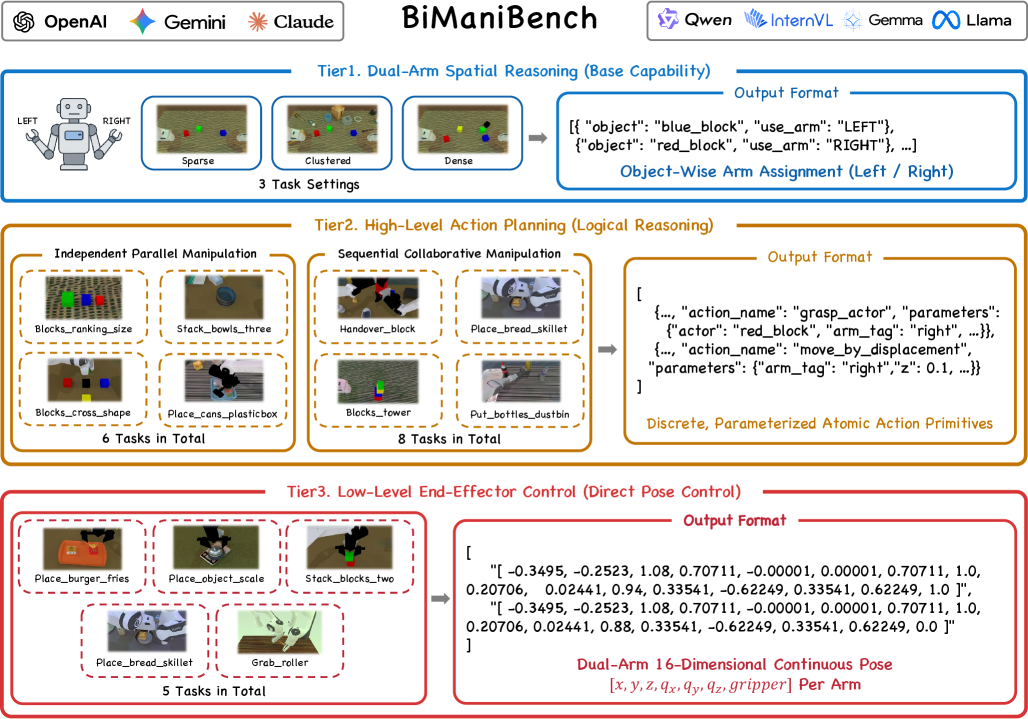

- BiManiBench通过分层评估MLLMs在空间推理、动作规划和末端执行器控制方面的能力,来解决双臂协调的评估难题。

- 实验结果表明,MLLMs在高层推理方面表现良好,但在双臂空间定位和控制方面存在不足,需要进一步研究。

📝 摘要(中文)

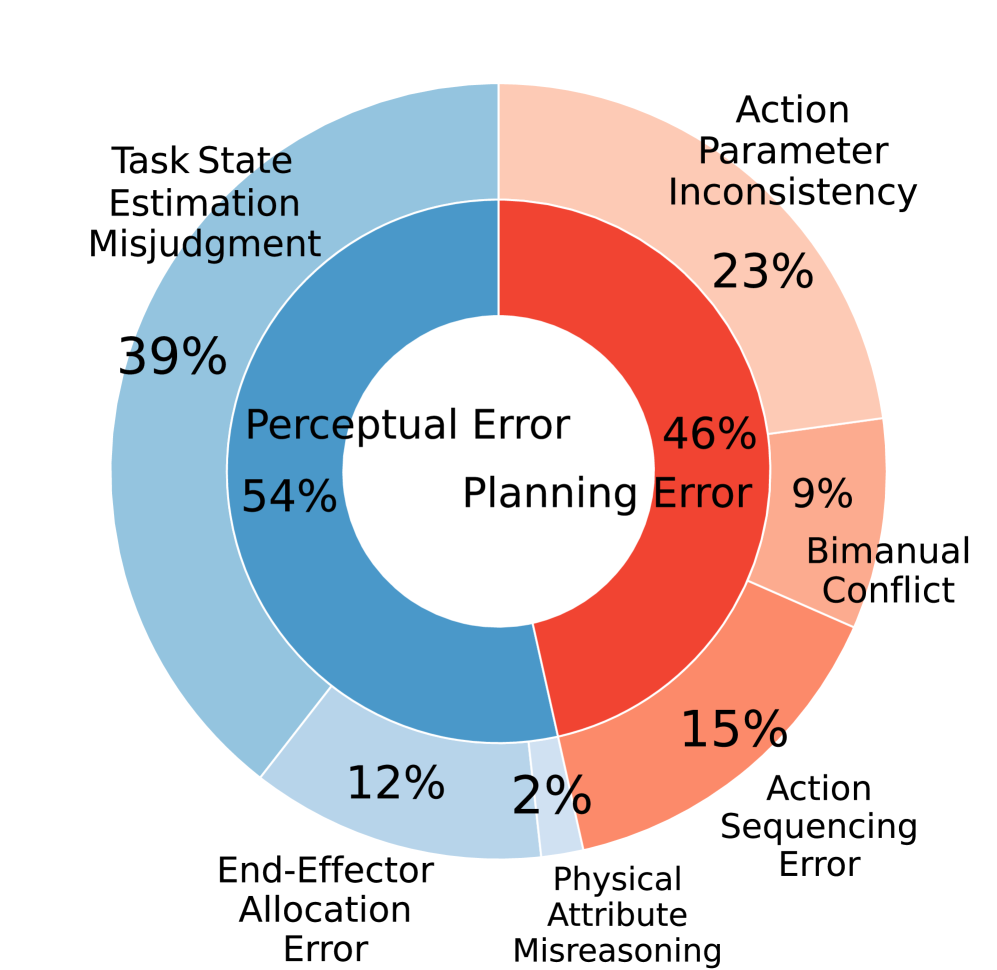

多模态大语言模型(MLLMs)显著推动了具身智能的发展,利用它们来评估机器人智能已成为关键趋势。然而,现有框架主要局限于单臂操作,无法捕捉双臂任务所需的时空协调,例如抬起重锅。为此,我们推出了BiManiBench,一个层级基准,用于评估MLLMs在三个层面的能力:基础空间推理、高层动作规划和底层末端执行器控制。我们的框架隔离了独特的双臂挑战,例如手臂可达性和运动学约束,从而区分了感知幻觉和规划失败。对30多个最先进模型的分析表明,尽管MLLMs具有高层推理能力,但在双臂空间定位和控制方面存在困难,经常导致相互干扰和序列错误。这些发现表明,当前的范式缺乏对相互运动学约束的深刻理解,突出了未来研究需要关注臂间避碰和精细的时间序列。

🔬 方法详解

问题定义:现有机器人智能评估框架主要集中于单臂操作,缺乏对双臂协调任务的有效评估。在双臂任务中,例如搬运重物,需要考虑两个手臂之间的空间关系、运动学约束以及时间序列的协调,这些都是单臂任务所不具备的挑战。现有方法难以区分感知错误、规划失败以及控制误差,阻碍了对MLLMs双臂操作能力的深入理解。

核心思路:BiManiBench的核心思路是通过构建一个分层评估体系,将双臂协调任务分解为三个层次:基础空间推理、高层动作规划和底层末端执行器控制。通过这种分层的方式,可以更精确地定位MLLMs在双臂任务中遇到的问题,例如是空间理解错误,还是规划策略不合理,亦或是末端执行器控制精度不足。

技术框架:BiManiBench框架包含三个主要层级:1) 基础空间推理层,评估MLLMs对物体位置、姿态以及手臂可达性的理解能力;2) 高层动作规划层,评估MLLMs生成合理双臂动作序列的能力,例如先抓取物体再抬起;3) 底层末端执行器控制层,评估MLLMs控制机械臂精确执行动作的能力,例如控制机械臂到达指定位置。每个层级都设计了相应的测试用例和评估指标,以全面评估MLLMs的双臂协调能力。

关键创新:BiManiBench的关键创新在于其分层评估体系,能够将复杂的双臂协调任务分解为多个可控的子任务,从而更精确地诊断MLLMs在不同层面的问题。此外,该基准还特别关注了双臂任务中特有的挑战,例如臂间避碰和时间序列协调,这些在单臂任务中通常被忽略。

关键设计:BiManiBench的设计考虑了多种因素,包括任务的复杂性、评估的全面性以及结果的可解释性。在空间推理层,使用了多种几何形状和物体摆放方式来测试MLLMs的空间理解能力。在高层动作规划层,设计了需要多个步骤才能完成的任务,以评估MLLMs的规划能力。在底层末端执行器控制层,使用了不同的控制策略和误差模型来评估MLLMs的控制精度。

🖼️ 关键图片

📊 实验亮点

对30多个最先进模型的分析表明,尽管MLLMs具有高层推理能力,但在双臂空间定位和控制方面存在困难,经常导致相互干扰和序列错误。这表明当前模型缺乏对相互运动学约束的深刻理解,需要未来研究关注臂间避碰和精细的时间序列。

🎯 应用场景

BiManiBench可应用于评估和提升多模态大语言模型在机器人双臂操作方面的能力,推动具身智能在工业自动化、医疗康复、家庭服务等领域的应用。通过该基准,可以更有效地开发出能够完成复杂双臂任务的智能机器人,例如装配线上的零件组装、手术室中的辅助操作以及家庭环境中的物品整理。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have significantly advanced embodied AI, and using them to benchmark robotic intelligence has become a pivotal trend. However, existing frameworks remain predominantly confined to single-arm manipulation, failing to capture the spatio-temporal coordination required for bimanual tasks like lifting a heavy pot. To address this, we introduce BiManiBench, a hierarchical benchmark evaluating MLLMs across three tiers: fundamental spatial reasoning, high-level action planning, and low-level end-effector control. Our framework isolates unique bimanual challenges, such as arm reachability and kinematic constraints, thereby distinguishing perceptual hallucinations from planning failures. Analysis of over 30 state-of-the-art models reveals that despite high-level reasoning proficiency, MLLMs struggle with dual-arm spatial grounding and control, frequently resulting in mutual interference and sequencing errors. These findings suggest the current paradigm lacks a deep understanding of mutual kinematic constraints, highlighting the need for future research to focus on inter-arm collision-avoidance and fine-grained temporal sequencing.