DexFormer: Cross-Embodied Dexterous Manipulation via History-Conditioned Transformer

作者: Ke Zhang, Lixin Xu, Chengyi Song, Junzhe Xu, Xiaoyi Lin, Zeyu Jiang, Renjing Xu

分类: cs.RO

发布日期: 2026-02-09

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

DexFormer:基于历史条件Transformer的跨具身灵巧操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧操作 跨具身 Transformer 机器人学习 零样本迁移

📋 核心要点

- 现有灵巧操作方法难以应对不同灵巧手之间运动学和动力学的差异,需要为每种手单独训练策略或使用共享动作空间。

- DexFormer利用Transformer结构,通过历史观测推断形态和动力学,从而适应不同的手部配置,生成合适的控制动作。

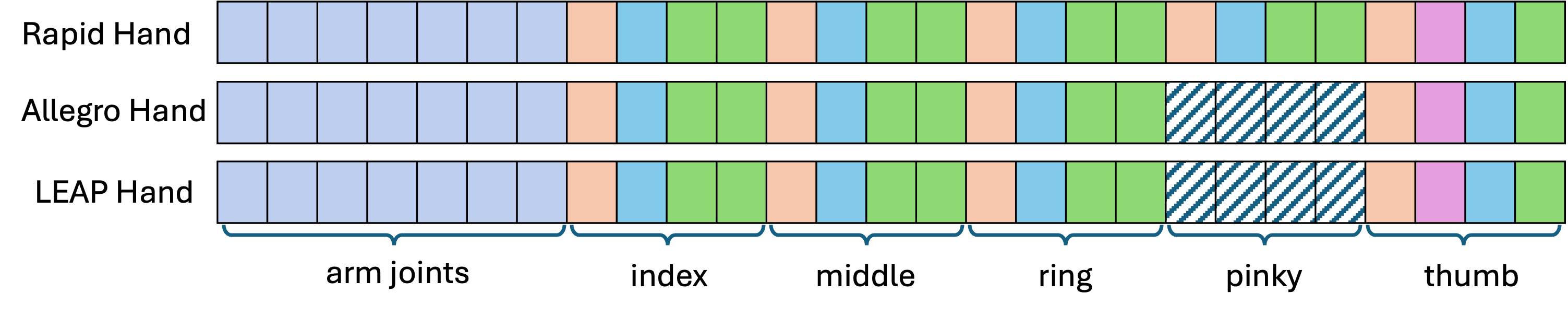

- 实验表明,DexFormer在多种灵巧手上训练后,能够零样本迁移到Leap Hand、Allegro Hand和Rapid Hand等新型灵巧手上。

📝 摘要(中文)

灵巧操作是机器人领域最具挑战性的问题之一,它需要在复杂、富接触的动力学环境下对高自由度手和手臂进行连贯控制。一个主要的障碍是具身可变性:不同的灵巧手表现出不同的运动学和动力学特性,这迫使先前的方法训练单独的策略或依赖于具有每个具身解码器头的共享动作空间。我们提出了DexFormer,这是一个端到端、动力学感知的跨具身策略,它建立在改进的Transformer骨干网络上,该网络以历史观测为条件。通过使用时间上下文来动态推断形态和动力学,DexFormer适应不同的手部配置并产生适合具身的控制动作。DexFormer在各种程序生成的灵巧手资产上进行训练,获得了可泛化的操作先验,并表现出对Leap Hand、Allegro Hand和Rapid Hand的强大零样本迁移能力。我们的结果表明,单个策略可以推广到异构的手部具身,为跨具身灵巧操作建立了一个可扩展的基础。

🔬 方法详解

问题定义:现有灵巧操作方法难以泛化到不同的灵巧手上,因为不同的灵巧手具有不同的运动学和动力学特性。这导致需要为每种灵巧手单独训练策略,或者使用共享动作空间但需要额外的解码器头来适应不同的具身,效率低下且难以扩展。

核心思路:DexFormer的核心思路是利用Transformer模型强大的序列建模能力,通过历史观测来推断当前灵巧手的形态和动力学信息,从而使策略能够自适应不同的具身。通过对历史信息的建模,策略可以学习到一种通用的操作先验,并将其迁移到新的灵巧手上。

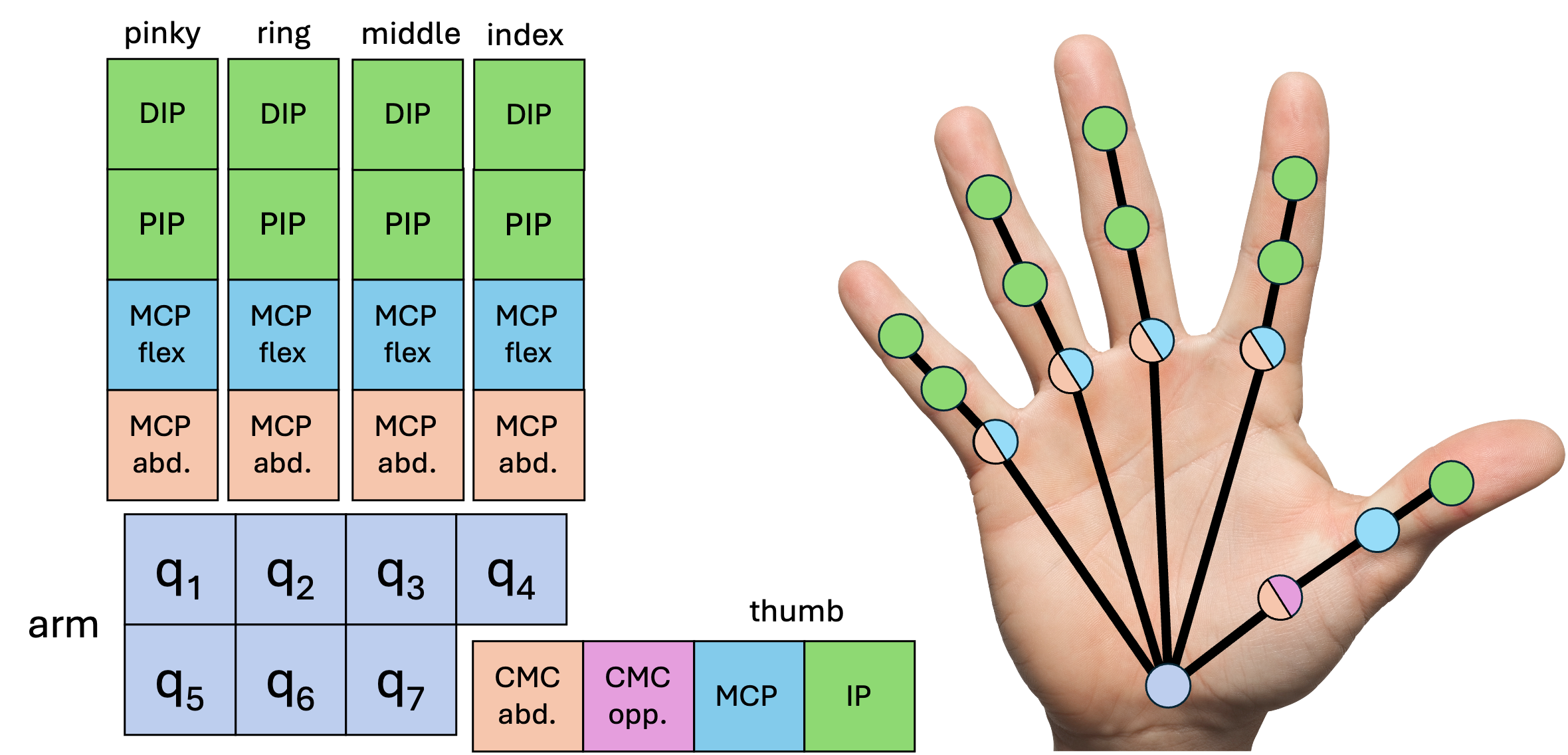

技术框架:DexFormer采用端到端的训练方式,输入是历史观测序列,输出是控制动作。其核心是一个改进的Transformer骨干网络,该网络以历史观测为条件。具体来说,历史观测包括关节角度、末端执行器位置等信息。Transformer网络对这些历史信息进行编码,提取出与当前灵巧手形态和动力学相关的特征,然后解码生成控制动作。

关键创新:DexFormer最重要的技术创新点在于其跨具身泛化能力。与现有方法需要为每种灵巧手单独训练策略不同,DexFormer只需要训练一个策略,就可以泛化到多种不同的灵巧手上。这是通过利用Transformer模型对历史信息的建模能力来实现的,使得策略能够动态地适应不同的具身。

关键设计:DexFormer的关键设计包括:1) 使用Transformer模型作为策略网络,以捕捉历史观测中的时间依赖关系;2) 使用程序生成的数据集进行训练,以增加训练数据的多样性;3) 使用零样本迁移学习来评估策略的泛化能力。具体的网络结构和损失函数等技术细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

DexFormer在多种程序生成的灵巧手上进行训练,并成功地零样本迁移到Leap Hand、Allegro Hand和Rapid Hand等真实灵巧手上。实验结果表明,DexFormer能够有效地适应不同的手部配置,并生成合适的控制动作,从而实现跨具身的灵巧操作。具体的性能数据和对比基线在论文中有详细的展示。

🎯 应用场景

DexFormer的潜在应用领域包括:工业自动化、医疗机器人、家庭服务机器人等。它可以用于控制各种灵巧手执行复杂的操作任务,例如装配、抓取、操作工具等。通过提高灵巧操作的泛化能力,DexFormer可以降低机器人部署的成本,并使其能够适应更加复杂和动态的环境。

📄 摘要(原文)

Dexterous manipulation remains one of the most challenging problems in robotics, requiring coherent control of high-DoF hands and arms under complex, contact-rich dynamics. A major barrier is embodiment variability: different dexterous hands exhibit distinct kinematics and dynamics, forcing prior methods to train separate policies or rely on shared action spaces with per-embodiment decoder heads. We present DexFormer, an end-to-end, dynamics-aware cross-embodiment policy built on a modified transformer backbone that conditions on historical observations. By using temporal context to infer morphology and dynamics on the fly, DexFormer adapts to diverse hand configurations and produces embodiment-appropriate control actions. Trained over a variety of procedurally generated dexterous-hand assets, DexFormer acquires a generalizable manipulation prior and exhibits strong zero-shot transfer to Leap Hand, Allegro Hand, and Rapid Hand. Our results show that a single policy can generalize across heterogeneous hand embodiments, establishing a scalable foundation for cross-embodiment dexterous manipulation. Project website: https://davidlxu.github.io/DexFormer-web/.