Informative Object-centric Next Best View for Object-aware 3D Gaussian Splatting in Cluttered Scenes

作者: Seunghoon Jeong, Eunho Lee, Jeongyun Kim, Ayoung Kim

分类: cs.RO, cs.CV

发布日期: 2026-02-09

备注: 9 pages, 8 figures, 4 tables, accepted to ICRA 2026

💡 一句话要点

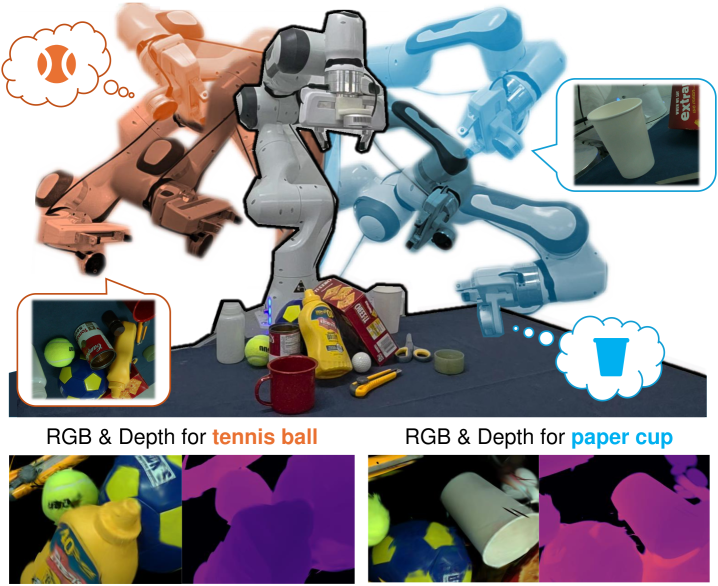

提出一种信息驱动的、面向对象的NBV策略,用于在复杂场景中实现对象感知的3D高斯溅射。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 最佳视点选择 对象感知 场景重建 机器人操作

📋 核心要点

- 现有NBV方法在复杂场景中重建时,仅依赖几何信息,忽略了对象语义,导致探索不足。

- 提出一种实例感知的NBV策略,利用对象特征计算置信度加权的信息增益,指导视点选择。

- 实验表明,该方法在合成和真实数据集上均显著降低了深度误差,并在机器人操作任务中验证了有效性。

📝 摘要(中文)

在复杂场景中,由于不可避免的遮挡和不完整的观测,选择信息量大的视点对于构建可靠的表示至关重要。3D高斯溅射(3DGS)在这方面具有独特的优势,因为它可以显式地指导后续视点的选择,然后利用新的观测来改进表示。然而,现有的方法仅依赖于几何线索,忽略了与操作相关的语义,并且倾向于优先考虑利用而非探索。为了解决这些局限性,我们引入了一种实例感知的最佳视点(NBV)策略,该策略通过利用对象特征来优先考虑未充分探索的区域。具体来说,我们的对象感知3DGS将实例级信息提炼成one-hot对象向量,用于计算置信度加权的信息增益,从而指导识别与错误和不确定高斯相关联的区域。此外,我们的方法可以很容易地适应于以对象为中心的NBV,从而将视点选择集中在目标对象上,从而提高重建对对象放置的鲁棒性。实验表明,与基线相比,我们的NBV策略在合成数据集上的深度误差降低了高达77.14%,在真实世界的GraspNet数据集上的深度误差降低了34.10%。此外,与针对整个场景相比,对特定对象执行NBV可以使该对象的深度误差额外降低25.60%。我们通过真实的机器人操作任务进一步验证了我们方法的有效性。

🔬 方法详解

问题定义:现有基于3DGS的场景重建方法在复杂场景中面临遮挡和观测不完整的问题,传统的NBV策略仅依赖几何信息,忽略了场景中对象的语义信息,导致对场景的探索不足,重建质量受限。尤其是在机器人操作等任务中,对特定对象的精确重建至关重要,而现有方法难以针对特定对象进行优化。

核心思路:本文的核心思路是引入对象感知的NBV策略,将场景中的对象信息融入到视点选择过程中。通过识别场景中未充分探索或重建质量较差的对象区域,引导相机选择更有利于这些区域重建的视点。这种方法旨在提高重建的完整性和准确性,尤其是在对象层面。

技术框架:该方法基于3DGS框架,主要包含以下几个模块:1) 对象信息提取模块:将场景中的对象实例信息编码为one-hot向量。2) 信息增益计算模块:利用对象向量和3DGS的参数(如不确定性)计算置信度加权的信息增益,用于评估不同视点的价值。3) 视点选择模块:根据信息增益选择下一个最佳视点。4) 3DGS优化模块:利用新的观测数据优化3DGS模型。

关键创新:该方法最重要的创新在于将对象信息融入到NBV策略中,实现了对象感知的视点选择。与传统的基于几何信息的NBV方法相比,该方法能够更有效地探索场景中未充分观测的对象区域,提高重建的完整性和准确性。此外,该方法还支持以对象为中心的NBV,可以针对特定对象进行优化。

关键设计:关键设计包括:1) 使用one-hot向量表示对象信息,方便计算信息增益。2) 设计置信度加权的信息增益函数,平衡探索和利用。3) 实现对象为中心的NBV,允许用户指定目标对象,并优化该对象的重建质量。损失函数方面,除了传统的渲染损失外,可能还引入了与对象相关的损失项,以进一步提高对象重建的准确性。具体的网络结构未知,但可以推测使用了某种形式的神经网络来估计信息增益。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成数据集上深度误差降低了高达77.14%,在真实世界的GraspNet数据集上深度误差降低了34.10%,相较于基线方法有显著提升。此外,针对特定对象进行NBV,可以使该对象的深度误差额外降低25.60%,验证了对象中心NBV的有效性。真实机器人操作实验也验证了该方法在实际应用中的可行性。

🎯 应用场景

该研究成果可应用于机器人操作、场景重建、增强现实等领域。例如,在机器人操作中,可以利用该方法提高机器人对目标对象的感知能力,从而实现更精确的抓取和操作。在场景重建中,可以生成更完整、更准确的3D模型。在增强现实中,可以提供更逼真的虚拟对象交互体验。

📄 摘要(原文)

In cluttered scenes with inevitable occlusions and incomplete observations, selecting informative viewpoints is essential for building a reliable representation. In this context, 3D Gaussian Splatting (3DGS) offers a distinct advantage, as it can explicitly guide the selection of subsequent viewpoints and then refine the representation with new observations. However, existing approaches rely solely on geometric cues, neglect manipulation-relevant semantics, and tend to prioritize exploitation over exploration. To tackle these limitations, we introduce an instance-aware Next Best View (NBV) policy that prioritizes underexplored regions by leveraging object features. Specifically, our object-aware 3DGS distills instancelevel information into one-hot object vectors, which are used to compute confidence-weighted information gain that guides the identification of regions associated with erroneous and uncertain Gaussians. Furthermore, our method can be easily adapted to an object-centric NBV, which focuses view selection on a target object, thereby improving reconstruction robustness to object placement. Experiments demonstrate that our NBV policy reduces depth error by up to 77.14% on the synthetic dataset and 34.10% on the real-world GraspNet dataset compared to baselines. Moreover, compared to targeting the entire scene, performing NBV on a specific object yields an additional reduction of 25.60% in depth error for that object. We further validate the effectiveness of our approach through real-world robotic manipulation tasks.