Aerial Manipulation with Contact-Aware Onboard Perception and Hybrid Control

作者: Yuanzhu Zhan, Yufei Jiang, Muqing Cao, Junyi Geng

分类: cs.RO

发布日期: 2026-02-09

备注: 9 pages, 7 figures. Accepted by ICRA 2026

💡 一句话要点

提出一种基于板载感知和混合控制的空中操作方法,用于接触式任务。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion) 支柱八:物理动画 (Physics-based Animation)

关键词: 空中操作 视觉惯性里程计 视觉伺服 力控制 无人机

📋 核心要点

- 现有空中操作方法依赖外部运动捕捉系统,限制了其在实际环境中的部署能力,且主要采用位置控制,难以实现精确的接触控制。

- 该论文提出了一种完全基于板载感知和混合控制的空中操作方案,通过增强的VIO和图像视觉伺服,实现了精确的运动跟踪和稳定的接触力控制。

- 实验结果表明,该方法在接触时速度估计精度提升了66.01%,并实现了可靠的目标接近和稳定的力保持,验证了其有效性。

📝 摘要(中文)

空中操作(AM)有望将无人机(UAV)的应用从被动检查扩展到抓取、组装和原位维护等接触式任务。目前多数空中操作演示依赖于外部运动捕捉(MoCap)系统,并侧重于位置控制以进行粗略交互,限制了其部署能力。本文提出了一种完全基于板载感知控制的接触式空中操作流程,无需MoCap即可实现精确的运动跟踪和受控的接触力。该流程主要包含:(1)增强的视觉惯性里程计(VIO),具有仅在交互期间激活的接触一致性因子,从而收紧接触框架周围的不确定性并减少漂移;(2)基于图像的视觉伺服(IBVS),以减轻感知-控制耦合,以及混合力-运动控制器,用于调节接触力和横向运动,以实现稳定的接触。实验表明,该方法仅使用板载传感器即可闭环感知到力,在接触时速度估计提高了66.01%,实现了可靠的目标接近和稳定的力保持,为可部署的、野外空中操作奠定了基础。

🔬 方法详解

问题定义:现有空中操作系统依赖于外部运动捕捉系统,这限制了其在真实环境中的部署。此外,现有方法主要关注位置控制,难以实现精确的接触力控制,从而限制了其在复杂接触任务中的应用。因此,需要一种能够仅使用板载传感器实现精确运动跟踪和稳定接触力控制的空中操作方法。

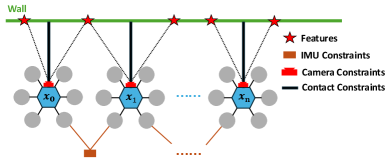

核心思路:该论文的核心思路是利用板载传感器,通过增强的视觉惯性里程计(VIO)和图像视觉伺服(IBVS)来实现精确的运动跟踪和稳定的接触力控制。VIO通过引入接触一致性因子来减小接触过程中的漂移,IBVS则用于减轻感知-控制耦合,从而提高系统的鲁棒性。混合力-运动控制器则用于调节接触力和横向运动,以实现稳定的接触。

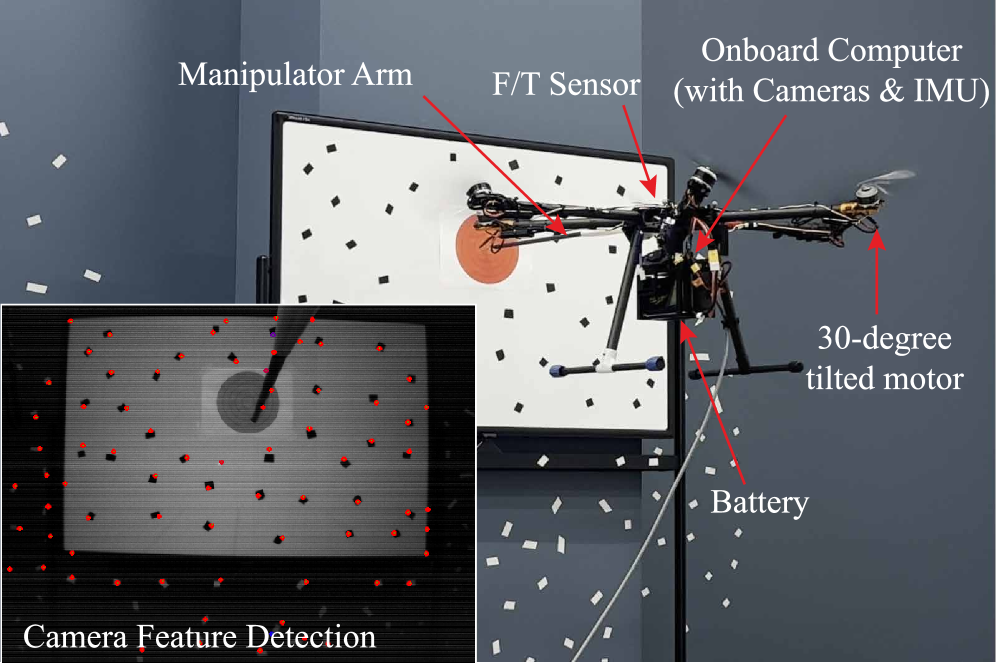

技术框架:该系统的整体框架包括以下几个主要模块:1) 增强的视觉惯性里程计(VIO):用于估计无人机的位姿和速度。2) 图像视觉伺服(IBVS):用于控制无人机接近目标并保持稳定的接触。3) 混合力-运动控制器:用于调节接触力和横向运动。整个流程是从板载相机和IMU获取数据,通过VIO估计位姿,然后利用IBVS和混合力-运动控制器实现精确的接触和力控制。

关键创新:该论文的关键创新在于以下几个方面:1) 提出了接触一致性因子,用于增强VIO在接触过程中的精度。2) 采用图像视觉伺服(IBVS)来减轻感知-控制耦合。3) 设计了混合力-运动控制器,用于调节接触力和横向运动,以实现稳定的接触。这些创新使得该系统能够仅使用板载传感器实现精确的运动跟踪和稳定的接触力控制。

关键设计:接触一致性因子被添加到VIO的优化问题中,只有在检测到接触时才会激活。IBVS使用图像特征作为控制输入,避免了直接使用位姿估计值带来的误差累积。混合力-运动控制器采用阻抗控制策略,根据接触力和位姿误差来调节无人机的控制输入。具体的参数设置包括VIO的噪声模型、IBVS的增益参数以及混合力-运动控制器的阻抗参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在接触时速度估计精度提升了66.01%,证明了接触一致性因子在减小漂移方面的有效性。此外,该方法还实现了可靠的目标接近和稳定的力保持,验证了IBVS和混合力-运动控制器在接触控制方面的性能。这些结果表明,该方法能够仅使用板载传感器实现精确的运动跟踪和稳定的接触力控制。

🎯 应用场景

该研究成果可应用于多种领域,如桥梁、高压电线等基础设施的检测与维护,以及危险环境下的物体抓取和操作。该技术能够提升无人机在复杂环境下的自主作业能力,降低人工成本和安全风险,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Aerial manipulation (AM) promises to move Unmanned Aerial Vehicles (UAVs) beyond passive inspection to contact-rich tasks such as grasping, assembly, and in-situ maintenance. Most prior AM demonstrations rely on external motion capture (MoCap) and emphasize position control for coarse interactions, limiting deployability. We present a fully onboard perception-control pipeline for contact-rich AM that achieves accurate motion tracking and regulated contact wrenches without MoCap. The main components are (1) an augmented visual-inertial odometry (VIO) estimator with contact-consistency factors that activate only during interaction, tightening uncertainty around the contact frame and reducing drift, and (2) image-based visual servoing (IBVS) to mitigate perception-control coupling, together with a hybrid force-motion controller that regulates contact wrenches and lateral motion for stable contact. Experiments show that our approach closes the perception-to-wrench loop using only onboard sensing, yielding an velocity estimation improvement of 66.01% at contact, reliable target approach, and stable force holding-pointing toward deployable, in-the-wild aerial manipulation.