VividFace: Real-Time and Realistic Facial Expression Shadowing for Humanoid Robots

作者: Peizhen Li, Longbing Cao, Xiao-Ming Wu, Yang Zhang

分类: cs.RO, cs.AI, cs.HC

发布日期: 2026-02-07 (更新: 2026-02-14)

备注: Accepted to the 2026 IEEE International Conference on Robotics and Automation (ICRA)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

VividFace:面向人型机器人的实时逼真面部表情模仿系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 人型机器人 面部表情模仿 实时系统 人机交互 特征自适应 X2CNet++

📋 核心要点

- 现有的人型机器人面部表情模仿方法难以兼顾实时性和表情的细致程度,主要受限于离线推理和对细微表情捕捉能力的不足。

- VividFace的核心在于优化了人脸模仿框架X2CNet++,通过微调面部运动传递模块和引入特征自适应训练,提升了表情的表达能力。

- VividFace实现了0.05秒内的面部表情模仿,并具备良好的泛化能力,真实场景的演示验证了其有效性。

📝 摘要(中文)

本文提出VividFace,一个面向人型机器人的实时逼真面部表情模仿系统。现有的人型机器人面部表情模仿技术存在局限性,通常难以同时实现实时性和逼真的表达效果,这是由于离线的基于视频的推理设计以及捕捉和传递细微表情细节的能力不足所致。为了解决这些限制,VividFace通过优化的模仿框架X2CNet++来增强表达能力,该框架通过微调人到人型机器人的面部运动传递模块,并引入特征自适应训练策略,以更好地对齐不同图像源。通过兼容视频流的推理管道和基于异步I/O的精简工作流程,实现设备间的高效通信,进一步实现了实时阴影效果。VividFace能够在0.05秒内模仿人类面部表情,从而产生生动的人型机器人面部,同时泛化到不同的面部配置。大量的真实世界演示验证了其使用的价值。

🔬 方法详解

问题定义:论文旨在解决人型机器人面部表情模仿中实时性和逼真度难以兼顾的问题。现有方法通常依赖离线视频处理,无法满足实时性需求,并且在捕捉和传递细微的面部表情细节方面存在不足,导致机器人面部表情僵硬、不自然。

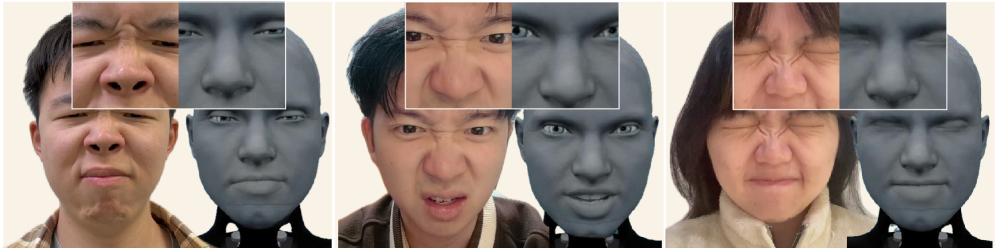

核心思路:论文的核心思路是通过优化人脸模仿框架,使其能够实时捕捉人类的面部表情,并将其精确地传递到人型机器人上。通过特征自适应训练,解决不同图像源(人类面部图像和机器人面部图像)之间的差异,从而提高表情传递的准确性和逼真度。

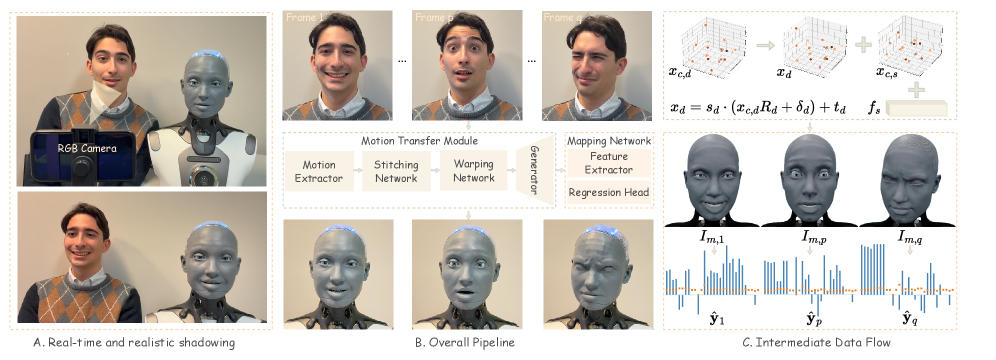

技术框架:VividFace系统包含一个优化的模仿框架X2CNet++,以及一个兼容视频流的推理管道。X2CNet++负责面部运动的传递和表情的生成,推理管道负责实时处理视频流数据。系统采用异步I/O进行设备间通信,以提高效率。整体流程是从视频流中提取人类面部表情,然后通过X2CNet++将其转换为机器人面部表情,最后驱动机器人做出相应的表情。

关键创新:该论文的关键创新在于X2CNet++框架的优化和特征自适应训练策略。X2CNet++通过微调人到人型机器人的面部运动传递模块,提高了表情传递的准确性。特征自适应训练策略则通过对齐不同图像源的特征,解决了人类面部图像和机器人面部图像之间的差异,从而提高了表情的逼真度。此外,实时视频流处理和异步I/O也保证了系统的实时性。

关键设计:X2CNet++框架的具体网络结构未知,但可以推测其可能包含编码器-解码器结构,用于提取和生成面部表情特征。特征自适应训练策略的具体实现方式未知,但可能涉及到对抗训练或域适应技术,以减小不同图像源之间的特征差异。异步I/O的具体实现方式也未知,但其目的是为了提高设备间通信的效率,避免阻塞。

🖼️ 关键图片

📊 实验亮点

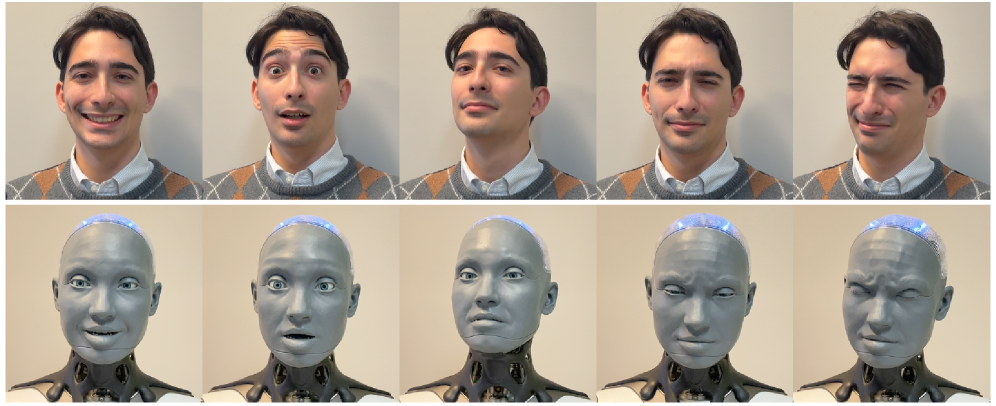

VividFace系统能够在0.05秒内完成面部表情模仿,实现了实时性。通过X2CNet++框架的优化和特征自适应训练策略,显著提高了表情的逼真度,使得机器人能够更准确、更自然地模仿人类的面部表情。真实场景的演示验证了VividFace的实用性和有效性,表明其在人机交互领域具有广阔的应用前景。

🎯 应用场景

VividFace技术可广泛应用于人机交互领域,例如情感陪护机器人、虚拟助手、远程教育等。通过赋予机器人更生动、更自然的表情,可以显著提升用户体验,增强人机之间的情感连接。此外,该技术还可应用于机器人表演、娱乐等领域,创造更具吸引力的机器人形象。未来,随着机器人技术的不断发展,VividFace有望成为人机交互的重要组成部分。

📄 摘要(原文)

Humanoid facial expression shadowing enables robots to realistically imitate human facial expressions in real time, which is critical for lifelike, facially expressive humanoid robots and affective human-robot interaction. Existing progress in humanoid facial expression imitation remains limited, often failing to achieve either real-time performance or realistic expressiveness due to offline video-based inference designs and insufficient ability to capture and transfer subtle expression details. To address these limitations, we present VividFace, a real-time and realistic facial expression shadowing system for humanoid robots. An optimized imitation framework X2CNet++ enhances expressiveness by fine-tuning the human-to-humanoid facial motion transfer module and introducing a feature-adaptation training strategy for better alignment across different image sources. Real-time shadowing is further enabled by a video-stream-compatible inference pipeline and a streamlined workflow based on asynchronous I/O for efficient communication across devices. VividFace produces vivid humanoid faces by mimicking human facial expressions within 0.05 seconds, while generalizing across diverse facial configurations. Extensive real-world demonstrations validate its practical utility. Videos are available at: https://lipzh5.github.io/VividFace/.