TextOp: Real-time Interactive Text-Driven Humanoid Robot Motion Generation and Control

作者: Weiji Xie, Jiakun Zheng, Jinrui Han, Jiyuan Shi, Weinan Zhang, Chenjia Bai, Xuelong Li

分类: cs.RO, cs.AI

发布日期: 2026-02-07

备注: Project Page: https://text-op.github.io/

💡 一句话要点

TextOp:实时交互式文本驱动的人形机器人运动生成与控制框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人形机器人 运动生成 文本驱动 实时控制 运动扩散模型

📋 核心要点

- 现有机器人控制器受限于预定义轨迹或持续人工遥控,缺乏灵活性和自主性。

- TextOp通过高层运动扩散模型生成轨迹,低层策略控制机器人,实现文本指令驱动的实时交互。

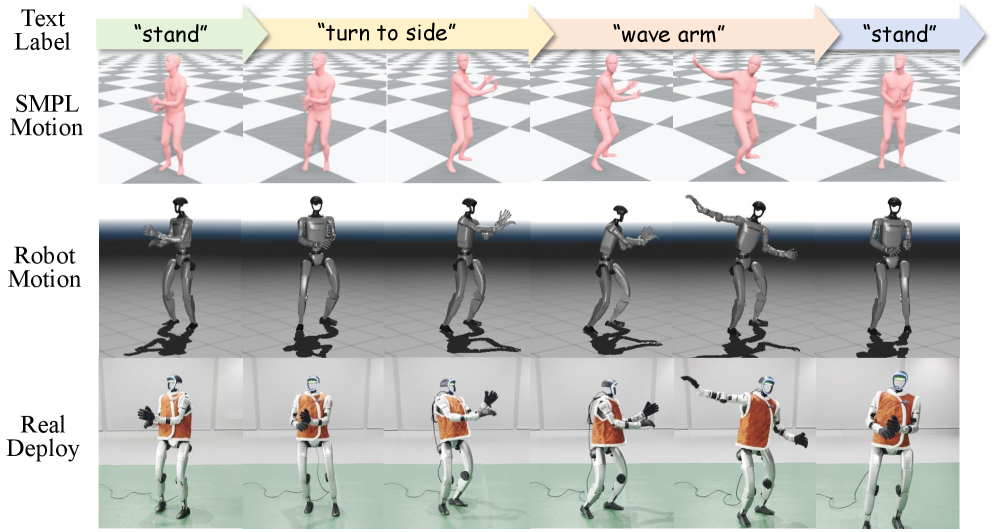

- 实验表明TextOp能使机器人流畅执行舞蹈、跳跃等复杂动作,并具备即时响应和精确控制能力。

📝 摘要(中文)

本文提出TextOp,一个实时的文本驱动人形机器人运动生成与控制框架,支持流式语言指令和执行过程中的指令修改。TextOp采用双层架构,高层自回归运动扩散模型根据当前文本输入连续生成短时程运动轨迹,低层运动跟踪策略在物理人形机器人上执行这些轨迹。通过桥接交互式运动生成与鲁棒的全身控制,TextOp解锁了自由形式的意图表达,并实现了在单个连续运动执行中跨越多个挑战性行为(如跳舞和跳跃)的平滑过渡。大量的真实机器人实验和离线评估证明了其即时响应性、平滑的全身运动和精确的控制。

🔬 方法详解

问题定义:现有的人形机器人控制方法主要依赖于预定义的运动轨迹或连续的人工遥操作。预定义轨迹缺乏灵活性,难以适应用户意图的改变;人工遥操作则需要持续的人工干预,限制了机器人的自主性。因此,如何以实时交互的方式驱动通用的人形机器人控制器是一个亟待解决的问题。

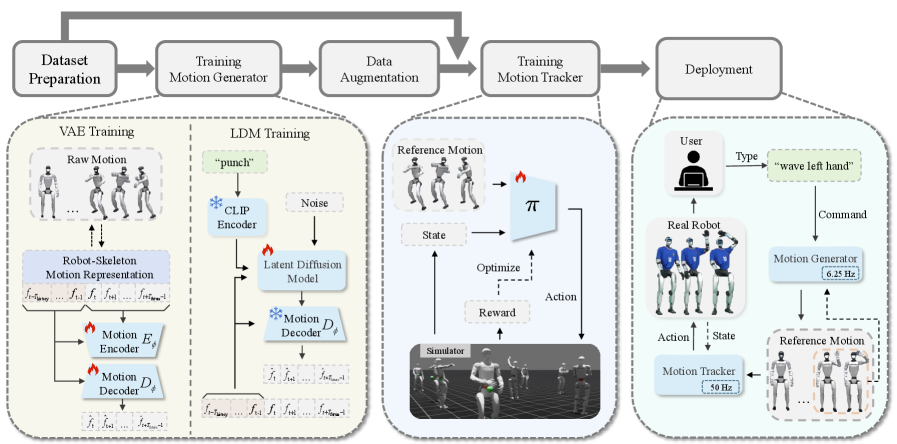

核心思路:TextOp的核心思路是将运动生成和运动控制解耦,采用一个双层架构。高层使用运动扩散模型根据文本指令生成短时程的运动轨迹,低层使用运动跟踪策略在真实的机器人上执行这些轨迹。这种解耦使得系统能够实时响应用户的文本指令,并实现平滑的运动过渡。

技术框架:TextOp框架包含两个主要模块:高层运动生成模块和低层运动控制模块。高层运动生成模块使用自回归运动扩散模型,该模型以文本指令为条件,连续生成短时程的运动轨迹。低层运动控制模块则负责将这些轨迹转化为机器人的关节控制指令,并在真实的机器人上执行。框架支持流式语言指令输入,允许用户在机器人运动过程中修改指令。

关键创新:TextOp的关键创新在于将交互式运动生成与鲁棒的全身控制相结合。传统的运动生成方法通常是离线的,难以适应实时的用户交互。TextOp通过使用运动扩散模型和运动跟踪策略,实现了实时的文本驱动运动生成和控制。此外,TextOp还支持在运动过程中修改指令,进一步增强了系统的交互性。

关键设计:高层运动扩散模型采用自回归结构,能够根据历史运动状态和当前文本指令预测未来的运动轨迹。低层运动跟踪策略使用强化学习进行训练,能够鲁棒地跟踪高层生成的运动轨迹。损失函数包括运动学损失、动力学损失和平衡损失,以保证机器人运动的自然性和稳定性。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

TextOp在真实机器人平台上进行了大量实验,结果表明该系统能够实时响应用户的文本指令,并生成平滑、自然的全身运动。实验还验证了TextOp在执行舞蹈、跳跃等复杂动作时的鲁棒性和精确性。项目主页提供了实验视频和开源代码,方便研究人员复现和进一步研究。

🎯 应用场景

TextOp具有广泛的应用前景,例如人机协作、远程操作、娱乐和教育等领域。在人机协作中,用户可以通过简单的文本指令指导机器人完成复杂的任务。在远程操作中,操作员可以通过语音或文本控制远端的机器人,而无需进行精确的手动控制。在娱乐和教育领域,TextOp可以用于开发各种交互式的机器人应用,例如舞蹈机器人、导游机器人等。

📄 摘要(原文)

Recent advances in humanoid whole-body motion tracking have enabled the execution of diverse and highly coordinated motions on real hardware. However, existing controllers are commonly driven either by predefined motion trajectories, which offer limited flexibility when user intent changes, or by continuous human teleoperation, which requires constant human involvement and limits autonomy. This work addresses the problem of how to drive a universal humanoid controller in a real-time and interactive manner. We present TextOp, a real-time text-driven humanoid motion generation and control framework that supports streaming language commands and on-the-fly instruction modification during execution. TextOp adopts a two-level architecture in which a high-level autoregressive motion diffusion model continuously generates short-horizon kinematic trajectories conditioned on the current text input, while a low-level motion tracking policy executes these trajectories on a physical humanoid robot. By bridging interactive motion generation with robust whole-body control, TextOp unlocks free-form intent expression and enables smooth transitions across multiple challenging behaviors such as dancing and jumping, within a single continuous motion execution. Extensive real-robot experiments and offline evaluations demonstrate instant responsiveness, smooth whole-body motion, and precise control. The project page and the open-source code are available at https://text-op.github.io/