Going with the Flow: Koopman Behavioral Models as Implicit Planners for Visuo-Motor Dexterity

作者: Yunhai Han, Linhao Bai, Ziyu Xiao, Zhaodong Yang, Yogita Choudhary, Krishna Jha, Chuizheng Kong, Shreyas Kousik, Harish Ravichandar

分类: cs.RO

发布日期: 2026-02-07 (更新: 2026-02-10)

备注: Codes can be found at https://github.com/GT-STAR-Lab/K-UBM/

💡 一句话要点

提出基于Koopman行为模型的统一行为模型(UBM),用于灵巧操作中的隐式规划。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 灵巧操作 Koopman算子 行为模型 隐式规划 视觉伺服

📋 核心要点

- 现有基于扩散模型和Transformer的策略需要大量数据和计算资源,且在灵巧操作中可靠性不足。

- 论文提出统一行为模型(UBM),将技能表示为耦合动力系统,捕捉视觉流和动作流的协同演化,保证时间连贯性。

- 实验表明,Koopman-UBM在多个任务中性能与SOTA基线相当或更好,并具有推理速度快、鲁棒性强等优点。

📝 摘要(中文)

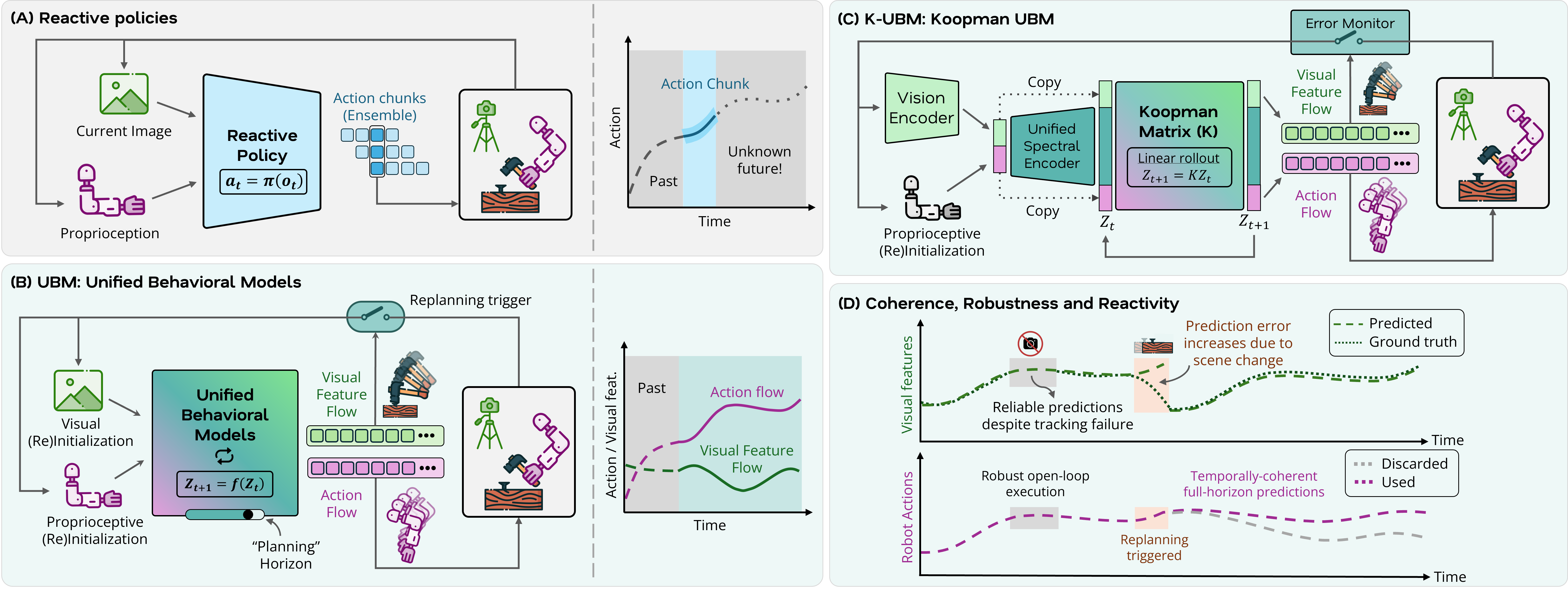

本文提出统一行为模型(UBM),该框架将灵巧操作技能表示为耦合的动力系统,捕捉环境的视觉特征(视觉流)和机器人的本体感受状态(动作流)如何协同演化。通过捕捉这种行为动态,UBM从设计上确保了时间连贯性,而不是通过启发式平均。论文提出了Koopman-UBM,它是UBM的第一个实例,利用Koopman算子理论有效地学习统一表示,其中潜在视觉和本体感受特征的联合流由结构化的线性系统控制。Koopman-UBM可以被视为一个隐式规划器:给定初始条件,它计算整个技能范围内期望的机器人行为以及由此产生的视觉特征流。为了实现反应性,论文引入了一种在线重规划策略,其中模型充当其自身的运行时监控器,当预测的和观察到的视觉流发散时自动触发重规划。在七个模拟任务和两个真实世界任务中,K-UBM的性能与SOTA基线相匹配或超过,同时提供更快的推理、平滑的执行、对遮挡的鲁棒性和灵活的重规划。

🔬 方法详解

问题定义:现有基于示教学习的灵巧操作方法,依赖于反应式映射和固定时间范围的动作分块,导致时间连贯性和反应性之间的权衡。尤其是在多指灵巧操作中,需要解决数据需求高、计算资源消耗大、鲁棒性不足等问题。

核心思路:论文的核心思路是将灵巧操作技能建模为视觉流和动作流的耦合动力系统。通过学习这种行为动态,模型能够自然地保证时间连贯性,避免了传统方法中通过启发式平均来平滑动作的需要。利用Koopman算子理论,将非线性动力系统线性化,从而简化了学习和控制过程。

技术框架:Koopman-UBM框架包含以下主要模块:1) 特征提取器:从视觉输入和机器人状态中提取潜在特征。2) Koopman算子学习器:学习一个线性算子,用于预测潜在特征的演化。3) 隐式规划器:基于Koopman算子,根据初始状态预测整个技能范围内的视觉流和动作流。4) 在线重规划模块:监控预测的视觉流和实际观察到的视觉流之间的差异,并在差异超过阈值时触发重规划。

关键创新:最重要的技术创新点在于将Koopman算子理论应用于灵巧操作技能的学习,从而将复杂的非线性动力系统转化为线性系统。这种线性化使得模型能够更有效地学习和预测技能的演化,并实现隐式规划。与现有方法相比,Koopman-UBM不需要显式地规划动作序列,而是通过预测视觉流来引导机器人的行为。

关键设计:Koopman-UBM的关键设计包括:1) 使用深度神经网络作为特征提取器,从视觉输入和机器人状态中提取有意义的潜在特征。2) 使用线性回归或类似方法学习Koopman算子,最小化预测的潜在特征和实际潜在特征之间的差异。3) 定义一个合适的视觉流差异度量,用于触发在线重规划。4) 损失函数通常包含预测误差和正则化项,以防止过拟合。

🖼️ 关键图片

📊 实验亮点

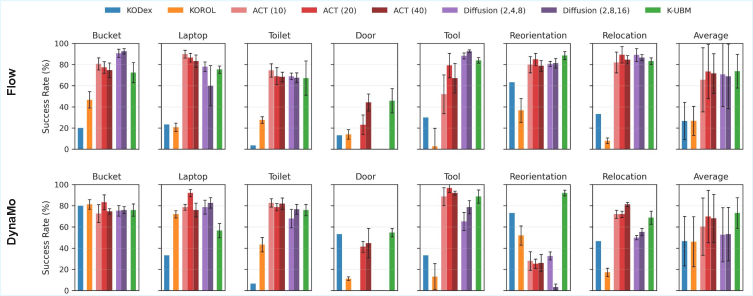

实验结果表明,Koopman-UBM在七个模拟任务和两个真实世界任务中,性能与SOTA基线相匹配或超过。例如,在遮挡条件下,Koopman-UBM表现出更强的鲁棒性,能够成功完成任务,而其他方法则失败。此外,Koopman-UBM的推理速度更快,执行过程更平滑,并支持灵活的重规划。

🎯 应用场景

该研究成果可应用于各种需要灵巧操作的机器人任务,例如:工业自动化中的装配、医疗手术中的微创操作、家庭服务机器人中的物品抓取等。通过提高机器人的操作精度、鲁棒性和适应性,可以显著提升这些应用场景的效率和安全性,并有望推动机器人技术在更广泛领域的应用。

📄 摘要(原文)

There has been rapid and dramatic progress in learning complex visuo-motor manipulation skills from demonstrations, thanks in part to expressive policy classes that employ diffusion- and transformer-based backbones. However, these design choices require significant data and computational resources and remain far from reliable, particularly within the context of multi-fingered dexterous manipulation. Fundamentally, they model skills as reactive mappings and rely on fixed-horizon action chunking to mitigate jitter, creating a rigid trade-off between temporal coherence and reactivity. In this work, we introduce Unified Behavioral Models (UBMs), a framework that learns to represent dexterous skills as coupled dynamical systems that capture how visual features of the environment (visual flow) and proprioceptive states of the robot (action flow) co-evolve. By capturing such behavioral dynamics, UBMs can ensure temporal coherence by construction rather than by heuristic averaging. To operationalize these models, we propose Koopman-UBM, a first instantiation of UBMs that leverages Koopman Operator theory to effectively learn a unified representation in which the joint flow of latent visual and proprioceptive features is governed by a structured linear system. We demonstrate that Koopman-UBM can be viewed as an implicit planner: given an initial condition, it computes the desired robot behavior with the resulting flow of visual features over the entire skill horizon. To enable reactivity, we introduce an online replanning strategy in which the model acts as its own runtime monitor that automatically triggers replanning when predicted and observed visual flow diverge. Across seven simulated and two real-world tasks, we demonstrate that K-UBM matches or exceeds the performance of SOTA baselines, while offering faster inference, smooth execution, robustness to occlusions, and flexible replanning.