Why Look at It at All?: Vision-Free Multifingered Blind Grasping Using Uniaxial Fingertip Force Sensing

作者: Edgar Lee, Junho Choi, Taemin Kim, Changjoo Nam, Seokhwan Jeong

分类: cs.RO, eess.SY

发布日期: 2026-02-07

备注: Submitted to Journal (under review)

💡 一句话要点

提出一种仅依赖单轴指尖力感知的无视觉多指盲抓取方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人抓取 盲抓取 力感知 师生学习 强化学习 Transformer网络 有限感知 无视觉

📋 核心要点

- 现有机器人抓取依赖视觉或高精度触觉,成本高、易损坏、集成复杂,限制了实际应用。

- 提出一种仅使用单轴指尖力反馈和关节角度信息的盲抓取方法,降低了传感需求。

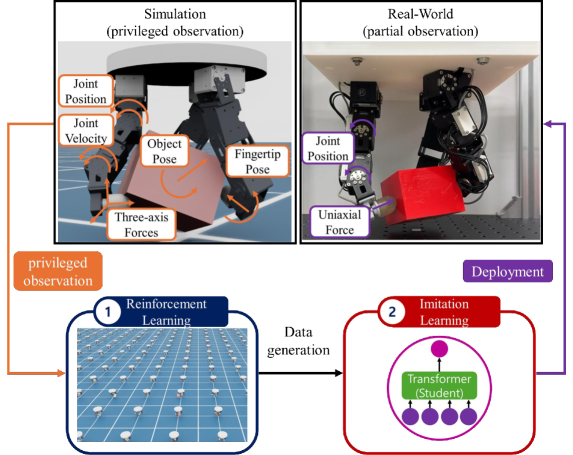

- 采用师生学习框架,教师在模拟环境中学习,学生在真实环境中仅使用有限的传感器进行学习,实现泛化。

📝 摘要(中文)

在现实世界的机器人操作中,有限的感知能力仍然是一个根本性的挑战,因为视觉和高分辨率触觉传感器通常会引入成本、脆弱性和集成复杂性。本文展示了,仅依靠单轴指尖力反馈和关节本体感受,无需视觉或多轴/触觉传感,即可实现可靠的多指抓取。为了实现这种盲抓取,我们采用了一种高效的师生训练流程,其中强化学习的教师利用特权模拟观测来生成演示,用于提炼一个基于Transformer的学生策略,该策略在部分观测下运行。学生策略被训练为仅使用真实部署中可用的传感方式进行操作。我们在真实硬件上对18个对象(包括分布内和分布外的情况)验证了所提出的方法,实现了98.3%的总体抓取成功率。这些结果表明,该方法具有很强的鲁棒性和对模拟训练分布之外的泛化能力,同时显著降低了真实世界抓取系统的传感要求。

🔬 方法详解

问题定义:论文旨在解决在极少传感信息下,如何实现鲁棒的多指抓取问题。现有方法通常依赖视觉或高分辨率触觉传感器,这些传感器成本高昂、易损坏,且集成复杂,限制了机器人在资源受限或恶劣环境中的应用。因此,如何在仅有指尖力反馈和关节角度信息的情况下,实现可靠的抓取是一个重要的挑战。

核心思路:论文的核心思路是利用师生学习框架,在模拟环境中训练一个具有特权信息的教师策略,然后将该策略的知识迁移到一个仅使用有限传感信息的学生策略。通过这种方式,学生策略可以学习到如何在缺乏视觉或高分辨率触觉信息的情况下,仅凭指尖力反馈和关节角度信息进行有效的抓取。

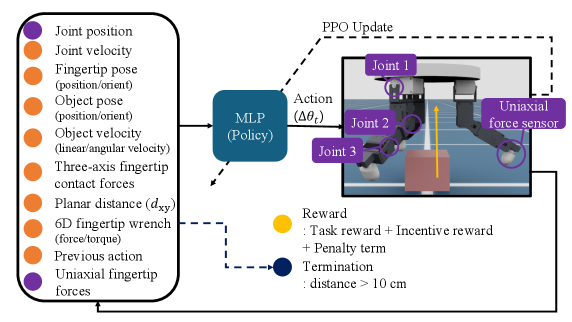

技术框架:整体框架包含两个主要阶段:教师策略训练和学生策略训练。首先,在模拟环境中,使用强化学习训练一个教师策略,该策略可以访问包括物体姿态、速度等特权信息。然后,利用教师策略生成抓取演示数据。接下来,使用这些演示数据训练一个学生策略,该策略只能访问指尖力反馈和关节角度信息。学生策略采用Transformer网络结构,用于处理时序信息,并预测关节控制指令。

关键创新:该论文的关键创新在于提出了一种仅依赖单轴指尖力反馈的盲抓取方法,并成功地在真实机器人上进行了验证。与现有方法相比,该方法显著降低了传感需求,提高了系统的鲁棒性和泛化能力。此外,利用师生学习框架,有效地将模拟环境中的知识迁移到真实环境中,克服了模拟到真实的差距。

关键设计:教师策略使用PPO算法进行训练,奖励函数设计鼓励成功抓取和减少能量消耗。学生策略采用Transformer网络结构,输入为指尖力反馈和关节角度信息,输出为关节控制指令。损失函数包括模仿学习损失和正则化项,用于约束关节运动。在真实机器人实验中,使用了18个不同的物体,包括分布内和分布外的情况,以评估算法的泛化能力。

🖼️ 关键图片

📊 实验亮点

在真实硬件实验中,该方法在18个物体上实现了98.3%的总体抓取成功率,包括分布内和分布外的情况。这表明该方法具有很强的鲁棒性和对模拟训练分布之外的泛化能力。与依赖视觉或高分辨率触觉传感器的方法相比,该方法显著降低了传感需求,同时保持了较高的抓取性能。

🎯 应用场景

该研究成果可应用于资源受限或恶劣环境下的机器人操作,例如太空探索、水下作业、灾难救援等。在这些场景中,视觉传感器可能失效或受到限制,而该方法仅依赖于简单的力传感器,具有更高的可靠性和适应性。此外,该方法还可以降低机器人抓取系统的成本和复杂性,促进机器人在更多领域的应用。

📄 摘要(原文)

Grasping under limited sensing remains a fundamental challenge for real-world robotic manipulation, as vision and high-resolution tactile sensors often introduce cost, fragility, and integration complexity. This work demonstrates that reliable multifingered grasping can be achieved under extremely minimal sensing by relying solely on uniaxial fingertip force feedback and joint proprioception, without vision or multi-axis/tactile sensing. To enable such blind grasping, we employ an efficient teacher-student training pipeline in which a reinforcement-learned teacher exploits privileged simulation-only observations to generate demonstrations for distilling a transformer-based student policy operating under partial observation. The student policy is trained to act using only sensing modalities available at real-world deployment. We validate the proposed approach on real hardware across 18 objects, including both in-distribution and out-of-distribution cases, achieving a 98.3~$\%$ overall grasp success rate. These results demonstrate strong robustness and generalization beyond the simulation training distribution, while significantly reducing sensing requirements for real-world grasping systems.