Strategizing at Speed: A Learned Model Predictive Game for Multi-Agent Drone Racing

作者: Andrei-Carlo Papuc, Lasse Peters, Sihao Sun, Laura Ferranti, Javier Alonso-Mora

分类: cs.RO, cs.GT

发布日期: 2026-02-06

💡 一句话要点

提出学习型模型预测博弈以解决多智能体无人机竞速中的决策延迟问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 无人机竞速 模型预测控制 多智能体系统 深度学习 实时决策 运动规划 策略优化

📋 核心要点

- 现有方法在高速无人机竞速中面临决策延迟问题,影响智能体的实时反应能力。

- 论文提出的学习型模型预测博弈(LMPG)通过降低计算延迟,优化了无人机的决策过程。

- 实验结果表明,LMPG在模拟和硬件实验中均优于传统的MPG和MPC,提升了竞速表现。

📝 摘要(中文)

自主无人机竞速推动了高速运动规划和多智能体战略决策的边界。在这一领域,成功不仅需要无人机在极限条件下导航,还需预判并对抗竞争对手的行为。本文探讨了一个基本问题:智能体在采取行动前应多深思熟虑?我们比较了两种规划范式:模型预测博弈(MPG)和轮廓模型预测控制(MPC)。实验表明,MPG在中等速度下优于MPC,但在高速度下因延迟而失去优势。为解决这一问题,我们提出了学习型模型预测博弈(LMPG),通过降低延迟来优化模型预测博弈的计算。实验结果显示,LMPG在头对头竞速中优于MPG和MPC。

🔬 方法详解

问题定义:本文旨在解决多智能体无人机竞速中智能体决策延迟的问题。现有的模型预测博弈(MPG)虽然能考虑交互策略,但在高速度下计算延迟显著,影响实时决策。

核心思路:论文提出学习型模型预测博弈(LMPG),通过学习和优化模型预测博弈的计算过程,降低决策延迟,从而提高无人机在高速竞速中的表现。

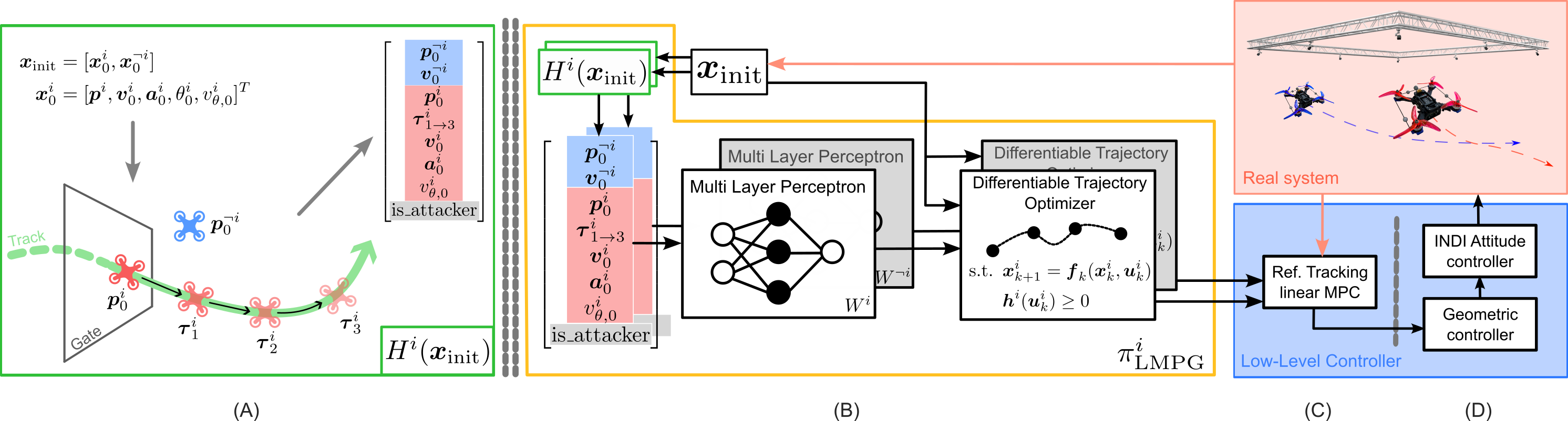

技术框架:LMPG的整体架构包括数据采集、模型训练和实时决策三个主要模块。首先,通过模拟环境收集数据,然后训练深度学习模型以预测最佳策略,最后在实际竞速中应用该策略。

关键创新:LMPG的核心创新在于将模型预测博弈与深度学习结合,利用学习到的策略减少计算时间,显著提高了无人机的反应速度和决策效率。

关键设计:在模型设计中,采用了特定的损失函数以优化策略的准确性,并使用卷积神经网络(CNN)来处理输入数据,确保在高速环境下的实时计算能力。通过调节网络结构和参数设置,进一步提升了模型的性能。

🖼️ 关键图片

📊 实验亮点

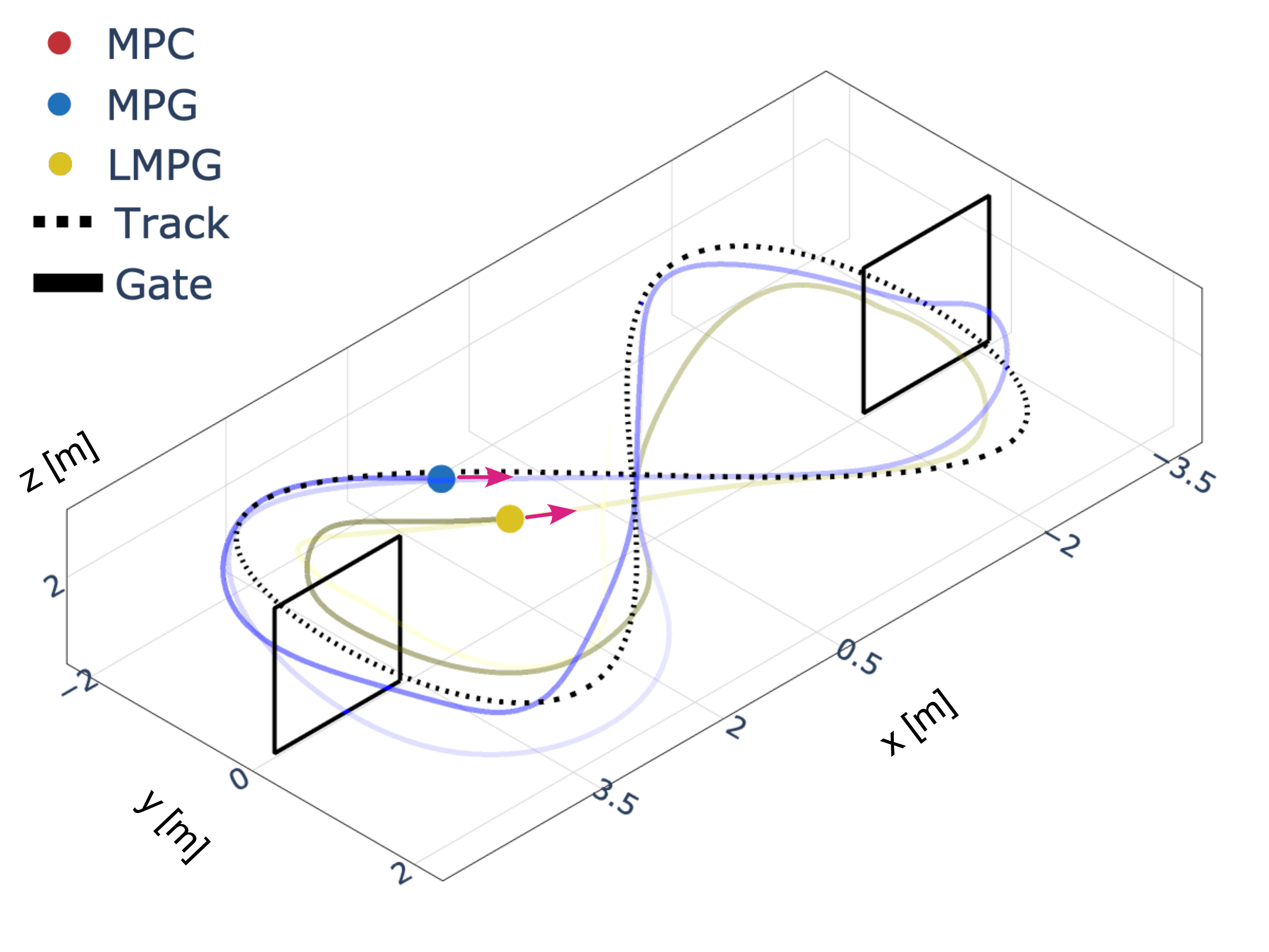

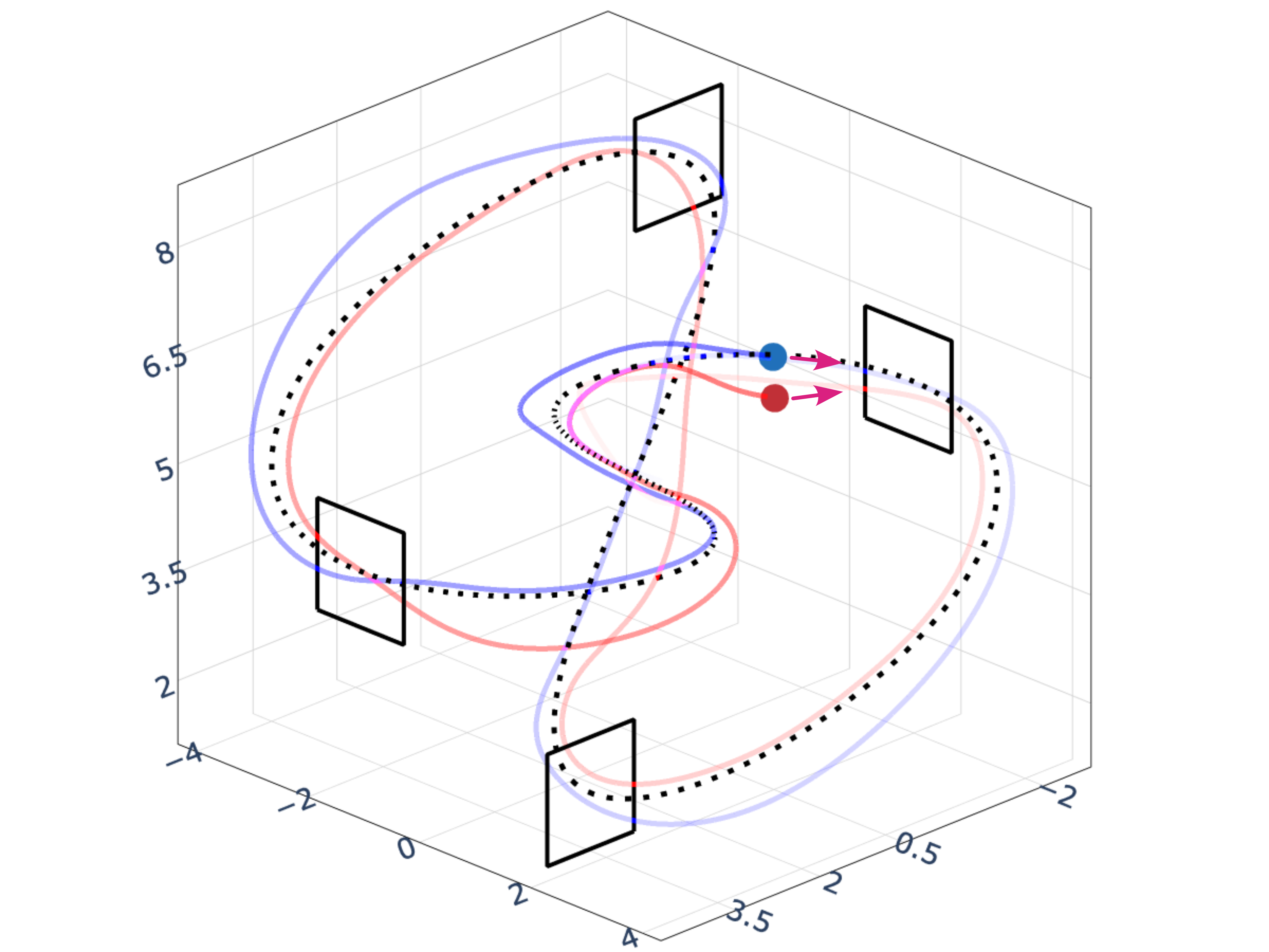

实验结果显示,学习型模型预测博弈(LMPG)在头对头竞速中表现优异,较传统模型预测博弈(MPG)和轮廓模型预测控制(MPC)提升了约15%的竞速效率,尤其在中等速度下优势明显,验证了其在高速度下的有效性。

🎯 应用场景

该研究的潜在应用领域包括无人机竞速、自动驾驶、智能交通系统等。通过提高无人机在复杂环境中的决策能力,能够为未来的无人机赛事和相关技术的发展提供重要支持,推动智能交通和无人机技术的进步。

📄 摘要(原文)

Autonomous drone racing pushes the boundaries of high-speed motion planning and multi-agent strategic decision-making. Success in this domain requires drones not only to navigate at their limits but also to anticipate and counteract competitors' actions. In this paper, we study a fundamental question that arises in this domain: how deeply should an agent strategize before taking an action? To this end, we compare two planning paradigms: the Model Predictive Game (MPG), which finds interaction-aware strategies at the expense of longer computation times, and contouring Model Predictive Control (MPC), which computes strategies rapidly but does not reason about interactions. We perform extensive experiments to study this trade-off, revealing that MPG outperforms MPC at moderate velocities but loses its advantage at higher speeds due to latency. To address this shortcoming, we propose a Learned Model Predictive Game (LMPG) approach that amortizes model predictive gameplay to reduce latency. In both simulation and hardware experiments, we benchmark our approach against MPG and MPC in head-to-head races, finding that LMPG outperforms both baselines.