Humanoid Manipulation Interface: Humanoid Whole-Body Manipulation from Robot-Free Demonstrations

作者: Ruiqian Nai, Boyuan Zheng, Junming Zhao, Haodong Zhu, Sicong Dai, Zunhao Chen, Yihang Hu, Yingdong Hu, Tong Zhang, Chuan Wen, Yang Gao

分类: cs.RO, cs.AI, cs.LG

发布日期: 2026-02-06 (更新: 2026-02-12)

备注: Website: https://humanoid-manipulation-interface.github.io

💡 一句话要点

HuMI:一种基于无机器人演示的人形机器人全身操作框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人形机器人 全身操作 无机器人演示 模仿学习 运动重定向

📋 核心要点

- 现有方法依赖遥操作或强化学习,存在硬件限制和奖励函数设计复杂的问题,限制了自主技能的泛化能力。

- HuMI通过便携式硬件进行无机器人数据采集,利用分层学习流程将人类动作转化为机器人技能。

- 实验表明,HuMI在数据收集效率上优于遥操作,并在多个全身操作任务中取得了良好的成功率。

📝 摘要(中文)

现有的人形机器人全身操作方法主要依赖于遥操作或基于视觉的sim-to-real强化学习,但受到硬件后勤和复杂奖励函数设计的限制。这导致自主技能的演示仍然有限,并且通常局限于受控环境。本文提出了一种便携且高效的框架——人形机器人操作接口(HuMI),用于学习各种环境下的全身操作任务。HuMI通过便携式硬件捕获丰富的全身运动,实现无机器人数据收集。这些数据驱动一个分层学习流程,将人类运动转化为灵巧且可行的人形机器人技能。在五个全身任务(包括跪、蹲、投掷、行走和双手操作)上的大量实验表明,与遥操作相比,HuMI的数据收集效率提高了3倍,并在未见环境中达到了70%的成功率。

🔬 方法详解

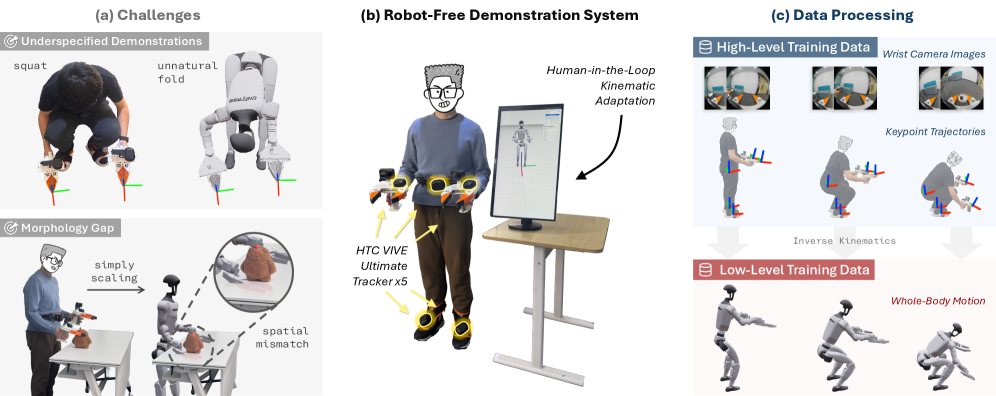

问题定义:现有的人形机器人全身操作方法,如遥操作和基于视觉的sim-to-real强化学习,存在数据采集困难、成本高昂、环境依赖性强等问题。遥操作需要专业的操作人员和复杂的硬件设备,而强化学习则需要大量的试错和精细的奖励函数设计。这些限制导致机器人难以在真实复杂环境中学习和执行多样化的全身操作任务。

核心思路:HuMI的核心思路是通过无机器人演示学习,降低数据采集的难度和成本。通过便携式动作捕捉设备记录人类的全身运动,然后将这些运动数据转化为机器人可以执行的动作。这种方法避免了对机器人硬件的依赖,并且可以利用人类的先验知识来指导机器人的学习。

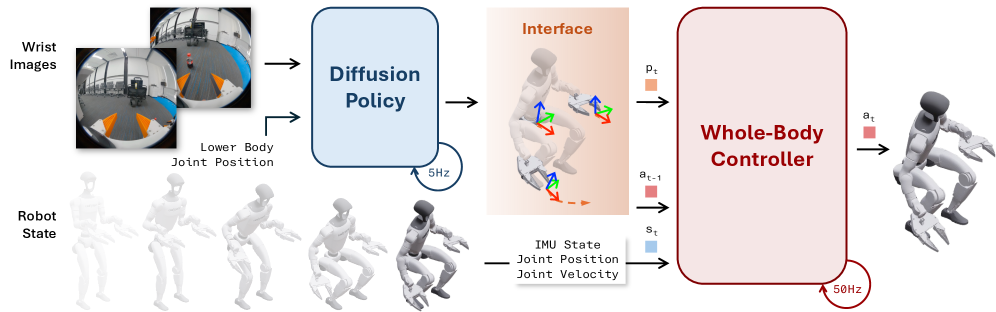

技术框架:HuMI采用分层学习框架,主要包括以下几个阶段:1) 数据采集:使用便携式动作捕捉设备记录人类的全身运动数据。2) 运动重定向:将人类的运动数据映射到机器人的运动空间,考虑到机器人和人类的结构差异。3) 技能学习:利用重定向后的运动数据训练机器人控制器,使其能够执行相应的操作任务。4) 技能泛化:通过强化学习或模仿学习等方法,提高机器人在不同环境下的泛化能力。

关键创新:HuMI的关键创新在于其无机器人演示学习方法。与传统的遥操作和强化学习方法相比,HuMI无需依赖机器人硬件,降低了数据采集的成本和难度。此外,HuMI可以利用人类的先验知识来指导机器人的学习,提高了学习效率和泛化能力。

关键设计:HuMI的关键设计包括:1) 便携式动作捕捉设备的选择,需要保证精度和易用性。2) 运动重定向算法的设计,需要考虑到机器人和人类的结构差异,保证运动的自然性和可行性。3) 技能学习算法的选择,需要根据具体的任务选择合适的算法,如模仿学习、强化学习等。4) 技能泛化策略的设计,需要提高机器人在不同环境下的鲁棒性和适应性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HuMI在数据收集效率上比遥操作提高了3倍,这意味着可以使用更少的时间和资源来训练机器人。此外,HuMI在未见环境中达到了70%的成功率,表明其具有良好的泛化能力。在五个全身任务(包括跪、蹲、投掷、行走和双手操作)上的实验结果验证了HuMI的有效性。

🎯 应用场景

HuMI具有广泛的应用前景,例如在家庭服务、医疗康复、工业制造等领域。它可以帮助机器人学习各种复杂的全身操作任务,如物品搬运、清洁打扫、辅助康复等。通过HuMI,机器人可以更好地适应不同的环境,并与人类进行更自然的交互,从而提高工作效率和服务质量。未来,HuMI有望成为人形机器人领域的重要技术支撑。

📄 摘要(原文)

Current approaches for humanoid whole-body manipulation, primarily relying on teleoperation or visual sim-to-real reinforcement learning, are hindered by hardware logistics and complex reward engineering. Consequently, demonstrated autonomous skills remain limited and are typically restricted to controlled environments. In this paper, we present the Humanoid Manipulation Interface (HuMI), a portable and efficient framework for learning diverse whole-body manipulation tasks across various environments. HuMI enables robot-free data collection by capturing rich whole-body motion using portable hardware. This data drives a hierarchical learning pipeline that translates human motions into dexterous and feasible humanoid skills. Extensive experiments across five whole-body tasks--including kneeling, squatting, tossing, walking, and bimanual manipulation--demonstrate that HuMI achieves a 3x increase in data collection efficiency compared to teleoperation and attains a 70% success rate in unseen environments.