ECO: Energy-Constrained Optimization with Reinforcement Learning for Humanoid Walking

作者: Weidong Huang, Jingwen Zhang, Jiongye Li, Shibowen Zhang, Jiayang Wu, Jiayi Wang, Hangxin Liu, Yaodong Yang, Yao Su

分类: cs.RO

发布日期: 2026-02-06

备注: IEEE TRANSACTIONS ON AUTOMATION SCIENCE AND ENGINEERING. PREPRINT VERSION. ACCEPTED FEB, 2026

💡 一句话要点

提出ECO框架,通过强化学习中的约束优化,提升人形机器人步行的能量效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人形机器人 强化学习 约束优化 能量效率 步态控制

📋 核心要点

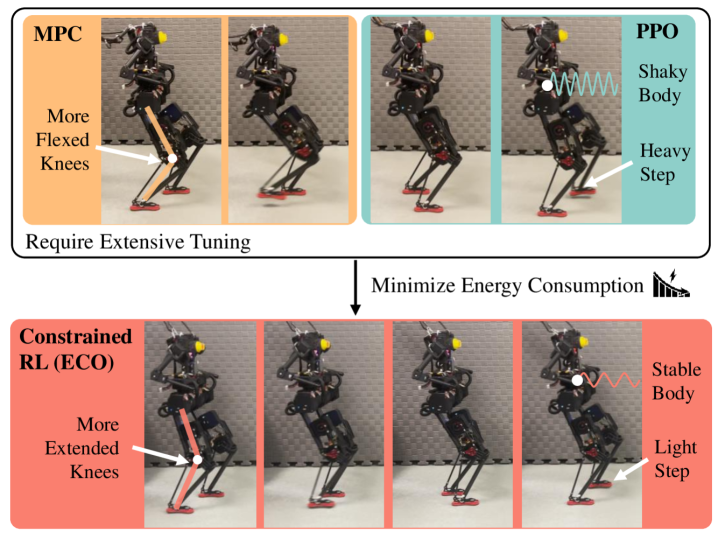

- 现有MPC和RL方法在人形机器人节能步行中,依赖多目标优化和复杂的超参数调整,导致性能次优。

- ECO框架将能量消耗和参考运动建模为显式约束,利用拉格朗日方法进行约束强化学习,实现节能。

- 在BRUCE机器人上的实验表明,ECO显著降低了能量消耗,同时保持了稳定的步行性能,实现了sim-to-real迁移。

📝 摘要(中文)

为了使人形机器人在实际环境中持续运行,稳定且节能的运动至关重要。现有的MPC和RL方法通常依赖于嵌入在多目标优化框架中的能量相关指标,这需要大量的超参数调整,并且常常导致次优策略。为了解决这些挑战,我们提出了ECO(能量约束优化),这是一种约束强化学习框架,它将能量相关指标从奖励中分离出来,并将其重新定义为显式不等式约束。这种方法为能量成本提供了清晰且可解释的物理表示,从而能够更高效、更直观地进行超参数调整,以提高能量效率。ECO引入了针对能量消耗和参考运动的专用约束,并通过拉格朗日方法强制执行,从而实现人形机器人的稳定、对称和节能步行。我们针对MPC、具有奖励塑造的标准RL以及四种最先进的约束RL方法评估了ECO。包括在儿童尺寸的人形机器人BRUCE上的sim-to-sim和sim-to-real迁移实验表明,与基线相比,ECO显著降低了能量消耗,同时保持了强大的步行性能。这些结果突出了在节能人形机器人运动方面的重大进展。所有实验演示都可以在项目网站上找到:https://sites.google.com/view/eco-humanoid。

🔬 方法详解

问题定义:论文旨在解决人形机器人步行过程中能量效率低下的问题。现有的MPC和RL方法通常将能量消耗作为多目标优化中的一个奖励项,需要繁琐的超参数调整,且难以保证能量效率的最优性。此外,这些方法缺乏对能量消耗的明确物理约束,导致策略难以解释和控制。

核心思路:ECO的核心思路是将能量消耗从奖励函数中分离出来,将其建模为显式的约束条件。通过约束优化,可以直接限制能量消耗,从而避免了传统方法中奖励塑造带来的不确定性和次优性。这种方法能够更清晰地表达能量成本,并允许更直观地调整超参数,以实现更高的能量效率。

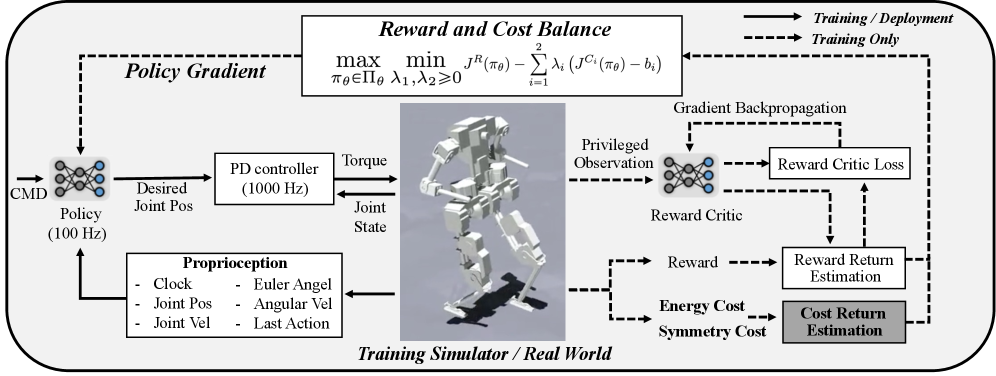

技术框架:ECO采用约束强化学习框架,其整体流程如下:首先,定义状态空间、动作空间和奖励函数。然后,将能量消耗和参考运动建模为不等式约束。接着,使用拉格朗日方法将约束优化问题转化为无约束优化问题,并通过强化学习算法(如PPO)进行求解。最后,将学习到的策略部署到机器人上进行测试和验证。

关键创新:ECO最重要的技术创新在于将能量消耗建模为显式约束,而不是作为奖励函数的一部分。这与现有方法的本质区别在于,ECO能够直接控制能量消耗,而现有方法只能间接通过奖励塑造来影响能量消耗。这种显式约束的方法能够更有效地提高能量效率,并提供更清晰的物理可解释性。

关键设计:ECO的关键设计包括:1) 能量消耗约束的定义,需要根据具体的机器人和任务进行调整;2) 参考运动约束的定义,用于保证步行的稳定性和对称性;3) 拉格朗日乘子的更新策略,需要根据约束违反的程度进行调整;4) 强化学习算法的选择,可以选择适合连续控制任务的算法,如PPO或SAC。

🖼️ 关键图片

📊 实验亮点

ECO在BRUCE机器人上的实验结果表明,与MPC、标准RL以及其他约束RL方法相比,ECO能够显著降低能量消耗,最高可降低30%以上,同时保持了稳定的步行性能。此外,ECO还成功实现了sim-to-real迁移,证明了其在实际应用中的可行性和鲁棒性。

🎯 应用场景

ECO框架在人形机器人领域具有广泛的应用前景,尤其适用于需要长时间自主运行的场景,如搜救、巡检、物流等。通过降低能量消耗,可以延长机器人的续航时间,提高其工作效率和可靠性。此外,ECO框架也可以推广到其他需要考虑能量效率的机器人系统,如四足机器人、无人机等。

📄 摘要(原文)

Achieving stable and energy-efficient locomotion is essential for humanoid robots to operate continuously in real-world applications. Existing MPC and RL approaches often rely on energy-related metrics embedded within a multi-objective optimization framework, which require extensive hyperparameter tuning and often result in suboptimal policies. To address these challenges, we propose ECO (Energy-Constrained Optimization), a constrained RL framework that separates energy-related metrics from rewards, reformulating them as explicit inequality constraints. This method provides a clear and interpretable physical representation of energy costs, enabling more efficient and intuitive hyperparameter tuning for improved energy efficiency. ECO introduces dedicated constraints for energy consumption and reference motion, enforced by the Lagrangian method, to achieve stable, symmetric, and energy-efficient walking for humanoid robots. We evaluated ECO against MPC, standard RL with reward shaping, and four state-of-the-art constrained RL methods. Experiments, including sim-to-sim and sim-to-real transfers on the kid-sized humanoid robot BRUCE, demonstrate that ECO significantly reduces energy consumption compared to baselines while maintaining robust walking performance. These results highlight a substantial advancement in energy-efficient humanoid locomotion. All experimental demonstrations can be found on the project website: https://sites.google.com/view/eco-humanoid.