Action Hallucination in Generative Visual-Language-Action Models

作者: Harold Soh, Eugene Lim

分类: cs.RO, cs.AI

发布日期: 2026-02-06

备注: 22 pages

💡 一句话要点

分析生成式视觉-语言-动作模型中的动作幻觉问题,揭示其与模型结构不匹配的关联

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人控制 动作幻觉 生成式模型 视觉-语言-动作模型 结构性不匹配

📋 核心要点

- 机器人基础模型面临动作幻觉问题,导致违反物理约束和规划失败,影响了其可靠性。

- 论文分析了动作幻觉的根本原因,指出其源于可行机器人行为与模型架构之间的结构性不匹配。

- 研究揭示了拓扑、精度和范围三个关键障碍,并提出了改进生成式机器人策略可靠性的方向。

📝 摘要(中文)

视觉-语言-动作模型等机器人基础模型正在迅速改变机器人策略的训练和部署方式,用端到端生成式动作模型取代了手工设计的规划器。尽管这些系统展示了令人印象深刻的泛化能力,但它们是否从根本上解决了机器人技术的长期挑战仍不清楚。本文通过分析违反物理约束的动作幻觉及其在规划层面的失败来探讨这个问题。针对隐变量生成策略,研究表明幻觉通常源于可行的机器人行为与常见模型架构之间的结构不匹配。本文研究了拓扑、精度和范围这三个障碍,并展示了它们如何施加不可避免的权衡。该分析为已报道的生成式机器人策略的经验性失败提供了机制解释,并为提高可靠性和可信度提出了原则性方向,而无需放弃其表达能力。

🔬 方法详解

问题定义:论文旨在解决生成式视觉-语言-动作模型在机器人控制中出现的动作幻觉问题。现有方法虽然具有良好的泛化能力,但容易产生违反物理约束的动作,导致规划失败,严重影响了机器人的可靠性和安全性。这些问题源于模型无法准确捕捉真实世界物理规律和机器人运动学约束。

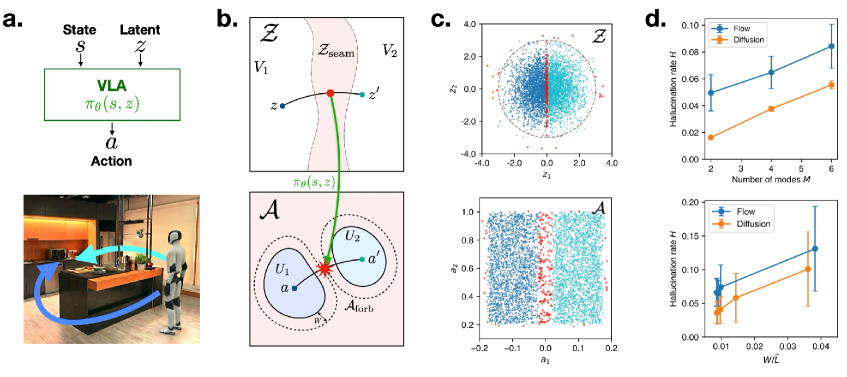

核心思路:论文的核心思路是分析动作幻觉产生的根本原因,并将其归结为模型结构与可行机器人行为之间的结构性不匹配。通过识别和分析这种不匹配,可以更好地理解现有模型的局限性,并为设计更可靠的生成式机器人策略提供指导。论文聚焦于隐变量生成策略,因为这类策略在机器人控制中应用广泛。

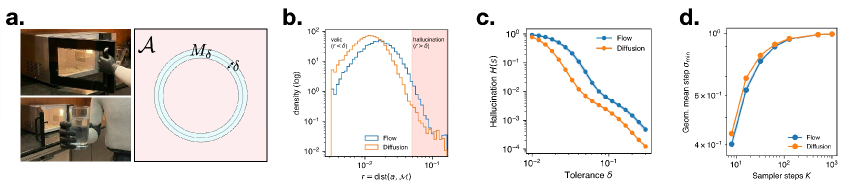

技术框架:论文没有提出一个全新的技术框架,而是侧重于对现有生成式模型的分析。其分析框架包括三个关键维度:拓扑(Topological)、精度(Precision)和范围(Horizon)。拓扑维度关注模型是否能够捕捉环境的拓扑结构;精度维度关注模型生成动作的精确程度;范围维度关注模型规划的范围和长期一致性。通过这三个维度,论文系统地分析了模型结构与机器人行为之间的不匹配。

关键创新:论文的关键创新在于其对动作幻觉的系统性分析和对结构性不匹配的揭示。以往的研究主要关注于提高模型的泛化能力,而忽略了模型结构本身可能存在的局限性。论文首次明确指出,动作幻觉并非仅仅是数据或训练的问题,而是与模型结构密切相关。

关键设计:论文没有提出新的模型结构或算法,因此没有具体的参数设置、损失函数或网络结构需要详细描述。其分析主要基于对现有模型的理解和对实验结果的观察。论文通过理论分析和实验验证,展示了拓扑、精度和范围三个维度上的结构性不匹配如何导致动作幻觉的产生。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了拓扑、精度和范围三个维度上的结构性不匹配会导致动作幻觉。例如,在拓扑维度上,模型可能无法正确处理环境中的障碍物,导致机器人穿墙而过;在精度维度上,模型生成的动作可能不够精确,导致机器人无法准确抓取物体;在范围维度上,模型可能无法进行长期规划,导致机器人陷入局部最优解。

🎯 应用场景

该研究成果可应用于提升机器人自主导航、操作和协作等任务的可靠性和安全性。通过理解和解决动作幻觉问题,可以开发出更值得信赖的机器人系统,从而在工业自动化、医疗保健、家庭服务等领域实现更广泛的应用。未来的研究可以基于此分析,设计更符合机器人行为特性的模型结构。

📄 摘要(原文)

Robot Foundation Models such as Vision-Language-Action models are rapidly reshaping how robot policies are trained and deployed, replacing hand-designed planners with end-to-end generative action models. While these systems demonstrate impressive generalization, it remains unclear whether they fundamentally resolve the long-standing challenges of robotics. We address this question by analyzing action hallucinations that violate physical constraints and their extension to plan-level failures. Focusing on latent-variable generative policies, we show that hallucinations often arise from structural mismatches between feasible robot behavior and common model architectures. We study three such barriers -- topological, precision, and horizon -- and show how they impose unavoidable tradeoffs. Our analysis provides mechanistic explanations for reported empirical failures of generative robot policies and suggests principled directions for improving reliability and trustworthiness, without abandoning their expressive power.