From Vision to Decision: Neuromorphic Control for Autonomous Navigation and Tracking

作者: Chuwei Wang, Eduardo Sebastián, Amanda Prorok, Anastasia Bizyaeva

分类: cs.RO, eess.SY

发布日期: 2026-02-05

💡 一句话要点

提出神经形态控制框架,解决自主导航和跟踪中的决策难题

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 神经形态计算 自主导航 机器人控制 动态系统 视觉伺服

📋 核心要点

- 传统机器人导航难以兼顾反应式控制和模型规划的决策能力,尤其是在目标选择不明朗时。

- 论文提出一种神经形态控制框架,将视觉信息转化为运动指令,利用动态分岔机制解决决策犹豫问题。

- 该方法计算负担小,参数可解释性强,易于集成,并在仿真和四旋翼实验中得到验证。

📝 摘要(中文)

本文提出了一种精简的神经形态控制框架,旨在弥合基于视觉的机器人导航和跟踪中,反应式、基于传感器的控制与基于模型的规划器之间的差距。当目标之间没有明显优势选项时,会导致犹豫不决,反应式系统难以在没有计算密集型规划器的情况下打破对称性,此时这种二元性至关重要。该框架将来自机载摄像头的图像像素编码为动态神经元群的输入,直接将视觉目标激励转换为自我中心的运动指令。动态分岔机制通过延迟承诺直到环境几何结构引起的临界点来解决犹豫不决的问题。该神经形态控制器受到动物认知和观点动力学机制模型的启发,以最小的计算负担和少量可解释的参数提供实时自主性,并且可以与特定应用的图像处理流程无缝集成。我们在仿真环境以及实验性四旋翼平台上验证了我们的方法。

🔬 方法详解

问题定义:现有机器人导航方法在反应式控制和模型规划之间存在脱节。反应式控制虽然快速,但在复杂环境中容易陷入局部最优或无法打破对称性,导致决策犹豫。而模型规划虽然可以做出全局决策,但计算量大,难以实时应用。因此,需要一种能够兼顾实时性和决策能力的控制方法。

核心思路:论文的核心思路是利用神经形态计算的特性,构建一个能够直接将视觉信息转化为运动指令的控制框架。该框架模拟生物神经系统的决策过程,通过动态神经元群处理视觉输入,并利用动态分岔机制解决决策犹豫问题。这种方法能够在保证实时性的同时,做出合理的决策。

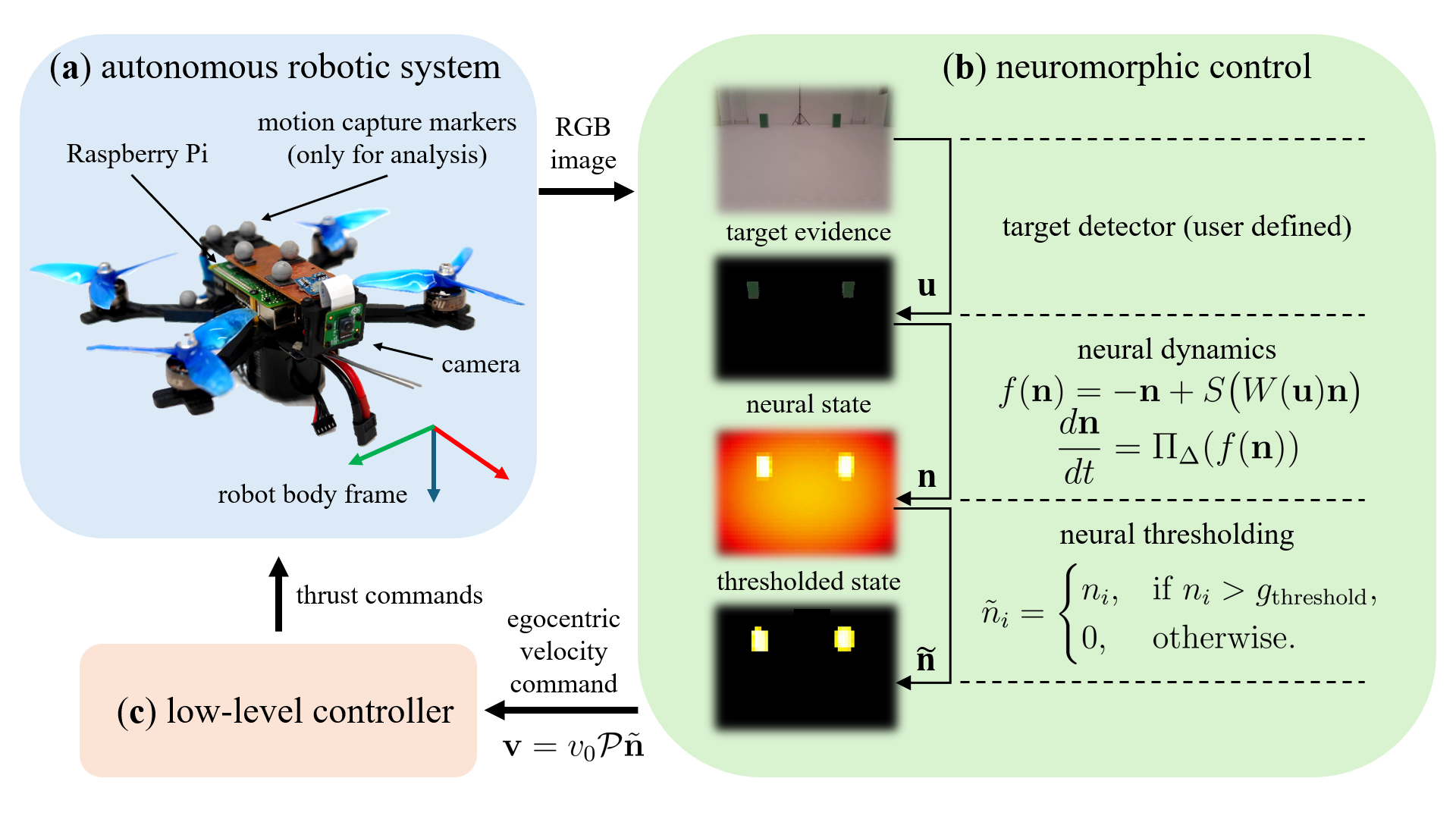

技术框架:整体框架包括图像处理、神经形态控制器和运动控制三个主要模块。首先,通过图像处理模块提取视觉特征,例如目标的位置和大小。然后,神经形态控制器接收这些特征作为输入,通过动态神经元群进行处理,生成自我中心的运动指令。最后,运动控制模块将这些指令转化为实际的电机控制信号,驱动机器人运动。

关键创新:该论文的关键创新在于将神经形态计算应用于机器人导航和跟踪控制。传统的控制方法通常依赖于复杂的数学模型或机器学习算法,而该论文提出的方法则更加简洁和高效。此外,动态分岔机制能够有效地解决决策犹豫问题,提高机器人的自主性和鲁棒性。

关键设计:神经形态控制器的关键设计包括神经元模型的选择、连接权重的设置和动态分岔机制的实现。论文可能采用了某种简化的神经元模型,例如Leaky Integrate-and-Fire模型。连接权重可能根据视觉特征的相对重要性进行设置。动态分岔机制可能通过调整神经元之间的连接强度或引入外部噪声来实现。

🖼️ 关键图片

📊 实验亮点

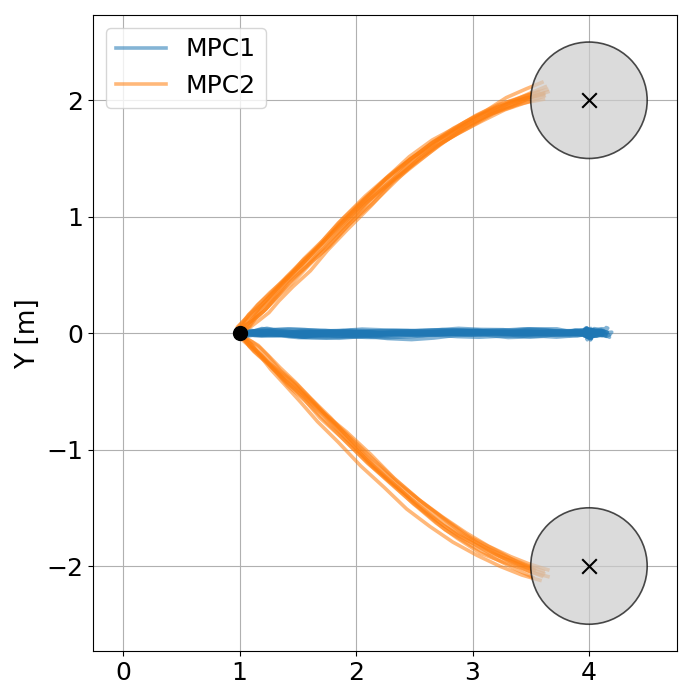

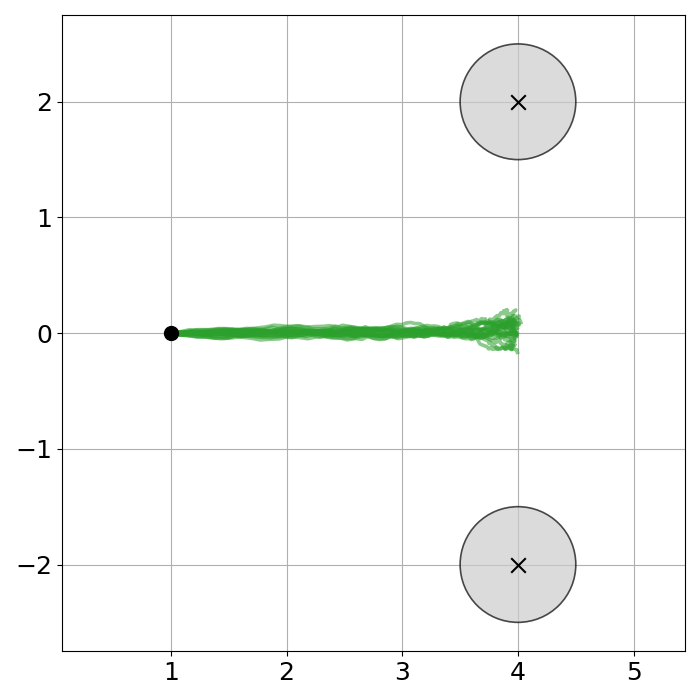

论文在仿真环境和实验性四旋翼平台上验证了所提出的神经形态控制框架。实验结果表明,该方法能够有效地解决决策犹豫问题,实现自主导航和跟踪。虽然论文中没有给出具体的性能数据,但强调了该方法具有实时性好、计算量小等优点,并且可以与现有的图像处理流程无缝集成。

🎯 应用场景

该研究成果可应用于各种自主导航和跟踪任务,例如无人机自主巡检、自动驾驶、机器人辅助医疗等。该方法具有实时性好、计算量小、鲁棒性强等优点,尤其适用于资源受限的嵌入式平台。未来,该方法有望进一步扩展到更复杂的环境和任务中,例如多智能体协作、人机交互等。

📄 摘要(原文)

Robotic navigation has historically struggled to reconcile reactive, sensor-based control with the decisive capabilities of model-based planners. This duality becomes critical when the absence of a predominant option among goals leads to indecision, challenging reactive systems to break symmetries without computationally-intense planners. We propose a parsimonious neuromorphic control framework that bridges this gap for vision-guided navigation and tracking. Image pixels from an onboard camera are encoded as inputs to dynamic neuronal populations that directly transform visual target excitation into egocentric motion commands. A dynamic bifurcation mechanism resolves indecision by delaying commitment until a critical point induced by the environmental geometry. Inspired by recently proposed mechanistic models of animal cognition and opinion dynamics, the neuromorphic controller provides real-time autonomy with a minimal computational burden, a small number of interpretable parameters, and can be seamlessly integrated with application-specific image processing pipelines. We validate our approach in simulation environments as well as on an experimental quadrotor platform.