Benchmarking Affordance Generalization with BusyBox

作者: Dean Fortier, Timothy Adamson, Tess Hellebrekers, Teresa LaScala, Kofi Ennin, Michael Murray, Andrey Kolobov, Galen Mullins

分类: cs.RO, cs.AI

发布日期: 2026-02-05

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出BusyBox基准,用于评估VLA模型在操作新物体时的泛化能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 可供性泛化 机器人操作 基准测试 模块化设计

📋 核心要点

- VLA模型在处理新指令和环境方面展现潜力,但其在操作具有熟悉物理特征的新物体(可供性泛化)方面仍面临挑战。

- 论文提出BusyBox基准,通过模块化设计和变体配置,系统评估VLA模型在不同视觉外观下对相同可供性的泛化能力。

- 实验表明,即使是强大的VLA模型在BusyBox变体上的泛化能力也面临挑战,论文开源了BusyBox的设计和数据集,以促进相关研究。

📝 摘要(中文)

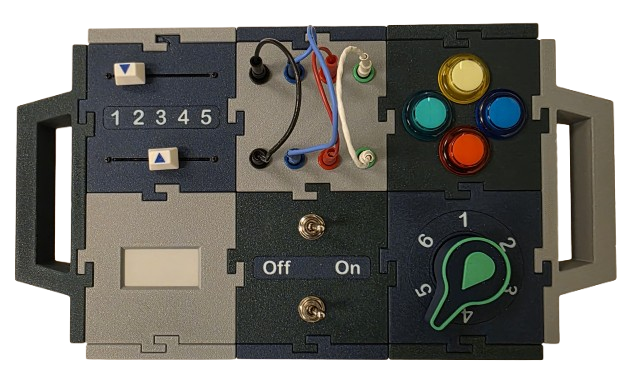

视觉-语言-动作(VLA)模型因其泛化潜力而备受关注。尽管单任务策略仍具有竞争力,但VLA越来越能够处理训练集中未见过的指令和环境。视觉和语言空间的泛化对于鲁棒和通用的行为至关重要,但VLA需要掌握的关键元技能是可供性泛化——即使用熟悉的物理特征来操作新对象的能力。本文提出了BusyBox,一个物理基准,用于系统地半自动评估VLA的可供性泛化能力。BusyBox由6个模块组成,包含开关、滑块、电线、按钮、显示器和拨盘。这些模块可以互换和旋转,从而创建具有不同视觉外观但具有相同可供性的一系列BusyBox变体。实验表明,即使对于像$π_{0.5}$和GR00T-N1.6这样强大的开放权重VLA,跨BusyBox变体的泛化也极具挑战性。为了鼓励研究社区在BusyBox上评估自己的VLA并提出新的可供性泛化实验,BusyBox被设计成易于在大多数机器人实验室中构建。论文发布了用于3D打印其零件的完整CAD文件以及用于(可选)组装其电子设备的物料清单。论文还发布了一个语言注释演示数据集,该数据集是使用常见的双手Mobile Aloha机器人在规范的BusyBox配置上收集的。所有发布的材料都可以在https://microsoft.github.io/BusyBox上找到。

🔬 方法详解

问题定义:现有VLA模型在视觉和语言空间展现出一定的泛化能力,但对于具有相似物理属性的新物体,其操作能力(可供性泛化)仍然不足。现有方法难以系统性地评估和提升VLA模型在可供性泛化方面的性能。

核心思路:论文的核心思路是设计一个模块化的物理基准BusyBox,通过改变模块的排列组合和视觉外观,创建多个具有相同可供性但视觉上不同的变体。这样可以系统地评估VLA模型在不同视觉输入下对相同操作任务的泛化能力。

技术框架:BusyBox基准包含6个模块,每个模块包含不同的交互元素(开关、滑块、电线、按钮、显示器、拨盘)。这些模块可以互换和旋转,形成多种BusyBox变体。论文还提供了一个使用Mobile Aloha机器人收集的语言注释演示数据集,用于训练和评估VLA模型。整体流程为:1) 构建BusyBox;2) 使用数据集训练VLA模型;3) 在不同的BusyBox变体上评估VLA模型的性能。

关键创新:BusyBox的关键创新在于其模块化和可配置性,能够系统地生成具有相同可供性但视觉外观不同的环境,从而实现对VLA模型可供性泛化能力的精确评估。与现有benchmark相比,BusyBox更侧重于评估模型对物体物理属性的理解和利用,而非简单的视觉识别。

关键设计:BusyBox的模块化设计允许灵活配置,可以控制视觉复杂度和操作难度。论文提供了详细的CAD文件和物料清单,方便研究者复现。数据集包含语言注释,方便VLA模型学习语言指令和动作之间的对应关系。论文使用常见的Mobile Aloha机器人进行数据收集,保证了实验的可重复性。

🖼️ 关键图片

📊 实验亮点

论文通过实验证明,即使是目前最先进的开放权重VLA模型(如$π_{0.5}$和GR00T-N1.6)在BusyBox变体上的泛化能力仍然有限,表明可供性泛化是一个具有挑战性的问题。论文发布了BusyBox的设计和数据集,为后续研究提供了基准和资源,促进了VLA模型在可供性泛化方面的研究进展。

🎯 应用场景

该研究成果可应用于机器人操作、自动化控制等领域。通过提高VLA模型的可供性泛化能力,可以使机器人更灵活地适应不同的环境和物体,完成各种复杂任务。例如,在智能家居、工业自动化、医疗机器人等场景中,机器人可以根据用户的指令,操作各种不同的设备和工具。

📄 摘要(原文)

Vision-Language-Action (VLA) models have been attracting the attention of researchers and practitioners thanks to their promise of generalization. Although single-task policies still offer competitive performance, VLAs are increasingly able to handle commands and environments unseen in their training set. While generalization in vision and language space is undoubtedly important for robust versatile behaviors, a key meta-skill VLAs need to possess is affordance generalization -- the ability to manipulate new objects with familiar physical features. In this work, we present BusyBox, a physical benchmark for systematic semi-automatic evaluation of VLAs' affordance generalization. BusyBox consists of 6 modules with switches, sliders, wires, buttons, a display, and a dial. The modules can be swapped and rotated to create a multitude of BusyBox variations with different visual appearances but the same set of affordances. We empirically demonstrate that generalization across BusyBox variants is highly challenging even for strong open-weights VLAs such as $π_{0.5}$ and GR00T-N1.6. To encourage the research community to evaluate their own VLAs on BusyBox and to propose new affordance generalization experiments, we have designed BusyBox to be easy to build in most robotics labs. We release the full set of CAD files for 3D-printing its parts as well as a bill of materials for (optionally) assembling its electronics. We also publish a dataset of language-annotated demonstrations that we collected using the common bimanual Mobile Aloha robot on the canonical BusyBox configuration. All of the released materials are available at https://microsoft.github.io/BusyBox.