From Vision to Assistance: Gaze and Vision-Enabled Adaptive Control for a Back-Support Exoskeleton

作者: Alessandro Leanza, Paolo Franceschi, Blerina Spahiu, Loris Roveda

分类: cs.RO

发布日期: 2026-02-04

💡 一句话要点

提出基于视觉和眼动追踪的自适应控制方法,提升腰部外骨骼的辅助效果。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 腰部外骨骼 视觉门控控制 眼动追踪 自适应控制 人机协作

📋 核心要点

- 现有腰部外骨骼依赖负荷估计或视觉系统,但前者不够直接,后者未充分用于控制。

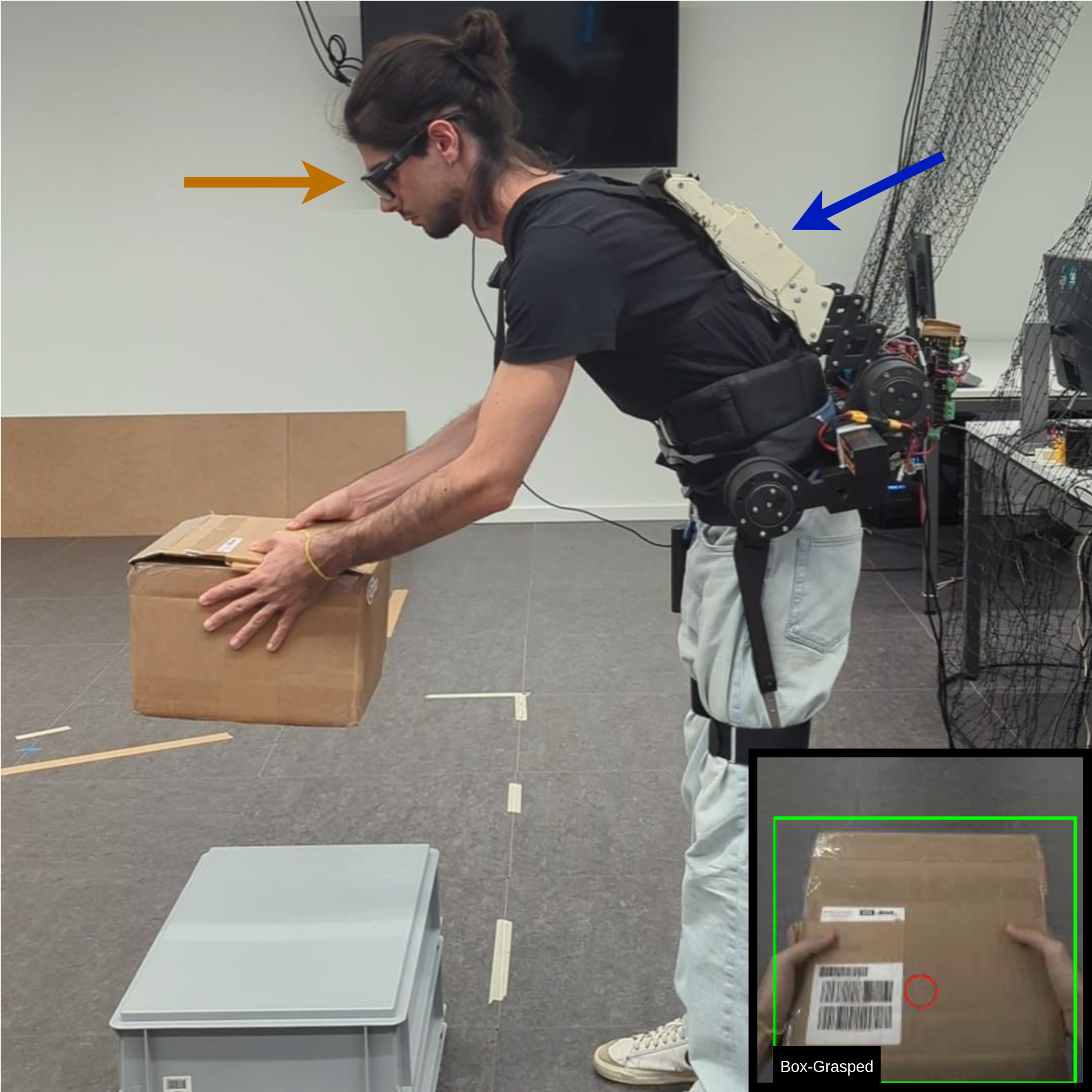

- 论文提出视觉门控控制框架,结合第一人称视觉、眼动追踪和自适应控制,提升外骨骼辅助效果。

- 实验表明,该方法能显著降低体力需求,提高流畅性、信任度和舒适度,用户更偏好该模式。

📝 摘要(中文)

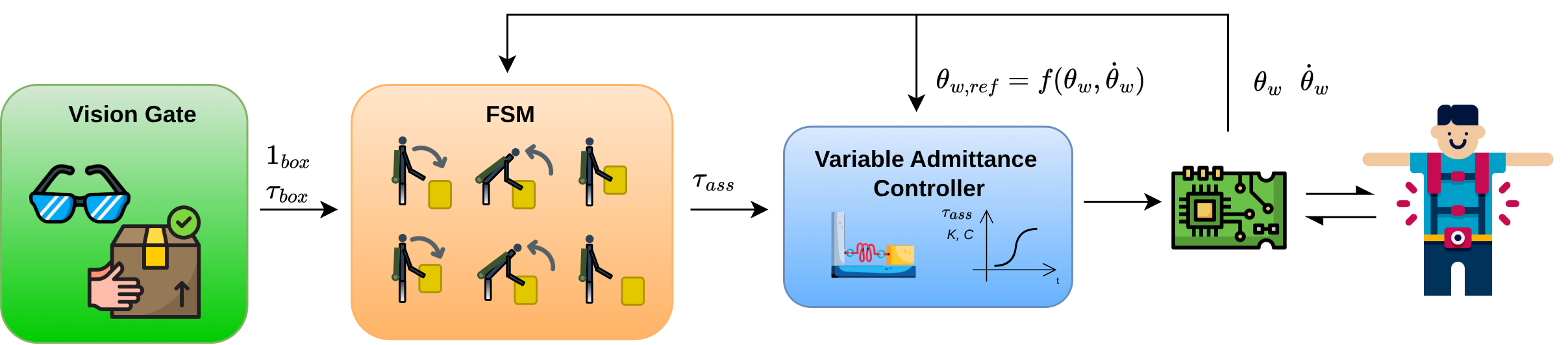

本文提出了一种基于视觉门控控制框架的主动式腰部外骨骼,旨在改善工业搬运中的脊柱负荷。该系统融合了第一人称视角的YOLO目标检测、用于任务进程的有限状态机(FSM)以及可变柔顺控制器,从而根据姿势和物体状态调整扭矩输出。通过包含15名参与者的用户研究,在三种条件下(无外骨骼、无视觉外骨骼、有视觉外骨骼)进行负重弯腰试验,结果表明,基于视觉的辅助显著降低了感知到的体力需求,并提高了流畅性、信任度和舒适度。定量分析显示,启用视觉后,辅助启动更早、力度更强。问卷调查结果证实了用户对视觉门控模式的偏好。这些发现突出了第一人称视角在增强腰部外骨骼的响应性、人体工程学、安全性和接受度方面的潜力。

🔬 方法详解

问题定义:现有腰部支撑外骨骼在工业搬运中旨在减轻脊柱负荷,但其有效性依赖于及时且具有上下文感知能力的辅助。现有方法主要依赖于负荷估计技术(如EMG、IMU)或视觉系统。然而,负荷估计方法不够直接,视觉系统通常不直接用于控制外骨骼的辅助行为,导致辅助时机和力度不够精准,影响用户体验和安全性。

核心思路:论文的核心思路是将第一人称视角视觉信息(物体抓取检测)和眼动追踪信息融入到外骨骼的控制策略中,通过视觉信息判断用户是否需要辅助,并根据物体状态和用户姿势自适应地调整外骨骼的扭矩输出。这种方法能够更及时、更精准地提供辅助,从而提高外骨骼的有效性和用户体验。

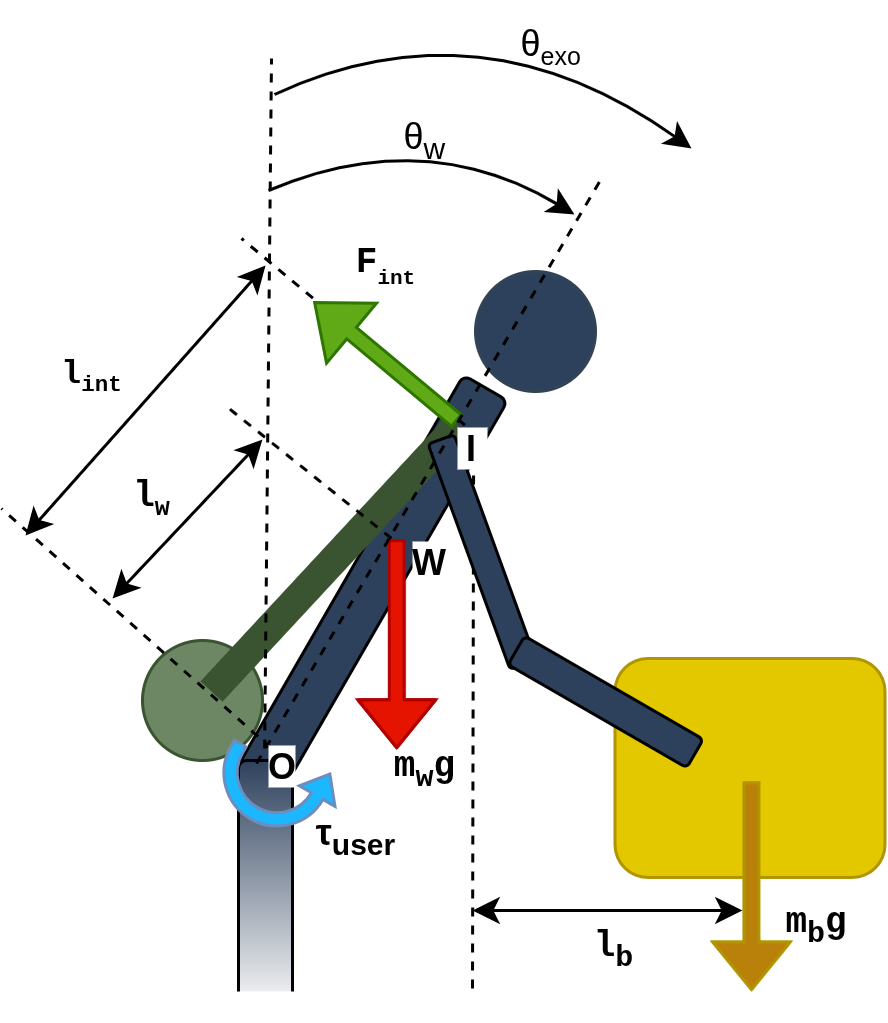

技术框架:该系统的整体框架包括以下几个主要模块:1) 基于YOLO的目标检测模块,用于实时检测第一人称视角中的抓取物体;2) 基于眼动追踪的模块,用于确定用户的注视点;3) 有限状态机(FSM),用于管理任务的进程,例如从“准备抓取”到“抬起物体”等状态的转换;4) 可变柔顺控制器,用于根据姿势和物体状态自适应地调整外骨骼的扭矩输出。这些模块协同工作,实现视觉门控的自适应控制。

关键创新:该论文的关键创新在于将第一人称视角的视觉信息和眼动追踪信息直接用于外骨骼的控制。与传统的基于负荷估计或简单视觉信息的方法相比,该方法能够更准确地判断用户的意图和任务状态,从而提供更及时、更有效的辅助。此外,可变柔顺控制器的设计也使得外骨骼能够根据不同的姿势和物体状态自适应地调整扭矩输出,提高了外骨骼的舒适性和安全性。

关键设计:YOLO目标检测器用于实时检测用户正在抓取的物体,输出物体的类别和位置信息。有限状态机(FSM)根据视觉信息和眼动追踪信息进行状态转移,例如,当检测到用户正在抓取物体并且注视该物体时,FSM从“准备状态”转移到“抓取状态”。可变柔顺控制器的关键在于根据姿势和物体状态调整柔顺参数,例如,在抬起重物时,增加柔顺参数以提供更大的支撑力。

🖼️ 关键图片

📊 实验亮点

用户研究表明,与没有视觉辅助的外骨骼相比,基于视觉门控的辅助显著降低了用户感知到的体力需求,提高了流畅性、信任度和舒适度。定量分析显示,启用视觉后,外骨骼的辅助启动更早、力度更强。问卷调查结果也证实了用户对视觉门控模式的偏好,表明该方法具有良好的用户接受度。

🎯 应用场景

该研究成果可应用于工业搬运、医疗康复等领域。在工业搬运中,可以帮助工人减轻腰部负担,降低工伤风险。在医疗康复中,可以辅助患者进行康复训练,提高康复效果。未来,该技术有望与人工智能、物联网等技术结合,实现更智能、更个性化的外骨骼辅助。

📄 摘要(原文)

Back-support exoskeletons have been proposed to mitigate spinal loading in industrial handling, yet their effectiveness critically depends on timely and context-aware assistance. Most existing approaches rely either on load-estimation techniques (e.g., EMG, IMU) or on vision systems that do not directly inform control. In this work, we present a vision-gated control framework for an active lumbar occupational exoskeleton that leverages egocentric vision with wearable gaze tracking. The proposed system integrates real-time grasp detection from a first-person YOLO-based perception system, a finite-state machine (FSM) for task progression, and a variable admittance controller to adapt torque delivery to both posture and object state. A user study with 15 participants performing stooping load lifting trials under three conditions (no exoskeleton, exoskeleton without vision, exoskeleton with vision) shows that vision-gated assistance significantly reduces perceived physical demand and improves fluency, trust, and comfort. Quantitative analysis reveals earlier and stronger assistance when vision is enabled, while questionnaire results confirm user preference for the vision-gated mode. These findings highlight the potential of egocentric vision to enhance the responsiveness, ergonomics, safety, and acceptance of back-support exoskeletons.