Depth Completion in Unseen Field Robotics Environments Using Extremely Sparse Depth Measurements

作者: Marco Job, Thomas Stastny, Eleni Kelasidi, Roland Siegwart, Michael Pantic

分类: cs.RO

发布日期: 2026-02-03

备注: Accepted to ICRA 2026

💡 一句话要点

提出基于极稀疏深度信息的深度补全模型,用于未知环境下的机器人导航。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 深度补全 机器人导航 合成数据 稀疏深度 实时性 嵌入式平台 单目深度估计

📋 核心要点

- 单目深度估计在机器人领域应用受限,缺乏可靠的尺度信息,易受光照和纹理影响,且缺少大规模数据集。

- 提出一种基于合成数据训练的深度补全模型,利用极稀疏深度测量预测稠密深度,解决尺度和环境适应性问题。

- 在Nvidia Jetson AGX Orin上实现实时运行,并在多种真实机器人场景中验证了其有效性和竞争力。

📝 摘要(中文)

本文提出了一种深度补全模型,旨在解决在非结构化环境中自主作业的机器人对鲁棒感知的需求。该模型利用合成数据进行训练,并使用深度传感器提供的极稀疏测量值,来预测未知机器人作业环境中的稠密、度量深度图。论文设计了一个针对机器人领域的合成数据集生成流程,能够创建多个逼真的数据集用于训练。该流程利用运动结构重建(Structure from Motion)生成的带纹理3D网格和逼真的渲染技术,通过新视角合成来模拟各种机器人应用场景。该方法在Nvidia Jetson AGX Orin上实现了53毫秒/帧的端到端延迟,支持在嵌入式平台上进行实时部署。广泛的评估表明,该方法在各种真实机器人应用场景中表现出具有竞争力的性能。

🔬 方法详解

问题定义:现有单目深度估计方法在机器人领域应用面临挑战,主要痛点在于:缺乏可靠的尺度信息,导致无法获得准确的度量深度;在低纹理或光照条件不佳的环境中表现不佳;以及缺乏针对机器人应用场景的大规模训练数据集。这些问题限制了单目深度估计在实际机器人导航和感知任务中的应用。

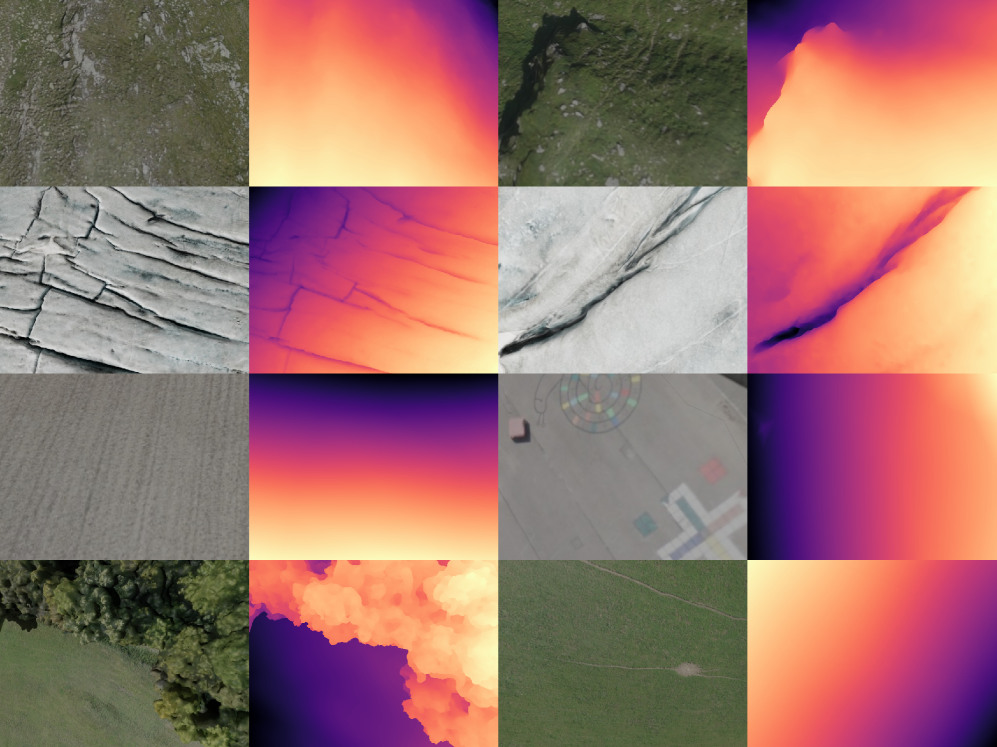

核心思路:本文的核心思路是利用合成数据生成技术,创建大量逼真的机器人应用场景数据集,用于训练深度补全模型。该模型以极稀疏的深度测量作为输入,预测稠密的度量深度图。通过合成数据训练,模型可以学习到场景的几何结构和尺度信息,从而克服真实数据不足和尺度模糊的问题。

技术框架:整体框架包含两个主要部分:合成数据集生成和深度补全模型训练。合成数据集生成流程首先利用运动结构重建(SfM)技术获取场景的3D网格模型,然后使用纹理贴图和光照渲染技术生成逼真的图像。通过随机改变相机位姿和场景参数,可以生成多样化的训练数据。深度补全模型采用编码器-解码器结构,输入是RGB图像和稀疏深度图,输出是稠密深度图。

关键创新:本文的关键创新在于:1) 提出了一个针对机器人领域的合成数据集生成流程,能够生成逼真的、多样化的训练数据;2) 利用极稀疏的深度测量作为输入,降低了对深度传感器精度的要求,提高了模型的鲁棒性;3) 在嵌入式平台上实现了实时运行,使其能够应用于实际的机器人系统。

关键设计:合成数据集生成流程中,使用了随机纹理和光照变化来增加数据的多样性。深度补全模型使用了残差连接和注意力机制来提高模型的性能。损失函数包括深度损失和梯度损失,用于约束预测深度图的准确性和平滑性。具体的网络结构和参数设置在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

该方法在真实机器人场景中进行了广泛的评估,结果表明其性能优于现有的深度补全方法。在Nvidia Jetson AGX Orin上实现了53毫秒/帧的端到端延迟,满足实时性要求。虽然论文中没有给出具体的量化指标和对比基线,但强调了其在真实场景中的竞争性表现(具体数据未知)。

🎯 应用场景

该研究成果可广泛应用于自主移动机器人、无人驾驶车辆、农业机器人等领域。通过提供准确的深度信息,可以帮助机器人在复杂环境中进行导航、避障和目标识别。该技术降低了对昂贵深度传感器的依赖,有望促进低成本机器人系统的发展,并加速机器人在各个行业的普及。

📄 摘要(原文)

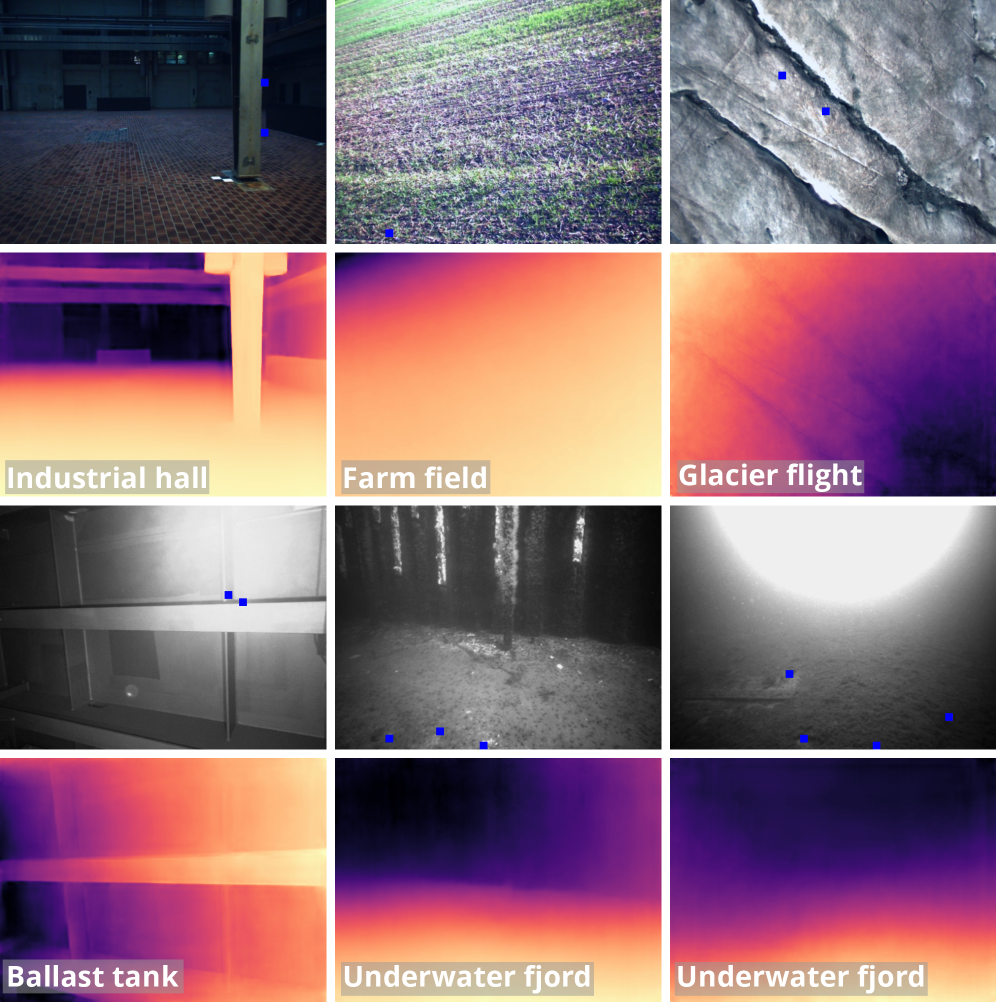

Autonomous field robots operating in unstructured environments require robust perception to ensure safe and reliable operations. Recent advances in monocular depth estimation have demonstrated the potential of low-cost cameras as depth sensors; however, their adoption in field robotics remains limited due to the absence of reliable scale cues, ambiguous or low-texture conditions, and the scarcity of large-scale datasets. To address these challenges, we propose a depth completion model that trains on synthetic data and uses extremely sparse measurements from depth sensors to predict dense metric depth in unseen field robotics environments. A synthetic dataset generation pipeline tailored to field robotics enables the creation of multiple realistic datasets for training purposes. This dataset generation approach utilizes textured 3D meshes from Structure from Motion and photorealistic rendering with novel viewpoint synthesis to simulate diverse field robotics scenarios. Our approach achieves an end-to-end latency of 53 ms per frame on a Nvidia Jetson AGX Orin, enabling real-time deployment on embedded platforms. Extensive evaluation demonstrates competitive performance across diverse real-world field robotics scenarios.