Towards Exploratory and Focused Manipulation with Bimanual Active Perception: A New Problem, Benchmark and Strategy

作者: Yuxin He, Ruihao Zhang, Tianao Shen, Cheng Liu, Qiang Nie

分类: cs.RO, cs.AI

发布日期: 2026-02-02

备注: ICRA 2026

💡 一句话要点

提出探索与聚焦操作(EFM)问题,并设计双臂主动感知(BAP)策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 主动感知 双臂协同 视觉遮挡 模仿学习

📋 核心要点

- 现有机器人操作中,固定在机器人头部的相机易受遮挡,导致信息缺失,阻碍任务完成。

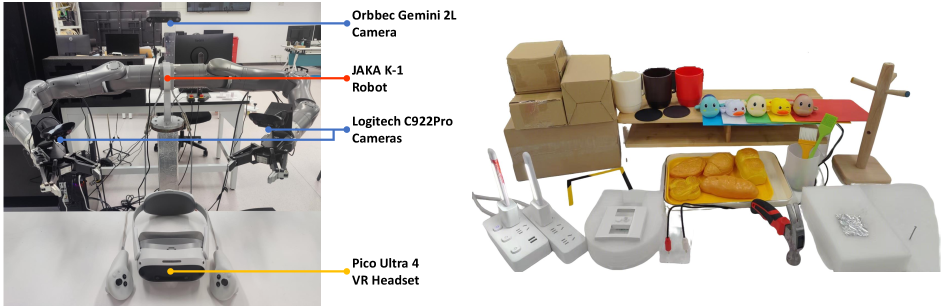

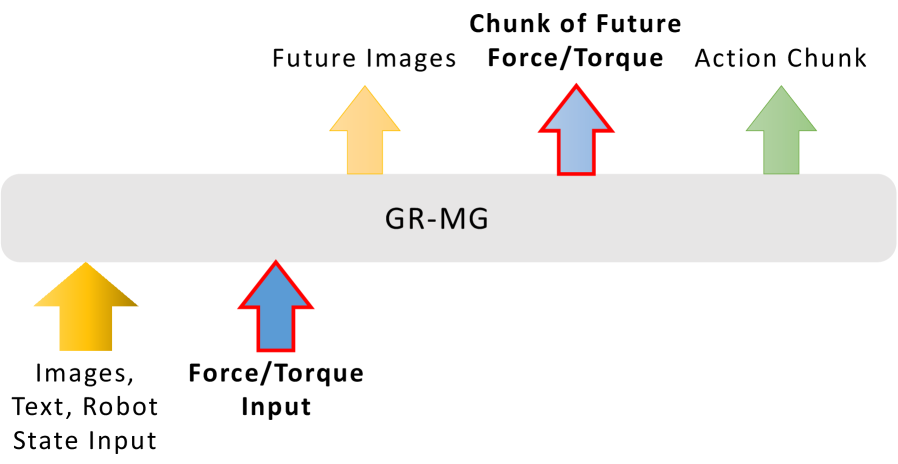

- 论文提出双臂主动感知(BAP)策略,利用一个手臂主动调整视角,另一个手臂进行操作和力觉感知,弥补信息缺失。

- 论文构建了EFM-10基准测试,并通过模仿学习实验验证了BAP策略在解决探索与聚焦操作问题上的有效性。

📝 摘要(中文)

本文提出了探索与聚焦操作(Exploratory and Focused Manipulation, EFM)这一更基础的问题,旨在主动收集信息以完成需要探索或聚焦的复杂操作任务。针对视觉遮挡问题,作者设计了EFM-10基准测试,包含4个类别的共10个任务。为了解决该问题,作者进一步提出了双臂主动感知(Bimanual Active Perception, BAP)策略,利用一个手臂提供主动视觉,另一个手臂提供力觉感知进行操作。基于此,作者收集了名为BAPData的数据集,并通过模仿学习验证了BAP策略的有效性。希望EFM-10基准测试和BAP策略能够为未来的研究奠定基础。

🔬 方法详解

问题定义:论文旨在解决机器人操作中由于视觉遮挡导致的信息缺失问题,从而无法完成需要探索或聚焦的操作任务。现有方法主要依赖于固定的相机视角,容易受到遮挡,无法获取足够的信息来完成复杂的操作任务。因此,论文提出了探索与聚焦操作(EFM)问题,强调主动收集信息的重要性。

核心思路:论文的核心思路是利用双臂协同工作,一个手臂作为主动视觉感知单元,通过调整视角来克服遮挡,获取更全面的场景信息;另一个手臂则负责执行操作任务,并利用力觉传感器感知操作过程中的力反馈。这种双臂协同的方式能够有效地解决视觉遮挡带来的信息缺失问题,提高操作的成功率。

技术框架:整体框架包含两个主要部分:主动视觉感知和操作执行。主动视觉感知部分利用一个手臂控制相机的位置和角度,通过策略选择合适的视角,获取尽可能多的目标物体信息。操作执行部分则利用另一个手臂执行操作任务,并利用力觉传感器感知操作过程中的力反馈。这两个部分通过信息共享和协同工作,共同完成探索与聚焦操作任务。论文还提出了EFM-10基准测试,用于评估不同算法在解决EFM问题上的性能。

关键创新:论文最重要的技术创新点在于提出了双臂主动感知(BAP)策略,将主动视觉感知和力觉感知相结合,用于解决机器人操作中的视觉遮挡问题。与传统的固定视角方法相比,BAP策略能够主动调整视角,获取更全面的场景信息,从而提高操作的成功率。此外,论文还构建了EFM-10基准测试,为未来的研究提供了一个统一的评估平台。

关键设计:在BAP策略中,关键的设计包括:1) 如何选择合适的视角,以最大程度地减少遮挡并获取目标物体的信息;2) 如何融合视觉信息和力觉信息,以提高操作的精度和鲁棒性;3) 如何设计合适的奖励函数,以训练能够有效解决EFM问题的策略。论文使用模仿学习的方式训练BAP策略,通过学习专家示例来提高策略的性能。具体的网络结构和参数设置在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文通过在EFM-10基准测试上进行模仿学习实验,验证了BAP策略的有效性。实验结果表明,BAP策略能够显著提高操作的成功率,尤其是在存在视觉遮挡的情况下。具体的性能数据和对比基线在论文中没有明确给出,属于未知信息。但总体而言,实验结果支持了BAP策略在解决探索与聚焦操作问题上的优势。

🎯 应用场景

该研究成果可应用于各种需要复杂操作的场景,例如:在拥挤环境中进行物体抓取、在遮挡条件下进行装配、以及在未知环境中进行探索等。通过主动感知和双臂协同,机器人能够更好地理解环境,提高操作的成功率和鲁棒性,从而在工业自动化、医疗机器人、家庭服务等领域发挥重要作用。

📄 摘要(原文)

Recently, active vision has reemerged as an important concept for manipulation, since visual occlusion occurs more frequently when main cameras are mounted on the robot heads. We reflect on the visual occlusion issue and identify its essence as the absence of information useful for task completion. Inspired by this, we come up with the more fundamental problem of Exploratory and Focused Manipulation (EFM). The proposed problem is about actively collecting information to complete challenging manipulation tasks that require exploration or focus. As an initial attempt to address this problem, we establish the EFM-10 benchmark that consists of 4 categories of tasks that align with our definition (10 tasks in total). We further come up with a Bimanual Active Perception (BAP) strategy, which leverages one arm to provide active vision and another arm to provide force sensing while manipulating. Based on this idea, we collect a dataset named BAPData for the tasks in EFM-10. With the dataset, we successfully verify the effectiveness of the BAP strategy in an imitation learning manner. We hope that the EFM-10 benchmark along with the BAP strategy can become a cornerstone that facilitates future research towards this direction. Project website: EFManipulation.github.io.