LIEREx: Language-Image Embeddings for Robotic Exploration

作者: Felix Igelbrink, Lennart Niecksch, Marian Renz, Martin Günther, Martin Atzmueller

分类: cs.RO, cs.CV

发布日期: 2026-02-02

备注: This preprint has not undergone peer review or any post-submission improvements or corrections. The Version of Record of this article is published in KI - Künstliche Intelligenz, and is available online at https://doi.org/10.1007/s13218-026-00902-6

期刊: Künstliche Intelligenz (2026)

DOI: 10.1007/s13218-026-00902-6

💡 一句话要点

LIEREx:利用语言-图像嵌入实现机器人自主探索

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人探索 语义地图 视觉-语言模型 CLIP 3D场景图

📋 核心要点

- 传统机器人地图构建方法依赖预定义词汇表,难以处理未知的、分布外的物体。

- LIEREx利用视觉-语言模型(VLFMs)的开放集特性,将物体编码为高维嵌入。

- LIEREx将VLFMs与3D语义场景图结合,使机器人能够在未知环境中进行目标导向的探索。

📝 摘要(中文)

语义地图允许机器人推理其周围环境,以完成诸如导航已知环境、寻找特定对象和探索未映射区域等任务。传统的地图构建方法提供精确的几何表示,但通常受到预先设计的符号词汇表的限制。对固定对象类别的依赖使得处理设计时未定义的分布外知识变得不切实际。视觉-语言基础模型(如CLIP)的最新进展实现了开放集映射,其中对象被编码为高维嵌入而不是固定标签。在LIEREx中,我们将这些VLFMs与已建立的3D语义场景图集成,以实现自主代理在部分未知环境中进行目标导向的探索。

🔬 方法详解

问题定义:现有机器人探索方法依赖于预定义的物体类别,无法识别和利用环境中未知的、分布外的物体信息。这限制了机器人在复杂和动态环境中完成任务的能力,例如寻找特定类型的物体或探索未知的区域。

核心思路:LIEREx的核心思路是利用视觉-语言基础模型(VLFMs)的强大语义理解能力,将环境中的物体表示为高维嵌入向量,而不是预定义的标签。这样,机器人可以理解和处理未知的物体,并根据语言指令进行目标导向的探索。

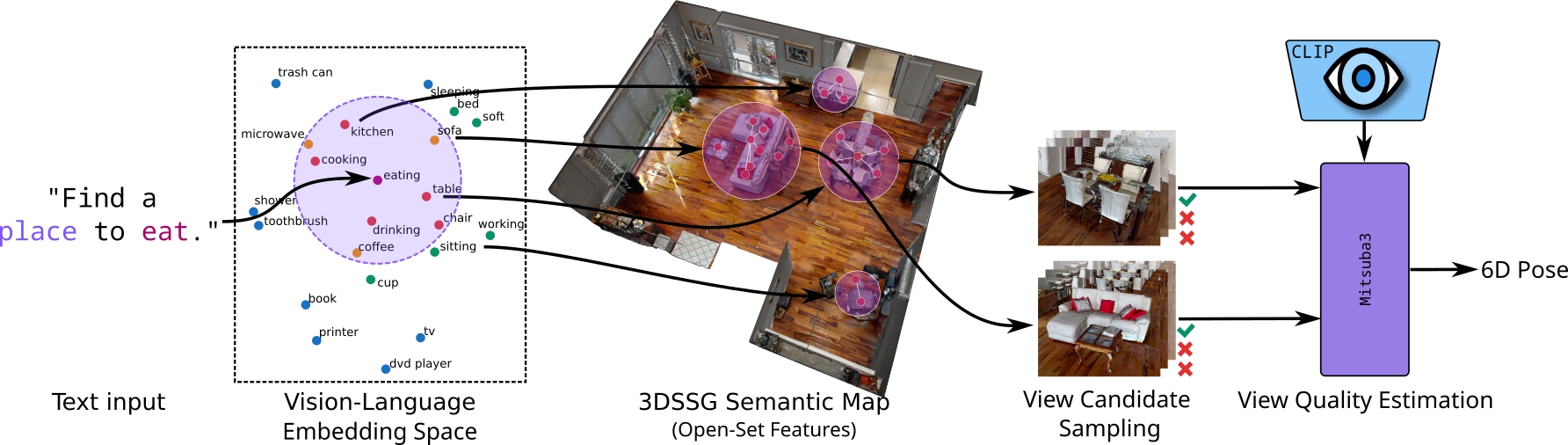

技术框架:LIEREx系统主要包含以下几个模块:1) 3D场景重建模块,用于构建环境的几何表示;2) 视觉-语言嵌入模块,利用VLFMs将图像和文本描述编码为统一的嵌入空间;3) 语义场景图构建模块,将3D场景与物体嵌入关联,构建语义场景图;4) 探索策略模块,根据目标描述和语义场景图,规划机器人的探索路径。

关键创新:LIEREx的关键创新在于将视觉-语言基础模型与3D语义场景图相结合,实现了开放集环境下的目标导向探索。与传统方法相比,LIEREx不再依赖于预定义的物体类别,而是可以根据语言描述动态地识别和探索环境中的物体。

关键设计:LIEREx使用CLIP模型作为视觉-语言嵌入模块,将图像和文本编码为512维的向量。语义场景图中的节点表示物体或区域,边表示物体之间的关系。探索策略基于强化学习,奖励函数鼓励机器人探索未知的区域,并找到与目标描述相关的物体。具体参数设置和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

论文的主要实验结果未知,摘要中没有提供具体的性能数据或对比基线。因此,无法总结实验亮点。需要阅读论文全文才能了解实验设置和结果。

🎯 应用场景

LIEREx可应用于各种机器人自主探索场景,例如:家庭服务机器人可以在未知环境中寻找特定物品;搜救机器人可以在灾难现场探索并定位幸存者;工业机器人可以在复杂环境中进行自主巡检和维护。该研究有助于提升机器人在未知环境中的适应性和智能化水平,具有广泛的应用前景。

📄 摘要(原文)

Semantic maps allow a robot to reason about its surroundings to fulfill tasks such as navigating known environments, finding specific objects, and exploring unmapped areas. Traditional mapping approaches provide accurate geometric representations but are often constrained by pre-designed symbolic vocabularies. The reliance on fixed object classes makes it impractical to handle out-of-distribution knowledge not defined at design time. Recent advances in Vision-Language Foundation Models, such as CLIP, enable open-set mapping, where objects are encoded as high-dimensional embeddings rather than fixed labels. In LIEREx, we integrate these VLFMs with established 3D Semantic Scene Graphs to enable target-directed exploration by an autonomous agent in partially unknown environments.