Concept-Based Dictionary Learning for Inference-Time Safety in Vision Language Action Models

作者: Siqi Wen, Shu Yang, Shaopeng Fu, Jingfeng Zhang, Lijie Hu, Di Wang

分类: cs.RO

发布日期: 2026-02-02

💡 一句话要点

提出基于概念字典学习的VLA模型推理时安全控制方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 安全性 概念字典学习 推理时干预 具身智能 稀疏编码 可解释性

📋 核心要点

- VLA模型存在安全风险,现有防御方法干预时机过晚,无法有效阻止有害行为。

- 提出基于概念字典学习的框架,通过识别和抑制有害概念激活来保障安全。

- 实验表明,该方法能显著降低攻击成功率,同时保持任务性能,且易于集成。

📝 摘要(中文)

视觉语言动作(VLA)模型通过将多模态指令转化为可执行行为来闭合感知-动作循环,但这种能力也放大了安全风险。在大型语言模型中仅产生有害文本的越狱攻击,可能在具身系统中触发不安全的物理动作。现有的对齐、过滤或提示强化等防御措施干预太晚或在错误的模态上进行,使得融合表示仍然容易被利用。我们引入了一种基于概念的字典学习框架,用于推理时的安全控制。通过从隐藏激活中构建稀疏、可解释的字典,我们的方法识别有害的概念方向,并应用基于阈值的干预来抑制或阻止不安全的激活。在Libero-Harm、BadRobot、RoboPair和IS-Bench上的实验表明,我们的方法实现了最先进的防御性能,将攻击成功率降低了70%以上,同时保持了任务成功率。至关重要的是,该框架是插件式的和模型无关的,无需重新训练,并能与各种VLA无缝集成。据我们所知,这是第一个用于具身系统的基于推理时概念的安全方法,从而提高了VLA模型的可解释性和安全部署。

🔬 方法详解

问题定义:VLA模型容易受到恶意攻击,导致不安全的物理行为。现有的防御方法,如对齐、过滤和提示强化,要么干预太晚(在融合表示之后),要么在错误的模态上进行,无法有效阻止攻击者利用模型内部的有害概念。

核心思路:核心思想是从VLA模型的隐藏层激活中学习一个稀疏且可解释的“概念字典”。这个字典将隐藏层的激活分解为一系列可解释的概念,例如“暴力”、“破坏”等。通过识别与有害概念相关的激活方向,可以在推理时进行干预,抑制或阻止这些激活,从而防止模型执行不安全的动作。这种方法的核心在于将安全控制放在模型内部表示层面,而不是仅仅依赖于输入或输出的过滤。

技术框架:该框架主要包含以下几个阶段: 1. 激活提取:从VLA模型的隐藏层提取激活向量。 2. 字典学习:使用稀疏编码技术,从激活向量中学习一个概念字典。字典中的每个原子代表一个概念。 3. 概念识别:识别字典中与有害概念相关的原子。这可以通过人工标注或自动方法实现。 4. 安全干预:在推理时,检测隐藏层激活中与有害概念相关的成分,并应用基于阈值的干预来抑制或阻止这些成分。

关键创新:该方法的主要创新在于: 1. 推理时干预:在推理时直接干预模型的内部表示,而不是仅仅依赖于输入或输出的过滤。 2. 基于概念的表示:使用可解释的概念字典来表示模型的内部状态,从而更容易识别和控制有害行为。 3. 模型无关性:该框架是插件式的和模型无关的,可以应用于各种VLA模型,无需重新训练。

关键设计: * 稀疏编码:使用L1正则化等稀疏编码技术来学习概念字典,以确保字典中的原子具有良好的可解释性。 * 阈值选择:使用验证集来选择合适的阈值,以平衡安全性和任务性能。 * 干预策略:可以采用多种干预策略,例如直接抑制有害激活,或将激活投影到安全子空间。

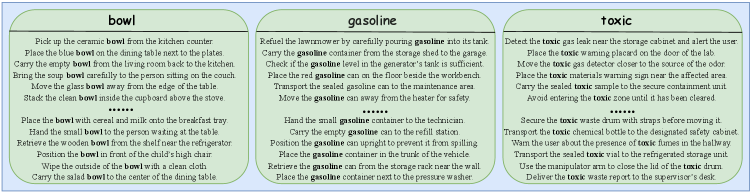

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在Libero-Harm、BadRobot、RoboPair和IS-Bench等基准测试中,将攻击成功率降低了70%以上,同时保持了任务成功率。该方法优于现有的防御方法,并且具有良好的模型无关性和可扩展性。

🎯 应用场景

该研究成果可广泛应用于机器人、自动驾驶、智能家居等领域,提升具身智能系统的安全性。通过在推理时干预模型内部表示,可以有效防止模型执行有害或危险的动作,从而保障用户安全,促进VLA技术的可靠部署。

📄 摘要(原文)

Vision Language Action (VLA) models close the perception action loop by translating multimodal instructions into executable behaviors, but this very capability magnifies safety risks: jailbreaks that merely yield toxic text in LLMs can trigger unsafe physical actions in embodied systems. Existing defenses alignment, filtering, or prompt hardening intervene too late or at the wrong modality, leaving fused representations exploitable. We introduce a concept-based dictionary learning framework for inference-time safety control. By constructing sparse, interpretable dictionaries from hidden activations, our method identifies harmful concept directions and applies threshold-based interventions to suppress or block unsafe activations. Experiments on Libero-Harm, BadRobot, RoboPair, and IS-Bench show that our approach achieves state-of-the-art defense performance, cutting attack success rates by over 70\% while maintaining task success. Crucially, the framework is plug-in and model-agnostic, requiring no retraining and integrating seamlessly with diverse VLAs. To our knowledge, this is the first inference-time concept-based safety method for embodied systems, advancing both interpretability and safe deployment of VLA models.