GAZELOAD A Multimodal Eye-Tracking Dataset for Mental Workload in Industrial Human-Robot Collaboration

作者: Bsher Karbouj, Baha Eddin Gaaloul, Jorg Kruger

分类: cs.RO

发布日期: 2026-01-29

💡 一句话要点

GAZELOAD:用于工业人机协作中精神负荷评估的多模态眼动追踪数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 眼动追踪 精神负荷 人机协作 多模态数据 工业应用

📋 核心要点

- 现有方法难以在真实工业人机协作场景中准确评估精神负荷,缺乏可靠的多模态数据集支持算法开发。

- GAZELOAD数据集通过同步眼动追踪、环境测量和任务上下文信息,为精神负荷评估提供全面数据。

- 该数据集包含26名参与者在不同任务难度和环境条件下的数据,可用于算法开发和环境因素影响研究。

📝 摘要(中文)

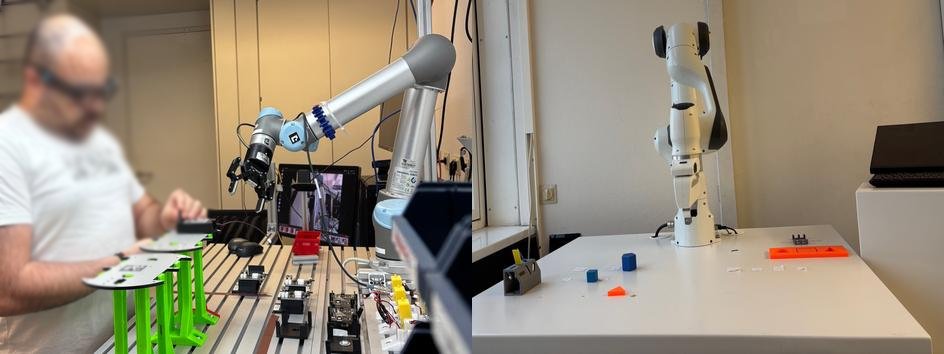

本文介绍了一个名为GAZELOAD的多模态数据集,用于评估工业人机协作中的精神负荷。该数据是在一个实验室装配测试平台中收集的,其中26名参与者与两个协作机器人(UR5和Franka Emika Panda)互动,同时佩戴Meta ARIA智能眼镜。该数据集将眼动追踪信号(瞳孔直径、注视、扫视、眼球注视、注视转移熵、注视离散度指数)与环境实时连续测量(照度)以及任务和机器人上下文(工作台、任务块、诱发故障)进行时间同步,并在任务难度和环境条件受控的情况下进行操作。对于每个参与者和工作负荷分级的任务块,我们提供了CSV文件,其中包含聚合到250毫秒窗口中的眼部指标、环境日志以及1-10 Likert量表上的自我报告的精神负荷评级,这些文件组织在特定于参与者的文件夹中以及文档中。这些数据可用于开发和评估用于精神负荷估计、特征提取和现实工业HRC场景中的时间建模的算法,并研究环境因素(如照明)对基于眼睛的工作负荷标记的影响。

🔬 方法详解

问题定义:论文旨在解决工业人机协作场景中精神负荷难以准确评估的问题。现有方法通常依赖于主观问卷或简单的生理指标,缺乏对环境因素和任务上下文的考虑,难以适应复杂多变的工业环境。此外,缺乏高质量的多模态数据集也限制了相关算法的开发和验证。

核心思路:论文的核心思路是构建一个包含眼动追踪数据、环境测量数据和任务上下文信息的多模态数据集,通过同步这些数据,为精神负荷评估提供更全面、更准确的信息。这种方法能够捕捉到精神负荷变化与环境因素、任务难度之间的关系,从而提高评估的准确性和可靠性。

技术框架:GAZELOAD数据集的构建流程主要包括以下几个阶段:1) 设计实验室装配测试平台,模拟真实的工业人机协作场景;2) 招募参与者,并让他们与协作机器人互动,完成不同难度的任务;3) 使用Meta ARIA智能眼镜收集参与者的眼动追踪数据,同时记录环境照度等信息;4) 对收集到的数据进行时间同步和预处理,并将其组织成易于使用的格式。

关键创新:该数据集的关键创新在于其多模态性和真实性。它不仅包含了丰富的眼动追踪数据,还同步了环境测量数据和任务上下文信息,从而能够更全面地反映精神负荷的变化。此外,该数据集是在真实的工业人机协作场景中收集的,因此具有很高的应用价值。

关键设计:数据集的关键设计包括:1) 使用Meta ARIA智能眼镜进行眼动追踪数据采集,保证了数据的准确性和可靠性;2) 设计了不同难度的任务,以诱发不同的精神负荷水平;3) 记录了环境照度等信息,以便研究环境因素对精神负荷的影响;4) 将数据组织成CSV文件,方便用户使用。

🖼️ 关键图片

📊 实验亮点

GAZELOAD数据集包含26名参与者在不同任务难度和环境条件下的眼动追踪、环境测量和任务上下文数据。该数据集提供了以250ms窗口聚合的眼部指标、环境日志和自我报告的精神负荷评级。这些数据为开发和评估精神负荷估计算法,以及研究环境因素对眼动指标的影响提供了宝贵资源。

🎯 应用场景

该研究成果可应用于工业人机协作、智能制造、人机工程学等领域。通过利用GAZELOAD数据集开发的算法,可以实时监测工人的精神负荷,并根据负荷水平调整任务分配、机器人行为或环境设置,从而提高生产效率、保障工人安全,并优化工作环境。

📄 摘要(原文)

This article describes GAZELOAD, a multimodal dataset for mental workload estimation in industrial human-robot collaboration. The data were collected in a laboratory assembly testbed where 26 participants interacted with two collaborative robots (UR5 and Franka Emika Panda) while wearing Meta ARIA smart glasses. The dataset time-synchronizes eye-tracking signals (pupil diameter, fixations, saccades, eye gaze, gaze transition entropy, fixation dispersion index) with environmental real-time and continuous measurements (illuminance) and task and robot context (bench, task block, induced faults), under controlled manipulations of task difficulty and ambient conditions. For each participant and workload-graded task block, we provide CSV files with ocular metrics aggregated into 250 ms windows, environmental logs, and self-reported mental workload ratings on a 1-10 Likert scale, organized in participant-specific folders alongside documentation. These data can be used to develop and benchmark algorithms for mental workload estimation, feature extraction, and temporal modeling in realistic industrial HRC scenarios, and to investigate the influence of environmental factors such as lighting on eye-based workload markers.