From Instruction to Event: Sound-Triggered Mobile Manipulation

作者: Hao Ju, Shaofei Huang, Hongyu Li, Zihan Ding, Si Liu, Meng Wang, Zhedong Zheng

分类: cs.RO, cs.CV

发布日期: 2026-01-29

💡 一句话要点

提出基于声音触发的移动操作方法,提升机器人自主性和环境适应性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 移动操作 声音触发 机器人自主性 声学感知 物理交互

📋 核心要点

- 现有移动操作方法依赖文本指令,限制了机器人的自主性和对环境变化的适应性。

- 论文提出声音触发的移动操作范式,使机器人无需指令即可主动感知和交互发声物体。

- 实验表明,该方法使机器人能够主动检测和响应听觉事件,在复杂场景中表现出鲁棒性。

📝 摘要(中文)

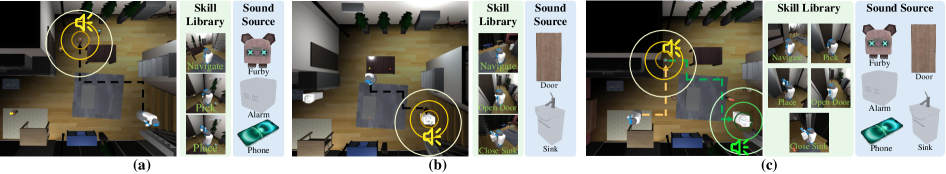

当前移动操作研究主要遵循指令驱动模式,智能体依赖预定义的文本命令来执行任务。然而,这种设置将智能体限制在被动角色,限制了它们的自主性和对动态环境事件的反应能力。为了解决这些限制,我们引入了声音触发的移动操作,其中智能体必须主动感知并与发声物体交互,而无需明确的动作指令。为了支持这些任务,我们开发了Habitat-Echo,一个将声学渲染与物理交互相结合的数据平台。我们进一步提出了一个包含高级任务规划器和低级策略模型的基线,以完成这些任务。大量的实验表明,所提出的基线使智能体能够主动检测和响应听觉事件,消除了对逐个案例指令的需求。值得注意的是,在具有挑战性的双源场景中,智能体成功地从重叠的声学干扰中分离出主要声源以执行第一次交互,随后继续操作次要对象,验证了基线的鲁棒性。

🔬 方法详解

问题定义:现有移动操作方法主要依赖于文本指令,这使得机器人只能被动地执行预先设定的任务,无法自主地感知和响应环境中的动态事件,尤其是在需要根据声音线索进行交互的场景中。这种指令驱动的模式限制了机器人的应用范围和智能化水平。

核心思路:论文的核心思路是利用声音作为触发信号,让机器人能够主动地感知和定位发声物体,并与之进行交互,而无需人为提供明确的指令。通过将声学感知与物理交互相结合,提高机器人的自主性和环境适应性。

技术框架:该方法包含一个高级任务规划器和一个低级策略模型。高级任务规划器负责根据声音信息确定目标物体和交互策略,低级策略模型则负责控制机器人的运动和操作,以完成与目标物体的交互。Habitat-Echo平台用于模拟声学环境和物理交互,为模型的训练和评估提供数据支持。

关键创新:该方法最重要的创新点在于提出了声音触发的移动操作范式,打破了传统指令驱动的限制,使机器人能够更加自主地与环境进行交互。此外,Habitat-Echo平台的开发也为相关研究提供了重要的工具和资源。

关键设计:论文中没有详细描述关键参数设置、损失函数、网络结构等技术细节。但可以推测,声源定位模块可能使用了深度学习模型,例如卷积神经网络或循环神经网络,来提取声音特征并预测声源的位置。低级策略模型可能采用了强化学习算法,例如PPO或DDPG,来学习控制机器人的运动和操作。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法使机器人能够主动检测和响应听觉事件,无需逐个案例的指令。在具有挑战性的双源场景中,机器人成功地从重叠的声学干扰中分离出主要声源,并执行第一次交互,随后操作次要对象,验证了基线的鲁棒性。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究成果可应用于智能家居、安防巡逻、搜救等领域。例如,在智能家居中,机器人可以根据用户的语音指令或环境中的声音事件(如警报声)自动执行相应的操作。在安防巡逻中,机器人可以根据异常声音(如玻璃破碎声)自动定位并进行调查。在搜救场景中,机器人可以根据幸存者的呼救声进行定位和救援。

📄 摘要(原文)

Current mobile manipulation research predominantly follows an instruction-driven paradigm, where agents rely on predefined textual commands to execute tasks. However, this setting confines agents to a passive role, limiting their autonomy and ability to react to dynamic environmental events. To address these limitations, we introduce sound-triggered mobile manipulation, where agents must actively perceive and interact with sound-emitting objects without explicit action instructions. To support these tasks, we develop Habitat-Echo, a data platform that integrates acoustic rendering with physical interaction. We further propose a baseline comprising a high-level task planner and low-level policy models to complete these tasks. Extensive experiments show that the proposed baseline empowers agents to actively detect and respond to auditory events, eliminating the need for case-by-case instructions. Notably, in the challenging dual-source scenario, the agent successfully isolates the primary source from overlapping acoustic interference to execute the first interaction, and subsequently proceeds to manipulate the secondary object, verifying the robustness of the baseline.