DexTac: Learning Contact-aware Visuotactile Policies via Hand-by-hand Teaching

作者: Xingyu Zhang, Chaofan Zhang, Boyue Zhang, Zhinan Peng, Shaowei Cui, Shuo Wang

分类: cs.RO

发布日期: 2026-01-29

💡 一句话要点

DexTac:通过手把手示教学习接触感知型灵巧操作策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion)

关键词: 灵巧操作 触觉感知 动觉示教 策略学习 接触力分布

📋 核心要点

- 现有灵巧操作系统在接触密集型任务中,难以获取和利用高维触觉信息,限制了操作的鲁棒性。

- DexTac通过动觉示教,从人类演示中学习多维触觉信息,包括接触力分布和空间接触区域。

- 实验表明,DexTac在单手注射任务中取得了91.67%的成功率,在高精度场景中显著优于传统方法。

📝 摘要(中文)

对于接触密集型任务,生成具有全面触觉感知运动策略的能力至关重要。然而,现有的灵巧操作数据收集和技能学习系统通常面临低维触觉信息的问题。为了解决这一局限性,我们提出了DexTac,一个基于动觉示教的视觉触觉操作学习框架。DexTac直接从人类演示中捕获多维触觉数据,包括接触力分布和空间接触区域。通过将这些丰富的触觉模态集成到策略网络中,由此产生的接触感知代理能够使灵巧手在复杂的交互过程中自主选择和维持最佳接触区域。我们在一个具有挑战性的单手注射任务中评估了我们的框架。实验结果表明,DexTac的成功率达到了91.67%。值得注意的是,在涉及小型注射器的高精度场景中,我们的方法比仅使用力信息的基线方法提高了31.67%。这些结果表明,从人类演示中学习多维触觉先验对于在接触丰富的环境中实现鲁棒的、类人灵巧操作至关重要。

🔬 方法详解

问题定义:现有灵巧操作方法在处理接触密集型任务时,往往依赖于低维度的触觉信息,例如单个力传感器的数据。这导致策略难以理解复杂的接触状态,从而影响操作的稳定性和精度。特别是在需要精细控制接触区域和力度的任务中,这种局限性尤为明显。因此,如何获取并利用高维度的触觉信息,是提升灵巧操作性能的关键挑战。

核心思路:DexTac的核心思路是通过动觉示教,直接从人类演示中学习触觉先验知识。人类在进行灵巧操作时,能够自然地感知和利用丰富的触觉信息。通过模仿人类的操作,DexTac可以学习到如何选择和维持最佳的接触区域,以及如何根据触觉反馈调整操作策略。这种方法避免了手动设计复杂的触觉模型或奖励函数,从而简化了学习过程。

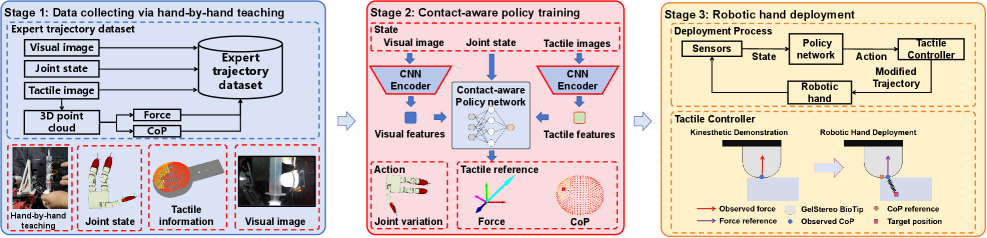

技术框架:DexTac的整体框架包括数据采集、策略学习和策略执行三个主要阶段。在数据采集阶段,使用配备多维触觉传感器的灵巧手进行动觉示教,记录人类操作过程中的视觉和触觉数据。在策略学习阶段,将采集到的数据用于训练一个策略网络,该网络能够根据视觉输入和触觉反馈生成操作指令。在策略执行阶段,将训练好的策略部署到机器人上,使其能够自主完成任务。

关键创新:DexTac最重要的创新在于其能够从人类演示中学习多维触觉先验知识。与传统的基于力信息的控制方法相比,DexTac能够利用更丰富的触觉信息,例如接触力分布和空间接触区域。这使得机器人能够更好地理解接触状态,并根据触觉反馈调整操作策略。此外,DexTac采用动觉示教的方式,避免了手动设计复杂的触觉模型或奖励函数,从而简化了学习过程。

关键设计:DexTac的关键设计包括触觉传感器的选择和策略网络的结构。论文使用了高分辨率的触觉传感器,能够捕获详细的接触力分布和空间接触区域。策略网络采用了深度神经网络结构,能够有效地学习视觉和触觉信息的融合表示。此外,论文还设计了一种特殊的损失函数,用于鼓励策略网络学习人类操作中的触觉模式。

🖼️ 关键图片

📊 实验亮点

DexTac在单手注射任务中取得了显著的成果,成功率达到91.67%。在高精度场景下,DexTac比仅使用力信息的基线方法提高了31.67%。这些结果表明,学习多维触觉先验知识对于实现鲁棒的灵巧操作至关重要。实验结果充分验证了DexTac框架的有效性和优越性。

🎯 应用场景

DexTac技术可应用于各种需要精细操作和接触感知的场景,如医疗手术机器人、精密装配、食品加工等。通过学习人类专家的操作经验,机器人能够更好地适应复杂的工作环境,提高操作的精度和效率。未来,该技术有望推动机器人技术在更多领域的应用,例如家庭服务、灾难救援等。

📄 摘要(原文)

For contact-intensive tasks, the ability to generate policies that produce comprehensive tactile-aware motions is essential. However, existing data collection and skill learning systems for dexterous manipulation often suffer from low-dimensional tactile information. To address this limitation, we propose DexTac, a visuo-tactile manipulation learning framework based on kinesthetic teaching. DexTac captures multi-dimensional tactile data-including contact force distributions and spatial contact regions-directly from human demonstrations. By integrating these rich tactile modalities into a policy network, the resulting contact-aware agent enables a dexterous hand to autonomously select and maintain optimal contact regions during complex interactions. We evaluate our framework on a challenging unimanual injection task. Experimental results demonstrate that DexTac achieves a 91.67% success rate. Notably, in high-precision scenarios involving small-scale syringes, our approach outperforms force-only baselines by 31.67%. These results underscore that learning multi-dimensional tactile priors from human demonstrations is critical for achieving robust, human-like dexterous manipulation in contact-rich environments.