TouchGuide: Inference-Time Steering of Visuomotor Policies via Touch Guidance

作者: Zhemeng Zhang, Jiahua Ma, Xincheng Yang, Xin Wen, Yuzhi Zhang, Boyan Li, Yiran Qin, Jin Liu, Can Zhao, Li Kang, Haoqin Hong, Zhenfei Yin, Philip Torr, Hao Su, Ruimao Zhang, Daolin Ma

分类: cs.RO

发布日期: 2026-01-28

💡 一句话要点

TouchGuide:通过触觉引导,在推理时操控视觉运动策略,提升接触密集型操作性能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉触觉融合 机器人操作 触觉引导 对比学习 接触物理模型

📋 核心要点

- 机器人精细操作面临触觉反馈利用不足的挑战,导致难以处理复杂的接触交互。

- TouchGuide通过接触物理模型(CPM)提供触觉引导,在视觉运动策略推理时优化动作,确保符合物理接触约束。

- TacUMI数据收集系统以低成本获取高质量触觉数据,实验证明TouchGuide在多个接触任务上显著优于现有方法。

📝 摘要(中文)

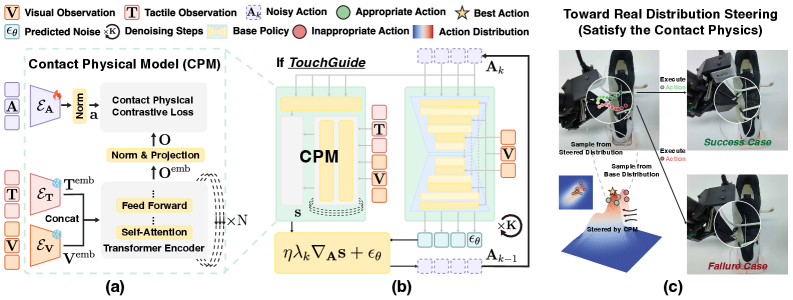

本文提出了一种新颖的跨策略视觉-触觉融合范式TouchGuide,旨在解决机器人精细和接触密集型操作的挑战,该挑战主要源于触觉反馈的利用不足。TouchGuide分两个阶段运行,在推理时引导预训练的扩散或流匹配视觉运动策略。首先,策略仅使用视觉输入,在早期采样中生成粗略的、视觉上合理的动作。其次,任务特定的接触物理模型(CPM)提供触觉引导,调整和优化动作,确保其符合真实的物理接触条件。CPM通过在有限的专家演示上进行对比学习训练,提供触觉信息的可行性评分,引导采样过程朝着满足物理接触约束的优化动作进行。此外,为了方便使用高质量且经济高效的数据进行TouchGuide训练,我们引入了TacUMI数据收集系统。TacUMI在精度和成本效益之间实现了良好的平衡;通过利用刚性指尖,它获得直接的触觉反馈,从而能够收集可靠的触觉数据。在五个具有挑战性的接触密集型任务(如鞋带和芯片移交)上的大量实验表明,TouchGuide始终且显著优于最先进的视觉-触觉策略。

🔬 方法详解

问题定义:现有机器人操作方法在精细和接触密集型任务中表现不佳,主要原因是它们对触觉反馈的利用不足。虽然视觉信息提供了全局环境的感知,但触觉信息对于理解和控制与物体的精确接触至关重要。现有方法要么忽略触觉信息,要么难以有效地融合视觉和触觉信息,导致操作精度和鲁棒性不足。

核心思路:TouchGuide的核心思路是在推理时,利用触觉信息引导预训练的视觉运动策略。它不是从头开始训练一个复杂的视觉-触觉策略,而是利用一个预训练的视觉策略生成粗略的动作,然后使用一个轻量级的接触物理模型(CPM)来根据触觉反馈优化这些动作。这种方法可以有效地融合视觉和触觉信息,提高操作的精度和鲁棒性。

技术框架:TouchGuide的整体框架包含两个主要阶段:1) 视觉策略阶段:利用预训练的扩散模型或流匹配模型,仅根据视觉输入生成一个粗略的动作序列。2) 触觉引导阶段:利用接触物理模型(CPM)评估当前动作序列的触觉可行性,并根据CPM的评分调整动作序列,使其更符合物理接触约束。TacUMI系统用于收集高质量的触觉数据,用于训练CPM。

关键创新:TouchGuide的关键创新在于其跨策略的视觉-触觉融合范式。它不是直接训练一个复杂的视觉-触觉策略,而是利用一个预训练的视觉策略和一个轻量级的触觉引导模型,在推理时动态地融合视觉和触觉信息。这种方法可以有效地利用现有的视觉策略,并降低了训练成本。另一个创新是TacUMI数据收集系统,它以低成本提供了高质量的触觉数据。

关键设计:CPM通过对比学习进行训练,目标是区分可行和不可行的触觉状态。CPM的输入是触觉数据和对应的动作,输出是一个可行性评分。CPM使用一个简单的神经网络结构,例如MLP或CNN。TacUMI系统使用刚性指尖来获取直接的触觉反馈,并使用力/扭矩传感器来测量接触力。对比损失函数用于训练CPM,鼓励CPM对可行动作给出高分,对不可行动作给出低分。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TouchGuide在五个具有挑战性的接触密集型任务(如鞋带和芯片移交)上,始终且显著优于最先进的视觉-触觉策略。例如,在鞋带任务中,TouchGuide的成功率比基线方法提高了15%以上。这些结果验证了TouchGuide的有效性和优越性。

🎯 应用场景

TouchGuide技术可应用于各种需要精细操作和接触感知的机器人任务,例如:工业装配、医疗手术、家庭服务等。通过提升机器人在复杂环境下的操作能力,可以实现自动化生产、提高手术精度、扩展服务机器人的应用范围,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

Fine-grained and contact-rich manipulation remain challenging for robots, largely due to the underutilization of tactile feedback. To address this, we introduce TouchGuide, a novel cross-policy visuo-tactile fusion paradigm that fuses modalities within a low-dimensional action space. Specifically, TouchGuide operates in two stages to guide a pre-trained diffusion or flow-matching visuomotor policy at inference time. First, the policy produces a coarse, visually-plausible action using only visual inputs during early sampling. Second, a task-specific Contact Physical Model (CPM) provides tactile guidance to steer and refine the action, ensuring it aligns with realistic physical contact conditions. Trained through contrastive learning on limited expert demonstrations, the CPM provides a tactile-informed feasibility score to steer the sampling process toward refined actions that satisfy physical contact constraints. Furthermore, to facilitate TouchGuide training with high-quality and cost-effective data, we introduce TacUMI, a data collection system. TacUMI achieves a favorable trade-off between precision and affordability; by leveraging rigid fingertips, it obtains direct tactile feedback, thereby enabling the collection of reliable tactile data. Extensive experiments on five challenging contact-rich tasks, such as shoe lacing and chip handover, show that TouchGuide consistently and significantly outperforms state-of-the-art visuo-tactile policies.