TRACER: Texture-Robust Affordance Chain-of-Thought for Deformable-Object Refinement

作者: Wanjun Jia, Kang Li, Fan Yang, Mengfei Duan, Wenrui Chen, Yiming Jiang, Hui Zhang, Kailun Yang, Zhiyong Li, Yaonan Wang

分类: cs.RO, cs.CV

发布日期: 2026-01-28

备注: The source code and dataset will be made publicly available at https://github.com/Dikay1/TRACER

🔗 代码/项目: GITHUB

💡 一句话要点

提出TRACER框架,增强机器人对纹理复杂形变物体操作的认知与控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 形变物体操作 机器人操作 认知链 纹理鲁棒性 空间约束 语义推理 功能区域细化

📋 核心要点

- 现有方法在处理形变物体时,由于自由度高、动态复杂和纹理多样,导致认知预测易出现边界溢出和区域碎片化。

- TRACER框架通过树状认知链分解任务意图,并利用空间约束和交互收敛细化,实现纹理鲁棒的功能区域细化。

- 实验表明,TRACER在形变物体上显著提升了认知定位精度和长时程任务成功率,弥合了语义与物理执行的差距。

📝 摘要(中文)

针对形变物体机器人操作中,外观和纹理变化带来的语义指令与物理交互点对齐难题,现有基于视觉的认知预测方法常出现边界溢出和功能区域碎片化。本文提出TRACER框架,即具有形变物体细化的纹理鲁棒性认知链,建立从分层语义推理到外观鲁棒且物理一致的功能区域细化的跨层映射。具体而言,构建树状认知链(TA-CoT)将高层任务意图分解为分层子任务语义,为各个执行阶段提供一致指导。引入空间约束边界细化(SCBR)机制抑制预测溢出,引导感知响应收敛到真实的交互流形。开发交互收敛细化流(ICRF)聚合被外观噪声破坏的离散像素,显著增强识别的功能区域的空间连续性和物理合理性。在Fine-AGDDO15数据集和真实机器人平台上的实验表明,TRACER显著提高了形变物体固有纹理和图案上的认知定位精度,并提高了长时程任务的成功率,有效弥合了高层语义推理和低层物理执行之间的差距。

🔬 方法详解

问题定义:论文旨在解决机器人操作形变物体时,由于物体纹理复杂多变,导致视觉感知的交互区域不准确的问题。现有方法容易出现预测区域超出物体边界(边界溢出)以及预测的交互区域不连续(区域碎片化)的现象,影响操作的成功率。

核心思路:论文的核心思路是将高层语义指令分解为一系列子任务,形成一个树状的认知链,指导对交互区域的感知和细化。同时,通过空间约束和像素聚合,增强预测区域的连续性和物理合理性,从而提高对复杂纹理形变物体的操作性能。

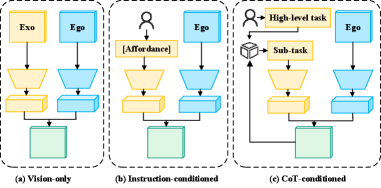

技术框架:TRACER框架包含三个主要模块:1) 树状认知链(TA-CoT):将高层任务意图分解为分层子任务语义,提供一致的指导。2) 空间约束边界细化(SCBR):抑制预测溢出,引导感知响应收敛到真实的交互流形。3) 交互收敛细化流(ICRF):聚合被外观噪声破坏的离散像素,增强空间连续性和物理合理性。整体流程是从高层语义到低层像素的逐步细化和约束。

关键创新:该论文的关键创新在于将认知链的思想引入到形变物体的操作中,通过分层语义推理来指导交互区域的感知。同时,提出的空间约束边界细化和交互收敛细化流有效地解决了纹理复杂带来的感知噪声问题,提升了预测的准确性和鲁棒性。

关键设计:TA-CoT的具体实现方式(例如,如何构建树结构,如何定义子任务),SCBR中空间约束的具体形式(例如,使用的损失函数,约束的强度),ICRF中像素聚合的算法(例如,使用的图模型,聚合的策略)等细节在论文中应该有更详细的描述。损失函数的设计可能包括交叉熵损失、Dice损失等,用于优化分割结果。网络结构可能采用U-Net或类似的编码器-解码器结构,用于像素级别的预测。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TRACER在Fine-AGDDO15数据集上显著提高了认知定位精度,尤其是在处理具有复杂纹理的形变物体时。此外,在真实机器人平台上,TRACER也成功提高了长时程任务的成功率,验证了其在实际应用中的有效性。具体性能数据需要在论文中查找。

🎯 应用场景

该研究成果可应用于服装整理、医疗手术、食品加工等领域,提升机器人对形变物体的操作能力。例如,在服装整理中,机器人可以准确识别衣领、袖口等关键区域,实现高效的折叠和整理。在医疗手术中,可以辅助医生进行精细的手术操作,提高手术的精度和安全性。未来,该技术有望推动机器人更加智能化和自主化。

📄 摘要(原文)

The central challenge in robotic manipulation of deformable objects lies in aligning high-level semantic instructions with physical interaction points under complex appearance and texture variations. Due to near-infinite degrees of freedom, complex dynamics, and heterogeneous patterns, existing vision-based affordance prediction methods often suffer from boundary overflow and fragmented functional regions. To address these issues, we propose TRACER, a Texture-Robust Affordance Chain-of-thought with dEformable-object Refinement framework, which establishes a cross-hierarchical mapping from hierarchical semantic reasoning to appearance-robust and physically consistent functional region refinement. Specifically, a Tree-structured Affordance Chain-of-Thought (TA-CoT) is formulated to decompose high-level task intentions into hierarchical sub-task semantics, providing consistent guidance across various execution stages. To ensure spatial integrity, a Spatial-Constrained Boundary Refinement (SCBR) mechanism is introduced to suppress prediction spillover, guiding the perceptual response to converge toward authentic interaction manifolds. Furthermore, an Interactive Convergence Refinement Flow (ICRF) is developed to aggregate discrete pixels corrupted by appearance noise, significantly enhancing the spatial continuity and physical plausibility of the identified functional regions. Extensive experiments conducted on the Fine-AGDDO15 dataset and a real-world robotic platform demonstrate that TRACER significantly improves affordance grounding precision across diverse textures and patterns inherent to deformable objects. More importantly, it enhances the success rate of long-horizon tasks, effectively bridging the gap between high-level semantic reasoning and low-level physical execution. The source code and dataset will be made publicly available at https://github.com/Dikay1/TRACER.