HARMONI: Multimodal Personalization of Multi-User Human-Robot Interactions with LLMs

作者: Jeanne Malécot, Hamed Rahimi, Jeanne Cattoni, Marie Samson, Mouad Abrini, Mahdi Khoramshahi, Maribel Pino, Mohamed Chetouani

分类: cs.RO, cs.AI, cs.HC

发布日期: 2026-01-27

💡 一句话要点

HARMONI:利用LLM实现多用户人机交互的多模态个性化

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 多模态融合 大型语言模型 个性化 用户建模

📋 核心要点

- 现有人机交互系统难以在多用户场景下进行持续的个性化和动态适应,限制了其应用。

- HARMONI框架利用大型语言模型,通过多模态输入和用户建模,实现社会辅助机器人的个性化交互。

- 实验表明,HARMONI在说话者识别、在线记忆更新和伦理对齐的个性化方面优于基线方法。

📝 摘要(中文)

现有人机交互系统通常缺乏在多用户环境中进行持续个性化和动态适应的机制,限制了它们在实际部署中的有效性。我们提出了HARMONI,一个多模态个性化框架,它利用大型语言模型使社会辅助机器人能够管理长期的多用户交互。该框架集成了四个关键模块:(i)一个感知模块,用于识别活跃的说话者并提取多模态输入;(ii)一个世界建模模块,用于维护环境和短期对话上下文的表示;(iii)一个用户建模模块,用于更新长期特定于说话者的配置文件;(iv)一个生成模块,用于生成上下文相关的和符合伦理的响应。通过对四个数据集的广泛评估和消融研究,以及在疗养院环境中进行的真实场景驱动的用户研究,我们证明了HARMONI支持强大的说话者识别、在线记忆更新和符合伦理的个性化,在用户建模准确性、个性化质量和用户满意度方面优于基线LLM驱动的方法。

🔬 方法详解

问题定义:现有人机交互系统在多用户环境中难以实现长期、动态的个性化交互。痛点在于无法有效识别和区分不同用户的特征,并根据用户的长期偏好进行适应性调整,导致交互体验不佳。

核心思路:HARMONI的核心思路是利用大型语言模型(LLM)作为知识库和推理引擎,结合多模态感知信息和用户建模,使机器人能够理解用户的意图和偏好,并生成个性化的响应。通过维护环境和用户的长期记忆,实现持续的个性化交互。

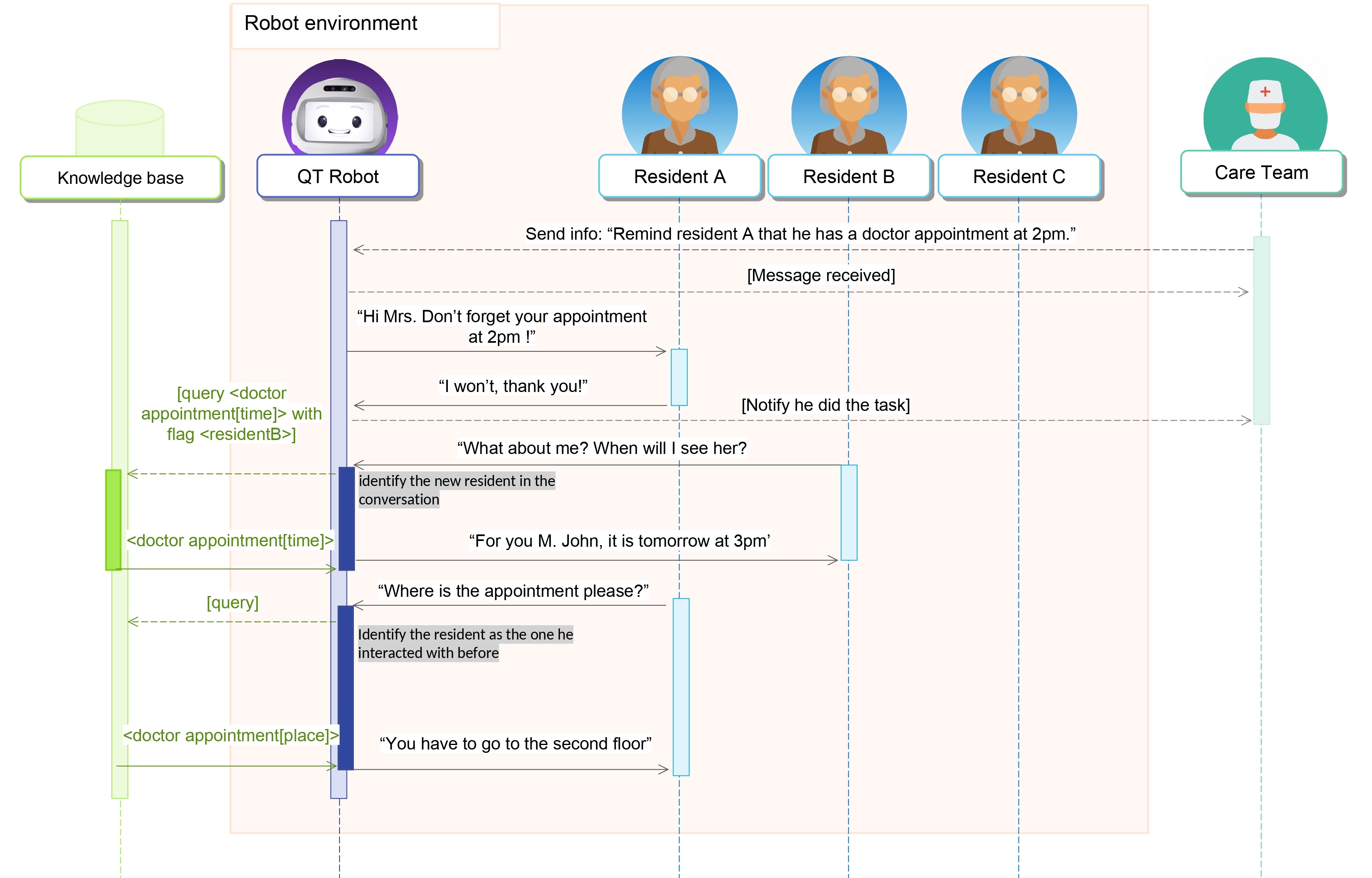

技术框架:HARMONI框架包含四个主要模块:1) 感知模块:负责识别活跃说话者,并提取多模态输入(如语音、视觉信息)。2) 世界建模模块:维护环境和短期对话上下文的表示。3) 用户建模模块:更新长期、特定于说话者的用户画像。4) 生成模块:基于上下文和用户画像,生成符合伦理规范的个性化回复。

关键创新:HARMONI的关键创新在于将大型语言模型与多模态感知和用户建模相结合,实现长期、个性化的多用户人机交互。与传统的基于规则或有限状态机的方法相比,HARMONI具有更强的泛化能力和适应性。

关键设计:感知模块使用语音活动检测和人脸识别技术进行说话者识别。用户建模模块使用LLM对用户的历史交互数据进行编码,并提取用户的偏好和特征。生成模块使用LLM生成回复,并使用伦理约束模块确保回复符合伦理规范。具体参数设置和网络结构在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HARMONI在用户建模准确性、个性化质量和用户满意度方面均优于基线LLM驱动的方法。在疗养院的真实场景用户研究中,用户对HARMONI的个性化交互体验给予了积极评价。具体的性能数据和提升幅度在摘要中有所提及,但未给出具体数值。

🎯 应用场景

HARMONI框架具有广泛的应用前景,例如在养老院中,机器人可以根据老年人的个人喜好和需求提供个性化的陪伴和护理服务。此外,该框架还可以应用于教育、医疗、客户服务等领域,提升人机交互的效率和用户满意度。未来,该研究有望推动社会辅助机器人技术的发展,使其更好地服务于人类社会。

📄 摘要(原文)

Existing human-robot interaction systems often lack mechanisms for sustained personalization and dynamic adaptation in multi-user environments, limiting their effectiveness in real-world deployments. We present HARMONI, a multimodal personalization framework that leverages large language models to enable socially assistive robots to manage long-term multi-user interactions. The framework integrates four key modules: (i) a perception module that identifies active speakers and extracts multimodal input; (ii) a world modeling module that maintains representations of the environment and short-term conversational context; (iii) a user modeling module that updates long-term speaker-specific profiles; and (iv) a generation module that produces contextually grounded and ethically informed responses. Through extensive evaluation and ablation studies on four datasets, as well as a real-world scenario-driven user-study in a nursing home environment, we demonstrate that HARMONI supports robust speaker identification, online memory updating, and ethically aligned personalization, outperforming baseline LLM-driven approaches in user modeling accuracy, personalization quality, and user satisfaction.