Whether We Care, How We Reason: The Dual Role of Anthropomorphism and Moral Foundations in Robot Abuse

作者: Fan Yang, Renkai Ma, Yaxin Hu, Lingyao Li

分类: cs.RO, cs.HC

发布日期: 2026-01-27

💡 一句话要点

研究拟人化程度与道德基础如何影响对机器人虐待的反应

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人伦理 人机交互 拟人化 道德基础 机器人虐待

📋 核心要点

- 核心问题是理解人们对机器人虐待行为的反应,这对于机器人伦理和设计至关重要。

- 该研究的核心思想是考察拟人化程度和道德基础如何共同影响人们对机器人虐待的道德判断。

- 实验结果表明,拟人化程度决定了是否对机器人进行道德考量,而道德基础影响了如何进行道德推理。

📝 摘要(中文)

随着机器人日益融入日常生活,理解人们对机器人虐待行为的反应具有重要的伦理和设计意义。本研究采用混合方法(N = 201),探讨了拟人化程度和道德基础如何塑造人们对机器人虐待的反应。参与者观看了描绘不同拟人化程度(蜘蛛、双足、人形)机器人遭受身体虐待的视频,并完成了评估道德基础、愤怒和社会距离的问卷。结果表明,拟人化程度决定了人们是否会将道德考量扩展到机器人,而道德基础则影响了他们如何对此进行推理。定性分析揭示了不同的推理模式:低进步主义者采用基于角色的判断,而高进步主义者则进行面向未来的道德审议。研究结果为机器人设计和政策沟通提供了启示。

🔬 方法详解

问题定义:该论文旨在解决的问题是:在机器人越来越普及的背景下,人们如何看待和评价虐待机器人的行为?现有的研究缺乏对拟人化程度和个体道德观念差异的综合考虑,无法全面解释人们对机器人虐待行为的不同反应。

核心思路:论文的核心思路是结合拟人化程度和道德基础这两个维度来分析人们对机器人虐待行为的反应。作者认为,拟人化程度会影响人们是否将机器人视为具有道德价值的对象,而个体的道德基础会影响他们如何对虐待行为进行道德推理。

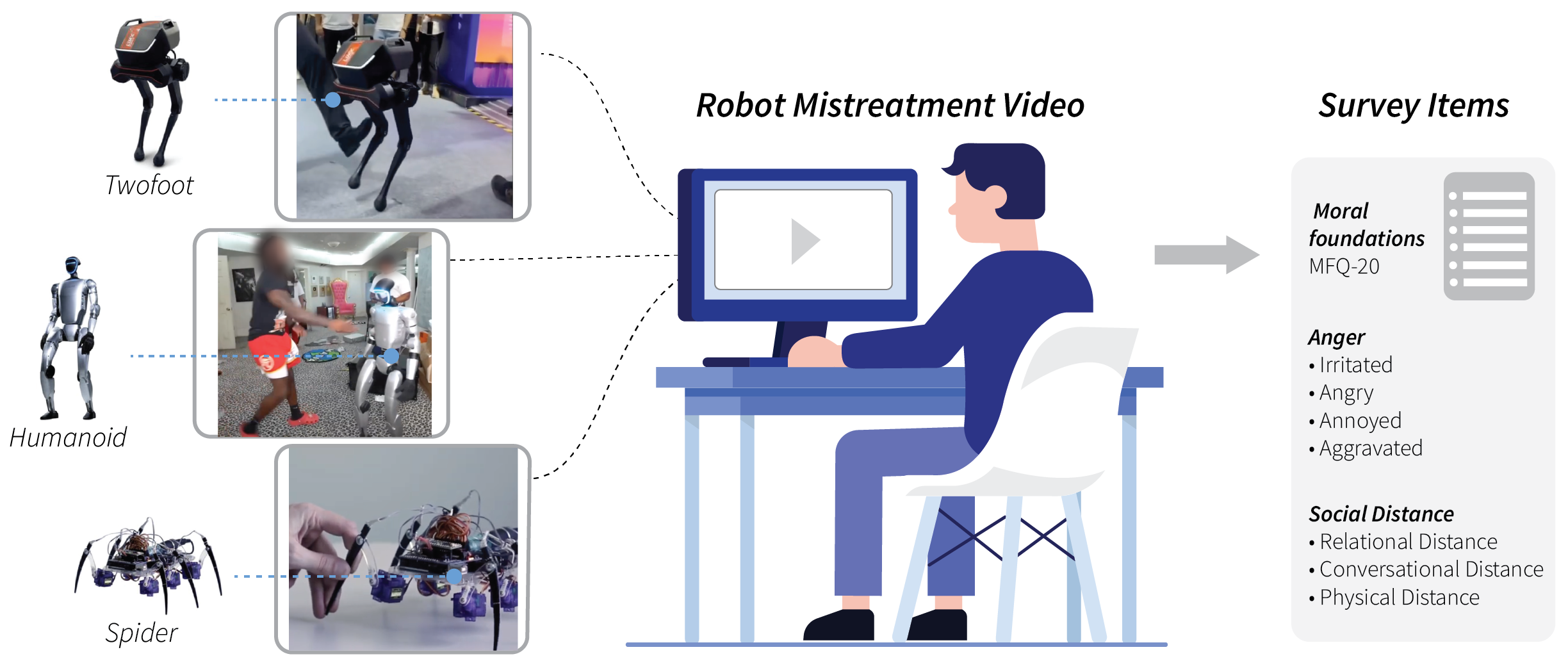

技术框架:该研究采用混合方法,包括定量研究和定性研究。定量研究部分,参与者观看不同拟人化程度(蜘蛛、双足、人形)的机器人被虐待的视频,然后填写问卷,评估他们的道德基础、愤怒程度和社会距离。定性研究部分,作者对参与者的开放式回答进行分析,以了解他们对机器人虐待行为的推理模式。

关键创新:该研究的关键创新在于将拟人化程度和道德基础这两个因素结合起来,全面分析了人们对机器人虐待行为的反应。此外,该研究还通过定性分析揭示了不同道德倾向的个体在道德推理方面的差异。

关键设计:实验中,机器人被设计成三种不同的拟人化程度:蜘蛛、双足和人形。道德基础采用Moral Foundations Questionnaire (MFQ)进行评估。通过分析参与者对不同拟人化程度机器人的反应以及他们的道德基础得分,研究人员可以了解这两个因素如何影响人们对机器人虐待行为的道德判断。

🖼️ 关键图片

📊 实验亮点

研究结果表明,拟人化程度越高,人们对机器人虐待行为的愤怒程度越高。此外,研究还发现,具有不同道德基础的人在对机器人虐待行为进行道德推理时存在差异。低进步主义者倾向于进行基于角色的判断,而高进步主义者则倾向于进行面向未来的道德审议。

🎯 应用场景

该研究的潜在应用领域包括机器人伦理、人机交互设计和公共政策制定。研究结果可以帮助设计师设计更符合伦理规范的机器人,并帮助政策制定者制定更合理的机器人管理政策。此外,该研究还可以促进公众对机器人伦理问题的讨论和反思。

📄 摘要(原文)

As robots become increasingly integrated into daily life, understanding responses to robot mistreatment carries important ethical and design implications. This mixed-methods study (N = 201) examined how anthropomorphic levels and moral foundations shape reactions to robot abuse. Participants viewed videos depicting physical mistreatment of robots varying in humanness (Spider, Twofoot, Humanoid) and completed measures assessing moral foundations, anger, and social distance. Results revealed that anthropomorphism determines whether people extend moral consideration to robots, while moral foundations shape how they reason about such consideration. Qualitative analysis revealed distinct reasoning patterns: low-progressivism individuals employed character-based judgments, while high-progressivism individuals engaged in future-oriented moral deliberation. Findings offer implications for robot design and policy communication.