PALM: Enhanced Generalizability for Local Visuomotor Policies via Perception Alignment

作者: Ruiyu Wang, Zheyu Zhuang, Danica Kragic, Florian T. Pokorny

分类: cs.RO

发布日期: 2026-01-27

期刊: IEEE Robotics and Automation Letters 2026

💡 一句话要点

PALM:通过感知对齐增强局部视觉运动策略的泛化能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 行为克隆 泛化能力 视觉运动策略 感知对齐 机器人操作

📋 核心要点

- 现有基于图像的行为克隆方法在泛化性方面存在不足,难以应对工作空间偏移、视点变化等问题。

- PALM利用局部动作分布的不变性,通过感知对齐减少领域内和OOD输入之间的差异,提升泛化能力。

- 实验结果表明,PALM在模拟和真实世界中均显著降低了OOD场景下的性能下降,优于现有基线方法。

📝 摘要(中文)

在基于图像的行为克隆中,泛化到训练领域之外仍然具有挑战性。现有方法分别处理泛化的各个方面,如工作空间偏移、视点变化和跨具身转移,但它们通常是孤立开发的,并且依赖于复杂的流程。我们提出了PALM(用于局部操作的感知对齐),它利用分布外(OOD)和演示领域之间局部动作分布的不变性,同时解决这些OOD偏移,无需额外的输入模态、模型更改或数据收集。PALM将操作策略模块化为粗略的全局组件和用于精细动作的局部策略。我们通过强制局部视觉关注和一致的本体感受表示来减少领域内和OOD输入在局部策略层面的差异,从而使策略能够在OOD条件下检索不变的局部动作。实验表明,与基线相比,PALM将模拟中的OOD性能下降限制在8%,真实世界中限制在24%,而基线分别为45%和77%。

🔬 方法详解

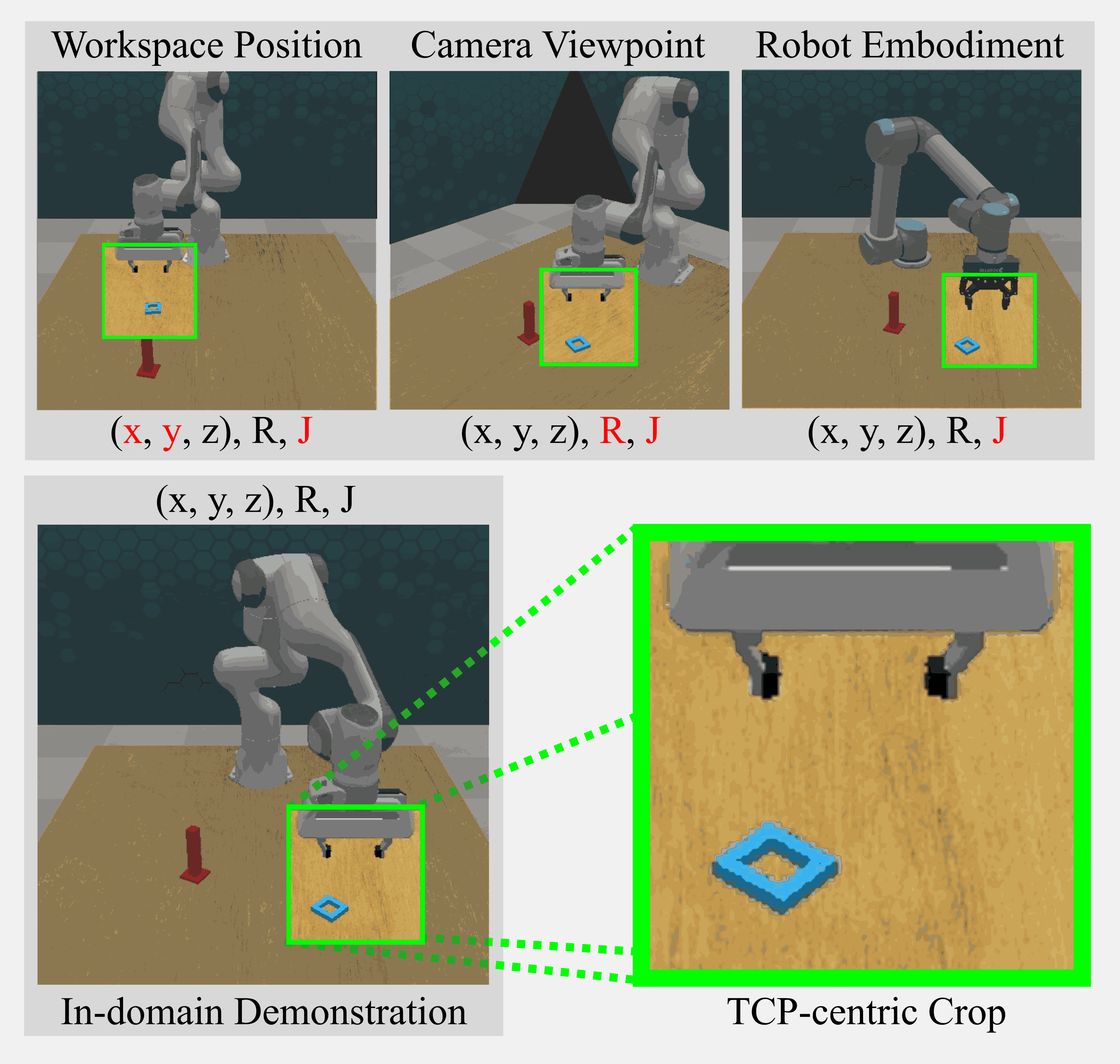

问题定义:现有基于图像的行为克隆方法在泛化性方面存在挑战,尤其是在面对分布外(OOD)数据时,性能会显著下降。现有的方法通常针对特定的泛化轴(如工作空间偏移、视点变化)进行优化,缺乏通用性,并且往往需要复杂的流程或额外的数据模态。

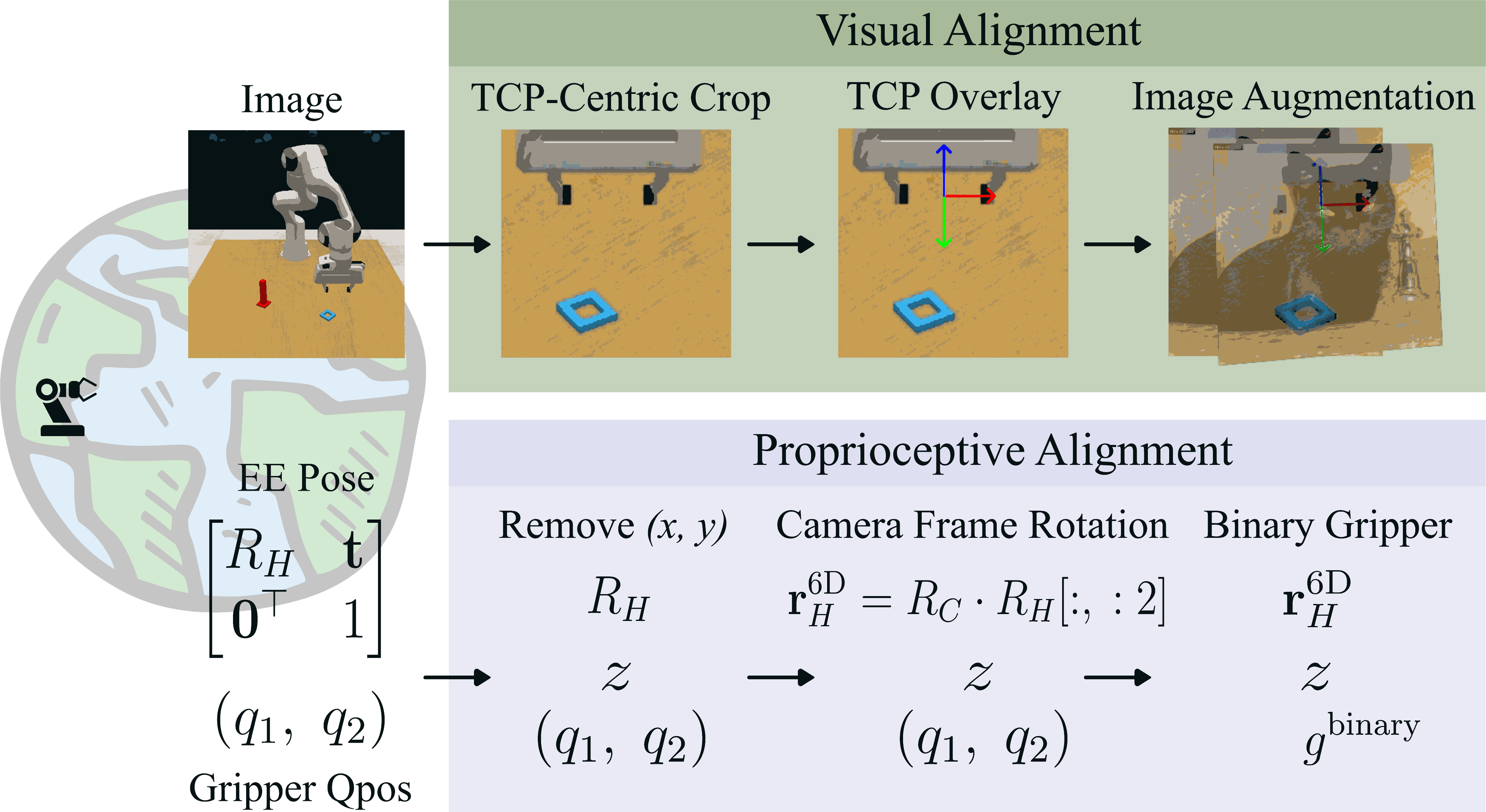

核心思路:PALM的核心思路是利用局部动作分布在不同领域之间的不变性。即使在OOD情况下,局部操作的动作分布可能仍然与训练数据相似。通过对局部视觉信息和本体感受信息进行对齐,可以使策略在OOD情况下也能检索到正确的局部动作。

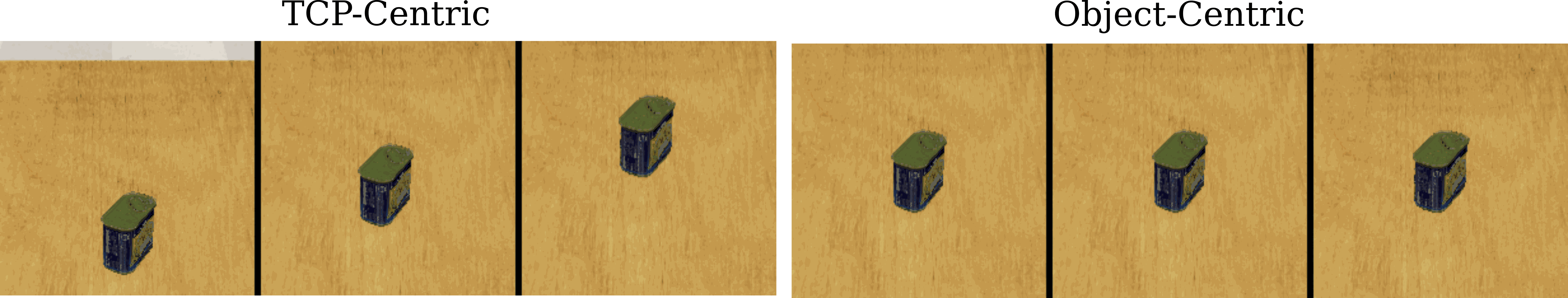

技术框架:PALM将操作策略分解为两个模块:全局组件和局部策略。全局组件负责粗略的动作规划,局部策略负责精细的动作执行。局部策略接收裁剪后的局部图像和本体感受信息作为输入,输出局部动作。通过感知对齐,减小局部策略在不同领域之间的差异。

关键创新:PALM的关键创新在于利用局部动作分布的不变性,并通过感知对齐来增强局部策略的泛化能力。与现有方法相比,PALM不需要额外的输入模态、模型更改或数据收集,就能同时解决多个泛化问题。

关键设计:PALM的关键设计包括:1) 局部视觉关注机制,通过裁剪局部图像来减少无关信息的干扰;2) 一致的本体感受表示,确保本体感受信息在不同领域之间的一致性;3) 损失函数的设计,用于鼓励局部策略学习不变的局部动作分布。具体的网络结构和参数设置在论文中有详细描述,但未在摘要中明确指出。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PALM在模拟环境中将OOD性能下降限制在8%,显著优于基线的45%。在真实世界中,PALM将OOD性能下降限制在24%,而基线则高达77%。这些结果表明,PALM能够有效地提升局部视觉运动策略的泛化能力,使其在各种OOD场景中都能保持良好的性能。

🎯 应用场景

PALM具有广泛的应用前景,可用于提升机器人操作在各种实际场景中的鲁棒性和泛化能力。例如,在家庭服务机器人中,PALM可以帮助机器人适应不同的厨房环境和物体摆放,从而更可靠地完成任务。此外,PALM还可以应用于工业自动化、医疗机器人等领域,提高机器人的智能化水平和适应性。

📄 摘要(原文)

Generalizing beyond the training domain in image-based behavior cloning remains challenging. Existing methods address individual axes of generalization, workspace shifts, viewpoint changes, and cross-embodiment transfer, yet they are typically developed in isolation and often rely on complex pipelines. We introduce PALM (Perception Alignment for Local Manipulation), which leverages the invariance of local action distributions between out-of-distribution (OOD) and demonstrated domains to address these OOD shifts concurrently, without additional input modalities, model changes, or data collection. PALM modularizes the manipulation policy into coarse global components and a local policy for fine-grained actions. We reduce the discrepancy between in-domain and OOD inputs at the local policy level by enforcing local visual focus and consistent proprioceptive representation, allowing the policy to retrieve invariant local actions under OOD conditions. Experiments show that PALM limits OOD performance drops to 8% in simulation and 24% in the real world, compared to 45% and 77% for baselines.