Reinforcement Learning Goal-Reaching Control with Guaranteed Lyapunov-Like Stabilizer for Mobile Robots

作者: Mehdi Heydari Shahna, Seyed Adel Alizadeh Kolagar, Jouni Mattila

分类: cs.RO

发布日期: 2026-01-27

💡 一句话要点

提出一种基于强化学习和Lyapunov稳定器的移动机器人目标导向控制方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 目标导向控制 移动机器人 Lyapunov稳定性 安全控制

📋 核心要点

- 传统强化学习在目标导向控制中缺乏形式化的目标可达保证,难以满足安全性要求。

- 该方法结合强化学习和类Lyapunov稳定器,强化学习负责探索,稳定器提供安全保障,实现有效控制。

- 实验表明,该方法显著提升了目标到达率,从84.6%提升至99.0%,并减少了失败次数。

📝 摘要(中文)

本文提出了一种基于强化学习(RL)的控制框架,为在非结构化环境中运行的轮式移动机器人提供正式的目标导向保证。首先,设计了一个实时的RL策略,其中包含15个精心设计的奖励项,鼓励机器人到达静态和动态目标,同时生成足够平滑的命令信号,以符合预定义的安全性规范。其次,将类Lyapunov稳定器层集成到基准RL框架中,作为策略监督器,以正式加强目标导向控制,同时保留状态-动作空间的有意义的探索。该框架适用于在具有挑战性的环境中进行实时部署,因为它提供了收敛到预期目标状态的正式保证,并通过生成基于当前状态的实时控制信号来补偿不确定性,同时尊重实际的运动约束。实验结果表明,所提出的类Lyapunov稳定器始终改进基准RL策略,将目标到达率从84.6%提高到99.0%,显著减少了失败,并提高了效率。

🔬 方法详解

问题定义:现有强化学习方法在移动机器人目标导向控制中,虽然能够学习到有效的策略,但通常缺乏形式化的保证,无法确保机器人一定能到达目标点,尤其是在复杂或动态环境中。此外,直接应用强化学习可能导致控制信号不稳定,不符合实际机器人的运动约束。

核心思路:该论文的核心思路是将强化学习与类Lyapunov稳定器相结合。强化学习负责学习高效的控制策略,而类Lyapunov稳定器则作为策略监督器,确保机器人的运动轨迹满足安全约束,并最终收敛到目标点。这种结合既能利用强化学习的自适应能力,又能保证控制系统的稳定性。

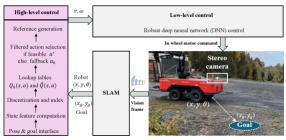

技术框架:该框架包含两个主要模块:强化学习策略模块和类Lyapunov稳定器模块。强化学习策略模块使用包含15个奖励项的奖励函数,鼓励机器人到达目标并生成平滑的控制信号。类Lyapunov稳定器模块则监控强化学习策略的输出,并在必要时进行干预,以确保系统的稳定性和安全性。整体流程是,强化学习策略生成控制指令,稳定器对指令进行校正,最终控制机器人运动。

关键创新:该方法最重要的创新在于将强化学习与类Lyapunov稳定器有机结合,既利用了强化学习的探索能力,又保证了控制系统的稳定性。这种结合克服了传统强化学习方法缺乏形式化保证的缺点,也避免了传统控制方法在复杂环境中适应性差的问题。

关键设计:奖励函数的设计是关键,包含了多种奖励项,例如到达目标的奖励、避免碰撞的惩罚、控制信号平滑性的奖励等。类Lyapunov稳定器的具体形式需要根据机器人动力学模型进行设计,以确保其能够有效地稳定系统。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的类Lyapunov稳定器能够显著提高基准RL策略的性能。具体来说,目标到达率从84.6%提高到99.0%,表明该方法能够有效地保证机器人的目标可达性。此外,该方法还显著减少了失败次数,并提高了控制效率,验证了其在实际应用中的价值。

🎯 应用场景

该研究成果可应用于各种需要安全可靠的目标导向控制的移动机器人应用中,例如自主导航、物流运输、搜索救援等。通过结合强化学习的自适应能力和Lyapunov稳定器的安全性保证,可以使机器人在复杂和不确定的环境中安全高效地完成任务。未来,该方法可以扩展到更复杂的机器人系统和更具挑战性的环境。

📄 摘要(原文)

Reinforcement learning (RL) can be highly effective at learning goal-reaching policies, but it typically does not provide formal guarantees that the goal will always be reached. A common approach to provide formal goal-reaching guarantees is to introduce a shielding mechanism that restricts the agent to actions that satisfy predefined safety constraints. The main challenge here is integrating this mechanism with RL so that learning and exploration remain effective without becoming overly conservative. Hence, this paper proposes an RL-based control framework that provides formal goal-reaching guarantees for wheeled mobile robots operating in unstructured environments. We first design a real-time RL policy with a set of 15 carefully defined reward terms. These rewards encourage the robot to reach both static and dynamic goals while generating sufficiently smooth command signals that comply with predefined safety specifications, which is critical in practice. Second, a Lyapunov-like stabilizer layer is integrated into the benchmark RL framework as a policy supervisor to formally strengthen the goal-reaching control while preserving meaningful exploration of the state action space. The proposed framework is suitable for real-time deployment in challenging environments, as it provides a formal guarantee of convergence to the intended goal states and compensates for uncertainties by generating real-time control signals based on the current state, while respecting real-world motion constraints. The experimental results show that the proposed Lyapunov-like stabilizer consistently improves the benchmark RL policies, boosting the goal-reaching rate from 84.6% to 99.0%, sharply reducing failures, and improving efficiency.