Sim-and-Human Co-training for Data-Efficient and Generalizable Robotic Manipulation

作者: Kaipeng Fang, Weiqing Liang, Yuyang Li, Ji Zhang, Pengpeng Zeng, Lianli Gao, Jingkuan Song, Heng Tao Shen

分类: cs.RO, cs.AI

发布日期: 2026-01-27

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SimHum:模拟与人类协同训练,提升机器人操作的数据效率和泛化性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 机器人操作 协同训练 模拟数据 人类数据 数据效率 泛化能力 运动学先验 视觉先验

📋 核心要点

- 机器人数据收集成本高昂,模拟数据存在与真实世界的视觉差距,人类数据存在与机器人的具身差距。

- SimHum 框架利用模拟数据提供机器人动作,人类数据提供真实世界观察,两者互补,协同训练。

- 实验表明,SimHum 在数据效率和泛化性方面均优于基线方法,仅用少量真实数据即可达到较高成功率。

📝 摘要(中文)

合成模拟数据和真实世界的人类数据为解决机器人数据收集的高昂成本提供了可扩展的替代方案。然而,这些数据源分别受到模拟到真实视觉差距和人类到机器人具身差距的限制,从而限制了策略在真实世界场景中的泛化能力。在这项工作中,我们发现这些数据源之间存在一种自然但未被充分利用的互补性:模拟提供人类数据所缺乏的机器人动作,而人类数据提供模拟难以渲染的真实世界观察。受此启发,我们提出了 SimHum,一个协同训练框架,用于同时从模拟机器人动作中提取运动学先验,并从真实世界的人类观察中提取视觉先验。基于这两个互补的先验,我们在真实世界的任务中实现了数据高效且可泛化的机器人操作。实验结果表明,在相同的数据收集预算下,SimHum 的性能优于基线高达 40%,并且仅使用 80 个真实数据就实现了 62.5% 的 OOD 成功率,比仅使用真实数据的基线高出 7.1 倍。

🔬 方法详解

问题定义:论文旨在解决机器人操作任务中,数据收集成本高昂以及模拟数据和人类数据各自存在局限性的问题。现有方法要么依赖大量真实数据,要么难以克服模拟到真实的差距或人类到机器人的差距,导致泛化能力不足。

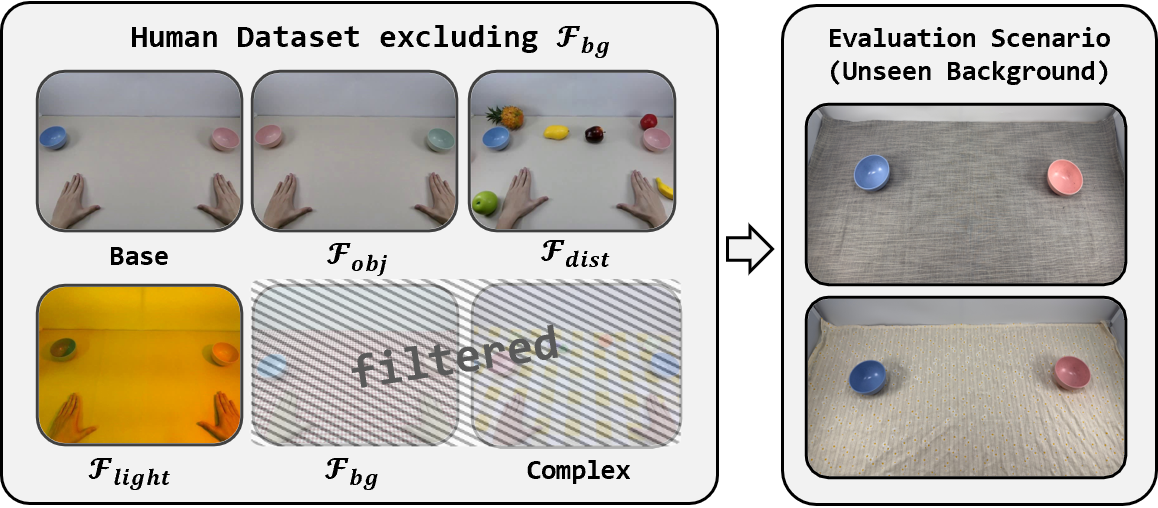

核心思路:论文的核心思路是利用模拟数据和人类数据的互补性。模拟数据擅长生成机器人动作,但视觉真实感不足;人类数据提供真实的视觉信息,但缺乏对应的机器人动作。通过协同训练,SimHum 框架能够从模拟数据中学习运动学先验,从人类数据中学习视觉先验,从而提升策略的泛化能力。

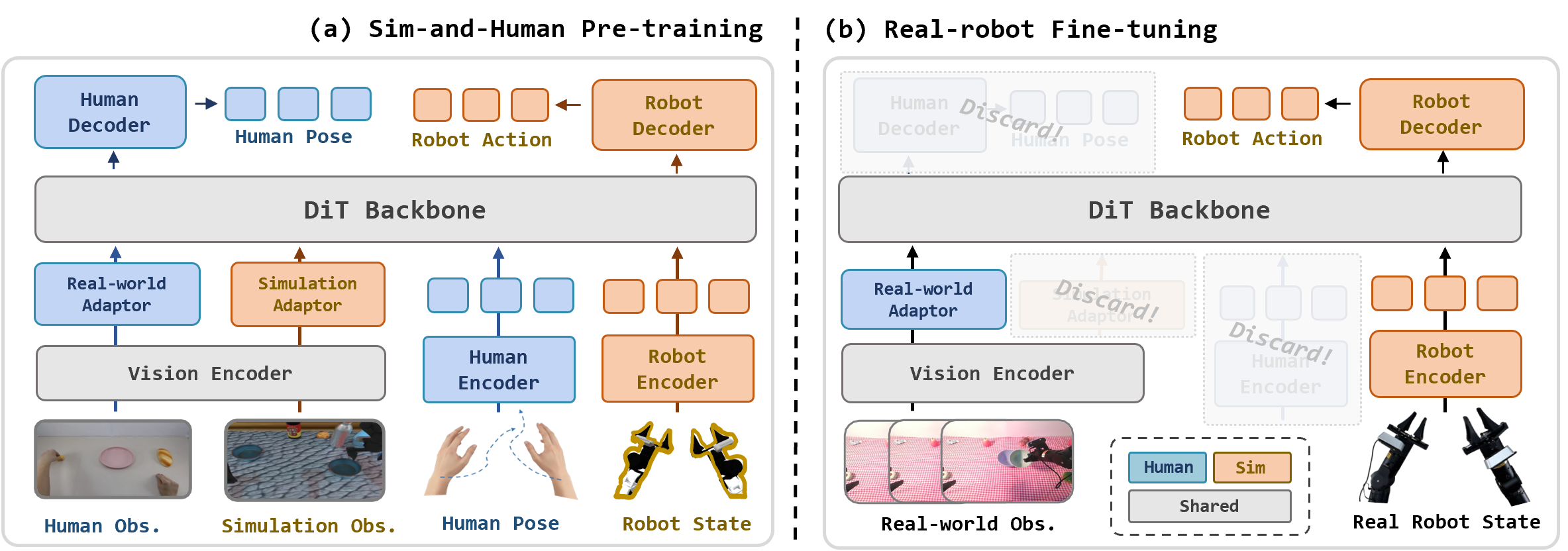

技术框架:SimHum 框架包含两个主要分支:模拟分支和人类分支。模拟分支利用模拟数据训练策略网络,学习机器人动作的运动学先验。人类分支利用人类数据训练视觉感知网络,学习真实世界的视觉先验。两个分支通过共享特征或损失函数进行协同训练,从而将运动学先验和视觉先验融合到最终的策略网络中。

关键创新:SimHum 的关键创新在于发现了模拟数据和人类数据在机器人操作任务中的互补性,并设计了一个协同训练框架来有效地利用这种互补性。与以往方法相比,SimHum 不需要大量的真实数据,并且能够更好地克服模拟到真实的差距和人类到机器人的差距。

关键设计:具体的协同训练方式(例如,共享哪些特征,使用什么损失函数来对齐两个分支)是关键的设计选择。论文可能采用了对比学习、领域对抗训练等技术来减小模拟数据和人类数据之间的差异。此外,网络结构的设计(例如,使用什么样的卷积神经网络或Transformer)以及训练参数的设置也会影响最终的性能。

🖼️ 关键图片

📊 实验亮点

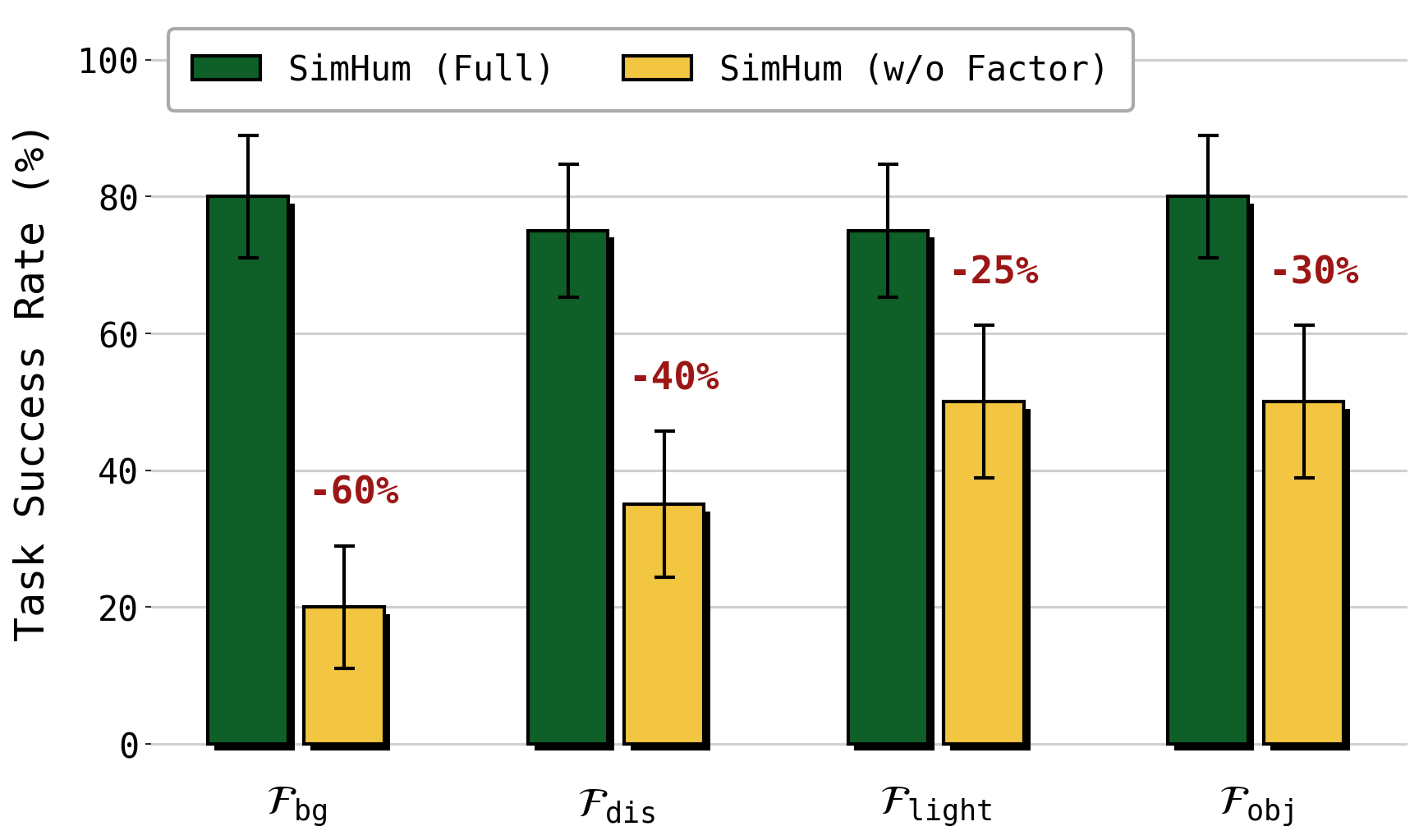

SimHum 框架在机器人操作任务中表现出色,在相同数据收集预算下,性能优于基线高达 40%。更重要的是,仅使用 80 个真实数据,SimHum 就能实现 62.5% 的 OOD 成功率,比仅使用真实数据的基线高出 7.1 倍。这些实验结果充分证明了 SimHum 框架在数据效率和泛化性方面的优势。

🎯 应用场景

SimHum 框架可应用于各种机器人操作任务,例如物体抓取、装配、导航等。该研究成果有助于降低机器人学习的成本,提高机器人在真实世界环境中的适应性和泛化能力。未来,该方法可以推广到更复杂的机器人任务和更广泛的机器人应用场景,例如智能制造、家庭服务、医疗辅助等。

📄 摘要(原文)

Synthetic simulation data and real-world human data provide scalable alternatives to circumvent the prohibitive costs of robot data collection. However, these sources suffer from the sim-to-real visual gap and the human-to-robot embodiment gap, respectively, which limits the policy's generalization to real-world scenarios. In this work, we identify a natural yet underexplored complementarity between these sources: simulation offers the robot action that human data lacks, while human data provides the real-world observation that simulation struggles to render. Motivated by this insight, we present SimHum, a co-training framework to simultaneously extract kinematic prior from simulated robot actions and visual prior from real-world human observations. Based on the two complementary priors, we achieve data-efficient and generalizable robotic manipulation in real-world tasks. Empirically, SimHum outperforms the baseline by up to $\mathbf{40\%}$ under the same data collection budget, and achieves a $\mathbf{62.5\%}$ OOD success with only 80 real data, outperforming the real only baseline by $7.1\times$. Videos and additional information can be found at \href{https://kaipengfang.github.io/sim-and-human}{project website}.