Neuromorphic BrailleNet: Accurate and Generalizable Braille Reading Beyond Single Characters through Event-Based Optical Tactile Sensing

作者: Naqash Afzal, Niklas Funk, Erik Helmut, Jan Peters, Benjamin Ward-Cherrier

分类: cs.RO

发布日期: 2026-01-27

💡 一句话要点

提出基于事件相机的Neuromorphic BrailleNet,实现高精度、通用盲文阅读

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 神经形态计算 事件相机 盲文阅读 触觉感知 机器人 ResNet 时空分割

📋 核心要点

- 传统盲文阅读器依赖逐字符扫描,速度受限且不自然;视觉方法计算量大,延迟高,真实场景表现差。

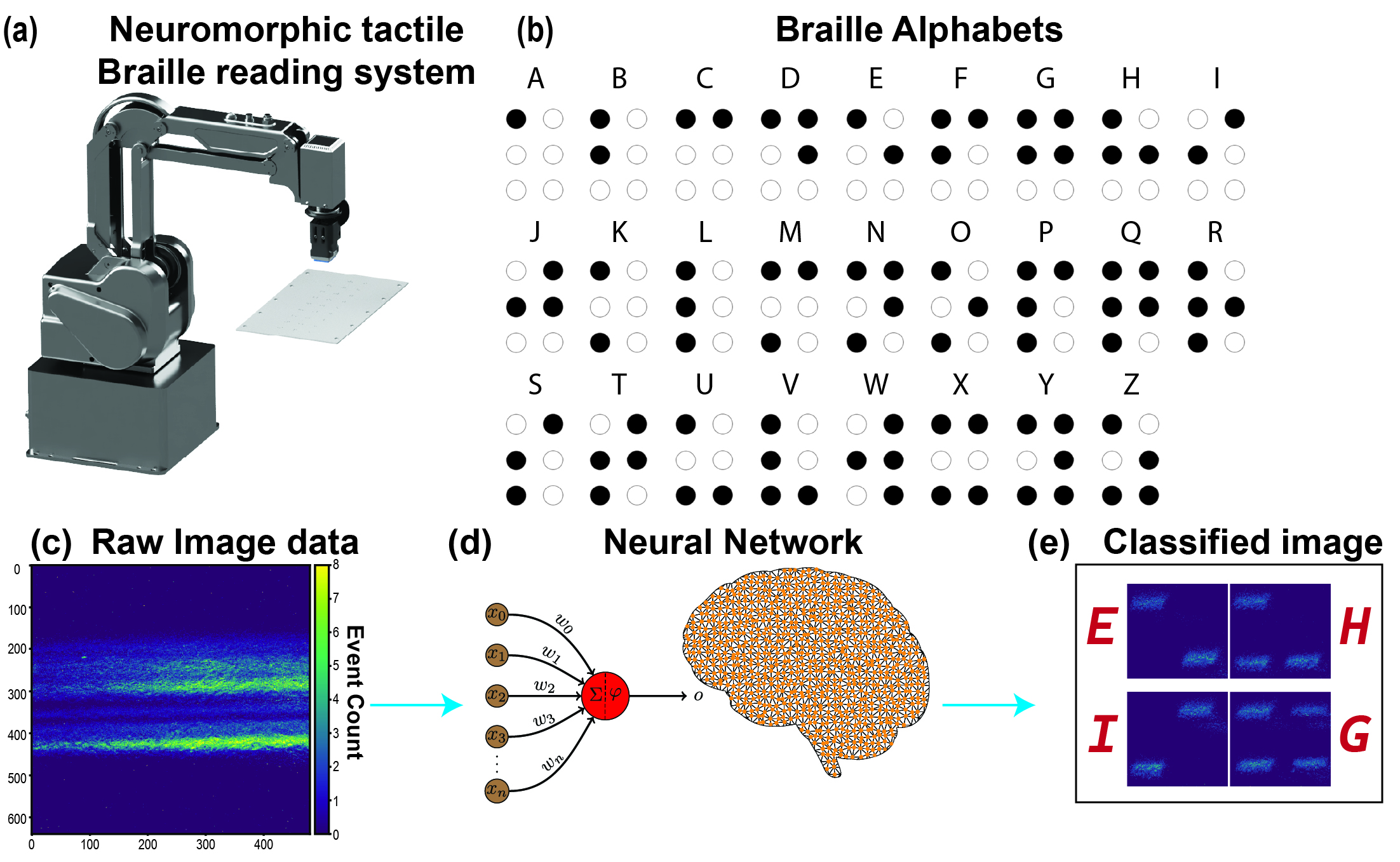

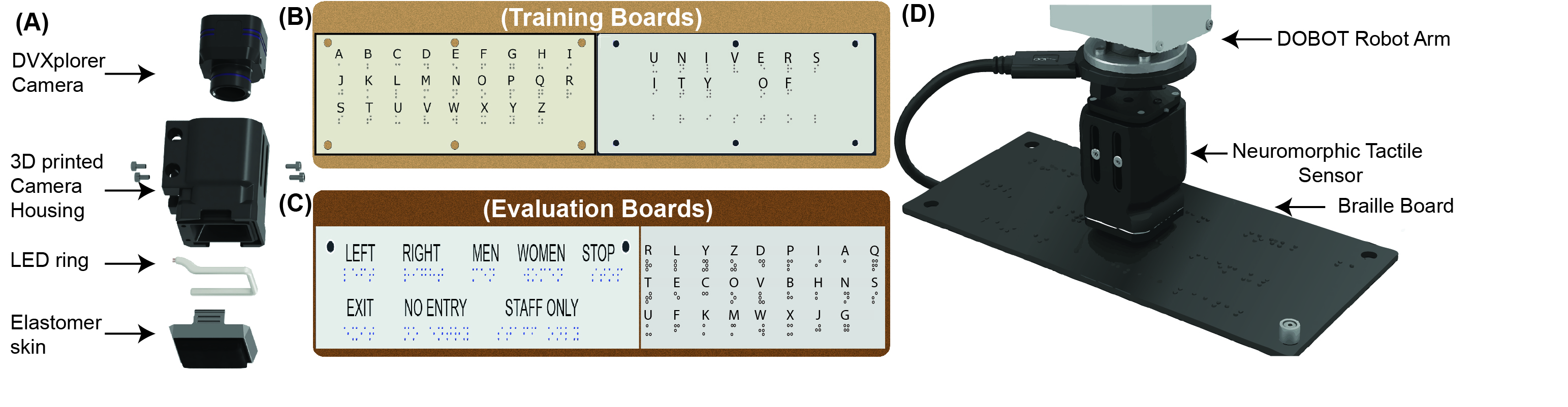

- 利用神经形态事件相机Evetac,直接编码动态接触事件,模仿人类手指扫描,实现连续盲文识别。

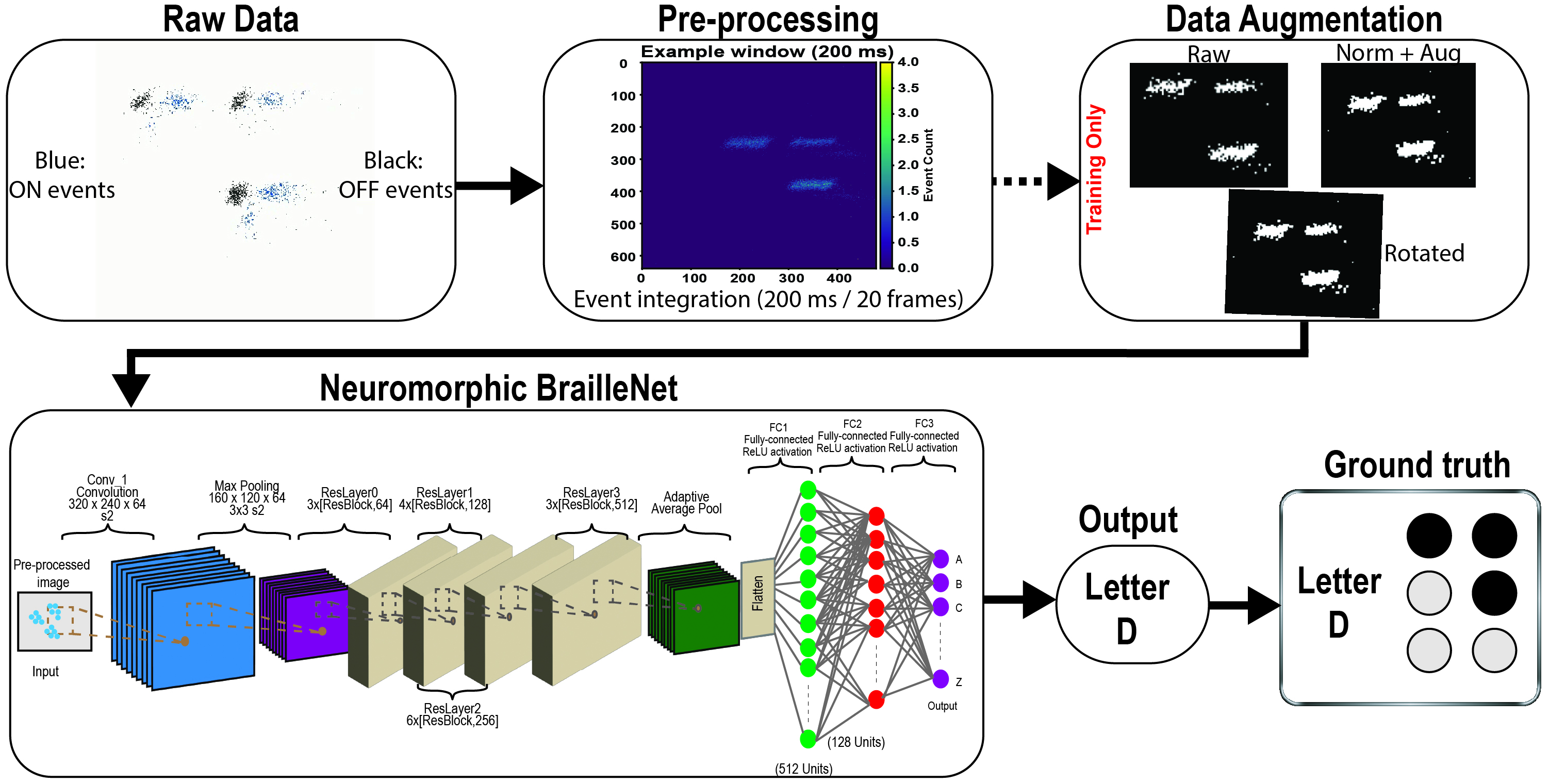

- 结合时空分割和轻量级ResNet分类器,处理稀疏事件流,在不同深度和速度下实现高精度字符识别。

📝 摘要(中文)

本文提出了一种高精度、实时的盲文连续识别流水线,该流水线使用开源神经形态事件相机Evetac。与基于帧的视觉系统不同,神经形态触觉模态直接编码连续滑动过程中的动态接触事件,模仿人类手指扫描策略。该方法结合了时空分割和基于ResNet的轻量级分类器来处理稀疏事件流,从而实现对不同压痕深度和扫描速度的鲁棒字符识别。在标准深度下,该系统实现了接近完美的准确率(>=98%),可推广到多个盲文板布局,并在快速扫描下保持强大的性能。在一个包含日常生活词汇的物理盲文板上,该系统达到了超过90%的单词级准确率,证明了其对传统方法构成挑战的时间压缩效应的鲁棒性。这些结果表明,神经形态触觉传感是一种可扩展、低延迟的机器人盲文阅读解决方案,对辅助和机器人应用中的触觉感知具有更广泛的意义。

🔬 方法详解

问题定义:现有机器人盲文阅读器通常采用离散的、逐字符扫描的方式,导致阅读速度慢,且破坏了自然的阅读流程。基于视觉的盲文阅读方法虽然可以实现连续阅读,但通常需要大量的计算资源,引入较高的延迟,并且在实际应用场景中的性能会显著下降,例如光照变化、遮挡等因素的影响。因此,如何实现低延迟、高精度、鲁棒的连续盲文阅读是一个重要的挑战。

核心思路:本文的核心思路是利用神经形态事件相机Evetac,模拟人类手指的触觉感知方式,通过连续滑动来感知盲文点阵。事件相机能够直接捕捉动态的接触事件,产生稀疏的事件流,避免了传统视觉方法中图像采集和处理的延迟。同时,通过设计合适的时空分割和分类算法,可以从事件流中提取有效的特征,实现对盲文字符的准确识别。

技术框架:该系统的整体框架包括以下几个主要模块:1) 事件相机Evetac:用于采集盲文点阵的动态接触事件,生成事件流。2) 时空分割:将事件流分割成独立的字符事件片段。3) 特征提取:从每个字符事件片段中提取时空特征。4) 分类器:使用ResNet-based的轻量级分类器对提取的特征进行分类,识别盲文字符。

关键创新:该论文的关键创新在于将神经形态事件相机应用于盲文阅读,并设计了相应的时空分割和分类算法。与传统的视觉方法相比,该方法具有低延迟、高精度和鲁棒性的优点。此外,该方法能够模拟人类手指的触觉感知方式,实现连续的盲文阅读。

关键设计:在时空分割方面,论文采用了一种基于事件密度的自适应分割算法,能够根据事件流的密度动态调整分割窗口的大小。在分类器方面,论文采用了一个轻量级的ResNet网络,以减少计算量和延迟。此外,论文还对网络结构和训练参数进行了优化,以提高分类精度和泛化能力。具体的参数设置和损失函数等技术细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

该系统在标准深度下实现了接近完美的准确率(>=98%),并且能够推广到多个盲文板布局。在快速扫描条件下,系统仍然保持了强大的性能。在一个包含日常生活词汇的物理盲文板上,该系统达到了超过90%的单词级准确率,证明了其对时间压缩效应的鲁棒性。这些结果表明,神经形态触觉传感是一种有前景的机器人盲文阅读解决方案。

🎯 应用场景

该研究成果可应用于开发新型的机器人盲文阅读器,提高盲人阅读效率和体验。此外,神经形态触觉传感技术还可扩展到其他触觉感知领域,如机器人抓取、物体识别、表面纹理感知等,为机器人提供更丰富的感觉信息,使其能够更好地与环境交互。该技术在辅助技术、机器人自动化、人机交互等领域具有广阔的应用前景。

📄 摘要(原文)

Conventional robotic Braille readers typically rely on discrete, character-by-character scanning, limiting reading speed and disrupting natural flow. Vision-based alternatives often require substantial computation, introduce latency, and degrade in real-world conditions. In this work, we present a high accuracy, real-time pipeline for continuous Braille recognition using Evetac, an open-source neuromorphic event-based tactile sensor. Unlike frame-based vision systems, the neuromorphic tactile modality directly encodes dynamic contact events during continuous sliding, closely emulating human finger-scanning strategies. Our approach combines spatiotemporal segmentation with a lightweight ResNet-based classifier to process sparse event streams, enabling robust character recognition across varying indentation depths and scanning speeds. The proposed system achieves near-perfect accuracy (>=98%) at standard depths, generalizes across multiple Braille board layouts, and maintains strong performance under fast scanning. On a physical Braille board containing daily-living vocabulary, the system attains over 90% word-level accuracy, demonstrating robustness to temporal compression effects that challenge conventional methods. These results position neuromorphic tactile sensing as a scalable, low latency solution for robotic Braille reading, with broader implications for tactile perception in assistive and robotic applications.