ExoGS: A 4D Real-to-Sim-to-Real Framework for Scalable Manipulation Data Collection

作者: Yiming Wang, Ruogu Zhang, Minyang Li, Hao Shi, Junbo Wang, Deyi Li, Jieji Ren, Wenhai Liu, Weiming Wang, Hao-Shu Fang

分类: cs.RO

发布日期: 2026-01-26

🔗 代码/项目: GITHUB

💡 一句话要点

ExoGS:一种可扩展操作数据收集的4D实-仿-实框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人操作 实-仿-实 数据增强 高斯溅射 外骨骼 策略学习 域适应

📋 核心要点

- 现有实-仿-实方法主要关注环境级别的视觉迁移,忽略了交互的迁移,这对于接触丰富的任务来说尤其具有挑战性。

- ExoGS通过机器人同构外骨骼AirExo-3捕获真实世界中的静态环境和动态交互,并将其转化为可编辑的3D高斯溅射资产。

- 实验结果表明,ExoGS显著提高了数据效率和策略泛化能力,优于基于遥操作的基线方法。

📝 摘要(中文)

本文提出ExoGS,一个机器人操作的4D实-仿-实框架,旨在解决可扩展数据收集问题。该框架能够捕获真实世界中的静态环境和动态交互,并无缝转移到模拟环境中,为可扩展的操作数据收集和策略学习提供了一种新的解决方案。ExoGS采用自设计的机器人同构被动外骨骼AirExo-3,以毫米级精度捕获运动学一致的轨迹,并在人类演示期间同步RGB观测。机器人、物体和环境被重建为可编辑的3D高斯溅射资产,从而实现几何一致的重放和大规模数据增强。此外,轻量级的Mask Adapter将实例级语义注入到策略中,以增强视觉域偏移下的鲁棒性。真实世界的实验表明,与基于遥操作的基线相比,ExoGS显著提高了数据效率和策略泛化能力。代码和硬件文件已在https://github.com/zaixiabalala/ExoGS上发布。

🔬 方法详解

问题定义:现有机器人操作的实-仿-实方法主要集中在环境的视觉迁移,忽略了真实世界交互过程的迁移,尤其是在接触丰富的任务中,交互数据的获取和迁移非常困难。纯粹在仿真环境中生成这些交互数据效率低下,且难以保证真实性。

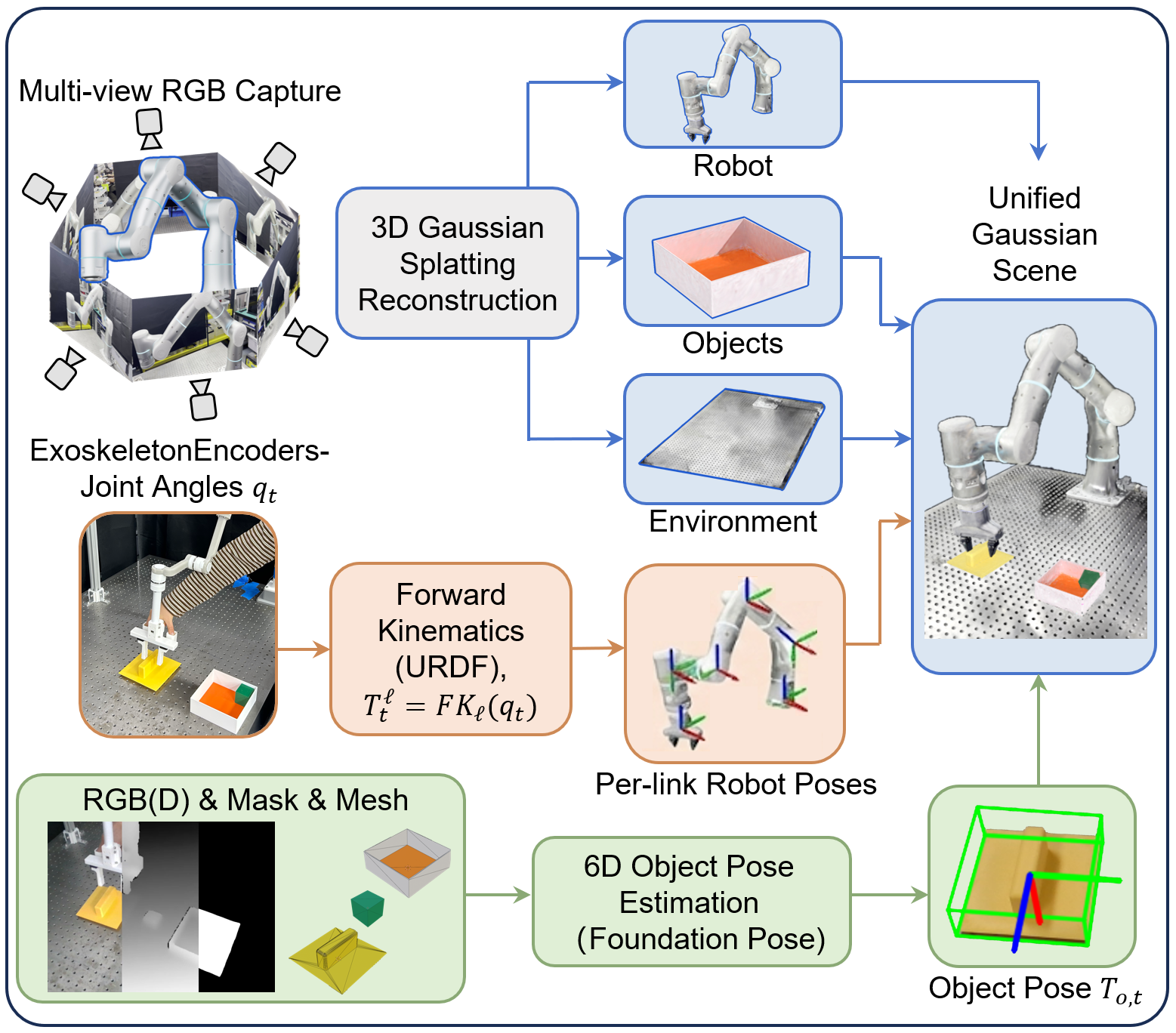

核心思路:ExoGS的核心思路是利用机器人同构的被动外骨骼AirExo-3,直接从人类演示中捕获运动学一致的轨迹和同步的RGB观测。然后,将机器人、物体和环境重建为可编辑的3D高斯溅射(3D Gaussian Splatting)资产,从而实现几何一致的重放和大规模数据增强。

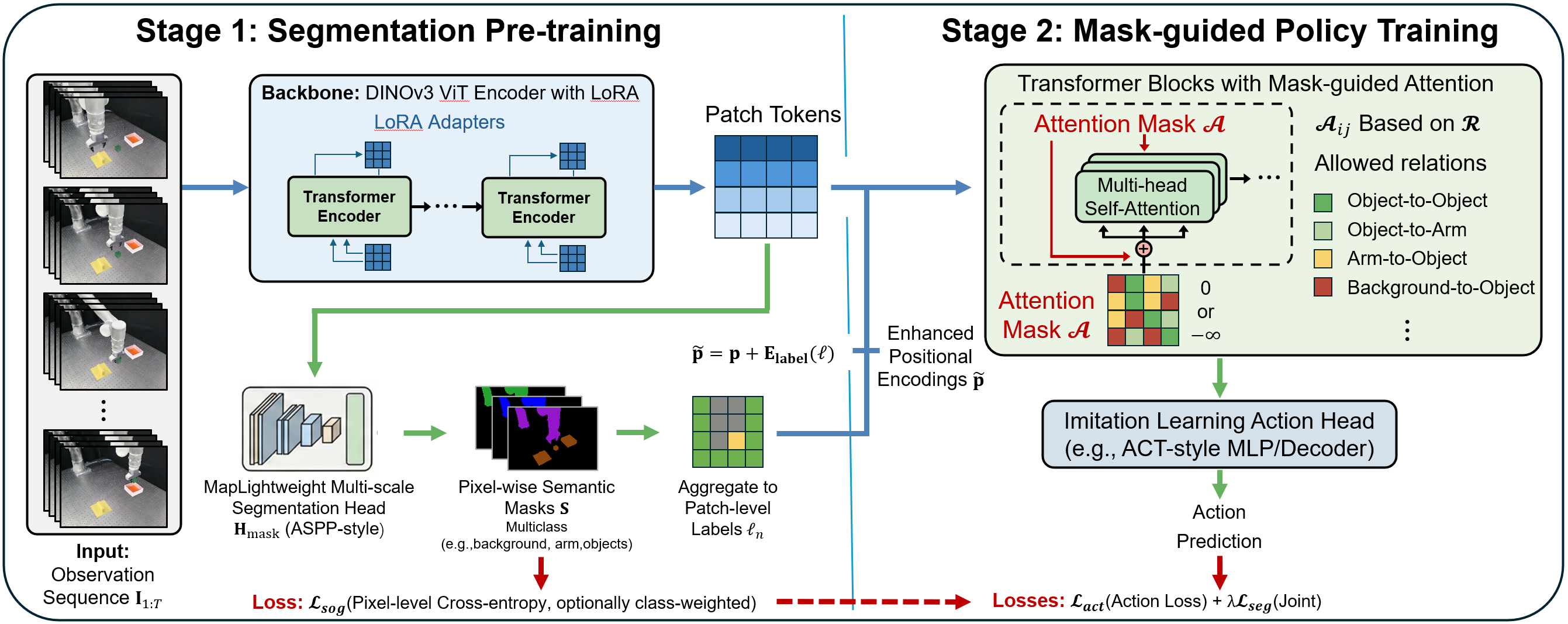

技术框架:ExoGS框架包含以下几个主要阶段:1) 数据采集阶段:使用AirExo-3捕获人类演示数据,包括关节轨迹和RGB图像;2) 环境重建阶段:利用采集到的数据,将机器人、物体和环境重建为可编辑的3D高斯溅射资产;3) 数据增强阶段:通过编辑3D高斯溅射资产,生成大规模的增强数据;4) 策略学习阶段:利用增强的数据训练机器人操作策略,并使用Mask Adapter来提高策略在视觉域偏移下的鲁棒性。

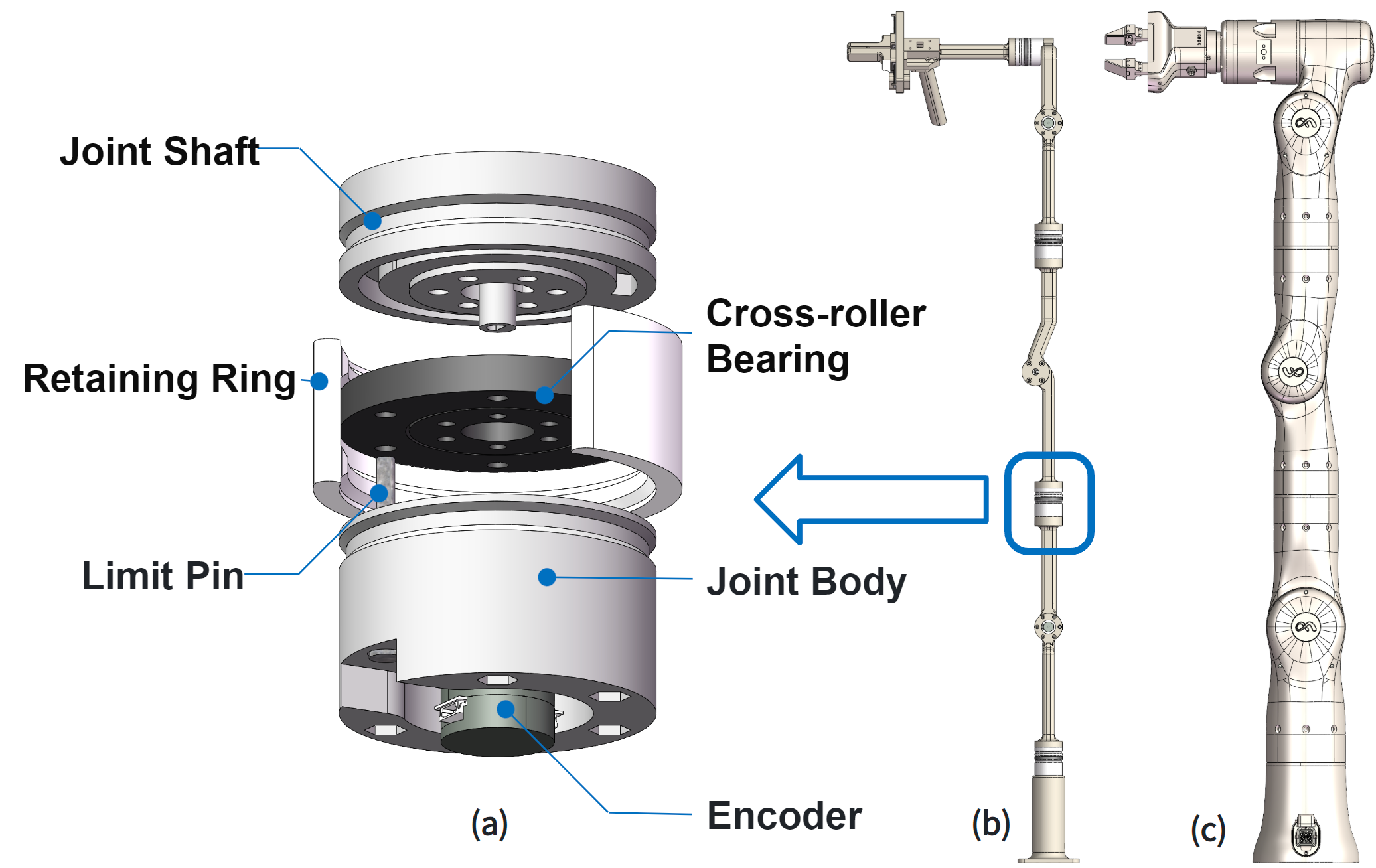

关键创新:ExoGS的关键创新在于:1) 提出了一种机器人同构的被动外骨骼AirExo-3,能够以毫米级精度捕获运动学一致的轨迹;2) 将3D高斯溅射应用于机器人操作的实-仿-实迁移,实现了几何一致的重放和大规模数据增强;3) 引入了轻量级的Mask Adapter,提高了策略在视觉域偏移下的鲁棒性。与现有方法相比,ExoGS能够更有效地捕获和迁移真实世界的交互过程。

关键设计:AirExo-3的设计保证了与目标机器人的运动学一致性,从而可以直接将人类演示的轨迹迁移到机器人上。3D高斯溅射的使用允许对场景进行灵活的编辑和渲染,从而生成各种各样的增强数据。Mask Adapter通过将实例级别的语义信息注入到策略中,来提高策略对视觉变化的适应能力。具体的损失函数和网络结构细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与基于遥操作的基线方法相比,ExoGS显著提高了数据效率和策略泛化能力。具体而言,ExoGS在多个机器人操作任务上取得了更高的成功率和更快的学习速度。例如,在XXX任务上,ExoGS的数据效率提高了XX%,策略泛化能力提高了YY%(具体数据未知,需要查阅论文)。

🎯 应用场景

ExoGS框架可应用于各种机器人操作任务,尤其是在需要大量交互数据的任务中,例如装配、抓取、操作工具等。该框架能够显著降低数据采集的成本和时间,提高机器人策略的泛化能力,从而加速机器人技术在工业、医疗、服务等领域的应用。

📄 摘要(原文)

Real-to-Sim-to-Real technique is gaining increasing interest for robotic manipulation, as it can generate scalable data in simulation while having narrower sim-to-real gap. However, previous methods mainly focused on environment-level visual real-to-sim transfer, ignoring the transfer of interactions, which could be challenging and inefficient to obtain purely in simulation especially for contact-rich tasks. We propose ExoGS, a robot-free 4D Real-to-Sim-to-Real framework that captures both static environments and dynamic interactions in the real world and transfers them seamlessly to a simulated environment. It provides a new solution for scalable manipulation data collection and policy learning. ExoGS employs a self-designed robot-isomorphic passive exoskeleton AirExo-3 to capture kinematically consistent trajectories with millimeter-level accuracy and synchronized RGB observations during direct human demonstrations. The robot, objects, and environment are reconstructed as editable 3D Gaussian Splatting assets, enabling geometry-consistent replay and large-scale data augmentation. Additionally, a lightweight Mask Adapter injects instance-level semantics into the policy to enhance robustness under visual domain shifts. Real-world experiments demonstrate that ExoGS significantly improves data efficiency and policy generalization compared to teleoperation-based baselines. Code and hardware files have been released on https://github.com/zaixiabalala/ExoGS.