A Multimodal Data Collection Framework for Dialogue-Driven Assistive Robotics to Clarify Ambiguities: A Wizard-of-Oz Pilot Study

作者: Guangping Liu, Nicholas Hawkins, Billy Madden, Tipu Sultan, Flavio Esposito, Madi Babaiasl

分类: cs.RO

发布日期: 2026-01-23

💡 一句话要点

提出一种多模态数据采集框架,用于对话驱动辅助机器人消除歧义

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 辅助机器人 多模态数据采集 对话系统 Wizard-of-Oz

📋 核心要点

- 现有轮椅和轮椅式机械臂(WMRA)集成控制界面缺乏灵活性,难以实现直观的辅助交互。

- 论文提出基于对话交互和Wizard-of-Oz设置的多模态数据采集框架,模拟机器人自主性并记录用户行为。

- 实验验证了该框架能够有效捕捉对话中的歧义,并支持自然的人机交互,为后续研究奠定基础。

📝 摘要(中文)

本文提出了一种多模态数据采集框架,旨在解决对话驱动辅助机器人控制中缺乏自然人机交互(HRI)数据集的问题,特别是对话中存在的歧义。该框架采用基于对话的交互协议和双房间Wizard-of-Oz(WoZ)设置,模拟机器人自主性,同时激发用户的自然行为。框架同步记录五种模态数据:RGB-D视频、对话音频、惯性测量单元(IMU)信号、末端执行器笛卡尔坐标姿态和全身关节状态,涵盖五项辅助任务。通过该框架,我们收集了一个包含53个试验的初步数据集,并利用运动平滑度分析和用户反馈验证了其质量。结果表明,该框架有效地捕捉了各种歧义类型,并支持自然的对话驱动交互,证明其适用于扩展到更大的数据集,用于学习、基准测试和评估具有歧义感知能力的辅助控制。

🔬 方法详解

问题定义:现有轮椅和轮椅式机械臂的控制界面不够灵活,难以实现自然和直观的辅助交互。数据驱动的人工智能方法在辅助机器人控制方面展现出潜力,但缺乏能够捕捉自然人机交互(HRI)的多模态数据集,尤其是在对话驱动控制中存在的歧义问题。

核心思路:论文的核心思路是构建一个多模态数据采集框架,通过模拟机器人自主性来收集自然的人机交互数据,特别是对话中存在的歧义信息。通过Wizard-of-Oz(WoZ)设置,让人类操作员扮演“机器人”的角色,从而在用户不知情的情况下,模拟机器人的行为,收集用户在与“机器人”交互时的自然反应和对话数据。

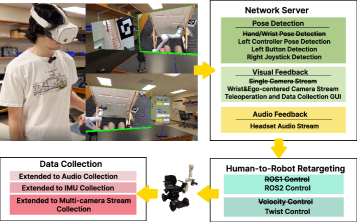

技术框架:该框架采用双房间WoZ设置,用户在一个房间与“机器人”交互,操作员在另一个房间控制机器人的行为。框架同步记录五种模态的数据:RGB-D视频、对话音频、惯性测量单元(IMU)信号(用户佩戴)、末端执行器笛卡尔坐标姿态和全身关节状态(机器人)。交互协议基于对话,旨在引导用户通过对话来完成特定的辅助任务。

关键创新:该框架的关键创新在于其能够有效地捕捉对话中的歧义。通过WoZ设置和精心设计的对话协议,框架能够诱导用户在表达意图时产生歧义,并记录用户在面对歧义时的反应和澄清过程。此外,同步记录多种模态的数据,为后续的歧义消解研究提供了丰富的信息来源。

关键设计:WoZ设置是关键设计之一,它允许研究人员在没有完全自主的机器人的情况下,收集真实的用户交互数据。对话协议的设计也至关重要,它需要引导用户进行自然的对话,同时诱导歧义的产生。此外,同步记录多种模态的数据,需要精确的时间同步和校准。

🖼️ 关键图片

📊 实验亮点

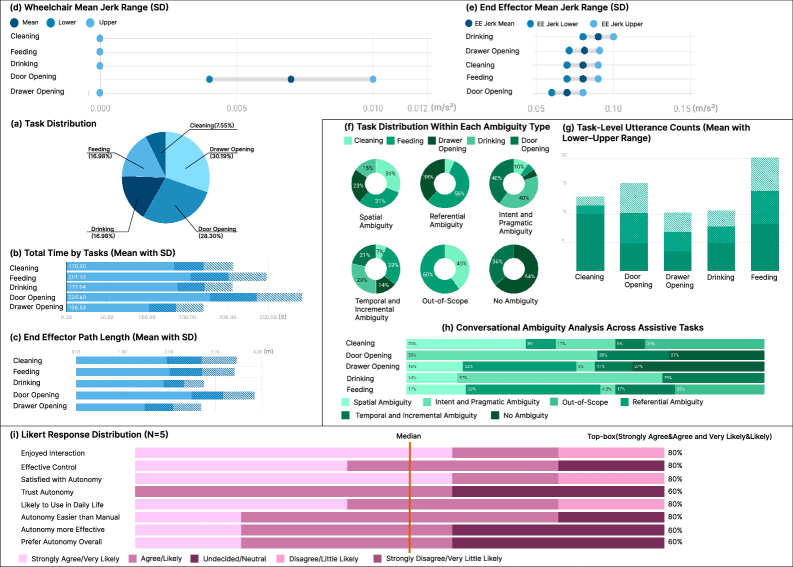

通过对收集到的53个试验数据进行运动平滑度分析和用户反馈,验证了该框架的有效性。运动平滑度分析表明,用户在与“机器人”交互时产生的运动是自然的。用户反馈也表明,他们认为该框架能够有效地捕捉对话中的歧义,并支持自然的对话驱动交互。

🎯 应用场景

该研究成果可应用于开发更智能、更自然的辅助机器人控制系统,提高残疾人士的生活质量。通过利用收集到的多模态数据集,可以训练能够理解和消解对话歧义的AI模型,从而实现更安全、更可靠的辅助机器人控制。未来,该框架可以扩展到其他类型的辅助机器人和人机交互场景。

📄 摘要(原文)

Integrated control of wheelchairs and wheelchair-mounted robotic arms (WMRAs) has strong potential to increase independence for users with severe motor limitations, yet existing interfaces often lack the flexibility needed for intuitive assistive interaction. Although data-driven AI methods show promise, progress is limited by the lack of multimodal datasets that capture natural Human-Robot Interaction (HRI), particularly conversational ambiguity in dialogue-driven control. To address this gap, we propose a multimodal data collection framework that employs a dialogue-based interaction protocol and a two-room Wizard-of-Oz (WoZ) setup to simulate robot autonomy while eliciting natural user behavior. The framework records five synchronized modalities: RGB-D video, conversational audio, inertial measurement unit (IMU) signals, end-effector Cartesian pose, and whole-body joint states across five assistive tasks. Using this framework, we collected a pilot dataset of 53 trials from five participants and validated its quality through motion smoothness analysis and user feedback. The results show that the framework effectively captures diverse ambiguity types and supports natural dialogue-driven interaction, demonstrating its suitability for scaling to a larger dataset for learning, benchmarking, and evaluation of ambiguity-aware assistive control.