Reinforcement Learning-Based Energy-Aware Coverage Path Planning for Precision Agriculture

作者: Beining Wu, Zihao Ding, Leo Ostigaard, Jun Huang

分类: cs.RO, cs.LG

发布日期: 2026-01-23

备注: Accepted by RACS '25: International Conference on Research in Adaptive and Convergent Systems, November 16-19, 2025, Ho Chi Minh, Vietnam. 10 pages, 5 figures

期刊: Proceedings of the 2025 International Conference on Research in Adaptive and Convergent Systems.(2025)

💡 一句话要点

提出基于强化学习的能量感知覆盖路径规划方法,用于精准农业机器人。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 覆盖路径规划 强化学习 软演员-评论家算法 能量感知 精准农业

📋 核心要点

- 现有覆盖路径规划方法在农业机器人应用中,常常忽略能量约束,导致任务失败。

- 论文提出基于SAC强化学习的能量感知覆盖路径规划框架,优化覆盖效率、能耗和返回基地的约束。

- 实验表明,该方法在覆盖率和能量安全方面优于传统启发式算法,验证了其有效性和可扩展性。

📝 摘要(中文)

覆盖路径规划(CPP)是农业机器人的基本能力,但现有解决方案通常忽略能量约束,导致大规模或资源受限环境中操作不完整。本文提出了一种基于软演员-评论家(SAC)强化学习的能量感知CPP框架,专为具有障碍物和充电站的网格环境设计。为了在能量限制下实现鲁棒和自适应的决策,该框架集成了卷积神经网络(CNN)用于空间特征提取和长短期记忆(LSTM)网络用于时间动态建模。设计了一个专门的奖励函数,以联合优化覆盖效率、能量消耗和返回基地的约束。实验结果表明,所提出的方法始终实现超过90%的覆盖率,同时确保能量安全,在覆盖率方面优于传统的启发式算法,如快速探索随机树(RRT)、粒子群优化(PSO)和蚁群优化(ACO)基线13.4-19.5%,并减少了59.9-88.3%的约束违规。这些发现验证了所提出的基于SAC的框架是农业机器人中能量约束CPP的有效且可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决农业机器人覆盖路径规划中,在能量约束下如何实现高效、安全的覆盖问题。现有方法,如RRT、PSO和ACO等,通常没有充分考虑能量消耗,导致机器人可能在完成任务前耗尽能量,或者无法返回充电站,从而影响作业效率和可靠性。

核心思路:论文的核心思路是利用强化学习,特别是SAC算法,学习一个能够在能量约束下做出最优决策的策略。通过精心设计的奖励函数,引导智能体在覆盖更多区域的同时,合理控制能量消耗,并确保能够及时返回充电站。这种方法能够自适应地学习环境特征,从而在复杂的农业环境中做出更明智的规划。

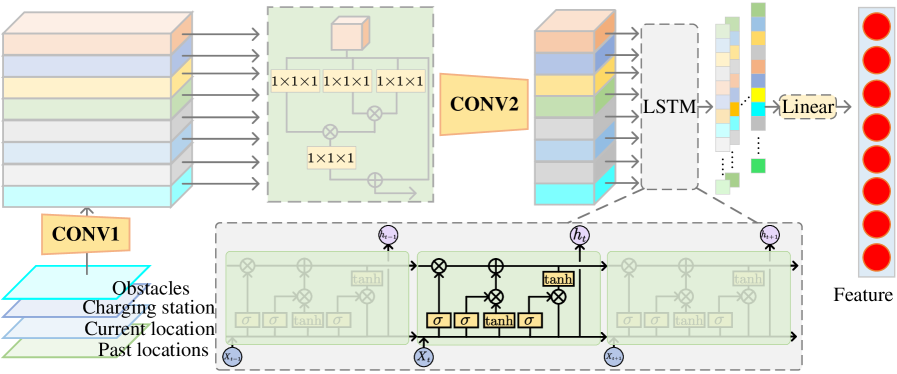

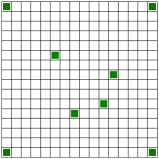

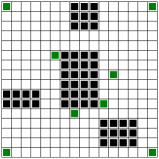

技术框架:该框架主要包含以下几个模块:1) 环境建模:将农业环境表示为带有障碍物和充电站的网格地图。2) 状态表示:使用CNN提取环境的空间特征,并使用LSTM网络捕捉时间动态信息,例如剩余电量和已覆盖区域。3) 动作空间:定义机器人的移动动作,例如向上、向下、向左、向右等。4) 奖励函数:设计一个综合考虑覆盖率、能量消耗和返回基地约束的奖励函数。5) SAC智能体:使用SAC算法训练智能体,使其学习最优的覆盖路径规划策略。

关键创新:该论文的关键创新在于将深度强化学习应用于能量感知的覆盖路径规划问题,并设计了一个能够有效平衡覆盖效率、能量消耗和返回基地约束的奖励函数。此外,利用CNN和LSTM网络提取环境的空间和时间特征,提高了智能体的决策能力。与传统的启发式算法相比,该方法能够更好地适应复杂和动态的农业环境。

关键设计:奖励函数的设计是关键。它通常包含以下几个部分:1) 覆盖奖励:鼓励智能体覆盖未覆盖的区域。2) 能量惩罚:惩罚智能体的能量消耗。3) 返回基地奖励:鼓励智能体在电量不足时返回充电站。4) 碰撞惩罚:惩罚智能体与障碍物发生碰撞。SAC算法使用两个Q函数和一个策略网络,通过最大化期望累积奖励来学习最优策略。CNN和LSTM的具体结构需要根据具体环境进行调整,例如卷积核的大小、LSTM的隐藏层维度等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的基于SAC的能量感知CPP框架在覆盖率方面优于传统的启发式算法,如RRT、PSO和ACO。具体来说,该方法能够始终实现超过90%的覆盖率,同时确保能量安全,在覆盖率方面比基线算法高出13.4-19.5%,并减少了59.9-88.3%的约束违规。这些结果验证了该方法在能量约束下的有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于精准农业领域,例如农田巡检、喷洒农药、播种等任务。通过优化农业机器人的覆盖路径规划,可以提高作业效率,降低能源消耗,减少环境污染,并最终提高农业生产的可持续性。未来,该方法还可以扩展到其他资源受限的机器人应用场景,例如灾害救援、环境监测等。

📄 摘要(原文)

Coverage Path Planning (CPP) is a fundamental capability for agricultural robots; however, existing solutions often overlook energy constraints, resulting in incomplete operations in large-scale or resource-limited environments. This paper proposes an energy-aware CPP framework grounded in Soft Actor-Critic (SAC) reinforcement learning, designed for grid-based environments with obstacles and charging stations. To enable robust and adaptive decision-making under energy limitations, the framework integrates Convolutional Neural Networks (CNNs) for spatial feature extraction and Long Short-Term Memory (LSTM) networks for temporal dynamics. A dedicated reward function is designed to jointly optimize coverage efficiency, energy consumption, and return-to-base constraints. Experimental results demonstrate that the proposed approach consistently achieves over 90% coverage while ensuring energy safety, outperforming traditional heuristic algorithms such as Rapidly-exploring Random Tree (RRT), Particle Swarm Optimization (PSO), and Ant Colony Optimization (ACO) baselines by 13.4-19.5% in coverage and reducing constraint violations by 59.9-88.3%. These findings validate the proposed SAC-based framework as an effective and scalable solution for energy-constrained CPP in agricultural robotics.