Point Bridge: 3D Representations for Cross Domain Policy Learning

作者: Siddhant Haldar, Lars Johannsmeier, Lerrel Pinto, Abhishek Gupta, Dieter Fox, Yashraj Narang, Ajay Mandlekar

分类: cs.RO

发布日期: 2026-01-22

💡 一句话要点

Point Bridge:利用点云表示实现跨域策略学习,解决Sim2Real迁移问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 Sim2Real 点云表示 视觉-语言模型 Transformer 策略学习 领域自适应

📋 核心要点

- 真实世界机器人操作数据稀缺,Sim2Real迁移受视觉领域差异限制,阻碍了通用机器人代理的发展。

- Point Bridge利用领域无关的点云表示,结合VLM提取、Transformer策略学习,实现高效的Sim2Real迁移。

- 实验表明,Point Bridge在零样本Sim2Real迁移和少量真实数据协同训练下,性能显著优于现有方法。

📝 摘要(中文)

机器人基础模型正逐渐展现通用机器人代理的潜力,但大规模真实世界操作数据集的稀缺性限制了其发展。仿真和合成数据生成提供了一种可扩展的替代方案,但仿真与现实之间的视觉领域差距限制了它们的有效性。本文提出了Point Bridge,一个利用统一的、领域无关的基于点的表示的框架,以实现零样本Sim2Real策略迁移,无需显式的视觉或对象级别对齐。Point Bridge结合了通过视觉-语言模型(VLM)自动提取的基于点的表示、基于Transformer的策略学习和高效的推理时流水线,仅使用合成数据即可训练出强大的真实世界操作代理。通过在少量真实演示数据上进行额外的协同训练,Point Bridge进一步提高了性能,显著优于以往基于视觉的Sim-and-Real协同训练方法。在单任务和多任务设置中,它实现了高达44%的零样本Sim2Real迁移增益,以及高达66%的有限真实数据增益。

🔬 方法详解

问题定义:现有方法在机器人操作任务中,依赖大量真实数据,成本高昂。使用仿真数据进行训练,再迁移到真实环境时,由于视觉领域差异,性能显著下降。现有Sim2Real方法需要显式的视觉或对象级别对齐,过程复杂且效果有限。

核心思路:Point Bridge的核心在于使用领域无关的点云表示作为中间桥梁,连接仿真环境和真实环境。通过视觉-语言模型(VLM)提取场景的点云表示,避免了直接处理像素级别的图像差异。Transformer模型用于学习点云表示上的策略,从而实现策略的跨域迁移。

技术框架:Point Bridge包含三个主要模块:1) 基于VLM的点云表示提取模块,将图像转换为点云;2) 基于Transformer的策略学习模块,学习点云表示上的动作策略;3) 推理时流水线,将训练好的策略部署到真实机器人上。整个流程无需显式的领域对齐或对象识别。

关键创新:Point Bridge的关键创新在于使用点云作为统一的、领域无关的表示。与直接使用图像或特征向量相比,点云表示更加简洁、鲁棒,并且能够更好地捕捉场景的几何结构。此外,利用VLM自动提取点云表示,避免了手动设计特征的繁琐过程。

关键设计:VLM使用CLIP模型,将图像编码为视觉特征,然后通过一个可学习的映射网络将视觉特征转换为点云。Transformer策略网络采用标准的encoder-decoder结构,encoder处理点云序列,decoder输出动作序列。损失函数包括行为克隆损失和奖励最大化损失,用于训练策略网络。

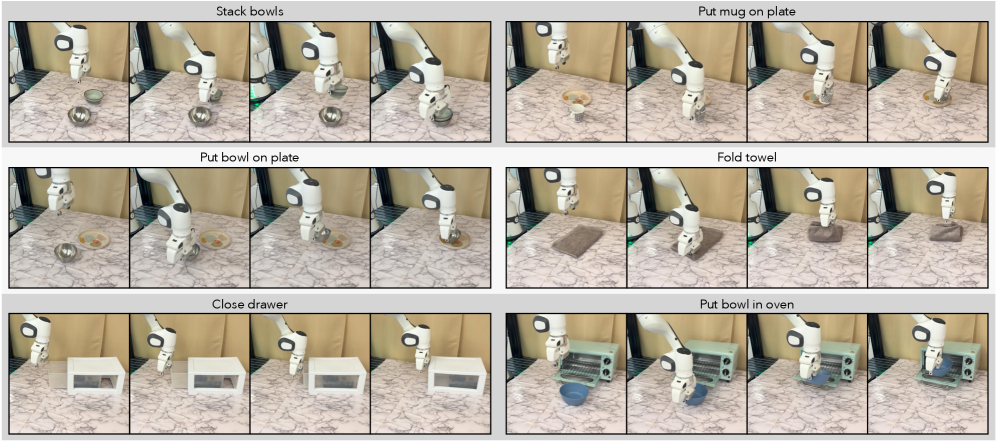

🖼️ 关键图片

📊 实验亮点

Point Bridge在零样本Sim2Real迁移中,相比现有方法取得了高达44%的性能提升。在少量真实数据协同训练下,性能提升高达66%。实验结果表明,Point Bridge在单任务和多任务设置中均表现出色,验证了其有效性和泛化能力。

🎯 应用场景

Point Bridge可应用于各种机器人操作任务,如物体抓取、放置、组装等。它降低了机器人训练对真实数据的依赖,加速了机器人技术的普及。该方法还可扩展到其他领域,如自动驾驶、增强现实等,实现跨域知识迁移。

📄 摘要(原文)

Robot foundation models are beginning to deliver on the promise of generalist robotic agents, yet progress remains constrained by the scarcity of large-scale real-world manipulation datasets. Simulation and synthetic data generation offer a scalable alternative, but their usefulness is limited by the visual domain gap between simulation and reality. In this work, we present Point Bridge, a framework that leverages unified, domain-agnostic point-based representations to unlock synthetic datasets for zero-shot sim-to-real policy transfer, without explicit visual or object-level alignment. Point Bridge combines automated point-based representation extraction via Vision-Language Models (VLMs), transformer-based policy learning, and efficient inference-time pipelines to train capable real-world manipulation agents using only synthetic data. With additional co-training on small sets of real demonstrations, Point Bridge further improves performance, substantially outperforming prior vision-based sim-and-real co-training methods. It achieves up to 44% gains in zero-shot sim-to-real transfer and up to 66% with limited real data across both single-task and multitask settings. Videos of the robot are best viewed at: https://pointbridge3d.github.io/