Collision-Free Humanoid Traversal in Cluttered Indoor Scenes

作者: Han Xue, Sikai Liang, Zhikai Zhang, Zicheng Zeng, Yun Liu, Yunrui Lian, Jilong Wang, Qingtao Liu, Xuesong Shi, Li Yi

分类: cs.RO

发布日期: 2026-01-22

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出HumanoidPF,解决复杂室内场景中人型机器人无碰撞导航问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人型机器人 无碰撞导航 强化学习 人形势场 复杂环境

📋 核心要点

- 现有方法难以有效表示人形机器人与障碍物之间的关系,导致难以直接学习避障导航技能。

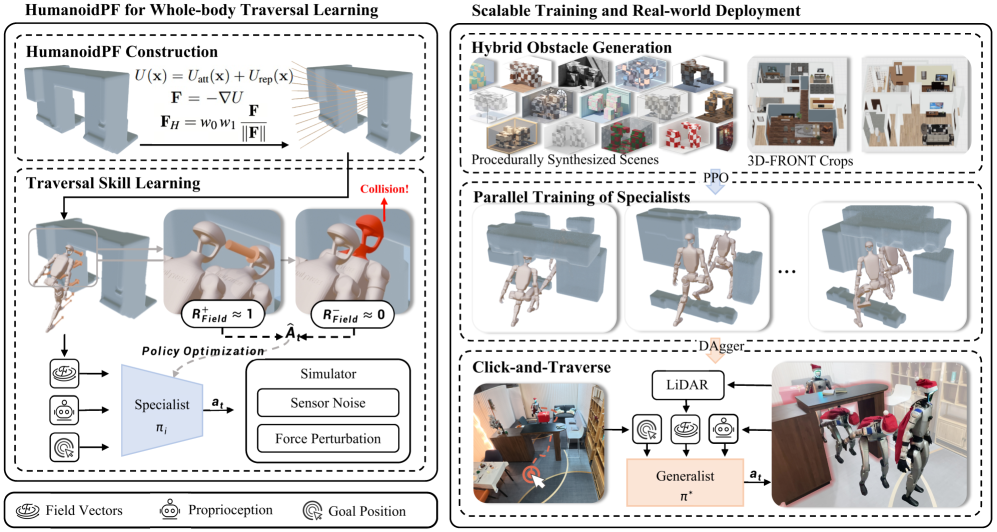

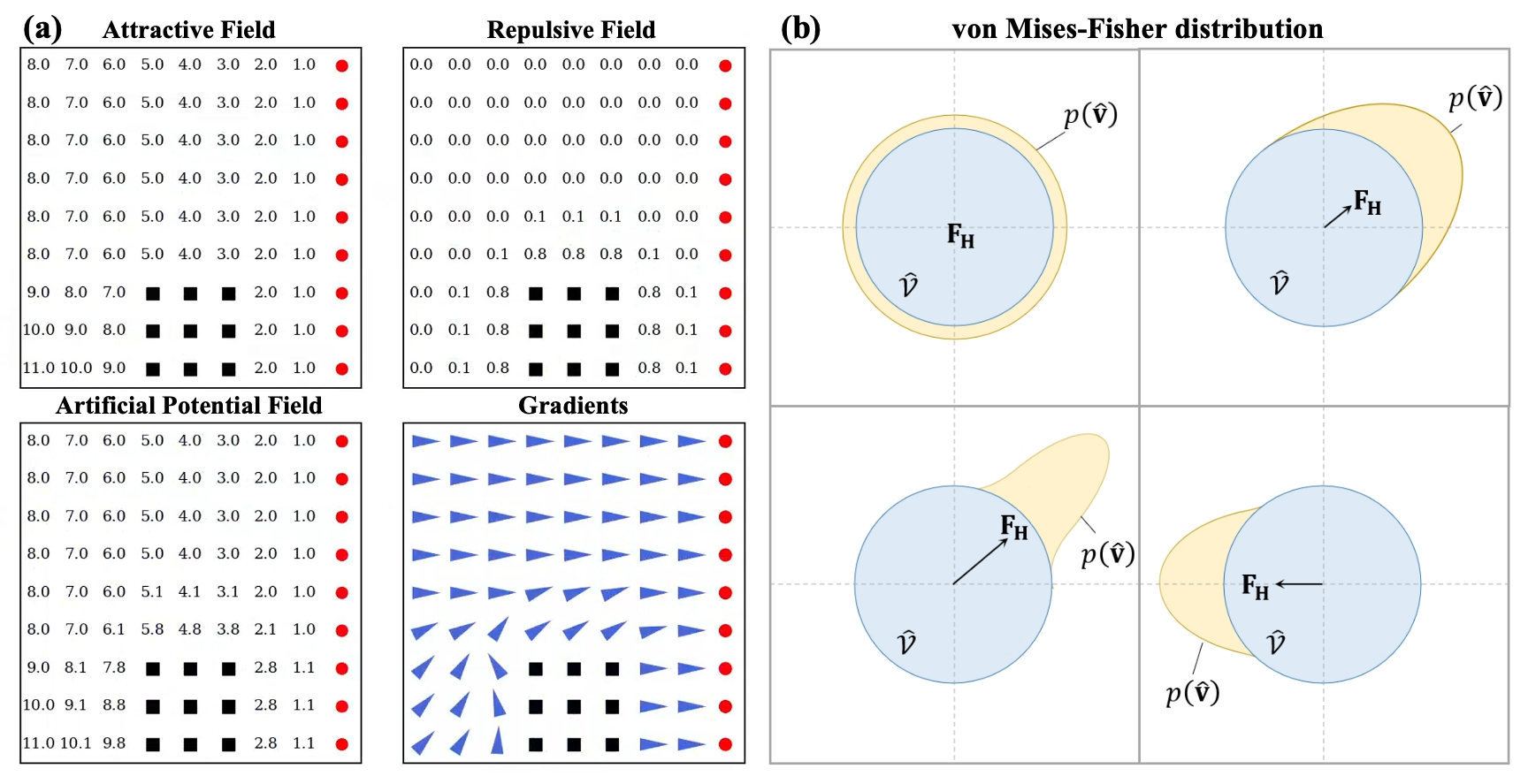

- 提出HumanoidPF,将人形机器人与障碍物的关系编码为无碰撞运动方向,简化强化学习过程。

- 通过混合场景生成方法,提升策略在复杂环境中的泛化能力,并在真实世界中验证了有效性。

📝 摘要(中文)

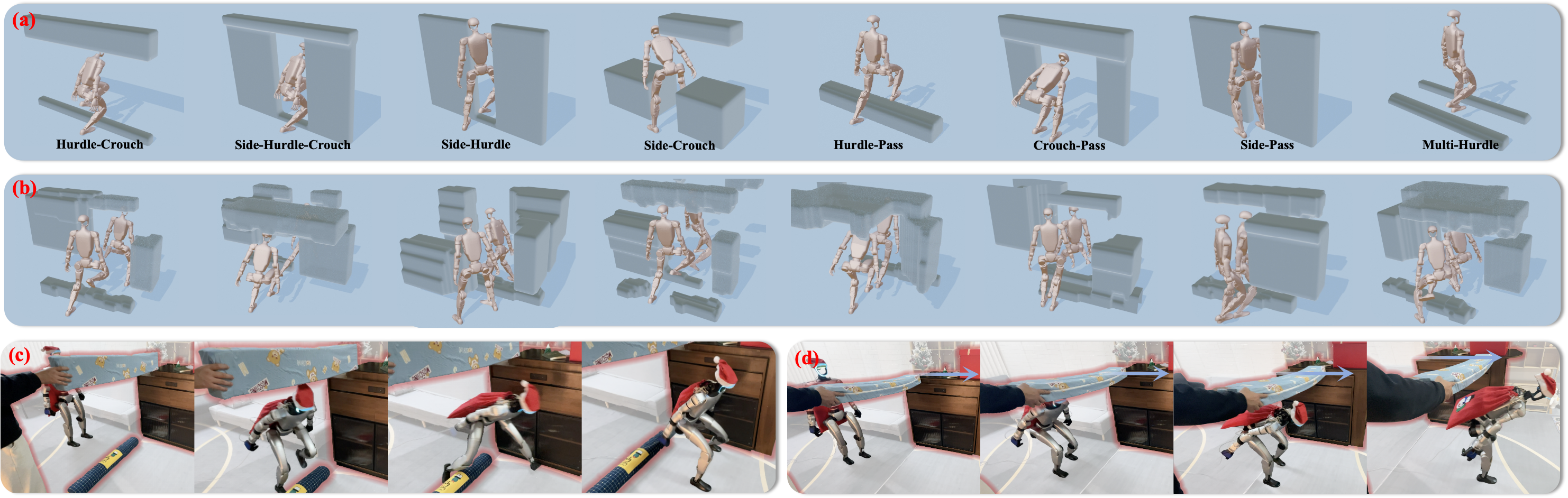

本文研究了复杂室内场景中人型机器人的无碰撞导航问题,例如跨越地面物体、蹲伏通过低矮障碍物或挤过狭窄通道。为了实现这一目标,机器人需要将其对周围障碍物的感知映射到相应的导航技能。然而,由于缺乏有效表示来捕捉避障期间的人形-障碍物关系,直接学习这种映射关系非常困难。因此,我们提出了人形势场(HumanoidPF),它将这些关系编码为无碰撞的运动方向,从而显著促进了基于强化学习的导航技能学习。我们还发现,HumanoidPF作为一种感知表示,具有令人惊讶的、可忽略不计的模拟到真实世界的差距。为了进一步实现通过多样且具有挑战性的复杂室内场景的通用导航技能,我们进一步提出了一种混合场景生成方法,结合了真实3D室内场景的裁剪和程序合成的障碍物。我们成功地将我们的策略转移到现实世界,并开发了一个远程操作系统,用户只需单击一下即可指挥人型机器人在杂乱的室内场景中导航。在模拟和现实世界中进行了大量实验,以验证我们方法的有效性。

🔬 方法详解

问题定义:论文旨在解决复杂室内环境中,人型机器人如何安全、高效地进行导航的问题。现有方法的痛点在于,缺乏一种有效的表示方法来描述机器人与周围障碍物之间的空间关系,这使得直接学习从感知到动作的映射变得困难,尤其是在障碍物种类繁多、布局复杂的场景下。

核心思路:论文的核心思路是引入“人形势场”(Humanoid Potential Field, HumanoidPF)的概念。HumanoidPF将机器人周围的环境信息编码为一系列无碰撞的运动方向,本质上是将复杂的几何关系转化为机器人可直接利用的运动引导信号。这种表示方法简化了强化学习过程,使得机器人更容易学习到避障导航技能。

技术框架:整体框架包含以下几个主要部分:1) 感知模块:负责获取周围环境信息,例如通过深度相机或激光雷达;2) HumanoidPF生成模块:将感知信息转化为HumanoidPF表示,即一系列无碰撞的运动方向;3) 强化学习模块:利用HumanoidPF作为输入,训练一个策略网络,该网络输出机器人的具体动作;4) 混合场景生成模块:用于生成多样化的训练环境,包括真实场景的裁剪和程序化生成的障碍物。

关键创新:最重要的技术创新点在于HumanoidPF的引入。与传统的直接从原始感知数据学习不同,HumanoidPF提供了一种更具结构化的、与运动直接相关的环境表示。这种表示方法显著降低了学习难度,并提高了策略的泛化能力。此外,混合场景生成方法也为训练提供了更丰富的数据,进一步提升了策略的鲁棒性。

关键设计:HumanoidPF的具体实现方式未知,但可以推测其可能涉及到碰撞检测、路径规划等算法。强化学习部分可能采用常见的Actor-Critic结构,损失函数的设计目标是最大化奖励(例如到达目标点)并避免碰撞。混合场景生成模块的关键在于如何平衡真实场景的真实性和程序化生成场景的多样性,具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

论文在模拟和真实环境中进行了大量实验,验证了HumanoidPF的有效性。实验结果表明,基于HumanoidPF的强化学习策略能够成功地在复杂室内场景中实现无碰撞导航。此外,论文还展示了策略在真实机器人上的部署效果,证明了其具有良好的sim-to-real迁移能力。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于服务机器人、家庭助手、搜救机器人等领域。通过赋予机器人在复杂环境中自主导航的能力,可以使其更好地完成各种任务,例如在拥挤的家庭环境中进行物品搬运、在灾难现场进行人员搜救等。未来,结合更先进的感知技术和控制算法,有望实现更智能、更安全的人机协作。

📄 摘要(原文)

We study the problem of collision-free humanoid traversal in cluttered indoor scenes, such as hurdling over objects scattered on the floor, crouching under low-hanging obstacles, or squeezing through narrow passages. To achieve this goal, the humanoid needs to map its perception of surrounding obstacles with diverse spatial layouts and geometries to the corresponding traversal skills. However, the lack of an effective representation that captures humanoid-obstacle relationships during collision avoidance makes directly learning such mappings difficult. We therefore propose Humanoid Potential Field (HumanoidPF), which encodes these relationships as collision-free motion directions, significantly facilitating RL-based traversal skill learning. We also find that HumanoidPF exhibits a surprisingly negligible sim-to-real gap as a perceptual representation. To further enable generalizable traversal skills through diverse and challenging cluttered indoor scenes, we further propose a hybrid scene generation method, incorporating crops of realistic 3D indoor scenes and procedurally synthesized obstacles. We successfully transfer our policy to the real world and develop a teleoperation system where users could command the humanoid to traverse in cluttered indoor scenes with just a single click. Extensive experiments are conducted in both simulation and the real world to validate the effectiveness of our method. Demos and code can be found in our website: https://axian12138.github.io/CAT/.