AION: Aerial Indoor Object-Goal Navigation Using Dual-Policy Reinforcement Learning

作者: Zichen Yan, Yuchen Hou, Shenao Wang, Yichao Gao, Rui Huang, Lin Zhao

分类: cs.RO

发布日期: 2026-01-22

💡 一句话要点

AION:基于双策略强化学习的无人机室内目标导航

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 无人机导航 目标导航 强化学习 双策略学习 室内导航

📋 核心要点

- 现有ObjectNav方法主要集中于2D平面移动,缺乏对无人机3D运动优势的利用,在空间感知、动态控制和安全保障方面面临挑战。

- AION采用双策略强化学习框架,将探索和目标到达行为分离为两个独立策略,分别优化,提升了导航效率和安全性。

- 实验结果表明,AION在AI2-THOR和IsaacSim中均表现出色,在探索、导航效率和安全性方面均优于现有方法。

📝 摘要(中文)

目标导航(ObjectNav)任务要求智能体自主探索未知环境,并导航至由语义标签指定的目标物体。现有工作主要集中于2D运动模式下的零样本ObjectNav,而将其扩展到具有3D运动能力的无人机平台的研究尚不充分。无人机具有卓越的机动性和搜索效率,但也带来了空间感知、动态控制和安全保障方面的新挑战。本文提出AION,用于基于视觉的无人机ObjectNav,无需依赖外部定位或全局地图。AION是一个端到端的双策略强化学习(RL)框架,将探索和目标到达行为解耦为两个专门的策略。我们在AI2-THOR基准上评估AION,并在IsaacSim中使用高保真无人机模型评估其实时性能。实验结果表明,AION在探索、导航效率和安全性等综合评估指标上均取得了优异的性能。

🔬 方法详解

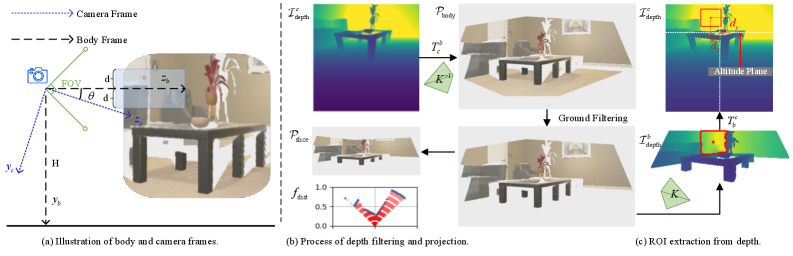

问题定义:论文旨在解决无人机在未知室内环境中,仅依靠视觉信息,自主导航到特定目标物体的问题。现有方法主要集中于地面机器人,无法直接应用于无人机,因为无人机需要处理更复杂的3D空间感知、动态控制以及安全问题。此外,依赖外部定位或全局地图的方法限制了无人机的自主性和灵活性。

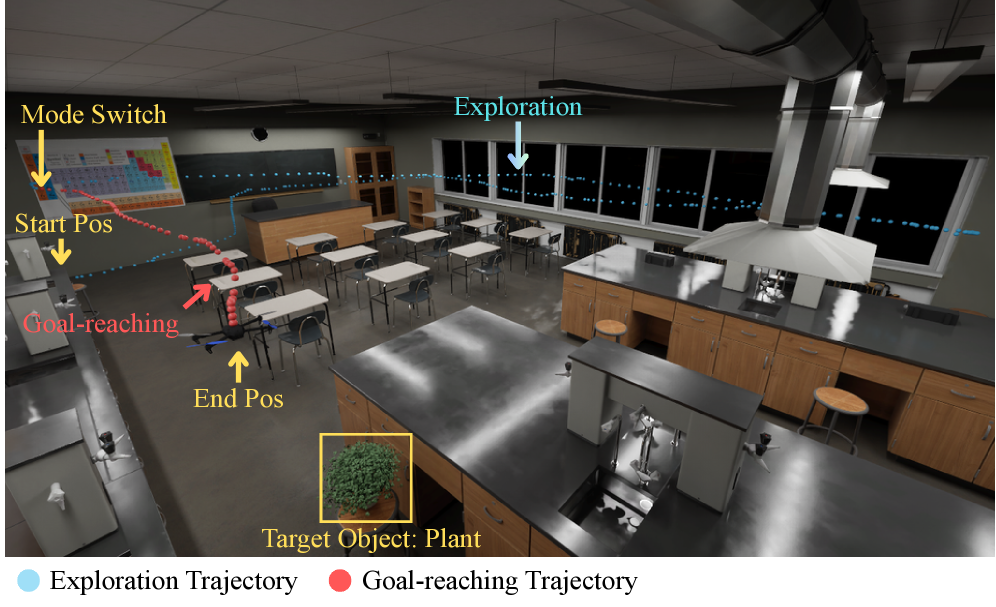

核心思路:论文的核心思路是将ObjectNav任务分解为探索和目标到达两个阶段,并分别设计专门的强化学习策略。探索策略负责高效地探索未知环境,发现目标物体;目标到达策略负责安全、高效地导航到目标物体。这种解耦的设计允许针对每个阶段的特点进行优化,从而提高整体性能。

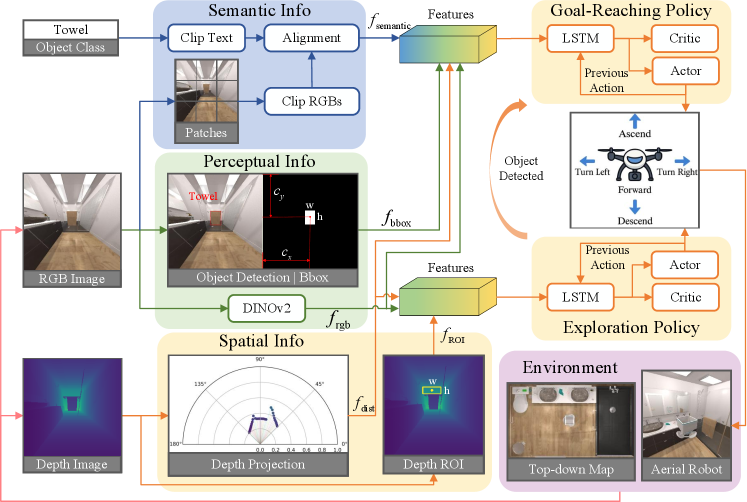

技术框架:AION框架包含两个主要的强化学习策略:探索策略和目标到达策略。输入是无人机的视觉信息(例如,RGB图像)和目标物体的语义标签。探索策略输出无人机的运动指令,使其在环境中进行高效探索。当探索策略发现目标物体时,目标到达策略接管控制,引导无人机安全、高效地到达目标物体。两个策略通过一个切换机制进行协调。

关键创新:AION的关键创新在于双策略强化学习框架,它将探索和目标到达行为解耦,并分别进行优化。这种解耦的设计允许针对每个阶段的特点进行优化,从而提高整体性能。此外,AION无需依赖外部定位或全局地图,增强了无人机的自主性和灵活性。

关键设计:探索策略和目标到达策略均采用深度强化学习算法进行训练。具体的网络结构和损失函数未知,但可以推测使用了卷积神经网络(CNN)处理视觉信息,并采用Actor-Critic或类似的算法进行策略学习。切换机制的设计也至关重要,需要平衡探索和目标到达的需求,避免无人机在探索过程中过早地切换到目标到达策略,或者在目标物体附近仍然进行不必要的探索。

🖼️ 关键图片

📊 实验亮点

AION在AI2-THOR基准测试中表现出色,在探索效率、导航成功率和安全性方面均优于现有方法。此外,AION在IsaacSim中使用高保真无人机模型进行了实时性能评估,验证了其在真实环境中的可行性。具体性能数据未知,但摘要中明确指出AION在综合评估指标上取得了优异的性能。

🎯 应用场景

AION技术可应用于室内环境下的无人机自主巡检、物流配送、安防监控等领域。例如,在大型仓库中,无人机可以自主搜索并定位特定货物;在灾后救援中,无人机可以自主探索受损建筑物,寻找幸存者。该研究有助于提升无人机在复杂环境下的自主作业能力,降低对人工干预的依赖。

📄 摘要(原文)

Object-Goal Navigation (ObjectNav) requires an agent to autonomously explore an unknown environment and navigate toward target objects specified by a semantic label. While prior work has primarily studied zero-shot ObjectNav under 2D locomotion, extending it to aerial platforms with 3D locomotion capability remains underexplored. Aerial robots offer superior maneuverability and search efficiency, but they also introduce new challenges in spatial perception, dynamic control, and safety assurance. In this paper, we propose AION for vision-based aerial ObjectNav without relying on external localization or global maps. AION is an end-to-end dual-policy reinforcement learning (RL) framework that decouples exploration and goal-reaching behaviors into two specialized policies. We evaluate AION on the AI2-THOR benchmark and further assess its real-time performance in IsaacSim using high-fidelity drone models. Experimental results show that AION achieves superior performance across comprehensive evaluation metrics in exploration, navigation efficiency, and safety. The video can be found at https://youtu.be/TgsUm6bb7zg.