Learning a Unified Latent Space for Cross-Embodiment Robot Control

作者: Yashuai Yan, Dongheui Lee

分类: cs.RO

发布日期: 2026-01-21

💡 一句话要点

提出一种统一的跨具身人形机器人控制学习框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 跨具身控制 人形机器人 潜在空间学习 对比学习 运动重定向

📋 核心要点

- 现有机器人控制方法难以泛化到不同形态的机器人,限制了其应用范围。

- 提出一种基于解耦潜在空间的跨具身控制框架,实现运动模式的统一表示。

- 实验证明该方法能够直接在多种机器人上部署,无需额外适配,并支持快速添加新机器人。

📝 摘要(中文)

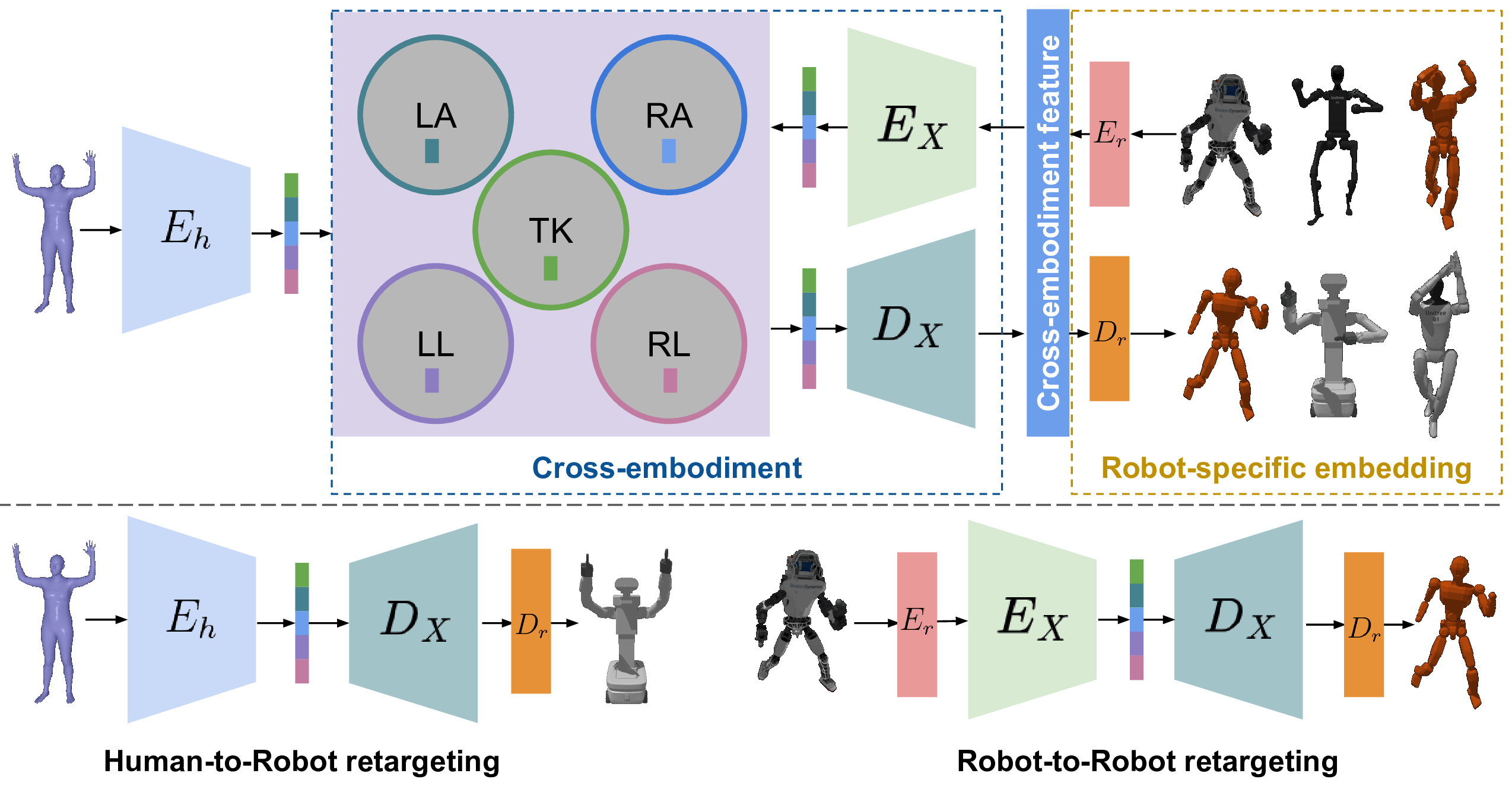

本文提出了一种可扩展的跨具身人形机器人控制框架,通过学习共享的潜在表示来统一人类和各种人形平台(包括单臂、双臂和腿式人形机器人)的运动。该方法分两个阶段进行:首先,我们构建一个解耦的潜在空间,利用对比学习捕捉不同身体部位的局部运动模式,从而实现精确而灵活的运动重定向,即使在形态各异的机器人之间也能实现。为了增强具身之间的对齐,我们引入了定制的相似性度量,将关节旋转和末端执行器的定位相结合,用于关键部分(如手臂)。然后,我们仅使用人类数据,直接在这个潜在空间中训练一个目标条件控制策略。利用条件变分自编码器,我们的策略学习预测由预期目标方向引导的潜在空间位移。我们表明,训练好的策略可以直接部署在多个机器人上,无需任何适应。此外,我们的方法支持通过仅学习一个轻量级的、特定于机器人的嵌入层,有效地将新机器人添加到潜在空间中。学习到的潜在策略也可以直接应用于新的机器人。实验结果表明,我们的方法能够实现跨越各种人形平台的鲁棒、可扩展且与具身无关的机器人控制。

🔬 方法详解

问题定义:现有机器人控制方法通常针对特定机器人设计,难以泛化到具有不同形态和运动能力的机器人上。这限制了机器人控制算法的通用性和可扩展性。此外,从人类运动数据中学习控制策略并将其迁移到机器人上仍然是一个挑战,因为人类和机器人之间的具身差异很大。

核心思路:本文的核心思路是学习一个共享的、解耦的潜在空间,该空间能够统一表示人类和各种人形机器人的运动。通过将运动分解为局部运动模式,并使用对比学习来对齐不同具身之间的运动,该方法能够实现运动重定向和控制策略的迁移。这种方法的核心在于将具身差异的影响降到最低,从而实现更通用的机器人控制。

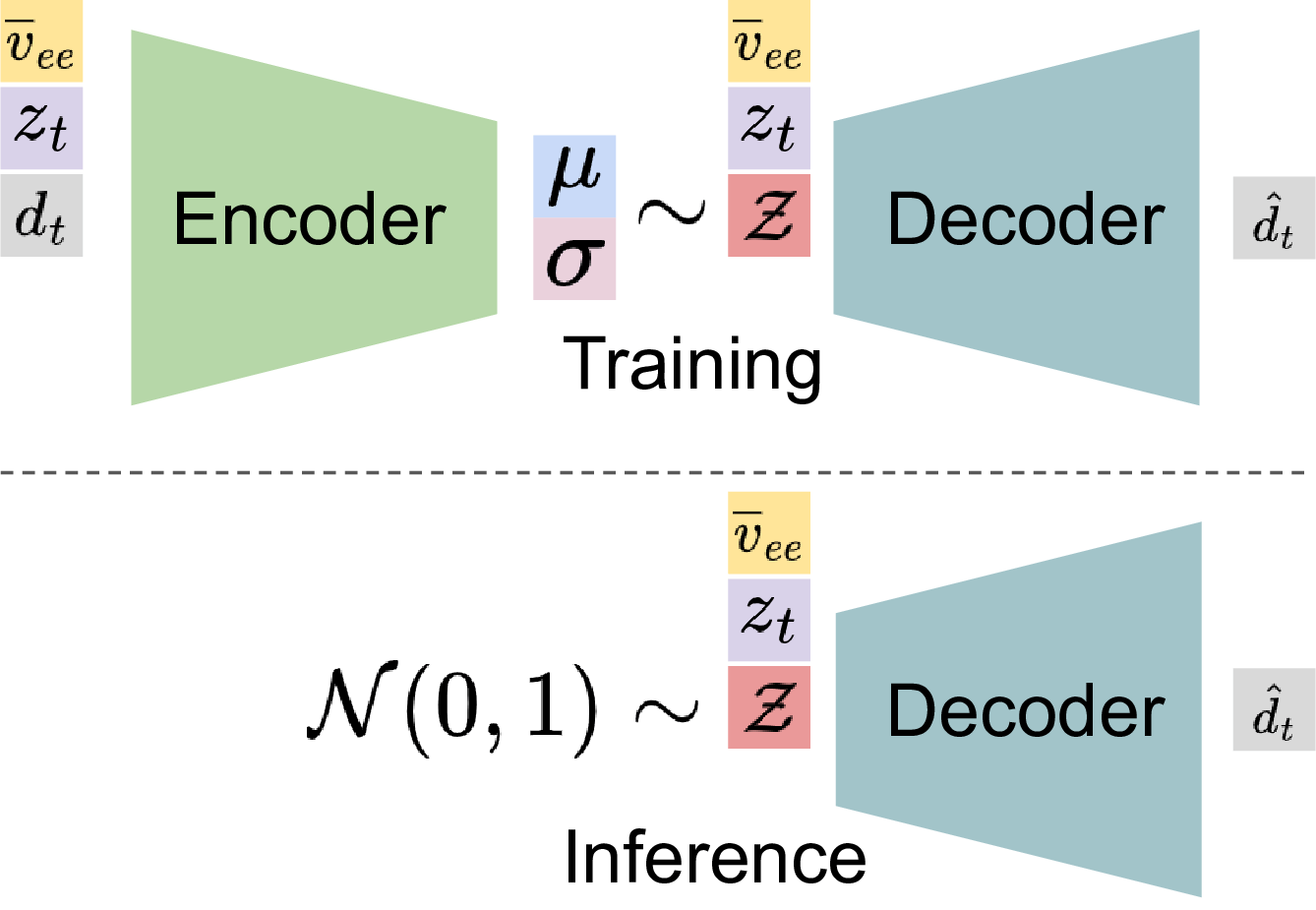

技术框架:该框架包含两个主要阶段:1) 潜在空间学习:使用对比学习构建解耦的潜在空间,捕捉局部运动模式。定制相似性度量用于增强具身之间的对齐。2) 目标条件控制策略学习:在潜在空间中训练目标条件控制策略,使用条件变分自编码器预测潜在空间位移。该策略仅使用人类数据进行训练,可以直接部署在多个机器人上。添加新机器人时,只需学习一个轻量级的机器人特定嵌入层。

关键创新:该方法最重要的技术创新点在于解耦潜在空间的构建和定制相似性度量的引入。解耦潜在空间允许对局部运动模式进行独立表示和学习,从而提高了运动重定向的灵活性和准确性。定制相似性度量能够更好地对齐不同具身之间的运动,从而提高控制策略的泛化能力。与现有方法相比,该方法能够实现更鲁棒、可扩展且与具身无关的机器人控制。

关键设计:对比学习损失函数用于学习解耦的潜在空间。定制相似性度量结合了关节旋转和末端执行器的定位信息。条件变分自编码器用于学习目标条件控制策略。机器人特定嵌入层使用少量数据进行训练,以实现快速添加新机器人。

🖼️ 关键图片

📊 实验亮点

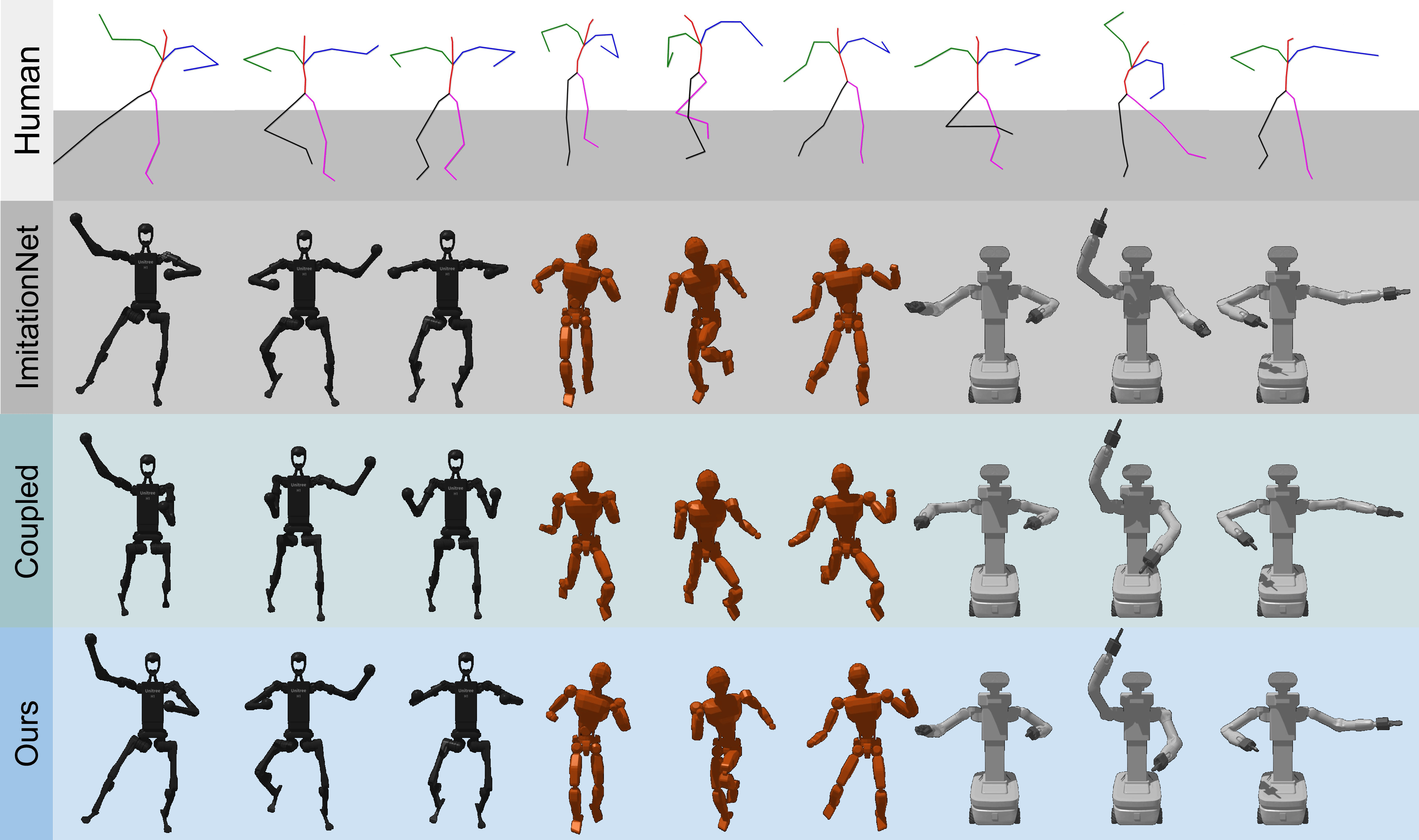

实验结果表明,该方法能够成功地将人类运动数据迁移到各种人形机器人上,并实现鲁棒的控制。与基线方法相比,该方法在运动重定向和控制精度方面均有显著提升。此外,该方法能够快速添加新机器人,并将其集成到现有的控制框架中。

🎯 应用场景

该研究成果可应用于各种人形机器人的控制,例如服务机器人、工业机器人和康复机器人。通过学习通用的控制策略,可以降低机器人开发的成本和时间,并提高机器人的智能化水平。该方法还可用于人机协作,使机器人能够更好地理解和模仿人类的动作。

📄 摘要(原文)

We present a scalable framework for cross-embodiment humanoid robot control by learning a shared latent representation that unifies motion across humans and diverse humanoid platforms, including single-arm, dual-arm, and legged humanoid robots. Our method proceeds in two stages: first, we construct a decoupled latent space that captures localized motion patterns across different body parts using contrastive learning, enabling accurate and flexible motion retargeting even across robots with diverse morphologies. To enhance alignment between embodiments, we introduce tailored similarity metrics that combine joint rotation and end-effector positioning for critical segments, such as arms. Then, we train a goal-conditioned control policy directly within this latent space using only human data. Leveraging a conditional variational autoencoder, our policy learns to predict latent space displacements guided by intended goal directions. We show that the trained policy can be directly deployed on multiple robots without any adaptation. Furthermore, our method supports the efficient addition of new robots to the latent space by learning only a lightweight, robot-specific embedding layer. The learned latent policies can also be directly applied to the new robots. Experimental results demonstrate that our approach enables robust, scalable, and embodiment-agnostic robot control across a wide range of humanoid platforms.